Taille et part du marché de l'analytique de données haute performance

Analyse du marché de l'analytique de données haute performance par Mordor Intelligence

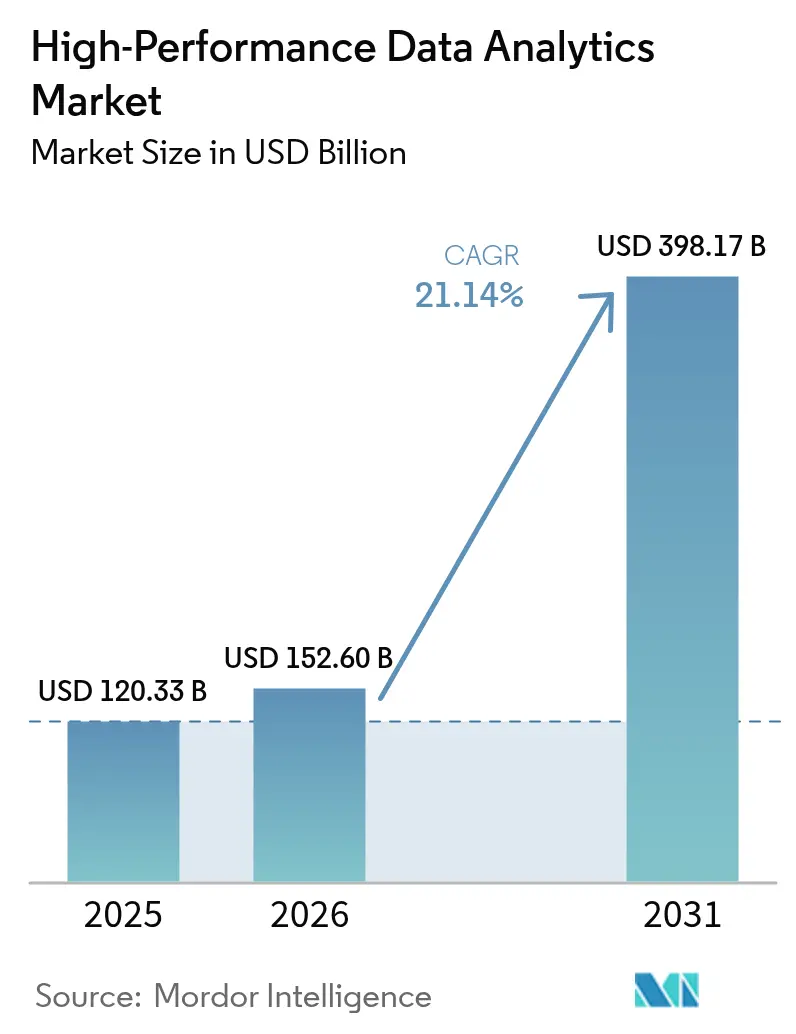

La taille du marché de l'analytique de données haute performance devrait passer de 120,33 milliards USD en 2025 à 152,60 milliards USD en 2026 et atteindre 398,17 milliards USD d'ici 2031, avec un TCAC de 21,14 % sur la période 2026-2031. L'essor de la formation des modèles d'IA et d'apprentissage automatique, la détection de fraudes en temps réel dans le secteur bancaire et l'optimisation des réseaux d'énergie renouvelable contraignent les entreprises à remplacer leurs clusters traditionnels par des architectures GPU parallèles. Les déploiements cloud et hybrides dominent, car les hyperscalers louent des accélérateurs à la demande, supprimant les barrières en capital pour les petites et moyennes entreprises. Le matériel capte toujours la plus grande part des revenus, mais les accélérateurs — GPU, FPGA et ASIC — constituent le composant à la croissance la plus rapide, les charges de travail se déplaçant vers des puces optimisées pour les tenseurs. Sur le plan régional, l'Amérique du Nord est en tête des dépenses, mais l'Asie-Pacifique est le moteur de croissance, les mandats d'IA souveraine en Chine, au Japon et en Inde élargissant la capacité à l'échelle pétascale.

Principaux enseignements du rapport

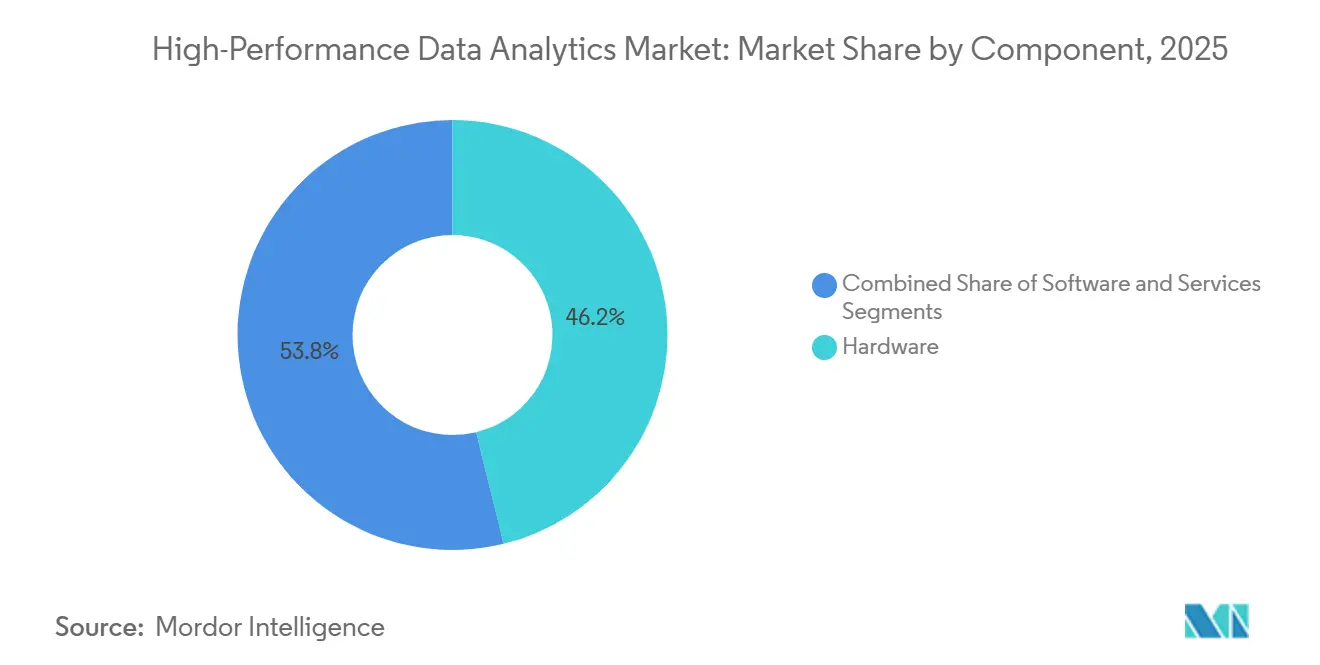

- Par composant, le matériel a représenté 46,19 % de la part des revenus en 2025, tandis que les accélérateurs devraient progresser à un TCAC de 21,97 % jusqu'en 2031.

- Par modèle de déploiement, le cloud et l'hybride ont capté 71,84 % de la part du marché de l'analytique de données haute performance en 2025, et ce même segment devrait croître à un TCAC de 21,56 % jusqu'en 2031.

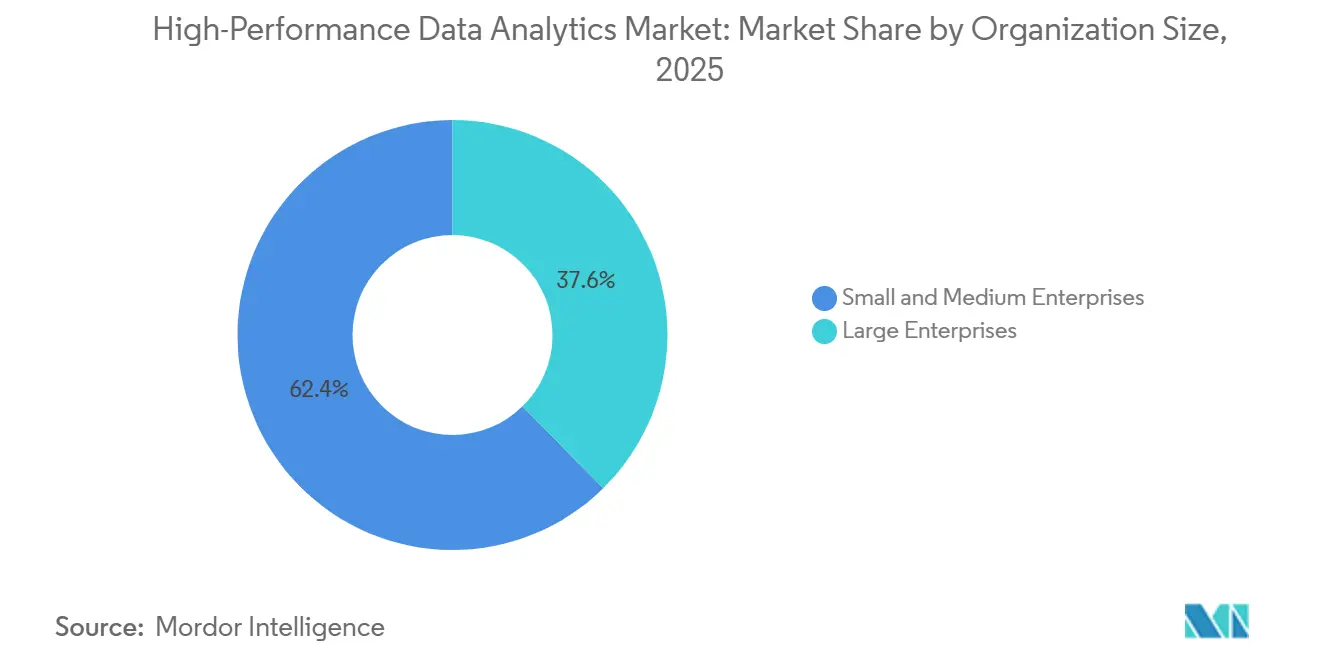

- Par taille d'organisation, les grandes entreprises ont représenté 62,36 % des dépenses en 2025, mais les petites et moyennes entreprises progressent à un TCAC de 21,67 % durant la période 2026-2031.

- Par secteur d'utilisateur final, les services bancaires, financiers et d'assurance ont contribué à hauteur de 24,53 % des revenus en 2025, tandis que le commerce de détail et le commerce électronique devrait croître à un TCAC de 21,88 % jusqu'en 2031.

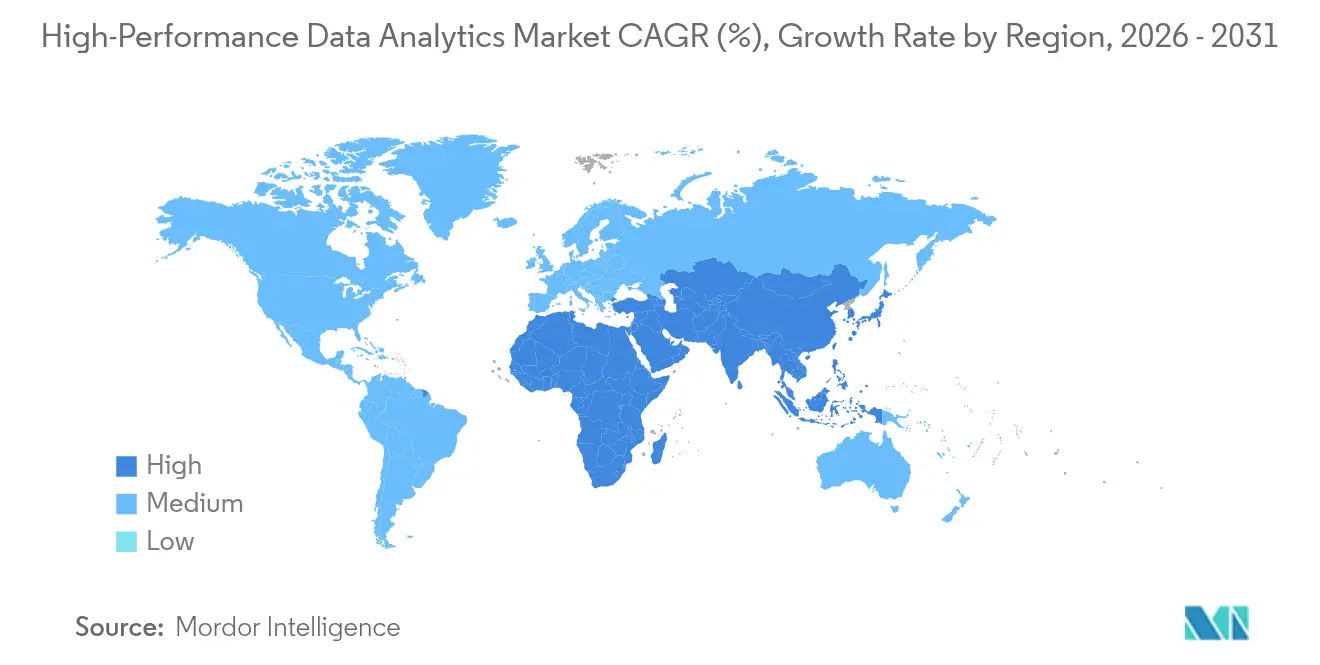

- Par géographie, l'Amérique du Nord a représenté 41,29 % de la part en 2025, tandis que l'Asie-Pacifique est en passe d'atteindre un TCAC de 22,07 % jusqu'en 2031.

Remarque : Les chiffres de la taille du marché et des prévisions de ce rapport sont générés à l’aide du cadre d’estimation propriétaire de Mordor Intelligence, mis à jour avec les données et analyses les plus récentes disponibles en 2026.

Tendances et perspectives du marché mondial de l'analytique de données haute performance

Analyse de l'impact des moteurs*

| Moteur | (~) % d'impact sur les prévisions de TCAC | Pertinence géographique | Horizon temporel de l'impact |

|---|---|---|---|

| Essor de la formation des modèles d'IA et d'apprentissage automatique nécessitant un traitement de données à l'échelle pétaoctet | +4.20% | Mondial, avec une concentration en Amérique du Nord, en Chine et en Europe | Moyen terme (2-4 ans) |

| Croissance du calcul haute performance de la périphérie vers le cloud pour la fabrication intelligente | +3.80% | Cœur Asie-Pacifique (Chine, Japon, Corée du Sud), avec extension vers l'Amérique du Nord et l'Europe | Moyen terme (2-4 ans) |

| Adoption accélérée de l'analytique en temps réel dans les services bancaires, financiers et d'assurance pour la détection de fraudes | +3.50% | Mondial, porté par l'Amérique du Nord et l'Europe, en expansion en Asie-Pacifique | Court terme (≤ 2 ans) |

| Baisse du coût par cœur pour les clusters GPU et CPU rendant le calcul haute performance abordable pour les PME | +3.10% | Mondial, avec des gains précoces en Amérique du Nord, en Europe et en Inde | Long terme (≥ 4 ans) |

| Programmes de modernisation des mégadonnées pour la défense nationale | +2.90% | Amérique du Nord, Europe, Australie et Moyen-Orient | Long terme (≥ 4 ans) |

| Initiatives d'optimisation des réseaux d'énergie renouvelable stimulant l'analytique de calcul haute performance | +2.60% | Europe, Amérique du Nord, avec une adoption émergente en Chine et en Inde | Moyen terme (2-4 ans) |

| Source: Mordor Intelligence | |||

Essor de la formation des modèles d'IA et d'apprentissage automatique nécessitant un traitement de données à l'échelle pétaoctet

Les charges de travail des grands modèles de langage et de l'IA générative s'appuient régulièrement sur des ensembles d'entraînement dépassant 10 pétaoctets, contraignant les entreprises à abandonner les clusters Hadoop liés aux disques au profit de frameworks accélérés par GPU qui réduisent le temps de convergence d'un facteur dix.[1]Nvidia Corporation, "Le framework Nvidia NeMo accélère la formation des grands modèles de langage," nvidia.com Les hyperscalers en Amérique du Nord et en Chine ont enregistré une hausse de 340 % en glissement annuel des heures d'instances GPU en 2025, alors que les entreprises affinaient des modèles de fondation pour la recherche juridique, l'identification de cibles médicamenteuses et la conduite automatisée.[2]Bloomberg News, "AWS et Microsoft réduisent les prix des GPU pour capter les charges de travail d'IA," bloomberg.com Le système monopuce Cerebras WSE-3 a délivré 52 pétaflops au Laboratoire national d'Argonne en 2026, démontrant que les conceptions à l'échelle de la tranche peuvent éliminer les goulots d'étranglement réseau.[3]Microsoft Azure, "Architecture HPC hybride pour les charges de travail d'entreprise," azure.microsoft.com Les fournisseurs cloud intègrent désormais des outils d'orchestration automatisés qui gèrent les points de contrôle et la tolérance aux pannes, permettant aux data scientists de se concentrer sur la logique des modèles sans maîtrise approfondie de MPI. Dès qu'une tâche d'entraînement dépasse 72 heures, les clusters GPU deviennent l'option la moins coûteuse, un seuil déjà franchi par 60 % des projets d'IA d'entreprise en 2025.[4]McKinsey and Company, "Infrastructure d'entraînement de l'IA : considérations économiques et techniques," mckinsey.com

Croissance du calcul haute performance de la périphérie vers le cloud pour la fabrication intelligente

Les usines industrielles diffusent désormais plus d'un téraoctet de données de capteurs par jour, ce qui incite au déploiement de serveurs périphériques compacts qui signalent les anomalies en quelques millisecondes avant d'envoyer des résumés vers des entrepôts cloud. Intel et Foxconn ont équipé 500 lignes d'assemblage à Shenzhen avec des dispositifs périphériques OpenVINO en 2025, réduisant la latence de détection des défauts de 8 secondes à 120 millisecondes et diminuant les rebuts de 18 %. Les constructeurs automobiles suivent le même schéma : l'usine BMW de Ratisbonne utilise des équipements HPE Edgeline pour inspecter les données de soudure 3D en temps réel. Le ministère de l'Économie, du Commerce et de l'Industrie du Japon a réservé 45 milliards JPY (310 millions USD) en 2025 pour subventionner des installations périphériques similaires, visant une hausse de productivité de 12 % d'ici 2028. Des normes internationales telles que l'ISO 23247 ancrent l'interopérabilité, permettant des flottes mixtes de modules d'inférence Nvidia Jetson et de nœuds de prétraitement AMD EPYC.

Adoption accélérée de l'analytique en temps réel dans les services bancaires, financiers et d'assurance pour la détection de fraudes

Les réseaux de paiement mondiaux exigent une notation de fraude en moins d'une seconde, poussant les banques vers une analytique de graphes accélérée par GPU qui cartographie des milliards de nœuds de transactions. JPMorgan Chase a traité 12 milliards de transactions en 2025 sur des serveurs IBM Power10 équipés de GPU Nvidia A100, signalant 4,2 millions d'événements à haut risque tout en réduisant les faux positifs de 30 %. La règle PSD3 européenne, en vigueur depuis janvier 2026, impose une surveillance en temps réel, catalysant les mises à niveau dans toute la région. L'Exadata X10M d'Oracle, lancé mi-2025, conserve l'état des modèles de fraude en mémoire persistante, réduisant la latence de démarrage à froid de 80 %. En Asie-Pacifique, les banques combinent des interfaces cloud public avec des moteurs d'analytique sur site pour rester dans le cadre des règles de souveraineté, à l'instar des implémentations de DBS Bank et d'ICICI Bank.

Baisse du coût par cœur pour les clusters GPU et CPU rendant le calcul haute performance abordable pour les PME

Les prix des accélérateurs ont chuté de 35 % en glissement annuel en 2025, les hyperscalers ayant introduit des puces maison telles qu'AWS Trainium2, élargissant l'accès aux entreprises aux ressources financières limitées. La facturation à la consommation supprime les dépenses en capital, permettant aux PME de faire évoluer les clusters à l'heure plutôt que d'acheter des équipements en totalité. Le service APEX de Dell convertit les déploiements sur site en abonnements mensuels, offrant des coûts prévisibles et des renouvellements automatiques du matériel tous les trois ans. Les incitations du secteur public renforcent la tendance : le programme Digital India de l'Inde rembourse jusqu'à 50 % des dépenses cloud éligibles pour les PME qualifiées. À mesure que les ratios prix accélérateur/CPU diminuent, la période de retour sur investissement pour le basculement vers le cloud tombe en dessous de six mois pour les charges de travail saisonnières, accélérant l'adoption.

Analyse de l'impact des freins*

| Frein | (~) % d'impact sur les prévisions de TCAC | Pertinence géographique | Horizon temporel de l'impact |

|---|---|---|---|

| Coût total de possession élevé pour les clusters de calcul haute performance dédiés | -2.80% | Mondial, particulièrement aigu pour les entreprises de taille intermédiaire en Amérique du Nord et en Europe | Court terme (≤ 2 ans) |

| Pénurie de professionnels qualifiés en calcul haute performance et en programmation parallèle | -2.20% | Mondial, avec des lacunes sévères en Asie-Pacifique et dans les marchés émergents | Long terme (≥ 4 ans) |

| Réglementations sur la souveraineté des données limitant l'analytique cloud transfrontalière | -1.90% | Europe (RGPD), Chine, Inde, avec des restrictions émergentes au Moyen-Orient | Moyen terme (2-4 ans) |

| Problèmes de fiabilité des infrastructures dans les marchés émergents entravant les flux de données continus | -1.60% | Afrique subsaharienne, Asie du Sud-Est, parties de l'Amérique du Sud | Moyen terme (2-4 ans) |

| Source: Mordor Intelligence | |||

Coût total de possession élevé pour les clusters de calcul haute performance dédiés

Les clusters sur site coûtent environ 15 000 USD par nœud GPU, et l'alimentation, le refroidissement et la maintenance annuels ajoutent encore 40 % à 60 % de la dépense initiale, décourageant les entreprises de taille intermédiaire. Une enquête Deloitte de 2025 a révélé que 58 % des fabricants européens citaient les frais de sortie imprévisibles comme un inconvénient majeur du cloud, érodant les économies projetées. La consommation électrique est considérable : un cluster Nvidia H100 de 1 024 nœuds peut consommer 2,5 mégawatts, comparable à 1 800 foyers, obligeant les opérateurs à sécuriser des contrats d'utilité dédiés. Le refroidissement liquide ajoute 1,2 million USD par mégawatt de chaleur évacuée, selon un rapport de l'Uptime Institute. Ces économies désavantagent les entreprises aux charges de travail intermittentes, comme les prévisions trimestrielles, incitant à une migration vers des modèles de paiement à l'usage.

Pénurie de professionnels qualifiés en calcul haute performance et en programmation parallèle

Soixante-huit pour cent des centres de calcul haute performance mondiaux ont signalé des postes CUDA, OpenMP ou MPI vacants en 2025, et le délai de recrutement pour les cadres supérieurs atteignait en moyenne neuf mois. Les universités diplôment moins de 2 000 spécialistes en informatique parallèle par an pour 18 000 postes ouverts, faisant grimper les salaires et ralentissant les déploiements. L'Asie-Pacifique fait face au déficit le plus important, les nouveaux instituts d'IA de Chine et la mission de supercalcul élargie de l'Inde se disputant les mêmes talents, produisant des taux d'attrition supérieurs à 25 % dans les laboratoires de niveau 2. Les entreprises investissent dans des académies internes — IBM a certifié 1 200 développeurs en 2025 — mais former du personnel opérationnel peut prendre un an. La rotation rapide du matériel complique la situation, car le code optimisé pour une génération de GPU peut sous-performer sur la suivante, nécessitant une montée en compétences continue.

*Nos prévisions mises à jour traitent les impacts des moteurs et des freins comme directionnels et non additifs. Les prévisions d’impact révisées reflètent la croissance de base, les effets de mix et les interactions entre variables.

Analyse des segments

Par composant : les accélérateurs propulsent les charges de travail de nouvelle génération

Le segment matériel a représenté 46,19 % des revenus en 2025, consolidant son rôle de colonne vertébrale du marché de l'analytique de données haute performance. Au sein du matériel, les accélérateurs progressent à un TCAC de 21,97 % car les GPU, FPGA et ASIC exécutent les opérations matricielles bien plus rapidement que les CPU. Les GPU Nvidia Blackwell B200 délivrent 20 pétaflops d'inférence FP4 tout en consommant moins d'énergie que les unités A100 précédentes, permettant le service de modèles de langage en temps réel. L'AMD MI300X offre 192 Go de mémoire HBM3, répondant aux limites de bande passante qui contraignaient auparavant la formation de grands modèles. Le stockage NVMe-over-Fabrics à haute vitesse réduit les goulots d'étranglement d'entrées/sorties, poussant le débit soutenu à des niveaux à l'échelle pétaoctet.

Les composants logiciels prospèrent en parallèle, les fournisseurs intégrant une orchestration basée sur Kubernetes qui masque la complexité des clusters, faisant passer le taux d'utilisation moyen de 40 % à plus de 70 %. Les revenus des services augmentent car les entreprises manquant de compétences en calcul haute performance externalisent le réglage et la surveillance. Ensemble, cet écosystème positionne les accélérateurs comme le levier de croissance central, et leur prolifération soutient l'expansion future de la taille du marché de l'analytique de données haute performance, tant sur les sites cloud que sur site.

Note: Les parts de segment de tous les segments individuels sont disponibles à l'achat du rapport

Par modèle de déploiement : les architectures cloud et hybrides dominent

Les modèles cloud et hybrides ont représenté 71,84 % des revenus en 2025, illustrant comment la tarification à la consommation et la scalabilité quasi instantanée s'alignent sur les charges de travail intensives en données. Les instances AWS Trainium2, tarifées 40 % en dessous des offres H100 comparables, ont déclenché une large adoption parmi les start-ups affinant des modèles de langage. Le Cross-Cloud Interconnect de Google, lancé en 2026, déplace des données à l'échelle pétaoctet entre les clusters sur site et Google Compute Engine avec une latence inférieure à 10 millisecondes.

Les secteurs réglementés exécutent encore des charges de travail sensibles dans des centres de données privés, mais la plupart adoptent désormais des frameworks hybrides qui transfèrent les pics saisonniers vers le cloud public. Les frais de sortie s'élèvent en moyenne à 0,09 USD par Go, rendant peu pratique le rapatriement de grands ensembles de données, ce qui ancre effectivement les pipelines d'analytique chez le fournisseur d'origine. Les zones cloud souveraines — AWS Local Zones en Arabie Saoudite et Azure Stack Hub en Inde — tentent de concilier les règles de résidence des données avec les économies d'échelle hyperscale. Ces développements garantissent que les déploiements cloud et hybrides continueront de propulser le marché de l'analytique de données haute performance tout au long de l'horizon de prévision.

Par taille d'organisation : les PME accélèrent l'adoption

Les grandes entreprises ont représenté 62,36 % des dépenses en 2025, car les contrats pluriannuels et les exigences de support mondial favorisent la tarification en volume des hyperscalers. Pourtant, les PME constituent la cohorte à la croissance la plus rapide avec un TCAC de 21,67 %, aidées par des plateformes SaaS à faible barrière d'entrée telles que Databricks Unity Catalog, qui automatise la gouvernance pour les environnements lakehouse. Snowflake Cortex AI permet aux analystes métier de déclencher une analyse de sentiment avec un seul appel SQL, contournant le codage Python.

Les subventions gouvernementales accélèrent l'adoption : le programme SME Go Digital de Singapour subventionne les projets pilotes cloud, tandis que l'Inde offre des crédits d'impôt dans le cadre de Digital India. Les programmes de financement comme Dell APEX étalent les paiements, permettant aux entreprises de traiter l'infrastructure comme une dépense d'exploitation. À mesure que ces mécanismes convergent, les PME élargissent leur part du marché de l'analytique de données haute performance sans avoir à constituer des équipes techniques internes approfondies.

Par secteur d'utilisateur final : le commerce de détail mène la croissance

Les services bancaires, financiers et d'assurance ont contribué à hauteur de 24,53 % des revenus en 2025, ancrés par l'analytique de fraude et la modélisation du capital, mais la croissance se stabilise à mesure que les systèmes cœur arrivent à maturité. Le commerce de détail et le commerce électronique, en revanche, devrait croître à un TCAC de 21,88 %, porté par une personnalisation en moins de 100 millisecondes qui génère des ventes additionnelles avant que l'attention du client ne s'estompe. Le moteur Item 360 de Walmart a analysé 2,5 milliards de transactions quotidiennes en 2025 et réduit les ruptures de stock de 22 %.

Les soins de santé et les sciences de la vie affichent une forte dynamique, car les pipelines génomiques font progresser la demande de calcul de 40 % d'une année sur l'autre. Le gouvernement et la défense, l'énergie et les services publics, et les télécommunications détiennent collectivement des parts à un chiffre moyen, mais les cas d'usage — optimisation des réseaux, découpage en tranches des réseaux 5G, contrôle qualité — s'élargissent. Ces dynamiques verticales soutiennent collectivement l'expansion du marché de l'analytique de données haute performance.

Analyse géographique

L'Amérique du Nord a conservé 41,29 % des dépenses de 2025 grâce aux dépenses en capital des hyperscalers dépassant 200 milliards USD et aux programmes exascale fédéraux tels que le système Frontier qui a franchi la barrière de l'exaflop. Le Canada a investi 400 millions CAD (295 millions USD) en 2025 pour porter la capacité nationale à 100 pétaflops d'ici 2027. Le Mexique émerge comme un hub de centres de données en délocalisation de proximité avec un investissement combiné des hyperscalers de 3,2 milliards USD en 2025.

L'Asie-Pacifique est prévue pour la croissance la plus rapide avec un TCAC de 22,07 %, portée par le plan de la Chine pour 1 000 exaflops d'ici 2030 et la feuille de route hybride quantique-classique du Japon. L'Inde a étendu sa Mission nationale de supercalcul à 18 centres en 2025 avec 4 500 crores INR (540 millions USD) alloués pour les mises à niveau de la troisième phase. Le nouveau supercalculateur de Canberra en Australie vise 50 pétaflops pour la recherche climatique. Les lois sur la souveraineté des données en Chine et en Inde insistent sur le traitement local, orientant les investissements vers des zones cloud nationales.

L'Europe détient une part d'environ 20 %, soutenue par l'Entreprise commune EuroHPC qui a financé des systèmes pré-exascale en Espagne, en Italie et en Allemagne avec des budgets dépassant 8 milliards EUR (9 milliards USD). Le JUPITER allemand a atteint 500 pétaflops en 2025, illustrant un refroidissement liquide économe en énergie. Le Royaume-Uni a réservé 900 millions GBP (1,15 milliard USD) pour une Ressource de recherche en IA, bien que l'exode des talents après le Brexit ralentisse les progrès. L'Amérique du Sud et le Moyen-Orient et l'Afrique restent naissants mais pas inactifs ; le fonds souverain d'Arabie Saoudite a ouvert un centre national de calcul haute performance en 2025.

Paysage concurrentiel

Le marché présente une concentration modérée : les cinq premiers fournisseurs — Amazon Web Services, Microsoft, Google, Hewlett Packard Enterprise et Nvidia — ont capté environ 55 % des revenus mondiaux en 2025. Les hyperscalers s'intègrent verticalement en concevant des puces personnalisées telles qu'AWS Trainium2, Google TPU v5 et Microsoft Maia pour réduire leur dépendance aux puces tierces. Les entreprises matérielles traditionnelles pivotent vers l'orchestration définie par logiciel et les services gérés, intégrant des clusters Kubernetes aux ventes d'infrastructure pour masquer la complexité.

Les acteurs émergents comme Cerebras Systems utilisent du silicium à l'échelle de la tranche pour éliminer la latence entre nœuds, et Graphcore cible l'inférence creuse avec des unités de traitement de l'intelligence, mais les deux manquent de la portée de distribution des hyperscalers.

Les frameworks open source — Apache Spark, Dask, Ray — banalisent les intergiciels, poussant les fournisseurs propriétaires à se différencier par des certifications de sécurité et un support entreprise. Les fusions reconfigurent le secteur : Broadcom a acquis VMware en 2024 pour renforcer les liens de virtualisation, et l'acquisition antérieure de Xilinx par AMD renforce sa gamme FPGA. La rivalité globale se concentre sur la réduction du coût par flop tout en intégrant l'analytique directement dans des plateformes SaaS verticales.

Leaders du secteur de l'analytique de données haute performance

SAS Institute, Inc.

Oracle Corporation

ATOS SE

Microsoft Corporation

NVIDIA Corporation

- *Avis de non-responsabilité : les principaux acteurs sont triés sans ordre particulier

Développements récents du secteur

- Mai 2025 : NVIDIA a dévoilé l'architecture Blackwell Ultra avec le rack NVL576 qui héberge 576 GPU Rubin Ultra, permettant un calcul d'IA de classe exascale tout en réduisant la consommation d'énergie grâce à l'optique co-packagée.

- Mai 2025 : One Stop Systems a signé un accord de recherche et développement coopératif avec l'USSOCOM pour co-développer des unités de calcul haute performance périphériques robustes pour les charges de travail d'IA sur le terrain.

- Mai 2025 : Seer a lancé Proteograph ONE plus l'automatisation SP200, portant le débit hebdomadaire de protéomique au-delà de 1 000 échantillons.

- Avril 2025 : Google Cloud a lancé des services de fondation de données autonomes et des agents de flux de travail qui améliorent la productivité des campagnes pour des partenaires tels que Radisson Hotel Group de 50 %.

- Mars 2025 : IonOpticks a nommé de nouveaux responsables des ventes mondiaux pour préparer l'expansion des lancements en protéomique et en clinique.

Périmètre du rapport mondial sur le marché de l'analytique de données haute performance

Le rapport sur le marché de l'analytique de données haute performance est segmenté par composant (matériel, logiciel, services), modèle de déploiement (sur site, cloud et hybride), taille d'organisation (petites et moyennes entreprises, grandes entreprises), secteur d'utilisateur final (services bancaires, financiers et d'assurance, gouvernement et défense, énergie et services publics, commerce de détail et commerce électronique, soins de santé et sciences de la vie, services de télécommunication et informatiques, fabrication), et géographie (Amérique du Nord, Amérique du Sud, Europe, Asie-Pacifique, Moyen-Orient, Afrique). Les prévisions du marché sont fournies en termes de valeur (USD).

| Matériel | Serveurs |

| Accélérateurs (GPU, FPGA, ASIC) | |

| Stockage haute vitesse | |

| Interconnexion et mise en réseau | |

| Logiciel | Systèmes de fichiers distribués et bases de données |

| Frameworks et bibliothèques d'analytique | |

| Orchestration et gestion de clusters | |

| Services | Services professionnels |

| Services gérés |

| Sur site |

| Cloud et hybride |

| Petites et moyennes entreprises |

| Grandes entreprises |

| Services bancaires, financiers et d'assurance |

| Gouvernement et défense |

| Énergie et services publics |

| Commerce de détail et commerce électronique |

| Soins de santé et sciences de la vie |

| Services de télécommunication et informatiques |

| Fabrication |

| Amérique du Nord | États-Unis |

| Canada | |

| Mexique | |

| Amérique du Sud | Brésil |

| Argentine | |

| Chili | |

| Pérou | |

| Reste de l'Amérique du Sud | |

| Europe | Allemagne |

| Royaume-Uni | |

| France | |

| Italie | |

| Espagne | |

| Reste de l'Europe | |

| Asie-Pacifique | Chine |

| Japon | |

| Corée du Sud | |

| Inde | |

| Australie | |

| Nouvelle-Zélande | |

| Reste de l'Asie-Pacifique | |

| Moyen-Orient | Émirats arabes unis |

| Arabie Saoudite | |

| Turquie | |

| Reste du Moyen-Orient | |

| Afrique | Afrique du Sud |

| Reste de l'Afrique |

| Par composant | Matériel | Serveurs |

| Accélérateurs (GPU, FPGA, ASIC) | ||

| Stockage haute vitesse | ||

| Interconnexion et mise en réseau | ||

| Logiciel | Systèmes de fichiers distribués et bases de données | |

| Frameworks et bibliothèques d'analytique | ||

| Orchestration et gestion de clusters | ||

| Services | Services professionnels | |

| Services gérés | ||

| Par modèle de déploiement | Sur site | |

| Cloud et hybride | ||

| Par taille d'organisation | Petites et moyennes entreprises | |

| Grandes entreprises | ||

| Par secteur d'utilisateur final | Services bancaires, financiers et d'assurance | |

| Gouvernement et défense | ||

| Énergie et services publics | ||

| Commerce de détail et commerce électronique | ||

| Soins de santé et sciences de la vie | ||

| Services de télécommunication et informatiques | ||

| Fabrication | ||

| Par géographie | Amérique du Nord | États-Unis |

| Canada | ||

| Mexique | ||

| Amérique du Sud | Brésil | |

| Argentine | ||

| Chili | ||

| Pérou | ||

| Reste de l'Amérique du Sud | ||

| Europe | Allemagne | |

| Royaume-Uni | ||

| France | ||

| Italie | ||

| Espagne | ||

| Reste de l'Europe | ||

| Asie-Pacifique | Chine | |

| Japon | ||

| Corée du Sud | ||

| Inde | ||

| Australie | ||

| Nouvelle-Zélande | ||

| Reste de l'Asie-Pacifique | ||

| Moyen-Orient | Émirats arabes unis | |

| Arabie Saoudite | ||

| Turquie | ||

| Reste du Moyen-Orient | ||

| Afrique | Afrique du Sud | |

| Reste de l'Afrique | ||

Questions clés auxquelles le rapport répond

À quelle vitesse les dépenses en analytique de données haute performance devraient-elles croître ?

Entre 2026 et 2031, les dépenses devraient progresser à un TCAC de 21,14 %, faisant passer le marché de 152,60 milliards USD en 2026 à 398,17 milliards USD d'ici 2031.

Quel modèle de déploiement génère la plus grande part des revenus actuels ?

Les déploiements cloud et hybrides ont généré 71,84 % des revenus mondiaux en 2025, reflétant une large préférence pour la tarification à la consommation et la capacité élastique.

Pourquoi les accélérateurs sont-ils si importants pour les charges de travail analytiques ?

Les GPU, FPGA et ASIC exécutent les opérations tensorielles et matricielles bien plus rapidement que les CPU, permettant l'inférence d'IA en temps réel et réduisant le temps de formation des modèles, ce qui propulse leur TCAC de 21,97 %.

Quelle région devrait afficher la croissance la plus élevée jusqu'en 2031 ?

L'Asie-Pacifique devrait croître à un TCAC de 22,07 % car les mandats d'IA souveraine en Chine, au Japon et en Inde continuent d'ajouter de la capacité à l'échelle pétascale.

Quelles sont les limites à l'adoption sur site pour les entreprises de taille intermédiaire ?

Le coût total de possession élevé, incluant 15 000 USD par nœud GPU plus des factures d'alimentation et de refroidissement importantes, rend les clusters dédiés difficiles à justifier pour les charges de travail intermittentes.

Quelle est la gravité de la pénurie de talents en programmation parallèle ?

En 2025, 68 % des centres de calcul haute performance ont signalé des postes CUDA ou MPI non pourvus, et la demande mondiale dépassait l'offre universitaire d'environ neuf fois, prolongeant les cycles de recrutement à neuf mois.

Dernière mise à jour de la page le: