KI-Chipsätze-Marktgröße und -Marktanteil

KI-Chipsätze-Marktanalyse von Mordor Intelligence

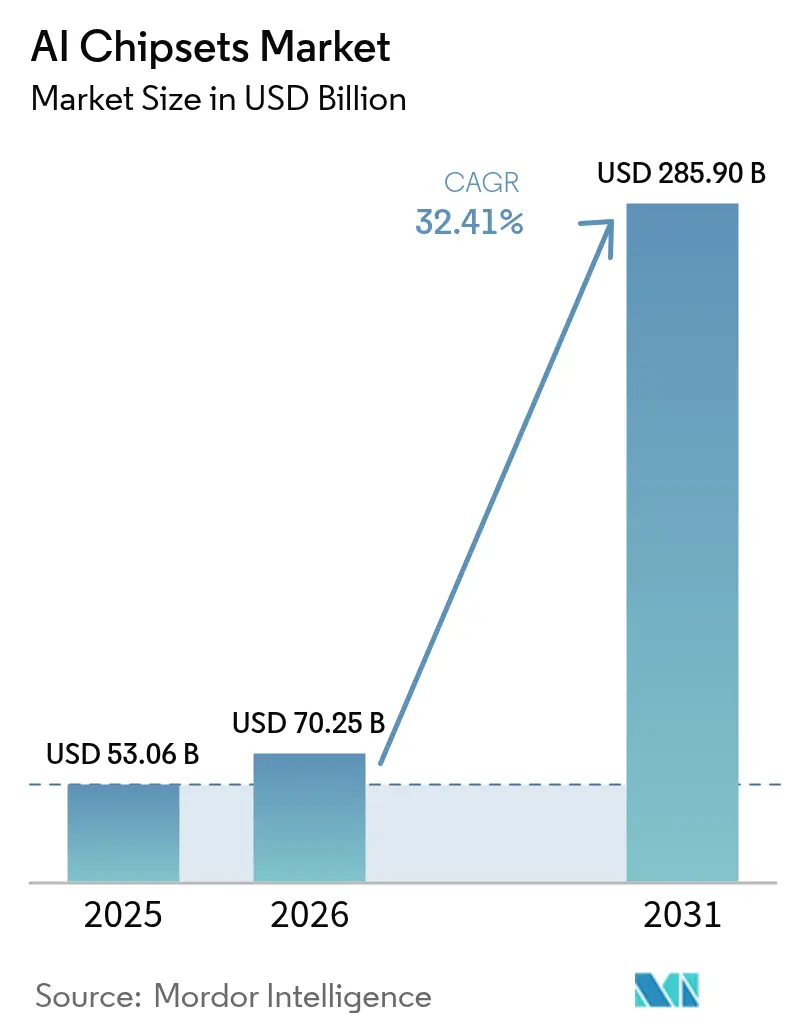

Die KI-Chipsätze-Marktgröße wird für 2026 auf 70,25 Mrd. USD geschätzt, ausgehend von einem Wert von 53,06 Mrd. USD im Jahr 2025, mit Projektionen für 2031, die 285,9 Mrd. USD zeigen, bei einer CAGR von 32,41 % über den Zeitraum 2026–2031.

Beispielloser Bedarf an rechenintensiven großen Sprachmodellen, eine beschleunigte Einführung softwaredefinierter Fahrzeuge und Durchbrüche bei ultraenergiesparsamen Edge-Siliziumlösungen sind die drei strukturellen Kräfte, die dieses Wachstum vorantreiben. Leistungsgewinne sind nach wie vor eng mit fortschrittlicher Verpackungstechnologie und Hochbandbreitenspeicher verbunden, doch Versorgungsengpässe unterhalb des 3-nm-Knotens begrenzen die kurzfristige Produktion. Gleichzeitig formen Exportkontrollbeschränkungen, Energieeffizienzgebote und Nachhaltigkeitsziele die Beschaffungsentscheidungen um und begünstigen Architekturen, die eine höhere Leistung pro Watt liefern können. Marktteilnehmer, die in der Lage sind, rohen Durchsatz mit thermischer Effizienz und Versorgungskettenresilienz in Einklang zu bringen, sichern sich langfristige Design-Wins in Rechenzentrum-, Automobil- und Edge-Einsatzgebieten in allen wichtigen Regionen. Insgesamt positionieren diese Dynamiken den KI-Chipsätze-Markt als grundlegenden Ermöglicher von generativer KI, Souveräne-Cloud-Strategien und geräteseitiger Intelligenz bis 2030. [1]NVIDIA Corporation, "NVIDIA meldet Rekordergebnisse für Q1 GJ2026," nvidia.com

Wesentliche Erkenntnisse des Berichts

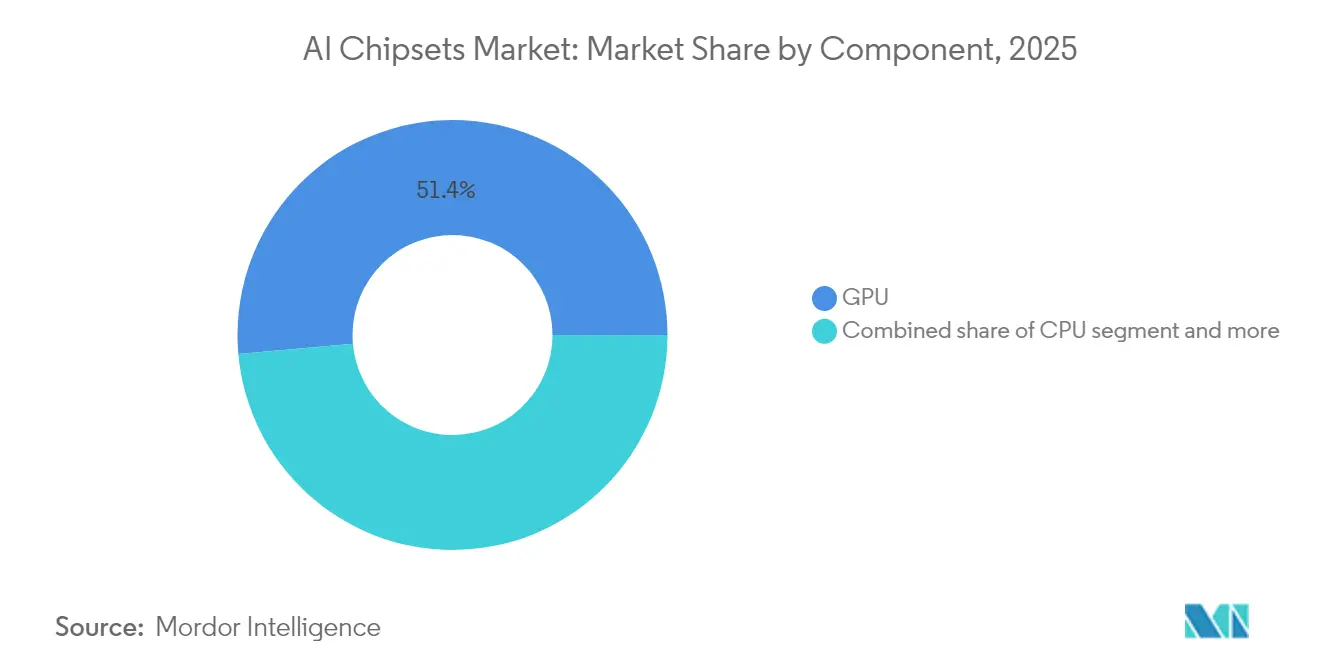

- Nach Komponente führten GPUs mit einem KI-Chipsätze-Marktanteil von 51,40 % im Jahr 2025, während NPUs und ASICs bis 2031 mit einer jährlichen Wachstumsrate (CAGR) von 44,2 % expandieren sollen.

- Nach Verarbeitungstyp beanspruchten Trainings-Workloads 2025 einen Anteil von 60,30 % an der Marktgröße; die Inferenz schreitet bis 2031 mit einer CAGR von 36,9 % voran.

- Nach Bereitstellungsort hielten Cloud- und Hyperscale-Rechenzentren 2025 einen Anteil von 63,10 % an der KI-Chipsätze-Marktgröße, während Edge-Geräte voraussichtlich mit einer CAGR von 39,2 % bis 2031 wachsen werden.

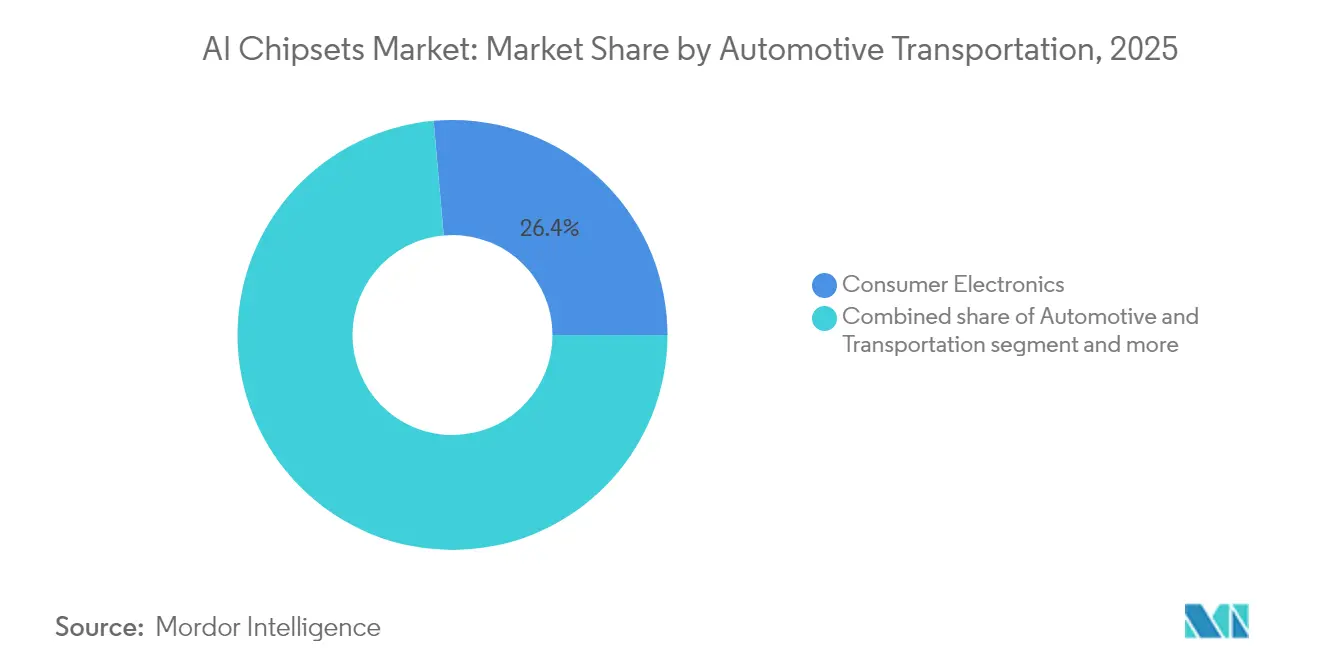

- Nach Anwendung entfiel 2025 ein Anteil von 26,40 % an der Marktgröße auf Unterhaltungselektronik; Automobil und Transport wird voraussichtlich die schnellste CAGR von 42,6 % bis 2031 verzeichnen.

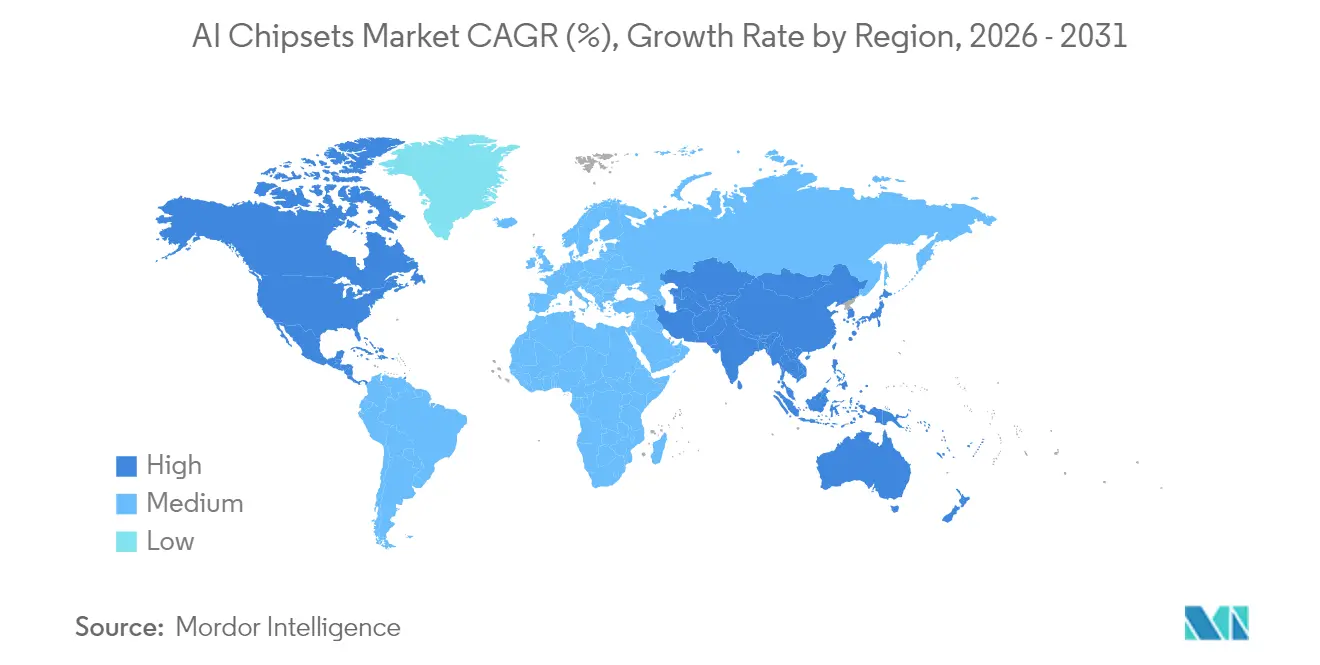

- Nach Geographie entfiel 2025 ein Anteil von 41,10 % am KI-Chipsätze-Marktanteil auf den asiatisch-pazifischen Raum, während die Region Naher Osten und Afrika voraussichtlich mit einer CAGR von 34,1 % bis 2031 wachsen wird.

- Auf Anbieterseite kontrollierten NVIDIA, AMD, Intel, Google und Amazon 2024 gemeinsam mehr als 80 % des Marktanteils bei Trainings-Beschleunigern.

Hinweis: Die Marktgrößen- und Prognosezahlen in diesem Bericht werden mithilfe des proprietären Schätzrahmens von Mordor Intelligence erstellt und mit den neuesten verfügbaren Daten und Erkenntnissen bis 2026 aktualisiert.

Globale KI-Chipsätze-Markttrends und -Einblicke

Analyse der Auswirkungen der Treiber*

| Treiber | (~) % Auswirkung auf die CAGR-Prognose | Geografische Relevanz | Zeithorizont der Auswirkung |

|---|---|---|---|

| Explosionsartig wachsender Trainingsbedarf an Rechenleistung durch Entwickler von Frontier-Modellen | 12.50% | Global, konzentriert in den USA, China, EU | Mittelfristig (2–4 Jahre) |

| Silizium-Design-Wins für softwaredefinierende Fahrzeuge im Automobilbereich | 8.20% | Global, angeführt von Deutschland, USA, China, Japan | Langfristig (≥ 4 Jahre) |

| Durchbrüche bei ultraenergiesparsamen Edge-KI-ASICs | 6.80% | Global, frühe Einführung im asiatisch-pazifischen Raum und Nordamerika | Kurzfristig (≤ 2 Jahre) |

| Nationale KI-Infrastruktur-Konjunkturprogramme (USA/China/EU) | 9.10% | USA, China, EU, mit Ausstrahlungseffekten auf verbündete Nationen | Mittelfristig (2–4 Jahre) |

| Open-Source-Silizium-Beschleunigungsframeworks (RISC-V) | 4.30% | Global, am stärksten in China, aufkommend in Indien und Europa | Langfristig (≥ 4 Jahre) |

| Technologische Fortschritte bei Hochbandbreitenspeicher (HBM) | 7.40% | Global, konzentriert in Südkorea, Taiwan, Japan | Kurzfristig (≤ 2 Jahre) |

| Quelle: Mordor Intelligence | |||

Explosionsartig wachsender Trainingsbedarf an Rechenleistung durch Entwickler von Frontier-Modellen

Der jährliche Rechenbedarf für großskalige Sprachmodelle verzehnfacht sich alle 18 Monate und treibt anhaltende Aufträge für Multi-Die-GPUs und fortschrittliche Verpackungslösungen an. Der Rechenzentrumsumsatz von NVIDIA stieg im Q4 2025 auf 35,6 Mrd. USD, gestützt durch Blackwell-Supercomputer-Lieferungen, was verdeutlicht, wie Hyperscale-Kunden riesige KI-spezifische Lagerbestände aufbauen. Multimodale Modellentwickler benötigen nun Tausende von miteinander verbundenen Beschleunigern, was die Nachfrage nach CoWoS-Substraten und HBM-Stacks der nächsten Generation vorantreibt. Infolgedessen wird erwartet, dass führende KI-Unternehmen bis 2027 15–20 % der globalen KI-Rechenkapazität kontrollieren werden, was eine kontinuierliche Beschaffung von Silizium der 3-nm-Klasse sicherstellt. Diese Volumenkonzentration verschärft kurzfristige Engpässe, schafft aber eine mehrjährige Umsatzpipeline für Lieferanten, die auf fortschrittlichen Knoten produzieren können. Folglich wird der KI-Chipsätze-Markt von einem strukturell höheren Sockel an trainingsorientierten Käufen über den Prognosehorizont hinaus profitieren.

Silizium-Design-Wins für softwaredefinierende Fahrzeuge im Automobilbereich

Automobilhersteller konsolidieren Dutzende von elektronischen Steuergeräten in zentralisierte, KI-fähige Rechendomänen. Branchenanalysten prognostizieren, dass bis 2035 80 % der neuen Fahrzeuge KI-Funktionalität integrieren werden, was eine große installierte Basis für inferenzklassige Beschleuniger schafft. NXPs S32N-Prozessoren, die auf 5-nm-Technologie basieren, liefern 34 TOPS und erfüllen gleichzeitig strenge ASIL-D-Anforderungen, was signalisiert, dass Automobil-Sicherheitstauglichkeit und KI-Rechenleistung in einem einzigen Gerät koexistieren können. Da jeder Designzyklus sieben bis zehn Jahre umfasst, generiert das für heutige Modelle ausgewählte Silizium annuitätenähnliche Volumen für ihre Lieferanten. Design-Wins, die jetzt für Level-3-Autonomie, Sensorfusion und Over-the-Air-Aktualisierbarkeit vergeben werden, werden daher die Nachfrage während des Prognosezeitraums steigern.

Durchbrüche bei ultraenergiesparsamen Edge-KI-ASICs

Edge-native Prozessoren bringen Echtzeit-Inferenz zu mobilen, IoT- und industriellen Endpunkten, die nicht von Cloud-Konnektivität abhängig sein können. Syntiant's NDP250 liefert 30 GOPS in einem Milliwatt-Bereich und ermöglicht stets aktive Sprachassistenten und lokale Interaktionen mit großen Sprachmodellen. BrainChips neuromorpher Koprozessor nutzt ähnlich die ereignisgesteuerte Verarbeitung, um die Leistungsaufnahme zu minimieren, und erschließt KI in batteriebetriebenen Sensoren und Wearables. Diese Durchbrüche ermöglichen es OEMs, Intelligenz zu integrieren, ohne den Formfaktor oder die Akkulaufzeit zu beeinträchtigen, was Design-Wins in der Gesundheitsdiagnostik, vorausschauenden Wartung und Mensch-Maschine-Schnittstellen beschleunigt. Die Geschwindigkeit, mit der Massenverbraucherprodukte solche ASICs integrieren, vergrößert die Stückzahlentwicklung und fügt dem KI-Chipsätze-Markt einen weiteren Rückenwind hinzu.

Nationale KI-Infrastruktur-Konjunkturprogramme

Souveräne KI-Agenden schreiben die Nachfragekurven für Halbleiter um. Der CHIPS and Science Act stellt mehr als 50 Mrd. USD für US-amerikanische Fertigungskapazitäten und Forschung & Entwicklung bereit, während China 143 Mrd. USD für KI-Selbständigkeit zugesagt hat. Der KI-Infrastruktur-Masterplan der Vereinigten Arabischen Emirate in Höhe von 200 Mrd. USD – mit NVIDIA-Chips im Kern – treibt neue Nachfrage im Nahen Osten an. Solche Fiskalprogramme subventionieren Chipwerke, Rechenzentren und Verpackungsanlagen, verankern die lokale Nachfrage, die weniger empfindlich gegenüber globalen Makrozyklen ist. Die daraus resultierende Beschaffung von KI-Beschleunigern, Spezialspeichern und Verbindungssilizium steigert die adressierbaren Volumen für Ökosystemakteure und hält die zweistellige Marktexpansion mittelfristig aufrecht. [2]Kongress der Vereinigten Staaten, "CHIPS and Science Act von 2022," congress.gov

Analyse der Auswirkungen von Hemmnissen*

| Hemmnis | (~) % Auswirkung auf die CAGR-Prognose | Geografische Relevanz | Zeithorizont der Auswirkung |

|---|---|---|---|

| Versorgungsketten-Lithografieengpässe unterhalb von 3 nm | -5.20% | Global, konzentrierte Auswirkungen auf Taiwan, Südkorea | Kurzfristig (≤ 2 Jahre) |

| KI-Modellkomprimierung reduziert den Siliziumbedarfs | -3.80% | Global, angeführt von Forschungseinrichtungen und Hyperscalern | Mittelfristig (2–4 Jahre) |

| Geopolitische Exportkontrollbeschränkungen für fortschrittliche GPUs | -4.10% | China, Russland, mit sekundären globalen Auswirkungen | Mittelfristig (2–4 Jahre) |

| Eskalierendes thermisches Design-Limit für Geräte | -2.90% | Global, akut in Rechenzentren und mobilen Geräten | Langfristig (≥ 4 Jahre) |

| Quelle: Mordor Intelligence | |||

Versorgungsketten-Lithografieengpässe unterhalb von 3 nm

Hochapertur-EUV-Maschinen, die für die 2-nm-Produktion benötigt werden, kosten jeweils mehr als 300 Mio. USD und sind mengenmäßig begrenzt. TSMCs erste 2-nm-Pilotlinie geht Ende 2025 in die Massenproduktion, sieht sich aber mit erheblichen Vorabzuteilungen von Flaggschiff-Kunden konfrontiert. Die Kapazitätsknappheit treibt die Waferpreise in die Höhe und verlängert die Lieferzeiten für KI-Beschleuniger, die auf diesen Knoten gefertigt werden. Chinas Ausschluss von der Hochapertur-Lithografie fragmentiert die globalen Lieferketten weiter und erhöht die Aussicht auf doppelte Technologiestandards. Der Nettoeffekt senkt die kurzfristige Einheitenverfügbarkeit und dämpft das Wachstum des KI-Chipsätze-Marktes, bis nach 2027 weitere Chipwerke in Betrieb gehen.

KI-Modellkomprimierung reduziert den Siliziumbedarfs

Pruning-, Quantisierungs- und Wissensdestillationstechniken können den Inferenz-Rechenbedarf um bis zu 70 % senken, sodass kleinere Modelle die ursprüngliche Genauigkeit erreichen können. Werden diese Methoden in großem Umfang eingesetzt, würden sie den Bedarf an High-End-Chips für bestimmte Workloads verringern und das gesamte Siliziumvolumenwachstum mäßigen. Folglich stellt die Komprimierungsinnovation eine strukturelle Gegenkraft zum Markt dar, auch wenn sie eine breitere KI-Verbreitung ermöglicht.

*Unsere aktualisierten Prognosen behandeln die Auswirkungen von Treibern und Hemmnissen als richtungsweisend und nicht additiv. Die überarbeiteten Wirkungsprognosen spiegeln das Basiswachstum, Mixeffekte und Wechselwirkungen zwischen Variablen wider.

Segmentanalyse

Nach Komponente: Speicherintegration treibt die Siliziumevolution voran

GPUs hielten 2025 mit einem KI-Chipsätze-Marktanteil von 51,40 % die Führung, indem sie unübertroffene Parallelität für das Training lieferten, auch wenn NPUs und ASICs bis 2031 voraussichtlich mit einer CAGR von 44,2 % wachsen werden. Die dem GPU-Versand zugeordnete Marktgröße wird in absoluten Zahlen weiter steigen, da Frontier-Modelle die Rechenbudgets aufblähen, doch die Anteilsverschiebung hin zu domänenspezifischem Silizium ist unverkennbar. Speicher- und Speicherlieferanten erfreuen sich außerordentlicher Rückenwinde: HBM3E-Stacks von Samsung erreichen nun 36 GB pro Die und decken den Bedarf an größeren Kontextfenstern, während die durchschnittlichen Verkaufspreise steigen. Ein HBM-Preisanstieg von 500 % seit 2024 bestätigt den Appetit des Marktes auf Bandbreite gegenüber reiner Frequenz. Heterogene Designs auf Basis von Chiplets integrieren CPUs, NPUs und HBM auf einem gemeinsamen Interposer, um die Leistungshüllkurven für Edge-Inferenz zu optimieren. Anbieter, die fortschrittliche 2,5D-Verpackung, Die-zu-Die-Verbindungen und Speicher-Co-Location beherrschen, werden innerhalb des sich entwickelnden KI-Chipsätze-Marktes Prämienmargen erzielen.

Das CPU-Segment passt sich durch On-Die-KI-Beschleuniger und neue Befehlssätze an und bewahrt seine Relevanz in traditionellen Workloads, die Steuerungslogik und Inferenz vermengen. FPGAs gewinnen dort wieder an Schwung, wo deterministische Latenz oder In-Field-Aktualisierbarkeit den absoluten Durchsatz überwiegen, insbesondere in Industrierobotern und Telekommunikations-Gateways. Architektonische Vielfalt erhöht letztlich den gesamten adressierbaren Markt, da jeder Workload dem effizientesten Siliziumblock zugeordnet wird. Lieferanten, die Multi-Chiplet-Lösungen orchestrieren können, sind daher für überproportionale Anteilsgewinne positioniert, da Systemintegratoren schlüsselfertige Subsysteme statt diskreter Einzelteile fordern.

Notiz: Segmentanteile aller Einzelsegmente sind nach dem Kauf des Berichts verfügbar

Nach Verarbeitungstyp: Inferenzbeschleunigung gestaltet Silizium-Prioritäten neu

Das Training beanspruchte 2025 mit einem KI-Chipsätze-Marktanteil von 60,30 % die Führung, verankert durch Hyperscale-Rechenzentrum-Cluster, die Hunderte von Petaflops pro Rack betreiben. Die mit dem Training verknüpfte Marktgröße wird weiter wachsen, da die Parameteranzahl in multimodalen Modellen geometrisch ansteigt; Szenarien deuten auf 100 Millionen H100-klassen-GPUs hin, die bis 2030 benötigt werden. Dennoch werden die Inferenz-Lieferungen mit einer CAGR von 36,9 % skalieren, da Unternehmen generative KI-Dienste branchenübergreifend einführen und kleinere Modelle an der Netzwerkkante einbetten. Cerebras Systems und Qualcomm demonstrierten gemeinsam ein 10-faches Preis-Leistungs-Verhältnis gegenüber etablierten Lösungen und bestätigten damit, dass neue Architekturen historische Kostenkurven aufbrechen können.

Edge-Inferenz-Beschleuniger priorisieren Energieeffizienz gegenüber FLOPS, was Chip-Anbieter dazu veranlasst, Niederspannungs-SRAM, Near-Memory-Computing und analoge Verarbeitung für Kerne wie Attention oder Faltung einzusetzen. Diese Dichotomie schafft zwei parallele Produkt-Roadmaps: ultra-dichte, flüssigkeitsgekühlte Dies für das Training und schlanke, Milliwatt-klassen-ASICs für die Inferenz. Anbieter, die beide Kategorien abdecken, können Software-Toolchains cross-selln, während Spezialisten möglicherweise Nischen rund um Latenz, Sicherheit oder preissensible Endpunkte besetzen. Die daraus resultierende Wettbewerbsspannung hält die Innovation im gesamten KI-Chipsätze-Markt aufrecht.

Nach Bereitstellungsort: Edge-Computing treibt architektonische Innovationen voran

Cloud-Einrichtungen generierten 2025 63,10 % der KI-Chipsätze-Marktgröße, da Hyperscaler 500 Mrd. USD in neue Rechenzentrumbauten flossen ließen. Trotz dieser Dominanz wird prognostiziert, dass Edge-Bereitstellungen mit einer CAGR von 39,2 % zunehmen werden, was den Bedarf an Echtzeit-Analysen, reduzierten Backhaul-Kosten und der Einhaltung von Datensouveränität widerspiegelt. Unternehmen verlagern auch ausgewählte KI-Workloads zurück in On-Premises-Cluster, die mit Intels Gaudi-3-Beschleunigern ausgestattet sind und einen um 50 % höheren Inferenz-Durchsatz als NVIDIAs H100 bei niedrigeren Kosten bieten. Diese Trends schaffen ein Mosaik aus Bereitstellungsmodellen – öffentliche Cloud, private Cloud, Hybrid und Far-Edge –, das die Einnahmequellen für Siliziumlieferanten kollektiv diversifiziert.

On-Device-Inferenz in Fahrzeugen, Drohnen und industriellen Steuerungsgeräten bevorzugt Chiplets, die domänenspezifische Kerne neben allgemeiner Logik bündeln. Thermische Hüllkurven und Härtungsanforderungen erfordern Innovationen wie Siliziumkarbid-Substrate, Phasenwechselmaterialien und Direkteinlass-Flüssigkeitskühler. Folglich wird sich der Markt in Formfaktor-Teilsegmente aufteilen, die jeweils für analoge Umgebungs- und Leistungsanforderungen optimiert sind, aber durch gemeinsame Software-Laufzeitumgebungen vereint werden.

Nach Anwendung: Automobiltransformation beschleunigt die Silizium-Nachfrage

Unterhaltungselektronik entfiel 2025 auf 26,40 % der KI-Chipsätze-Marktgröße, ein Wert, der durch Smartphone- und PC-Erneuerungszyklen aufgebläht wurde, die On-Device-generative KI integrieren. Automobil und Transport werden jedoch voraussichtlich bis 2031 mit einer CAGR von 42,6 % wachsen und die Unterhaltungselektronik bis zum Ende des Jahrzehnts überholen. Qualcomm schätzt, dass softwaredefinierende Fahrzeuge bis 2030 eine jährliche Halbleitermöglichkeit von 650 Mrd. USD erschließen könnten. Der R-Car V4H SoC von Renesas liefert 34 TOPS bei 16 TOPS/W und beweist, dass erstklassige funktionale Sicherheit und KI-Leistung in einem einzigen Die zusammenfinden, womit die Kostenobergrenzen der OEMs eingehalten und gleichzeitig der zukünftige Rechenhorizont gesichert wird.

Gesundheitswesen und Biowissenschaften setzen hochdurchsatzfähige KI-Chipsätze in der Bildgebung und Genomik ein, während Industrie- und Robotik-Segmente deterministische Latenz und erweiterte Betriebsbereiche fordern. Die Unternehmens-IT- und BFSI-Domäne integriert Beschleuniger in Server für Betrugserkennung und Konversationsagenten. Das jeweils spezifische Latenz-, Leistungs- und Normenprofil jeder Branche treibt Anbieter dazu, Siliziumblöcke, interaktive Compiler und Sicherheitsmodule anzupassen. Diese Heterogenität sichert vielfältige Nachfrageströme, die den KI-Chipsätze-Markt unterstützen.

Notiz: Segmentanteile aller Einzelsegmente sind nach dem Kauf des Berichts verfügbar

Geografische Analyse

Der asiatisch-pazifische Raum behauptete 2025 die Führung mit einem KI-Chipsätze-Marktanteil von 41,10 %. Chinas 143-Mrd.-USD-KI-Selbstständigkeitsprogramm, Taiwans >90%iger Anteil an der fortschrittlichen KI-Fertigung und Südkoreas Hegemonie bei HBM stärken den Vorteil der Region. Das Upgrade des Fugaku-Supercomputers Japans festigt weiter die lokale Nachfrage nach Trainings-klassen-Beschleunigern. Infolgedessen wird die dem asiatisch-pazifischen Raum zugeordnete Marktgröße trotz kurzfristiger Exportkontrollreibungen stetig wachsen.

Nordamerika profitiert von einem tiefen Forschungs- & Entwicklungs-Ökosystem, Hyperscale-Investitionsausgaben und staatlichen Subventionen im Rahmen des CHIPS and Science Act. NVIDIAs Plattformdominanz und Intels Rückverlagerungsstrategie für Chipwerke festigen die regionale Lieferkettenkontrolle und bewahren gleichzeitig den Zugang zu Spitzentechnologiekapazitäten. Diese Faktoren halten Nordamerika als zweitgrößte Verbrauchsbasis, insbesondere für Trainings-Cluster und kundenspezifische Beschleuniger für Cloud-Anbieter.

Die Region Naher Osten und Afrika ist, obwohl sie in absoluten Zahlen kleiner ist, voraussichtlich mit einer CAGR von 34,1 % das am schnellsten wachsende Gebiet im KI-Chipsätze-Markt. Der Stargate-Campus der Vereinigten Arabischen Emirate, verankert durch NVIDIA-GPUs, und Saudi-Arabiens KI-Fonds im Rahmen der Vision 2030 in Höhe von 40 Mrd. USD ziehen direkte Investitionen westlicher Technologieunternehmen an. Anpassungen für die Wärmebelastung in Wüstenklimata und arabischsprachige große Sprachmodelle erweitern das Anwendungsspektrum und verdeutlichen, wie lokale Bedingungen maßgeschneiderte Siliziumlösungen auslösen können. Europa konzentriert sich auf Datensouveränität und Energieeffizienz und befürwortet GAIA-X-Cloud-Standards, die die Spezifikationsauswahl in Richtung energieeffizienterer KI-Chipsätze beeinflussen. Südamerika ist ein aufstrebender Anwender, der Edge-KI für die Landwirtschaft und die Überwachung natürlicher Ressourcen nutzt, hinkt jedoch beim Zugang zu fortschrittlichen Knoten noch hinterher.

Wettbewerbslandschaft

Der KI-Chipsätze-Markt ist durch hohe Konzentration gekennzeichnet. NVIDIA allein kontrolliert rund 80 % des Trainings-Beschleuniger-Umsatzes, gestützt durch den umfassenden CUDA-Software-Stack und die Blackwell-Generation-Hardware, die vierteljährliche Umsätze von 11 Mrd. USD erzielte. AMDs MI300-Serie hat den Abstand verringert, überschritt 1 Mrd. USD an vierteljährlichem Umsatz und verbesserte die Lieferantenvielfalt. Hyperscaler entwickeln nun kundenspezifisches Silizium wie Googles TPU v5e und Amazons Graviton4, um die Gesamtbetriebskosten zu senken und die Lieferantenabhängigkeit zu reduzieren, was eine schrittweise vertikale Integrationsverlagerung signalisiert.

Intel setzt sein Comeback auf den Gaudi-3-Beschleuniger, der einen um 50 % höheren Inferenz-Durchsatz als vergleichbare GPUs beansprucht, während das Chipwerk als offene Fertigungsalternative positioniert wird. Start-ups wie Cerebras Systems, Groq und SiMa.ai stören Nischen mit Wafer-Scale-Engines, Token-optimierten Pipelines und multimodalen Edge-ASICs. Inzwischen erweitern Speicheranbieter Samsung und SK Hynix die HBM-Kapazität durch milliardenschwere Chipwerke, da sie erkannt haben, dass die Speicherbandbreite zum neuen Leistungsengpass geworden ist. Da sich der Markt bis 2030 dem Wert von 226 Mrd. USD nähert, werden sich die Wettbewerbsdynamiken um Software-Ökosysteme, heterogene Integration und Gesamtsystemoptimierung intensivieren, nicht nur um die rohe Die-Größe allein.

Marktführer in der KI-Chipsätze-Branche

NVIDIA Corporation

Intel Corporation

Advanced Micro Devices Inc.

Alphabet Inc.

Huawei Technologies Co. Ltd

- *Haftungsausschluss: Hauptakteure in keiner bestimmten Reihenfolge sortiert

Jüngste Branchenentwicklungen

- Januar 2025: NVIDIA meldete einen Q1-GJ2026-Umsatz von 44,1 Mrd. USD, ein Plus von 69 % im Jahresvergleich, und begann mit dem Serienversand des Blackwell-NVL72-Supercomputers.

- Mai 2025: AMD verzeichnete einen Q1-2025-Umsatz von 7,44 Mrd. USD, ein Anstieg von 36 % im Jahresvergleich, gestützt durch die Markteinführungen der Instinct MI325X.

- April 2025: TSMC gab bekannt, dass die Massenproduktion seines 2-nm-Knotens in der zweiten Jahreshälfte 2025 beginnen wird, verankert durch einen Multi-Standort-Investitionsplan im Wert von 1,5 Billionen USD.

- März 2025: Intel strich Falcon Shores, um sich auf KI-Lösungen auf Systemebene mit Jaguar Shores zu konzentrieren, mit dem Ziel, das Chipwerk bis 2027 in die Gewinnzone zu führen.

Berichtsumfang des globalen KI-Chipsätze-Marktes

Ein KI-Chip ist ein integrierter Schaltkreis, der für das Training und die Ausführung neuronaler Netze, der Architektur von KI-Software, bestimmt ist. Die kommerziell bedeutendsten Anwendungen künstlicher neuronaler Netze (ANN) sind Deep-Learning-Verfahren. Der Bericht umfasst eine Marktsegmentierung nach Komponenten, darunter Zentralverarbeitungseinheit (CPU), Grafikverarbeitungseinheit (GPU), Neuronaler-Netz-Prozessor (NNP) und weitere Komponenten, die verschiedene Endnutzersegmente wie Unterhaltungselektronik, Automobil, Gesundheitswesen, Automatisierung und Robotik sowie weitere Anwendungen betreffen. Die Studie bietet Wettbewerbsinformationen zu wichtigen Anbietern auf dem Markt sowie deren Finanzdaten, Strategien, SWOT-Analysen und aktuelle Entwicklungen. Die Studie enthält auch eine kurze Analyse der Auswirkungen von COVID-19 auf den untersuchten Markt.

| Zentralverarbeitungseinheit (CPU) |

| Grafikverarbeitungseinheit (GPU) |

| Neuronaler-Netz-Prozessor (NNP) |

| Weitere Komponenten |

| Unterhaltungselektronik |

| Automobil |

| Gesundheitswesen |

| Automatisierung und Robotik |

| Weitere Anwendungen |

| Nordamerika |

| Europa |

| Asiatisch-pazifischer Raum |

| Lateinamerika |

| Naher Osten |

| Nach Komponente | Zentralverarbeitungseinheit (CPU) |

| Grafikverarbeitungseinheit (GPU) | |

| Neuronaler-Netz-Prozessor (NNP) | |

| Weitere Komponenten | |

| Nach Anwendung | Unterhaltungselektronik |

| Automobil | |

| Gesundheitswesen | |

| Automatisierung und Robotik | |

| Weitere Anwendungen | |

| Nach Geographie | Nordamerika |

| Europa | |

| Asiatisch-pazifischer Raum | |

| Lateinamerika | |

| Naher Osten |

Im Bericht beantwortete Schlüsselfragen

Wie groß ist der KI-Chipsätze-Markt derzeit?

Der KI-Chipsätze-Markt beläuft sich 2026 auf 70,25 Mrd. USD und soll bis 2031 einen Wert von 285,9 Mrd. USD erreichen.

Welche Komponente führt den KI-Chipsätze-Markt an?

GPUs halten einen Marktanteil von 51,40 %, hauptsächlich aufgrund verankerter Software-Ökosysteme, die ihre Parallelverarbeitungsstärken begünstigen.

Wie schnell wächst das Automobilsegment innerhalb des KI-Chipsätze-Marktes?

Anwendungen in Automobil und Transport werden voraussichtlich bis 2031 mit einer CAGR von 42,6 % expandieren, da Fahrzeuge auf zentralisierte KI-Rechendomänen umstellen.

Warum steigen die Preise für Hochbandbreitenspeicher?

Die Nachfrage aus KI-GPU-Clustern hat das Angebot überstiegen, was die HBM-Preise um 500 % in die Höhe treibt und die Kapazitäten bis 2025 ausverkauft.

Welche Region verzeichnet das schnellste Wachstum im KI-Chipsätze-Markt?

Die Region Naher Osten und Afrika soll mit einer CAGR von 34,1 % wachsen, gestützt durch milliardenschwere souveräne KI-Infrastrukturpläne.

Was ist das größte Hemmnis für das kurzfristige KI-Chipsatz-Angebot?

Begrenzte Lithografiekapazität unterhalb des 3-nm-Knotens schränkt die Produktion ein, was zu längeren Lieferzeiten und einem aufwärtsgerichteten Preisdruck führt.

Seite zuletzt aktualisiert am: