Tamanho e Participação do Mercado de Chipsets de IA

Análise do Mercado de Chipsets de IA pela Mordor Intelligence

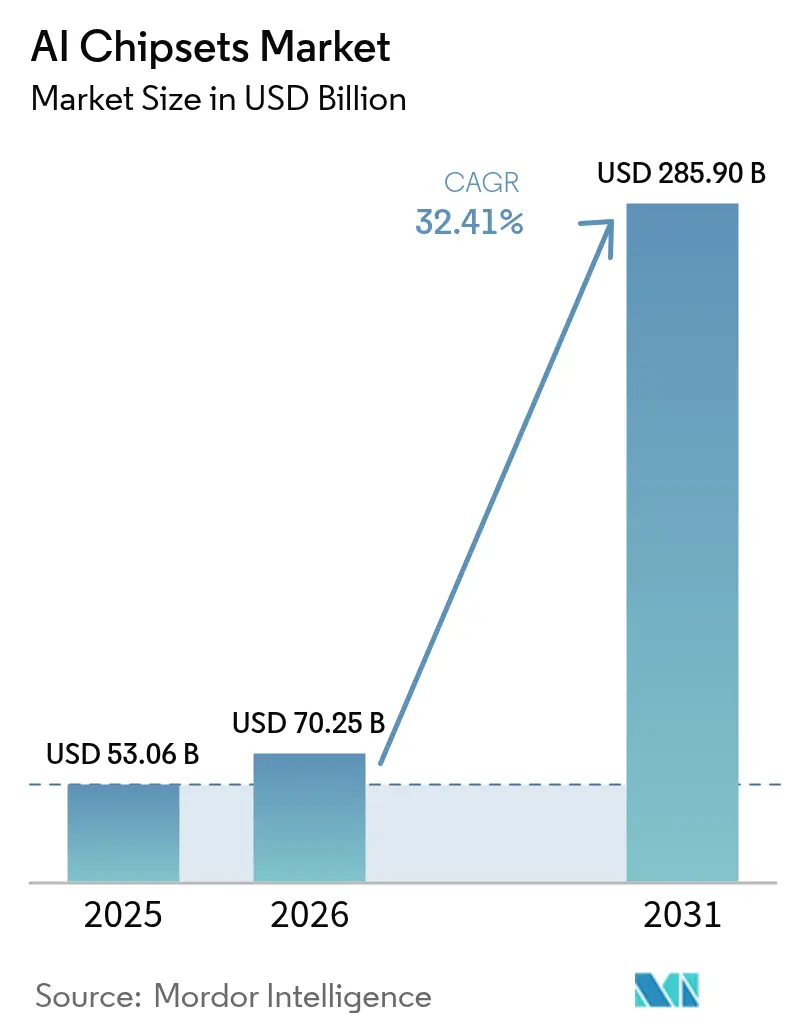

O tamanho do Mercado de Chipsets de IA em 2026 é estimado em USD 70,25 mil milhões, crescendo a partir do valor de 2025 de USD 53,06 mil milhões com projeções para 2031 indicando USD 285,9 mil milhões, crescendo a uma CAGR de 32,41% no período 2026-2031.

A demanda sem precedentes por modelos de linguagem de grande escala com uso intensivo de computação, a acelerada adoção de veículos definidos por software e os avanços em silício de edge de ultrabaixa potência são as três forças estruturais que impulsionam este crescimento. Os ganhos de desempenho continuam fortemente ligados ao empacotamento avançado e à memória de alta largura de banda, mas as restrições de fornecimento abaixo do nó de 3 nm limitam a produção no curto prazo. Enquanto isso, os tetos de controle de exportação, os mandatos de eficiência energética e as metas de sustentabilidade estão a reformular as decisões de abastecimento e a favorecer arquiteturas capazes de oferecer maior desempenho por watt. Os participantes do mercado capazes de equilibrar o rendimento bruto com a eficiência térmica e a resiliência da cadeia de fornecimento estão a conquistar design wins de longo prazo em implantações de data centers, automotivos e edge em todas as principais regiões. Coletivamente, essas dinâmicas posicionam o mercado de chipsets de IA como um facilitador fundamental da IA generativa, das estratégias de nuvem soberana e da inteligência em dispositivo até 2030. [1]NVIDIA Corporation, "NVIDIA Reports Record Q1 FY2026 Results," nvidia.com

Principais Conclusões do Relatório

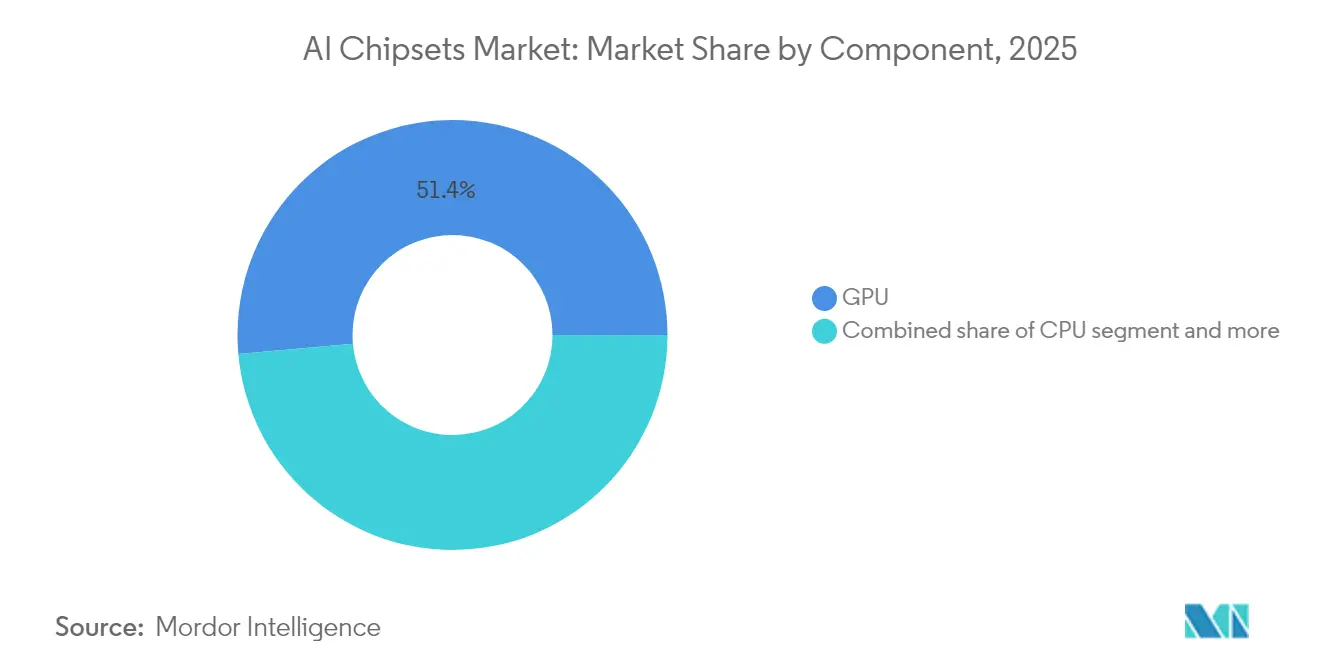

- Por componente, as GPUs lideraram com 51,40% da participação do mercado de chipsets de IA em 2025, enquanto as NPUs e os ASICs deverão expandir-se a uma CAGR de 44,2% até 2031.

- Por tipo de processamento, as cargas de trabalho de treinamento comandaram 60,30% da participação no tamanho do mercado em 2025; a inferência avança a uma CAGR de 36,9% até 2031.

- Por local de implantação, os data centers em nuvem e hiperescala detinham 63,10% da participação no tamanho do mercado de chipsets de IA em 2025, enquanto se projeta que os dispositivos de edge cresçam a uma CAGR de 39,2% até 2031.

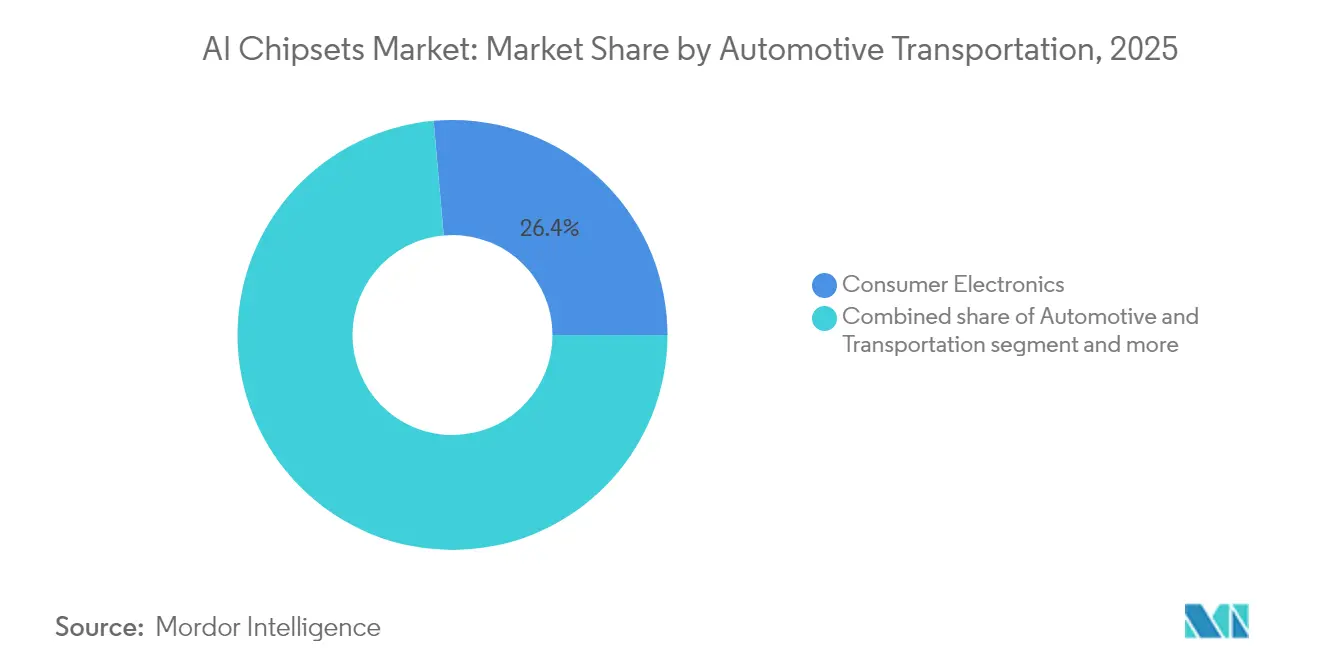

- Por aplicação, os eletrônicos de consumo capturaram 26,40% da participação no tamanho do mercado em 2025; o segmento automotivo e de transporte deverá registar a CAGR mais rápida de 42,6% até 2031.

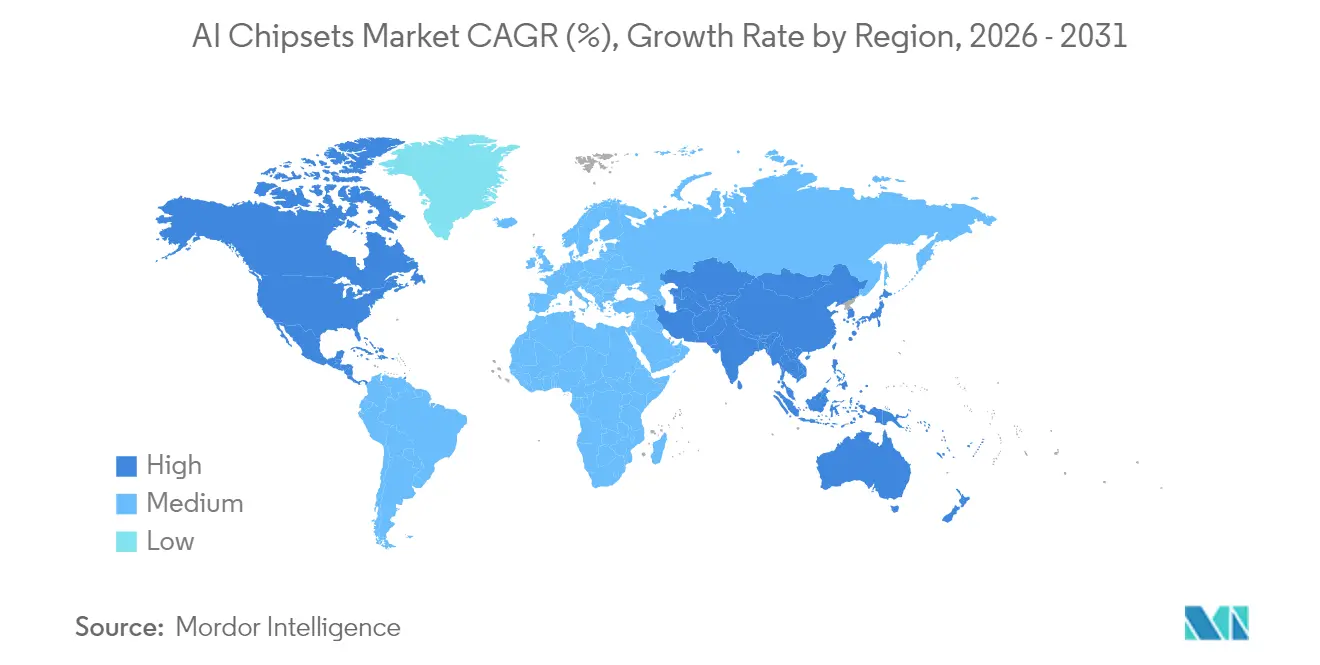

- Por geografia, a Ásia-Pacífico representou 41,10% da participação do mercado de chipsets de IA em 2025, enquanto se espera que a região do Médio Oriente e África aumente a uma CAGR de 34,1% até 2031.

- No front de fornecedores, NVIDIA, AMD, Intel, Google e Amazon controlaram coletivamente mais de 80% da participação do mercado de aceleradores de treinamento em 2024.

Nota: Os números de tamanho de mercado e previsão neste relatório são gerados usando a estrutura de estimativa proprietária da Mordor Intelligence, atualizada com os dados e insights mais recentes disponíveis até 2026.

Tendências e Perspetivas do Mercado Global de Chipsets de IA

Análise de Impacto dos Impulsionadores*

| Impulsionador | (~) % de Impacto na Previsão de CAGR | Relevância Geográfica | Horizonte Temporal de Impacto |

|---|---|---|---|

| Explosão da demanda por computação de treinamento por parte dos desenvolvedores de modelos de fronteira | 12.50% | Global, concentrado nos EUA, China e UE | Médio prazo (2-4 anos) |

| Design wins de silício para veículos 'definidos por software' no setor automotivo | 8.20% | Global, liderado pela Alemanha, EUA, China e Japão | Longo prazo (≥ 4 anos) |

| Avanços em ASICs de edge de IA de ultrabaixa potência | 6.80% | Global, adoção precoce na Ásia-Pacífico e América do Norte | Curto prazo (≤ 2 anos) |

| Programas nacionais de estímulo à infraestrutura de IA (EUA/China/UE) | 9.10% | EUA, China, UE, com efeitos colaterais para nações aliadas | Médio prazo (2-4 anos) |

| Frameworks de aceleração em silício de código aberto (RISC-V) | 4.30% | Global, mais forte na China, emergindo na Índia e na Europa | Longo prazo (≥ 4 anos) |

| Avanços em tecnologia de memória de alta largura de banda (HBM) | 7.40% | Global, concentrado na Coreia do Sul, Taiwan e Japão | Curto prazo (≤ 2 anos) |

| Fonte: Mordor Intelligence | |||

Explosão da Demanda por Computação de Treinamento por Parte dos Desenvolvedores de Modelos de Fronteira

As necessidades anuais de computação para modelos de linguagem de grande escala estão a aumentar dez vezes a cada 18 meses, impulsionando encomendas sustentadas de GPUs multi-die e soluções de empacotamento avançado. A receita de data center da NVIDIA subiu para USD 35,6 mil milhões no quarto trimestre de 2025 com base nos envios do supercomputador Blackwell, sublinhando como os clientes hiperescala estão a acumular vastos inventários específicos de IA. Os construtores de modelos multimodais necessitam agora de milhares de aceleradores interligados, impulsionando a demanda por substratos CoWoS e pilhas HBM de nova geração. Como resultado, espera-se que as principais empresas de IA controlem entre 15% e 20% da capacidade global de computação de IA até 2027, garantindo a aquisição contínua de silício de classe de 3 nm. Esta concentração de volume intensifica as escassez de curto prazo, mas estabelece um pipeline de receitas plurianual para os fornecedores que conseguem executar em nós avançados. Consequentemente, o mercado de chipsets de IA beneficiará de uma base estruturalmente mais elevada de aquisições orientadas para o treinamento ao longo do horizonte de previsão.

Design Wins de Silício para Veículos 'Definidos por Software' no Setor Automotivo

Os fabricantes de automóveis estão a consolidar dezenas de unidades de controlo eletrónico em domínios de computação centralizados habilitados por IA. Analistas do setor projetam que 80% dos novos veículos incorporarão funcionalidades de IA até 2035, criando uma grande base instalada para aceleradores de classe de inferência. Os processadores S32N da NXP, construídos com tecnologia de 5 nm, oferecem 34 TOPS cumprindo rigorosos requisitos ASIL D, sinalizando que a segurança de grau automotivo e a capacidade de processamento de IA podem coexistir num único dispositivo. Com cada ciclo de design a durar entre sete e dez anos, o silício selecionado para os modelos de hoje gera volume em formato de anuidade para os seus fornecedores. Os design wins agora sendo concedidos para a autonomia de Nível 3, fusão de sensores e atualizabilidade over-the-air irão, portanto, compor a demanda durante o período de previsão.

Avanços em ASICs de Edge de IA de Ultrabaixa Potência

Os processadores nativos de edge trazem inferência em tempo real para endpoints móveis, de IoT e industriais que não podem depender da conectividade em nuvem. O NDP250 da Syntiant oferece 30 GOPS dentro de um envelope da classe de um miliwatt, permitindo assistentes de voz sempre ativos e interações com LLMs locais. O coprocessador neuromórfico da BrainChip utiliza igualmente o processamento orientado por eventos para minimizar o consumo de energia, desbloqueando a IA em sensores alimentados por bateria e dispositivos wearable. Estes avanços permitem que os OEMs incorporem inteligência sem comprometer o fator de forma ou a autonomia da bateria, acelerando os design wins em diagnósticos de saúde, manutenção preditiva e interfaces homem-máquina. A velocidade com que os produtos de consumo em volume integram esses ASICs amplifica as trajetórias de envio de unidades, acrescentando mais um vento favorável ao mercado de chipsets de IA.

Programas Nacionais de Estímulo à Infraestrutura de IA

As agendas de IA soberana estão a reescrever as curvas de demanda por semicondutores. A Lei CHIPS e Ciência destina mais de USD 50 mil milhões para a capacidade de fundição e I&D nos EUA, enquanto a China comprometeu USD 143 mil milhões em prol da autossuficiência em IA. O plano diretor de infraestrutura de IA dos Emirados Árabes Unidos no valor de USD 200 mil milhões — com chips NVIDIA no seu núcleo — impulsiona nova demanda no Médio Oriente. Tais programas fiscais subsidiam fábricas, data centers e instalações de empacotamento, ancorando a demanda local que é menos sensível aos ciclos macroeconômicos globais. A consequente aquisição de aceleradores de IA, memórias especializadas e silício de interligação aumenta os volumes endereçáveis para os participantes do ecossistema e sustenta a expansão de dois dígitos do mercado no médio prazo. [2]Congresso dos Estados Unidos, "Lei CHIPS e Ciência de 2022," congress.gov

Análise de Impacto das Restrições*

| Restrição | (~) % de Impacto na Previsão de CAGR | Relevância Geográfica | Horizonte Temporal de Impacto |

|---|---|---|---|

| Estrangulamentos na cadeia de fornecimento em litografia abaixo de 3 nm | -5.20% | Global, impacto concentrado em Taiwan e Coreia do Sul | Curto prazo (≤ 2 anos) |

| Compressão de modelos de IA a reduzir os requisitos de silício | -3.80% | Global, liderado por instituições de investigação e hiperescalas | Médio prazo (2-4 anos) |

| Tetos de controlo de exportação geopolíticos em GPUs avançadas | -4.10% | China, Rússia, com efeitos secundários a nível global | Médio prazo (2-4 anos) |

| Limites crescentes de projeto térmico em dispositivo | -2.90% | Global, agudo em data centers e dispositivos móveis | Longo prazo (≥ 4 anos) |

| Fonte: Mordor Intelligence | |||

Estrangulamentos na Cadeia de Fornecimento em Litografia Abaixo de 3 nm

As máquinas High-NA EUV necessárias para a produção de 2 nm custam mais de USD 300 milhões cada uma e permanecem limitadas em quantidade. A primeira linha piloto de 2 nm da TSMC entra em produção em massa no final de 2025, mas enfrenta pesadas pré-alocações por parte de clientes flagship. A escassez de capacidade eleva os preços das bolachas e alonga os prazos de entrega dos aceleradores de IA fabricados nesses nós. A exclusão da China da litografia High-NA fragmenta ainda mais as cadeias de fornecimento globais, levantando a perspetiva de duplos padrões tecnológicos. O efeito líquido reduz a disponibilidade de unidades no curto prazo e modera a taxa de crescimento do mercado de chipsets de IA até que fábricas adicionais entrem em funcionamento após 2027.

Compressão de Modelos de IA a Reduzir os Requisitos de Silício

As técnicas de poda, quantização e destilação de conhecimento podem reduzir a demanda de computação de inferência em até 70%, permitindo que modelos menores igualem a precisão original. Se amplamente adotados, estes métodos reduziriam a necessidade de chips de alta gama em determinadas cargas de trabalho e moderariam o crescimento global do volume de silício. Consequentemente, a inovação em compressão representa uma força contrária estrutural ao mercado, ainda que permita uma implantação mais ampla da IA.

*Nossas previsões atualizadas tratam os impactos de impulsionadores e restrições como direcionais, não aditivos. As previsões de impacto revisadas refletem o crescimento base, os efeitos de mix e as interações entre variáveis.

Análise de Segmentos

Por Componente: A Integração de Memória Impulsiona a Evolução do Silício

As GPUs mantiveram uma participação de 51,40% no mercado de chipsets de IA em 2025, ao oferecerem um paralelismo incomparável para o treinamento, mesmo com as NPUs e os ASICs previstos para crescer a uma CAGR de 44,2% até 2031. O tamanho do mercado alocado aos envios de GPUs continuará a aumentar em termos absolutos à medida que os modelos de fronteira aumentam os orçamentos de computação, mas a mudança de participação para silício específico de domínio é inconfundível. Os fornecedores de memória e armazenamento desfrutam de ventos extraordinariamente favoráveis: as pilhas HBM3E da Samsung atingem agora 36 GB por die, atendendo às maiores exigências de janela de contexto e elevando os preços médios de venda. Um aumento de 500% nos preços da HBM desde 2024 confirma o apetite do mercado por largura de banda em detrimento da frequência bruta. Os designs heterogéneos baseados em chiplets estão a integrar CPUs, NPUs e HBM num interposer comum para otimizar os envelopes de energia para a inferência em edge. Os fornecedores que dominarem o empacotamento 2,5D avançado, as interligações die a die e a colocalização de memória conquistarão margens premium dentro do mercado de chipsets de IA em evolução.

O segmento de CPU adapta-se através de aceleradores de IA on-die e novos conjuntos de instruções, preservando a relevância em cargas de trabalho tradicionais que intercalam lógica de controlo e inferência. As FPGAs recuperam o impulso onde a latência determinística ou a atualizabilidade em campo supera o rendimento absoluto, especialmente em robôs industriais e gateways de telecomunicações. A diversidade arquitetónica eleva, em última análise, o mercado total endereçável porque cada carga de trabalho mapeia para o bloco de silício mais eficiente. Os fornecedores capazes de orquestrar soluções multi-chiplet estão, assim, posicionados para ganhos de participação desproporcionais à medida que os integradores de sistemas exigem subsistemas turnkey em vez de peças discretas.

Nota: As participações de segmento de todos os segmentos individuais estão disponíveis mediante a compra do relatório

Por Tipo de Processamento: A Aceleração da Inferência Remodela as Prioridades do Silício

O treinamento comandou 60,30% da participação do mercado de chipsets de IA em 2025, ancorado por clusters de data centers hiperescala a executar centenas de petaflops por rack. O tamanho do mercado associado ao treinamento continuará a crescer porque os contagens de parâmetros nos modelos multimodais expandem-se geometricamente; os cenários apontam para 100 milhões de GPUs de classe H100 necessárias até 2030. Ainda assim, os envios de inferência escalarão a uma CAGR de 36,9% à medida que as empresas lançam serviços de IA generativa em verticais e incorporam modelos menores na periferia da rede. A Cerebras Systems e a Qualcomm demonstraram conjuntamente ganhos de relação preço-desempenho 10× em relação às soluções incumbentes, confirmando que novas arquiteturas podem perturbar as curvas de custo históricas.

Os aceleradores de inferência em edge colocam a eficiência energética acima das FLOPS, levando os fornecedores de chips a adotar SRAM de baixa tensão, computação near-memory e processamento analógico para kernels como atenção ou convolução. Esta dicotomia cria dois roteiros de produtos paralelos: dies ultradensas e arrefecidas a líquido para treinamento, e ASICs esbeltos da classe de miliwatts para inferência. Os fornecedores que abrangem ambas as categorias podem realizar vendas cruzadas de cadeias de ferramentas de software, enquanto os especialistas podem conquistar nichos em torno de latência, segurança ou endpoints sensíveis ao preço. A tensão competitiva resultante sustenta a inovação em todo o mercado de chipsets de IA.

Por Local de Implantação: A Computação em Edge Impulsiona a Inovação Arquitetónica

As instalações em nuvem geraram 63,10% do tamanho do mercado de chipsets de IA em 2025, à medida que as hiperescalas canalizaram USD 500 mil milhões para novas construções de data centers. Apesar desta dominância, projeta-se que as implantações em edge aumentem a uma CAGR de 39,2%, refletindo a demanda por análise em tempo real, redução dos custos de backhaul e conformidade com a soberania de dados. As empresas também estão a repatriar cargas de trabalho de IA selecionadas para clusters on-premises equipados com aceleradores Gaudi 3 da Intel, que proporcionam 50% mais rendimento de inferência do que o H100 da NVIDIA a um custo inferior. Essas tendências criam um mosaico de modelos de implantação — nuvem pública, nuvem privada, híbrida e far-edge — que, coletivamente, diversificam os fluxos de receita para os fornecedores de silício.

A inferência em dispositivo em veículos, drones e controladores industriais favorece os chiplets que empacotam núcleos específicos de domínio junto à lógica de uso geral. Os envelopes térmicos e as necessidades de robustez exigem inovações como substratos de carboneto de silício, materiais de mudança de fase e arrefecedores a líquido de entrada direta. Consequentemente, o mercado fragmentar-se-á em sub-segmentos de fator de forma, cada um otimizado para ambientes e restrições de energia análogos, mas unificados por runtimes de software comuns.

Por Aplicação: A Transformação Automotiva Acelera a Demanda por Silício

Os eletrônicos de consumo representaram 26,40% do tamanho do mercado de chipsets de IA em 2025, um valor inflacionado pelos ciclos de renovação de smartphones e PCs que integram IA generativa em dispositivo. No entanto, o segmento automotivo e de transporte deverá crescer a uma CAGR de 42,6% até 2031, ultrapassando os eletrônicos de consumo no final da década. A Qualcomm estima que os veículos definidos por software poderão desbloquear uma oportunidade anual de semicondutores de USD 650 mil milhões até 2030. O SoC R-Car V4H da Renesas oferece 34 TOPS a 16 TOPS/W, provando que a segurança funcional de alto grau e o desempenho de IA convergem num único die, atendendo assim aos envelopes de custo dos OEMs enquanto prepara o futuro da capacidade de computação.

Os setores de saúde e ciências da vida aplicam chipsets de IA de alto rendimento em imagiologia e genómica, ao passo que os segmentos industrial e de robótica exigem latência determinística e intervalos de operação alargados. O domínio de TI empresarial e BFSI integra aceleradores em servidores para análise de fraude e agentes conversacionais. O perfil distinto de latência, energia e normas de cada vertical empurra os fornecedores a personalizar blocos de silício, compiladores interativos e módulos de segurança. Esta heterogeneidade garante que múltiplos fluxos de demanda sustentam o mercado de chipsets de IA.

Nota: As participações de segmento de todos os segmentos individuais estão disponíveis mediante a compra do relatório

Análise Geográfica

A Ásia-Pacífico manteve a liderança com 41,10% da participação do mercado de chipsets de IA em 2025. O programa de autossuficiência em IA da China no valor de USD 143 mil milhões, a participação de >90% de Taiwan na fabricação avançada de IA e a hegemonia da Coreia do Sul na HBM reforçam a vantagem da região. A atualização do supercomputador Fugaku do Japão cimenta ainda mais a demanda local por aceleradores de classe de treinamento. Como resultado, o tamanho do mercado associado à Ásia-Pacífico expandir-se-á de forma constante, apesar do atrito de curto prazo relacionado com os controlos de exportação.

A América do Norte beneficia de um profundo ecossistema de I&D, do capex hiperescala e dos subsídios governamentais ao abrigo da Lei CHIPS e Ciência. A dominância de plataforma da NVIDIA e a estratégia de relocalização de fundição da Intel reforçam o controlo da cadeia de fornecimento regional, preservando simultaneamente o acesso a capacidade de ponta absoluta. Estes fatores mantêm a América do Norte como a segunda maior base de consumo, especialmente para clusters de treinamento e aceleradores personalizados para fornecedores de nuvem.

A região do Médio Oriente e África, embora menor em termos absolutos, deverá registar uma CAGR de 34,1%, tornando-a o território de mais rápido crescimento no mercado de chipsets de IA. O campus Stargate dos Emirados Árabes Unidos ancorado por GPUs NVIDIA e o fundo de IA de USD 40 mil milhões da Visão 2030 da Arábia Saudita atraem investimento direto de empresas tecnológicas ocidentais. As personalizações para condições térmicas de clima desértico e LLMs em língua árabe alargam o espectro de aplicação, sublinhando como as condições locais podem desencadear soluções de silício à medida. A Europa continua focada na soberania de dados e na eficiência energética, defendendo as normas de nuvem GAIA-X que influenciam a seleção de especificações em prol de chipsets de IA de menor potência. A América do Sul é um adotante emergente, aproveitando a IA em edge para agricultura e monitoramento de recursos naturais, mas ainda fica atrás no acesso a nós avançados.

Panorama Competitivo

O mercado de chipsets de IA é caracterizado por elevada concentração. A NVIDIA por si só controla cerca de 80% da receita de aceleradores de treinamento, impulsionada pela abrangente pilha de software CUDA e pelo hardware de geração Blackwell que registou USD 11 mil milhões em vendas trimestrais. A série MI300 da AMD reduziu a diferença, ultrapassando USD 1 mil milhões em receita trimestral e melhorando a diversidade de fornecimento. As hiperescalas concebem agora silício personalizado, como o TPU v5e da Google e o Graviton4 da Amazon, para reduzir o custo total de propriedade e diminuir a dependência de fornecedores, o que significa uma mudança gradual de integração vertical.

A Intel aposta o seu regresso no acelerador Gaudi 3, que afirma oferecer 50% mais rendimento de inferência do que as GPUs concorrentes, enquanto posiciona a sua fundição como uma alternativa de fabricação aberta. As startups como Cerebras Systems, Groq e SiMa.ai estão a perturbar nichos com motores à escala de bolachas, pipelines otimizados para tokens e ASICs de edge multimodais. Entretanto, os fornecedores de memória Samsung e SK Hynix expandem a capacidade de HBM através de fábricas de vários mil milhões de dólares, reconhecendo que a largura de banda de memória se tornou o novo estrangulamento de desempenho. À medida que o mercado se aproxima de USD 226 mil milhões até 2030, a dinâmica competitiva intensificar-se-á em torno de ecossistemas de software, integração heterogénea e otimização do sistema total, em vez do tamanho bruto do die apenas.

Líderes do Setor de Chipsets de IA

-

NVIDIA Corporation

-

Intel Corporation

-

Advanced Micro Devices Inc.

-

Alphabet Inc.

-

Huawei Technologies Co. Ltd

- *Isenção de responsabilidade: Principais participantes classificados em nenhuma ordem específica

Desenvolvimentos Recentes do Setor

- Janeiro de 2025: A NVIDIA reportou uma receita de USD 44,1 mil milhões no primeiro trimestre do exercício fiscal 2026, um aumento de 69% em relação ao ano anterior, e iniciou os envios em volume do supercomputador Blackwell NVL72.

- Maio de 2025: A AMD registou uma receita de USD 7,44 mil milhões no primeiro trimestre de 2025, um aumento de 36% em relação ao ano anterior, impulsionado pelos lançamentos do Instinct MI325X.

- Abril de 2025: A TSMC declarou que a produção em massa do seu nó de 2 nm terá início no segundo semestre de 2025, ancorada por um plano de investimento multi-site de USD 1,5 biliões.

- Março de 2025: A Intel cancelou o Falcon Shores para se concentrar nas soluções de IA a nível de sistema Jaguar Shores, visando o equilíbrio da fundição até 2027.

Âmbito do Relatório do Mercado Global de Chipsets de IA

Um chip de IA é um circuito integrado dedicado ao treinamento e execução de redes neurais, a arquitetura do software de IA. As aplicações de redes neurais artificiais (RNA) mais comerciais são o aprendizado profundo. O relatório compreende a segmentação do mercado por componente, incluindo Unidade Central de Processamento (CPU), Unidade de Processamento Gráfico (GPU), Processador de Rede Neural (PNN) e outros componentes relativos a vários segmentos de utilizadores finais, como eletrônicos de consumo, automotivo, saúde, automação e robótica, e outras aplicações. O estudo oferece inteligência competitiva dos principais fornecedores que operam no mercado e as suas finanças, estratégias, análise SWOT e desenvolvimentos recentes. O estudo também oferece uma breve análise do impacto da COVID-19 no mercado estudado.

| Unidade Central de Processamento (CPU) |

| Unidade de Processamento Gráfico (GPU) |

| Processador de Rede Neural (PNN) |

| Outros Componentes |

| Eletrônicos de Consumo |

| Automotivo |

| Saúde |

| Automação e Robótica |

| Outras Aplicações |

| América do Norte |

| Europa |

| Ásia-Pacífico |

| América Latina |

| Médio Oriente |

| Por Componente | Unidade Central de Processamento (CPU) |

| Unidade de Processamento Gráfico (GPU) | |

| Processador de Rede Neural (PNN) | |

| Outros Componentes | |

| Por Aplicação | Eletrônicos de Consumo |

| Automotivo | |

| Saúde | |

| Automação e Robótica | |

| Outras Aplicações | |

| Por Geografia | América do Norte |

| Europa | |

| Ásia-Pacífico | |

| América Latina | |

| Médio Oriente |

Principais Questões Respondidas no Relatório

Qual é o tamanho atual do mercado de chipsets de IA?

O mercado de chipsets de IA situa-se em USD 70,25 mil milhões em 2026 e está projetado para atingir USD 285,9 mil milhões até 2031.

Qual componente lidera o mercado de chipsets de IA?

As GPUs detêm 51,40% da participação de mercado, em grande parte devido aos consolidados ecossistemas de software que favorecem as suas capacidades de processamento paralelo.

Quão rápido está a crescer o segmento automotivo no mercado de chipsets de IA?

Espera-se que as aplicações automotivas e de transporte se expandam a uma CAGR de 42,6% até 2031, à medida que os veículos transitam para domínios de computação de IA centralizados.

Por que estão a subir os preços da memória de alta largura de banda?

A demanda dos clusters de GPUs de IA superou a oferta, elevando os preços da HBM em 500% e esgotando a capacidade até 2025.

Qual região apresenta o crescimento mais rápido no mercado de chipsets de IA?

Prevê-se que a região do Médio Oriente e África cresça a uma CAGR de 34,1%, apoiada por planos soberanos de infraestrutura de IA de vários mil milhões de dólares.

Qual é a principal restrição ao fornecimento de chipsets de IA no curto prazo?

A capacidade limitada de litografia abaixo do nó de 3 nm está a restringir a produção, criando prazos de entrega mais longos e pressão ascendente sobre os preços.

Página atualizada pela última vez em: