Taille et parts du marché des chipsets IA

Analyse du marché des chipsets IA par Mordor Intelligence

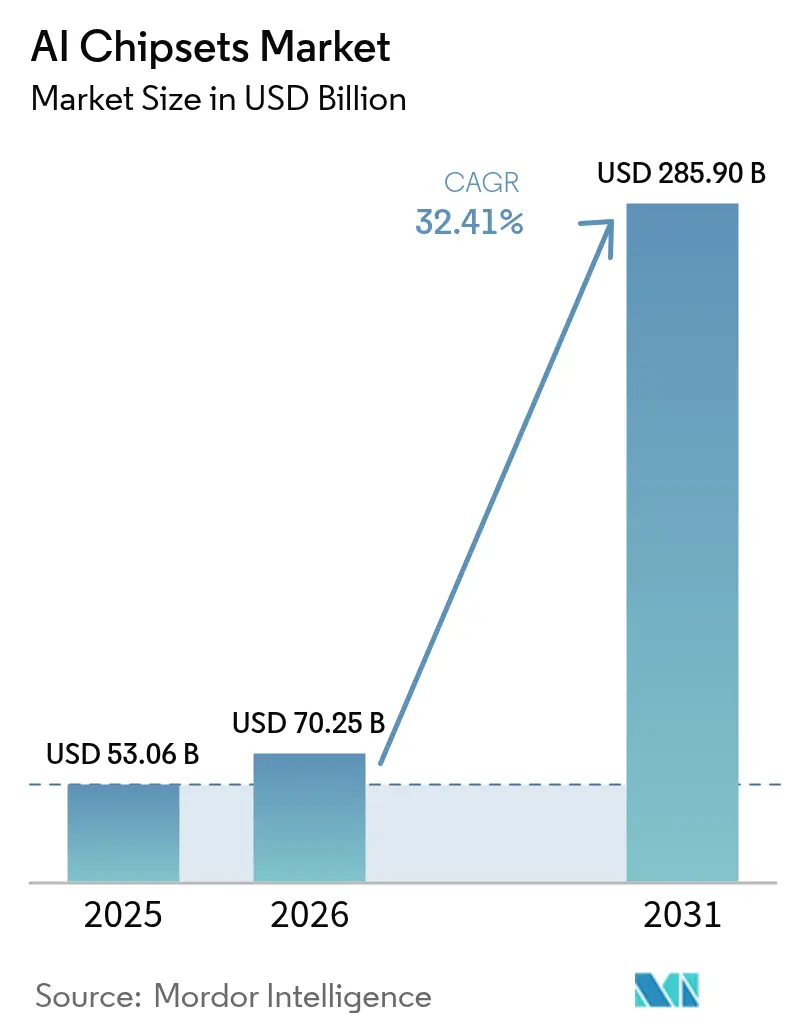

La taille du marché des chipsets IA en 2026 est estimée à 70,25 milliards USD, en croissance par rapport à la valeur 2025 de 53,06 milliards USD, avec des projections pour 2031 à 285,9 milliards USD, affichant un TCAC de 32,41 % sur la période 2026-2031.

La demande sans précédent pour les grands modèles de langage à forte intensité de calcul, l'adoption accélérée des véhicules à définition logicielle et les percées dans le domaine du silicium en périphérie à ultra-faible consommation d'énergie constituent les trois forces structurelles qui propulsent cette croissance. Les gains de performance restent étroitement liés aux technologies d'encapsulation avancée et à la mémoire à haute bande passante, mais les contraintes d'approvisionnement en dessous du nœud 3 nm limitent la production à court terme. Par ailleurs, les plafonds de contrôle des exportations, les mandats d'efficacité énergétique et les objectifs de durabilité reconfigurent les décisions d'approvisionnement et favorisent les architectures capables d'offrir de meilleures performances par watt. Les acteurs du marché capables d'équilibrer le débit brut avec l'efficacité thermique et la résilience de la chaîne d'approvisionnement s'assurent des gains de conception à long terme dans les déploiements en centres de données, dans le secteur automobile et en périphérie dans toutes les grandes régions. Collectivement, ces dynamiques positionnent le marché des chipsets IA comme un catalyseur fondamental de l'IA générative, des stratégies de cloud souverain et de l'intelligence embarquée jusqu'en 2030. [1]NVIDIA Corporation, "NVIDIA Reports Record Q1 FY2026 Results," nvidia.com

Principaux enseignements du rapport

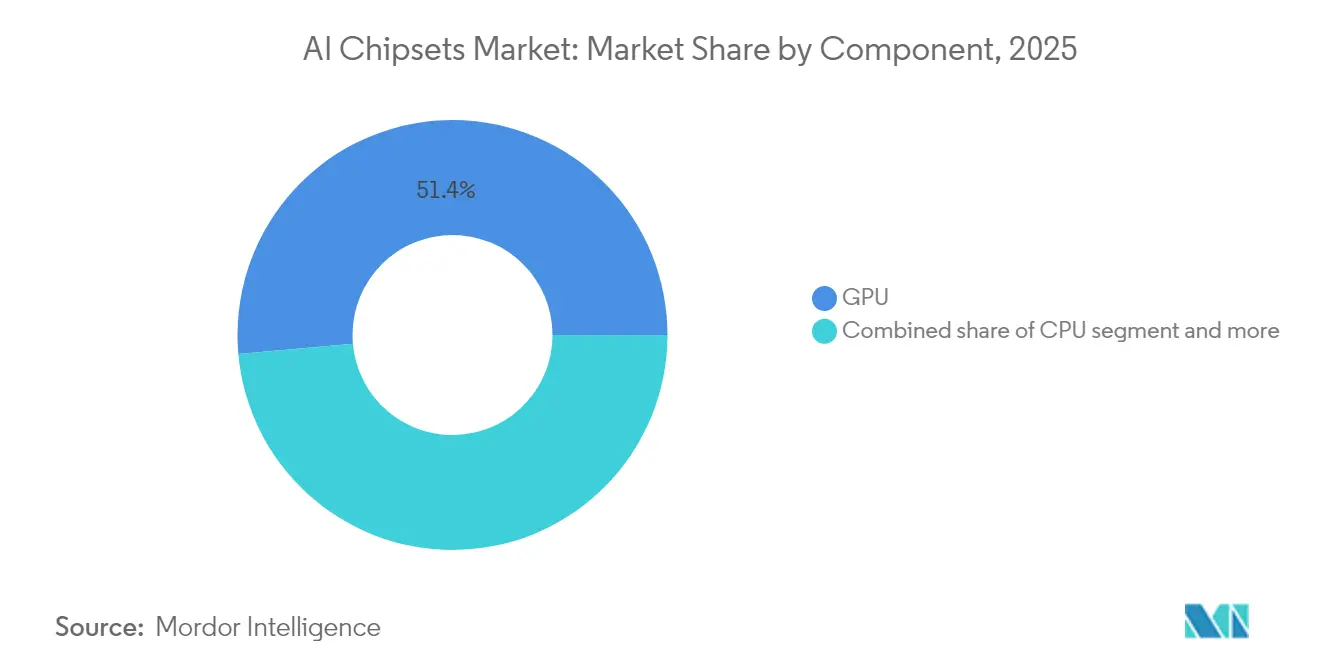

- Par composant, les GPU ont dominé avec 51,40 % des parts du marché des chipsets IA en 2025, tandis que les NPU et les ASIC devraient se développer à un TCAC de 44,2 % jusqu'en 2031.

- Par type de traitement, les charges de travail d'entraînement représentaient 60,30 % de la taille du marché en 2025 ; l'inférence progresse à un TCAC de 36,9 % jusqu'en 2031.

- Par emplacement de déploiement, les centres de données cloud et hyperscale détenaient 63,10 % de la taille du marché des chipsets IA en 2025, tandis que les appareils en périphérie devraient croître à un TCAC de 39,2 % jusqu'en 2031.

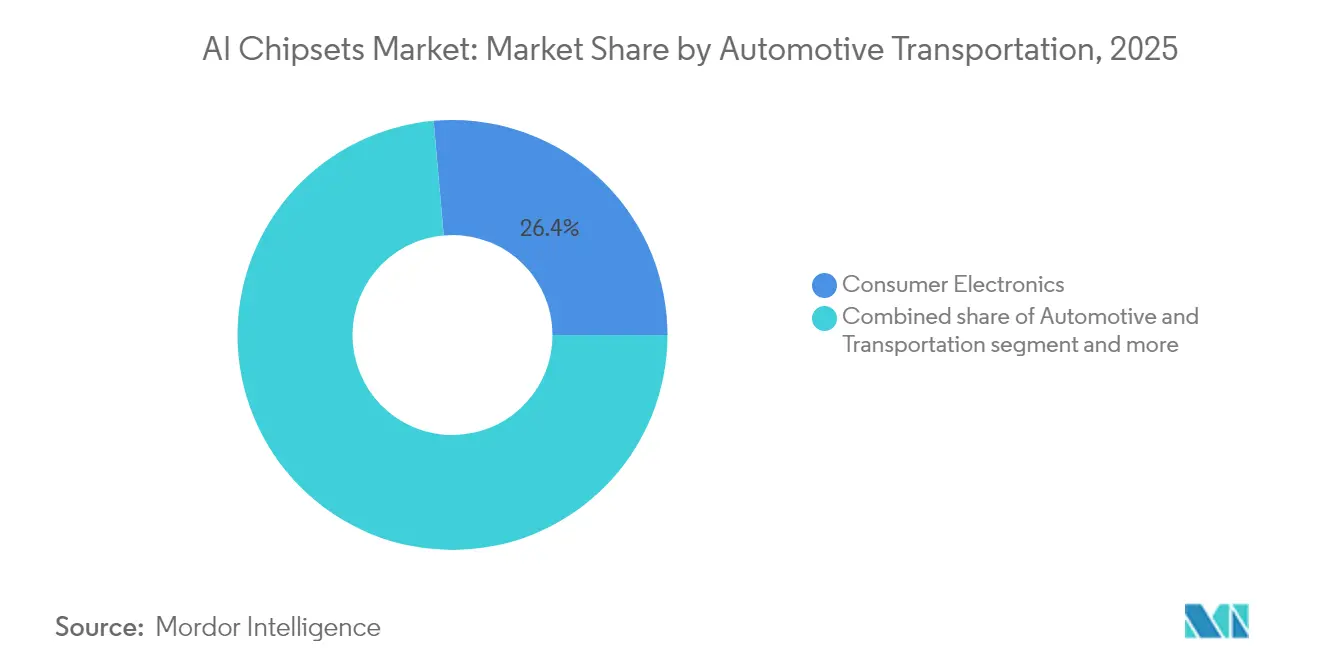

- Par application, l'électronique grand public a capturé 26,40 % de la taille du marché en 2025 ; l'automobile et le transport devraient afficher le TCAC le plus rapide de 42,6 % jusqu'en 2031.

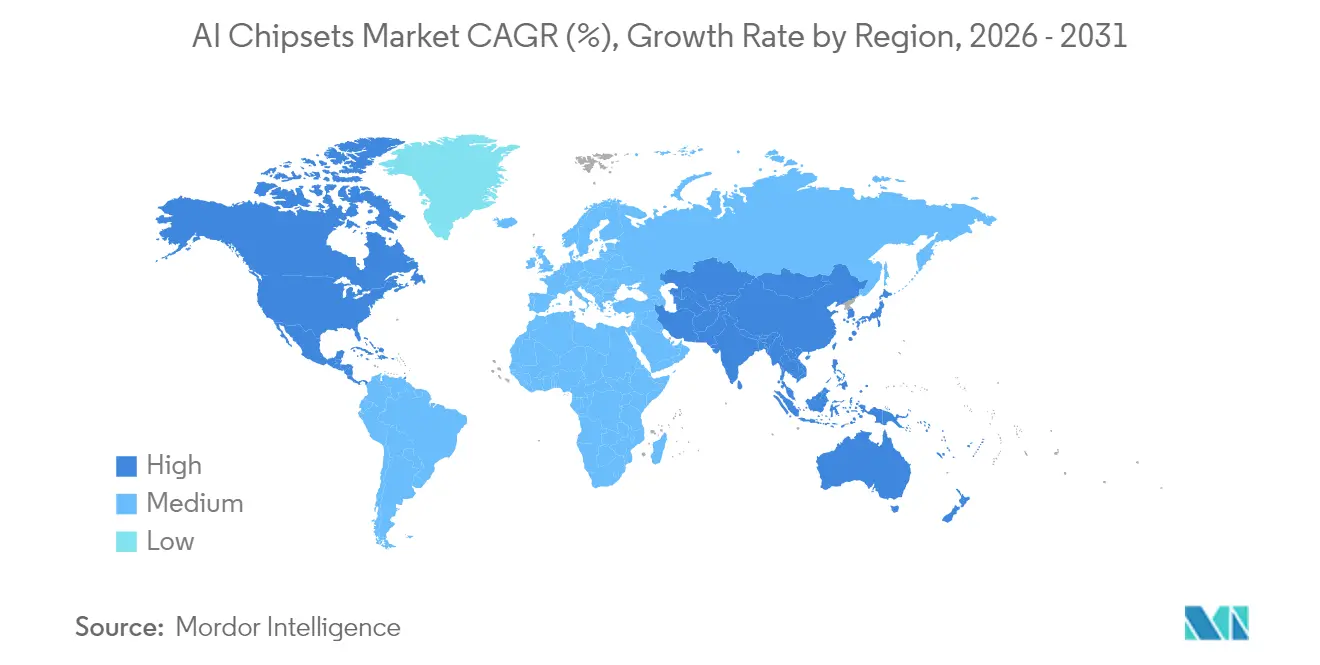

- Par géographie, l'Asie-Pacifique représentait 41,10 % des parts du marché des chipsets IA en 2025, tandis que la région Moyen-Orient et Afrique devrait progresser à un TCAC de 34,1 % jusqu'en 2031.

- Du côté des fournisseurs, NVIDIA, AMD, Intel, Google et Amazon contrôlaient collectivement plus de 80 % des parts du marché des accélérateurs d'entraînement en 2024.

Remarque : Les chiffres de la taille du marché et des prévisions de ce rapport sont générés à l’aide du cadre d’estimation propriétaire de Mordor Intelligence, mis à jour avec les données et analyses les plus récentes disponibles en 2026.

Tendances et perspectives du marché mondial des chipsets IA

Analyse de l'impact des moteurs*

| Moteur | Impact (~) % sur les prévisions de TCAC | Pertinence géographique | Calendrier d'impact |

|---|---|---|---|

| Explosion de la demande de calcul d'entraînement provenant des développeurs de modèles de pointe | 12.50% | Mondial, concentré aux États-Unis, en Chine, dans l'UE | Moyen terme (2-4 ans) |

| Gains de conception de silicium pour les véhicules à « définition logicielle » dans l'automobile | 8.20% | Mondial, mené par l'Allemagne, les États-Unis, la Chine, le Japon | Long terme (≥ 4 ans) |

| Percées dans les ASIC IA en périphérie à ultra-faible consommation d'énergie | 6.80% | Mondial, adoption précoce en Asie-Pacifique, Amérique du Nord | Court terme (≤ 2 ans) |

| Programmes nationaux de stimulus pour l'infrastructure IA (États-Unis/Chine/UE) | 9.10% | États-Unis, Chine, UE, avec retombées vers les nations alliées | Moyen terme (2-4 ans) |

| Cadres d'accélération en silicium open source (RISC-V) | 4.30% | Mondial, plus fort en Chine, émergent en Inde, en Europe | Long terme (≥ 4 ans) |

| Avancées technologiques en mémoire à haute bande passante (HBM) | 7.40% | Mondial, concentré en Corée du Sud, à Taïwan, au Japon | Court terme (≤ 2 ans) |

| Source: Mordor Intelligence | |||

Explosion de la demande de calcul d'entraînement provenant des développeurs de modèles de pointe

Les besoins annuels en calcul pour les modèles de langage à grande échelle augmentent dix fois toutes les 18 mois, ce qui génère des commandes soutenues de GPU multi-puces et de solutions d'encapsulation avancée. Le chiffre d'affaires du centre de données de NVIDIA a atteint 35,6 milliards USD au T4 2025 grâce aux expéditions du supercalculateur Blackwell, soulignant à quel point les clients hyperscale accumulent de vastes stocks spécifiques à l'IA. Les concepteurs de modèles multimodaux nécessitent désormais des milliers d'accélérateurs interconnectés, ce qui stimule la demande de substrats CoWoS et de nouvelles générations de piles HBM. En conséquence, les grandes entreprises d'IA devraient contrôler 15 à 20 % de la capacité mondiale de calcul IA d'ici 2027, garantissant un approvisionnement continu en silicium de classe 3 nm. Cette concentration de volumes intensifie les pénuries à court terme, mais établit un pipeline de revenus pluriannuel pour les fournisseurs capables d'exécuter sur des nœuds avancés. Par conséquent, le marché des chipsets IA bénéficiera d'une base structurellement plus élevée d'achats orientés vers l'entraînement tout au long de l'horizon de prévision.

Gains de conception de silicium pour les véhicules à « définition logicielle » dans l'automobile

Les constructeurs automobiles consolident de nombreuses unités de contrôle électronique dans des domaines de calcul centralisés dotés de capacités IA. Les analystes du secteur projettent que 80 % des nouveaux véhicules intégreront des fonctionnalités IA d'ici 2035, créant une large base installée pour les accélérateurs de classe inférence. Les processeurs S32N de NXP, construits sur technologie 5 nm, délivrent 34 TOPS tout en répondant aux exigences rigoureuses ASIL D, signalant que la sécurité de niveau automobile et la puissance de calcul IA peuvent coexister dans un seul dispositif. Chaque cycle de conception s'étalant sur sept à dix ans, le silicium sélectionné pour les modèles actuels génère des volumes de type annuité pour leurs fournisseurs. Les gains de conception accordés aujourd'hui pour l'autonomie de niveau 3, la fusion de capteurs et la mise à jour à distance viendront donc amplifier la demande pendant la période de prévision.

Percées dans les ASIC IA en périphérie à ultra-faible consommation d'énergie

Les processeurs natifs en périphérie apportent l'inférence en temps réel aux terminaux mobiles, IoT et industriels qui ne peuvent pas dépendre de la connectivité cloud. Le NDP250 de Syntiant délivre 30 GOPS dans une enveloppe de classe milliwatt, permettant des assistants vocaux toujours actifs et des interactions locales avec des LLM. Le coprocesseur neuromorphique de BrainChip exploite de même le traitement à événements pour minimiser la consommation d'énergie, déverrouillant l'IA dans les capteurs alimentés par batterie et les appareils portables. Ces percées permettent aux fabricants d'équipements d'origine (OEM) d'intégrer l'intelligence sans compromettre le facteur de forme ou l'autonomie de la batterie, accélérant les gains de conception dans le diagnostic médical, la maintenance prédictive et les interfaces homme-machine. La vitesse à laquelle les produits grand public à gros volumes intègrent de tels ASIC amplifie les trajectoires d'expéditions unitaires, ajoutant un autre vent porteur au marché des chipsets IA.

Programmes nationaux de stimulus pour l'infrastructure IA

Les programmes d'IA souverains réécrivent les courbes de demande en semi-conducteurs. La loi CHIPS et Science alloue plus de 50 milliards USD à la capacité des fonderies américaines et à la R&D, tandis que la Chine s'est engagée à hauteur de 143 milliards USD pour l'autosuffisance en IA. Le plan directeur d'infrastructure IA de 200 milliards USD des Émirats arabes unis — avec les puces NVIDIA en son cœur — génère une nouvelle demande au Moyen-Orient. De tels programmes fiscaux subventionnent les fonderies, les centres de données et les installations d'encapsulation, ancrant une demande locale moins sensible aux cycles macroéconomiques mondiaux. L'approvisionnement résultant en accélérateurs IA, en mémoire spécialisée et en silicium d'interconnexion renforce les volumes adressables pour les acteurs de l'écosystème et soutient l'expansion à deux chiffres du marché à moyen terme. [2]Congrès des États-Unis, "CHIPS and Science Act of 2022," congress.gov

Analyse de l'impact des contraintes*

| Contrainte | Impact (~) % sur les prévisions de TCAC | Pertinence géographique | Calendrier d'impact |

|---|---|---|---|

| Goulots d'étranglement de la lithographie dans la chaîne d'approvisionnement en dessous de 3 nm | -5.20% | Mondial, impact concentré à Taïwan, en Corée du Sud | Court terme (≤ 2 ans) |

| Compression des modèles IA réduisant les besoins en silicium | -3.80% | Mondial, mené par les institutions de recherche et les hyperscalers | Moyen terme (2-4 ans) |

| Plafonds de contrôle des exportations géopolitiques sur les GPU avancés | -4.10% | Chine, Russie, avec effets secondaires à l'échelle mondiale | Moyen terme (2-4 ans) |

| Limites croissantes de conception thermique des appareils | -2.90% | Mondial, aigu dans les centres de données et les appareils mobiles | Long terme (≥ 4 ans) |

| Source: Mordor Intelligence | |||

Goulots d'étranglement de la lithographie dans la chaîne d'approvisionnement en dessous de 3 nm

Les machines EUV haute-NA requises pour la production à 2 nm coûtent chacune plus de 300 millions USD et restent disponibles en quantité limitée. La première ligne pilote 2 nm de TSMC entre en production de masse fin 2025, mais fait face à de lourdes pré-allocations de la part des clients phares. La rareté des capacités entraîne des prix de plaquettes plus élevés et allonge les délais de livraison pour les accélérateurs IA fabriqués sur ces nœuds. L'exclusion de la Chine de la lithographie haute-NA fragmente davantage les chaînes d'approvisionnement mondiales, soulevant la perspective de deux normes technologiques distinctes. L'effet net réduit la disponibilité des unités à court terme et atténue le taux de croissance du marché des chipsets IA jusqu'à la mise en service de capacités supplémentaires de fonderies après 2027.

Compression des modèles IA réduisant les besoins en silicium

Les techniques d'élagage, de quantification et de distillation des connaissances peuvent réduire la demande de calcul pour l'inférence jusqu'à 70 %, permettant à des modèles plus petits d'atteindre la précision des modèles originaux. Si elles sont largement adoptées, ces méthodes réduiraient le besoin de puces haut de gamme pour certaines charges de travail et modéreraient la croissance globale des volumes de silicium. Par conséquent, l'innovation en matière de compression représente une force structurelle de contrepoids pour le marché, même si elle permet un déploiement plus large de l'IA.

*Nos prévisions mises à jour traitent les impacts des moteurs et des freins comme directionnels et non additifs. Les prévisions d’impact révisées reflètent la croissance de base, les effets de mix et les interactions entre variables.

Analyse des segments

Par composant : l'intégration de la mémoire stimule l'évolution du silicium

Les GPU ont conservé 51,40 % des parts du marché des chipsets IA en 2025 en offrant un parallélisme inégalé pour l'entraînement, même si les NPU et les ASIC devraient croître à un TCAC de 44,2 % d'ici 2031. La taille du marché allouée aux expéditions de GPU continuera d'augmenter en termes absolus à mesure que les modèles de pointe font gonfler les budgets de calcul, mais le glissement des parts vers le silicium spécifique au domaine est indéniable. Les fournisseurs de mémoire et de stockage bénéficient de vents porteurs extraordinaires : les piles HBM3E de Samsung atteignent désormais 36 Go par puce, répondant aux demandes de fenêtres contextuelles plus larges tout en augmentant les prix de vente moyens. Une augmentation de 500 % du prix du HBM depuis 2024 confirme l'appétit du marché pour la bande passante plutôt que pour la fréquence brute. Les conceptions hétérogènes basées sur les chiplets intègrent des CPU, des NPU et de la mémoire HBM sur un interposeur commun pour optimiser les enveloppes de puissance pour l'inférence en périphérie. Les fournisseurs qui maîtrisent l'encapsulation avancée 2,5D, les interconnexions puce-à-puce et la colocalisation de la mémoire captureront des marges premium au sein du marché des chipsets IA en évolution.

Le segment CPU s'adapte grâce aux accélérateurs IA intégrés et aux nouveaux jeux d'instructions, préservant sa pertinence dans les charges de travail traditionnelles qui mêlent logique de contrôle et inférence. Les FPGA regagnent de l'élan là où la latence déterministe ou la mise à niveau sur le terrain l'emporte sur le débit absolu, notamment dans les robots industriels et les passerelles de télécommunication. La diversité architecturale augmente finalement le marché total adressable car chaque charge de travail correspond au bloc de silicium le plus efficace. Les fournisseurs capables d'orchestrer des solutions multi-chiplets sont ainsi positionnés pour des gains de parts significatifs à mesure que les intégrateurs de systèmes exigent des sous-systèmes clés en main plutôt que des composants discrets.

Note: Les parts de chaque segment individuel sont disponibles à l'achat du rapport

Par type de traitement : l'accélération de l'inférence redéfinit les priorités du silicium

L'entraînement représentait 60,30 % des parts du marché des chipsets IA en 2025, ancré par des clusters hyperscale de centres de données fonctionnant à des centaines de pétaflops par baie. La taille du marché liée à l'entraînement continuera de croître car les nombres de paramètres dans les modèles multimodaux s'étendent de façon géométrique ; des scénarios indiquent que 100 millions de GPU de classe H100 seront nécessaires d'ici 2030. Cependant, les expéditions d'inférence évolueront à un TCAC de 36,9 % à mesure que les entreprises déploient des services d'IA générative dans tous les secteurs verticaux et intègrent des modèles plus petits en périphérie du réseau. Cerebras Systems et Qualcomm ont conjointement démontré des gains de performance par rapport au coût 10× supérieurs aux solutions existantes, confirmant que de nouvelles architectures peuvent perturber les courbes de coûts historiques.

Les accélérateurs d'inférence en périphérie placent l'efficacité énergétique au-dessus des FLOPS, incitant les fournisseurs de puces à adopter des SRAM à basse tension, le calcul proche de la mémoire et le traitement analogique pour des noyaux tels que l'attention ou la convolution. Cette dichotomie crée deux feuilles de route produit parallèles : des puces ultra-denses refroidies par liquide pour l'entraînement, et des ASIC svelte de classe milliwatt pour l'inférence. Les fournisseurs couvrant les deux catégories peuvent proposer des chaînes d'outils logiciels croisés, tandis que les spécialistes peuvent conquérir des niches autour de la latence, de la sécurité ou des terminaux sensibles aux prix. La tension concurrentielle résultante soutient l'innovation dans l'ensemble du marché des chipsets IA.

Par emplacement de déploiement : l'informatique en périphérie stimule l'innovation architecturale

Les installations cloud ont généré 63,10 % de la taille du marché des chipsets IA en 2025, alors que les hyperscalers ont englouti 500 milliards USD dans de nouvelles constructions de centres de données. Malgré cette domination, les déploiements en périphérie devraient augmenter à un TCAC de 39,2 %, reflétant la demande d'analytique en temps réel, la réduction des coûts de transport et la conformité à la souveraineté des données. Les entreprises rapatrient également certaines charges de travail IA vers des clusters sur site équipés des accélérateurs Gaudi 3 d'Intel, qui offrent un débit d'inférence 50 % plus élevé que le H100 de NVIDIA à moindre coût. Ces tendances créent une mosaïque de modèles de déploiement — cloud public, cloud privé, hybride et périphérie lointaine — qui diversifient collectivement les flux de revenus pour les fournisseurs de silicium.

L'inférence embarquée dans les véhicules, les drones et les contrôleurs industriels favorise les chiplets qui regroupent des cœurs spécifiques au domaine à proximité d'une logique à usage général. Les enveloppes thermiques et les besoins en robustesse nécessitent des innovations telles que les substrats en carbure de silicium, les matériaux à changement de phase et les refroidisseurs liquides à admission directe. Par conséquent, le marché se fragmentera en sous-segments de facteurs de forme, chacun optimisé pour des environnements analogues et des contraintes de puissance, mais unifié par des environnements d'exécution logiciels communs.

Par application : la transformation automobile accélère la demande en silicium

L'électronique grand public représentait 26,40 % de la taille du marché des chipsets IA en 2025, un chiffre gonflé par les cycles de renouvellement des smartphones et des PC intégrant l'IA générative embarquée. Cependant, l'automobile et le transport devraient croître à un TCAC de 42,6 % jusqu'en 2031, dépassant l'électronique grand public d'ici la fin de la décennie. Qualcomm estime que les véhicules à définition logicielle pourraient représenter une opportunité semestrielle de semi-conducteurs de 650 milliards USD d'ici 2030. Le SoC R-Car V4H de Renesas délivre 34 TOPS à 16 TOPS/W, prouvant que la sécurité fonctionnelle de haute qualité et les performances IA convergent dans une seule puce, répondant ainsi aux enveloppes de coûts des OEM tout en pérennisant la marge de calcul.

La santé et les sciences de la vie appliquent des chipsets IA à haut débit dans l'imagerie et la génomique, tandis que les segments industrie et robotique exigent une latence déterministe et des plages de fonctionnement étendues. Le domaine des technologies de l'entreprise et du BFSI intègre des accélérateurs dans les serveurs pour l'analyse de la fraude et les agents conversationnels. Le profil distinct de latence, de puissance et de normes de chaque secteur vertical pousse les fournisseurs à personnaliser les blocs de silicium, les compilateurs interactifs et les modules de sécurité. Cette hétérogénéité garantit des flux de demande multipronges qui soutiennent le marché des chipsets IA.

Note: Les parts de chaque segment individuel sont disponibles à l'achat du rapport

Analyse géographique

L'Asie-Pacifique a maintenu son leadership avec 41,10 % des parts du marché des chipsets IA en 2025. Le programme d'autosuffisance IA de 143 milliards USD de la Chine, la part de >90 % de Taïwan dans la fabrication avancée de l'IA et l'hégémonie de la Corée du Sud dans le HBM renforcent l'avantage de la région. La mise à niveau du supercalculateur Fugaku du Japon ancre davantage la demande locale en accélérateurs de classe entraînement. Par conséquent, la taille du marché liée à l'Asie-Pacifique s'étendra régulièrement malgré les frictions à court terme liées au contrôle des exportations.

L'Amérique du Nord bénéficie d'un écosystème de R&D approfondi, de dépenses d'investissement hyperscale et de subventions gouvernementales dans le cadre de la loi CHIPS et Science. La domination de la plateforme NVIDIA et la stratégie de relocalisation des fonderies d'Intel renforcent le contrôle régional de la chaîne d'approvisionnement tout en préservant l'accès aux capacités de pointe. Ces facteurs maintiennent l'Amérique du Nord comme la deuxième plus grande base de consommation, notamment pour les clusters d'entraînement et les accélérateurs personnalisés pour les fournisseurs de services cloud.

La région Moyen-Orient et Afrique, bien que plus petite en termes absolus, devrait afficher un TCAC de 34,1 %, ce qui en fait le territoire à la croissance la plus rapide du marché des chipsets IA. Le campus Stargate des Émirats arabes unis ancré par les GPU de NVIDIA et le fonds IA de 40 milliards USD de l'Arabie saoudite dans le cadre de Vision 2030 attirent des investissements directs de la part des entreprises technologiques occidentales. Les personnalisations pour les conditions thermiques des climats désertiques et les LLM en langue arabe élargissent le spectre des applications, soulignant comment les conditions locales peuvent déclencher des solutions de silicium sur mesure. L'Europe reste axée sur la souveraineté des données et l'efficacité énergétique, championne des normes cloud GAIA-X qui influencent la sélection des spécifications en faveur des chipsets IA à plus faible consommation. L'Amérique du Sud est en train de devenir un adoptant émergent, tirant parti de l'IA en périphérie pour l'agriculture et la surveillance des ressources naturelles, mais reste en retard sur l'accès aux nœuds avancés.

Paysage concurrentiel

Le marché des chipsets IA se caractérise par une forte concentration. NVIDIA seule contrôle environ 80 % du chiffre d'affaires des accélérateurs d'entraînement, soutenu par la pile logicielle CUDA complète et le matériel de génération Blackwell qui a affiché 11 milliards USD de ventes trimestrielles. La série MI300 d'AMD a réduit l'écart, dépassant 1 milliard USD de chiffre d'affaires trimestriel et améliorant la diversité de l'offre. Les hyperscalers conçoivent désormais du silicium personnalisé tel que le TPU v5e de Google et le Graviton4 d'Amazon pour réduire le coût total de possession et diminuer la dépendance envers les fournisseurs, ce qui signifie un glissement progressif vers l'intégration verticale.

Intel mise son retour sur l'accélérateur Gaudi 3, qui revendique un débit d'inférence 50 % supérieur à celui des GPU concurrents tout en positionnant sa fonderie comme une alternative de fabrication ouverte. Des start-ups comme Cerebras Systems, Groq et SiMa.ai perturbent des niches avec des moteurs à l'échelle de la tranche, des pipelines optimisés pour les tokens et des ASIC multimodaux en périphérie. Entre-temps, les fournisseurs de mémoire Samsung et SK Hynix développent leur capacité HBM grâce à des fonderies de plusieurs milliards de dollars, reconnaissant que la bande passante de la mémoire est devenue le nouveau goulot d'étranglement des performances. À mesure que le marché approche 226 milliards USD d'ici 2030, la dynamique concurrentielle s'intensifiera autour des écosystèmes logiciels, de l'intégration hétérogène et de l'optimisation de l'ensemble du système plutôt qu'autour de la seule taille brute des puces.

Leaders du secteur des chipsets IA

-

NVIDIA Corporation

-

Intel Corporation

-

Advanced Micro Devices Inc.

-

Alphabet Inc.

-

Huawei Technologies Co. Ltd

- *Avis de non-responsabilité : les principaux acteurs sont triés sans ordre particulier

Développements récents dans le secteur

- Janvier 2025 : NVIDIA a déclaré un chiffre d'affaires de 44,1 milliards USD au T1 de l'exercice fiscal 2026, en hausse de 69 % en glissement annuel, et a commencé les expéditions en volume du supercalculateur Blackwell NVL72.

- Mai 2025 : AMD a affiché un chiffre d'affaires de 7,44 milliards USD au T1 2025, une hausse de 36 % en glissement annuel, soutenue par les lancements de l'Instinct MI325X.

- Avril 2025 : TSMC a annoncé que la production de masse de son nœud 2 nm débutera au second semestre 2025, ancrée par un plan d'investissement multi-sites de 1,5 billion USD.

- Mars 2025 : Intel a annulé Falcon Shores pour se concentrer sur les solutions IA au niveau système Jaguar Shores, visant l'équilibre financier de la fonderie d'ici 2027.

Périmètre du rapport mondial sur le marché des chipsets IA

Un chipset IA est un circuit intégré dédié à l'entraînement et à l'exécution de réseaux de neurones, l'architecture des logiciels d'IA. Les applications les plus commerciales des réseaux de neurones artificiels (RNA) sont l'apprentissage profond. Le rapport comprend la segmentation du marché par composant, notamment l'unité centrale de traitement (CPU), l'unité de traitement graphique (GPU), le processeur de réseau de neurones (NNP) et d'autres composants relatifs à divers segments d'utilisateurs finaux tels que l'électronique grand public, l'automobile, la santé, l'automatisation et la robotique, et d'autres applications. L'étude offre une veille concurrentielle des principaux fournisseurs opérant sur le marché ainsi que leurs résultats financiers, stratégies, analyses SWOT et développements récents. L'étude propose également une brève analyse de l'impact de la COVID-19 sur le marché étudié.

| Unité centrale de traitement (CPU) |

| Unité de traitement graphique (GPU) |

| Processeur de réseau de neurones (NNP) |

| Autres composants |

| Électronique grand public |

| Automobile |

| Santé |

| Automatisation et robotique |

| Autres applications |

| Amérique du Nord |

| Europe |

| Asie-Pacifique |

| Amérique latine |

| Moyen-Orient |

| Par composant | Unité centrale de traitement (CPU) |

| Unité de traitement graphique (GPU) | |

| Processeur de réseau de neurones (NNP) | |

| Autres composants | |

| Par application | Électronique grand public |

| Automobile | |

| Santé | |

| Automatisation et robotique | |

| Autres applications | |

| Par géographie | Amérique du Nord |

| Europe | |

| Asie-Pacifique | |

| Amérique latine | |

| Moyen-Orient |

Questions clés auxquelles le rapport répond

Quelle est la taille actuelle du marché des chipsets IA ?

Le marché des chipsets IA s'élève à 70,25 milliards USD en 2026 et devrait atteindre 285,9 milliards USD d'ici 2031.

Quel composant domine le marché des chipsets IA ?

Les GPU détiennent 51,40 % des parts de marché, en grande partie grâce à des écosystèmes logiciels bien établis qui favorisent leurs atouts en matière de traitement parallèle.

À quelle vitesse le segment automobile croît-il au sein du marché des chipsets IA ?

Les applications automobiles et de transport devraient se développer à un TCAC de 42,6 % jusqu'en 2031, alors que les véhicules transitionnent vers des domaines de calcul IA centralisés.

Pourquoi les prix de la mémoire à haute bande passante augmentent-ils ?

La demande des clusters GPU pour l'IA a dépassé l'offre, entraînant une hausse des prix du HBM de 500 % et épuisant les capacités jusqu'en 2025.

Quelle région affiche la croissance la plus rapide sur le marché des chipsets IA ?

La région Moyen-Orient et Afrique devrait croître à un TCAC de 34,1 %, soutenue par des plans d'infrastructure IA souveraine de plusieurs milliards de dollars.

Quelle est la principale contrainte pesant sur l'approvisionnement à court terme en chipsets IA ?

La capacité de lithographie limitée en dessous du nœud 3 nm contraint la production, créant des délais de livraison plus longs et une pression haussière sur les prix.

Dernière mise à jour de la page le: