Emotionsanalyse-Marktgröße und -Marktanteil

Emotionsanalyse-Marktanalyse von Mordor Intelligence

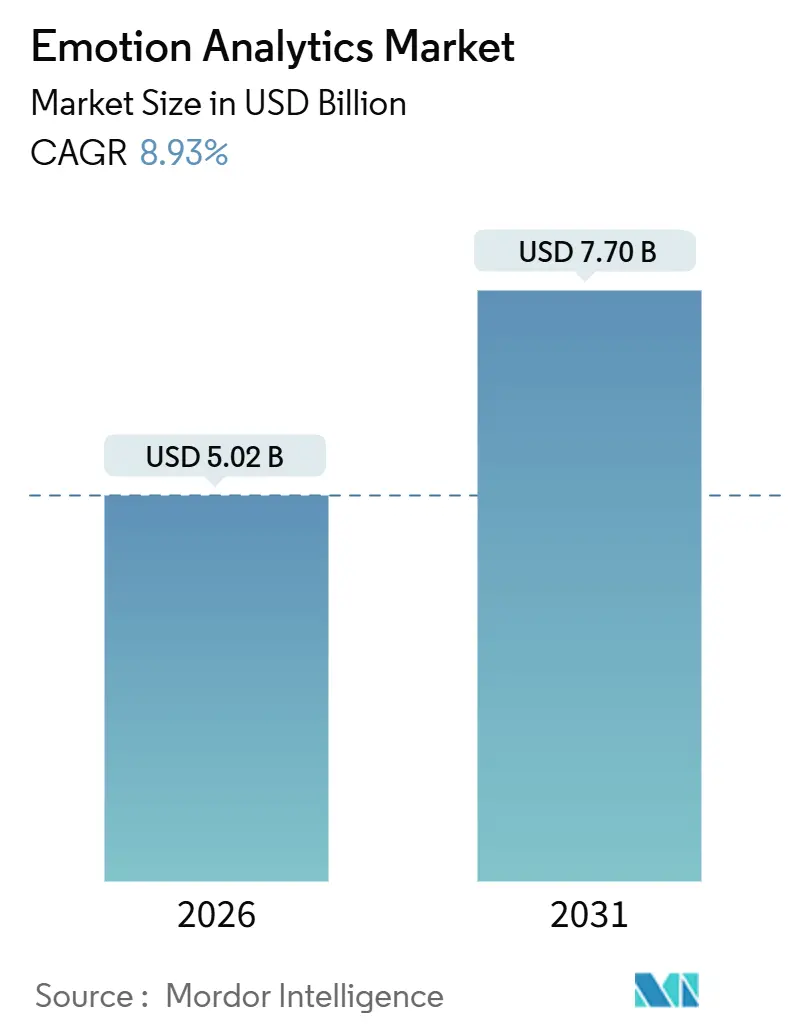

Die Emotionsanalyse-Marktgröße wird im Jahr 2026 auf 5,02 Milliarden USD geschätzt und soll bis 2031 einen Wert von 7,70 Milliarden USD erreichen, mit einer CAGR von 8,93 % während des Prognosezeitraums (2026–2031).

Die Dynamik spiegelt wider, dass Unternehmen von eindimensionaler Sentiment-Kennzeichnung zu Echtzeit-Multimodalinferenz übergehen, die Gesichtsmikroausdrücke, Sprachprosodik, Biosignale und Textsentiment zusammenführt. Verbindliche Vorschriften zur Fahrerüberwachung in Fahrzeugkabinen sowie messbare Verbesserungen bei der Problemlösungszeit in Kontaktzentren haben Kaufentscheidungen beschleunigt. Die Cloud-Bereitstellung dominiert weiterhin, doch Anforderungen an Datensouveränität, Latenz und Bandbreitenökonomie treiben den Wandel hin zu Edge- und On-Device-Verarbeitung voran, insbesondere dort, wo Sicherheitswarnungen im Millisekundenbereich kritisch sind. Anbieter, die datenschutzwahrende Lernverfahren oder homomorphe Verschlüsselung integrieren können, sind gut positioniert, um die europäische Nachfrage inmitten strenger biometrischer Vorschriften zu bedienen.

Wichtigste Erkenntnisse des Berichts

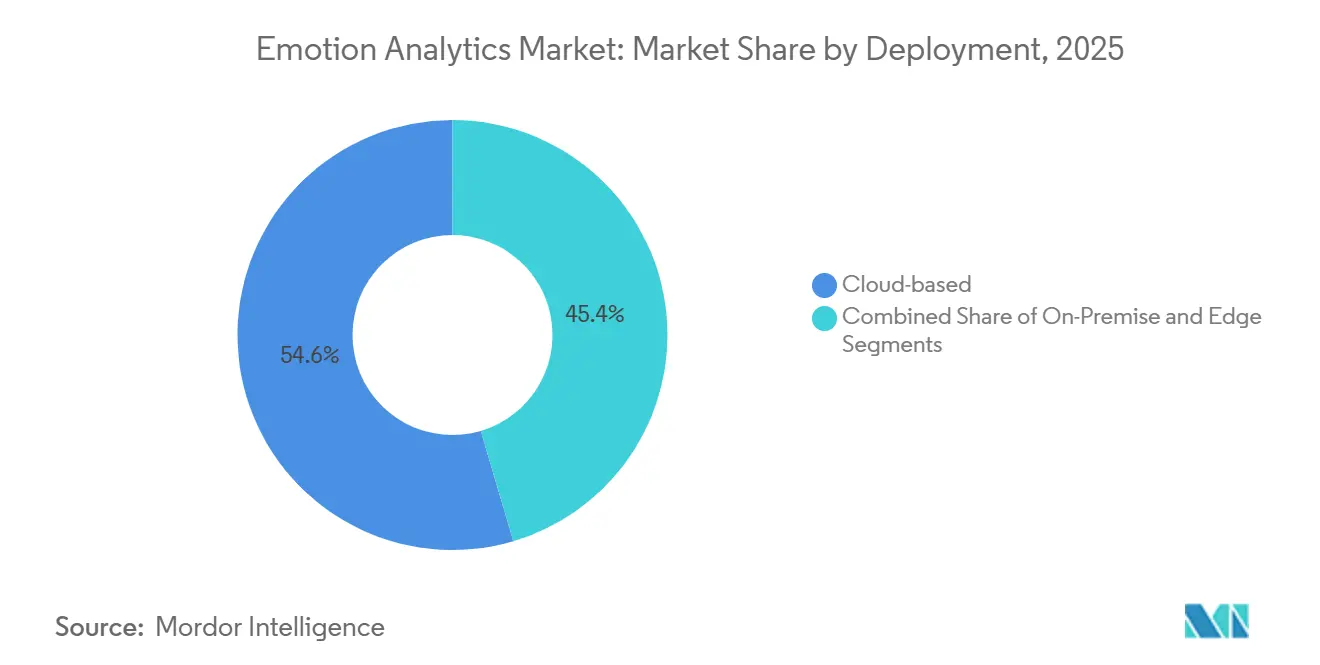

- Nach Bereitstellung entfielen cloudbasierte Lösungen im Jahr 2025 auf 54,57 % des Emotionsanalyse-Marktanteils, während Edge- und On-Device-Inferenz bis 2031 voraussichtlich mit einer CAGR von 10,11 % wachsen wird.

- Nach Komponente hielten Software-Plattformen im Jahr 2025 45,72 % der Emotionsanalyse-Marktgröße, während Hardware-Module bis 2031 mit der höchsten CAGR von 9,43 % wachsen werden.

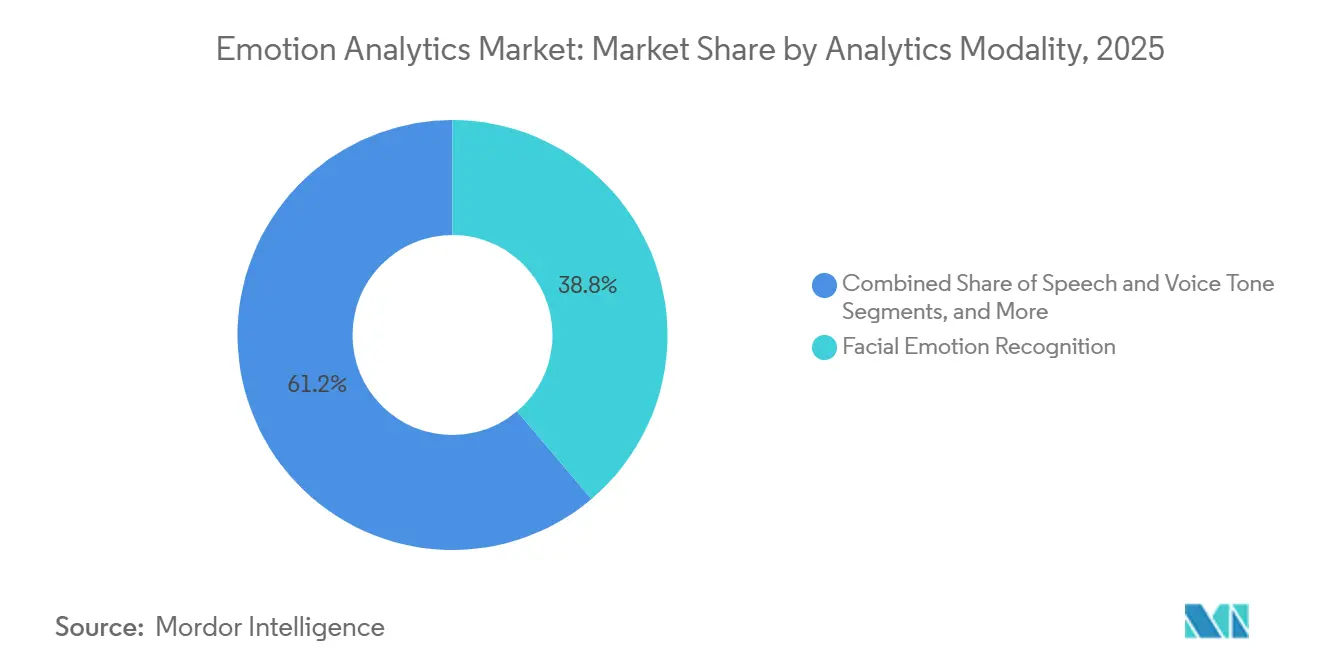

- Nach Modalität beanspruchte die Gesichtsemotionserkennung im Jahr 2025 38,82 % des Umsatzes; biosignalgestützte multimodale Systeme werden mit einer CAGR von 10,96 % expandieren.

- Nach Anwendung entfielen im Jahr 2025 55,47 % des Marktanteils auf Kundenservice und Kontaktzentren, während Anwendungsfälle in Gesundheitswesen und Wohlbefinden bis 2031 voraussichtlich mit einer CAGR von 9,08 % wachsen werden.

- Nach Geografie führte Nordamerika im Jahr 2025 mit einem Anteil von 36,64 %, während der asiatisch-pazifische Raum bis 2031 voraussichtlich eine CAGR von 11,61 % verzeichnen wird.

Hinweis: Die Marktgröße und Prognosezahlen in diesem Bericht werden mithilfe des proprietären Schätzungsrahmens von Mordor Intelligence erstellt und mit den neuesten verfügbaren Daten und Erkenntnissen vom Januar 2026 aktualisiert.

Globale Emotionsanalyse-Markttrends und -Erkenntnisse

Treiber-Wirkungsanalyse

| Treiber | (~) % Auswirkung auf die CAGR-Prognose | Geografische Relevanz | Zeithorizont der Auswirkung |

|---|---|---|---|

| Verbreitung von IoT-Wearables und intelligenten Geräten | +2.8% | Global | Mittelfristig (2–4 Jahre) |

| Fortschritte bei Deep-Learning-basiertem Computer Vision und natürlicher Sprachverarbeitung | +3.2% | Global | Mittelfristig (2–4 Jahre) |

| Nachfrage nach hyper-personalisierten Kundenbindungstools | +2.5% | Nordamerika und Europa | Kurzfristig (≤ 2 Jahre) |

| Regulatorisches Mandat für Fahrerüberwachungssysteme (EU-GSR 2024) | +1.8% | Europa | Kurzfristig (≤ 2 Jahre) |

| Entstehung empathischer KI in Telemedizin-Plattformen für psychische Gesundheit | +1.5% | Global | Mittelfristig (2–4 Jahre) |

| Edge-Computing-Frameworks für datenschutzwahrende Analysen | +2.0% | Global | Langfristig (≥ 4 Jahre) |

| Quelle: Mordor Intelligence | |||

Verbreitung von IoT-Wearables und intelligenten Geräten

Wearable-Hardware zur Emotionserkennung hat sich von Laborprototypen zu Unternehmenseinführungen entwickelt, exemplarisch verdeutlicht durch das Emotiv EPOC X, ein 14-Kanal-Elektroenzephalografie-Headset zum Preis von 999 USD, das nun für Stressaudits am Arbeitsplatz und Tests zur Nutzererfahrung eingesetzt wird.[1]Emotiv Inc., "Emotiv Epoc X," emotiv.com Der BIOPAC Research Ring kombiniert galvanische Hautreaktion, Photoplethysmografie, Elektrokardiogramm, Temperatur und Beschleunigungsmessersignale in einem einzigen Formfaktor und ermöglicht kontinuierliches Affekt-Tracking ohne Brustgurte oder Gesichtskameras. Ein im Dezember 2025 in Nature Scientific Data veröffentlichter Artikel stellte den LLaMAC-Datensatz vor, der Epoc-X- und Empatica-E4-Signale mit synchronisierten Video- und Audiodaten kombiniert, um multimodale Emotionsmodelle zu trainieren. Physiologische Signale wie Herzratenvariabilität und Hautleitwert weisen eine höhere demografische Konsistenz auf als Gesichtssignale, wodurch demografische Verzerrungen reduziert werden. Die On-Device-Inferenz begrenzt zudem Latenz und Datenleckrisiken, indem die Notwendigkeit entfällt, Roh-Biosignale an Cloud-Server zu streamen.

Fortschritte bei Deep-Learning-basiertem Computer Vision und natürlicher Sprachverarbeitung

Transformer-Architekturen und selbstüberwachtes Vortraining haben den Bedarf an beschrifteten Daten reduziert und ermöglichen es Anbietern, Basismodelle mit deutlich weniger Annotationen als bei ihren Vorgängern auf Basis von Faltungsnetzen auf Callcenter-Audio, klinische Interviews oder Fahrzeuginnenraum-Videos feinabzustimmen.[2]Google LLC, "Contact Center AI Insights," cloud.google.com Google Clouds Conversational Insights ermittelt Sentiment, Absicht und Eskalationshinweise aus Live-Audio, während Microsoft Azure AI vorgefertigte Sentiment-APIs anbietet, die Text, Sprache und Video analysieren und so die Hürden für Unternehmen ohne eigene Mitarbeiter für maschinelles Lernen senken. Echtzeit-Emotions-Routing verkürzt die Bearbeitungszeit und steigert den Durchsatz in Kontaktzentren und wandelt potenzielle Kundenverluste in Loyalitätsgewinne um. Textanalysen verfolgen auch innerhalb von Minuten die Markenwahrnehmung in sozialen Medien, Produktbewertungen und Umfragen. Zusammen erweitern diese Fortschritte affektives Computing von isolierten Pilotprojekten auf routinemäßige Geschäftsabläufe.

Nachfrage nach hyper-personalisierten Kundenbindungstools

Unternehmen erkennen, dass generische Customer Journeys Umsatz einbüßen, weshalb Emotionssignale nun dynamische Inhalte, Angebote und Service-Eskalationen innerhalb von Customer-Relationship-Management- und Marketing-Automatisierungssuiten auslösen. Privatkundenbanken setzen sentiment-bewusste Chatbots ein, die belastete Nutzer vor dem Abbruch an menschliche Mitarbeiter weiterleiten, während E-Commerce-Seiten Empfehlungen anpassen, wenn das Engagement während des Browsens schwankt. Durch die Überlagerung von Affektdaten mit Klick-Streams und Kaufhistorien gewinnen Vermarkter kausale Einblicke in Warenkorbabbrüche und Feature-Test-Ergebnisse. Teams für Nutzererfahrung kombinieren Eye-Tracking, Gesichtskodierung und galvanische Hautreaktion, um Reibungspunkte zu lokalisieren und Iterationszyklen zu verkürzen. Diese Praktiken steigern Konversion, Bindung und Kundenwert über digitale Kanäle hinweg.

Regulatorisches Mandat für Fahrerüberwachungssysteme (EU-GSR 2024)

Die Verordnung (EU) 2019/2144 schreibt Warnungen bei Fahrerschläfrigkeit und Ablenkung für alle neuen Fahrzeugtypen ab Juli 2024 und für alle neu zugelassenen Fahrzeuge ab Juli 2026 vor. Die UN-Regelungen 158 und 159 legen Leistungskriterien fest und werden in die delegierten Verordnungen der Kommission 2023/1231 und 2023/1230 umgesetzt. Diese Vorschriften verpflichten Automobilhersteller, Infrarotkameras und -sensoren in der Fahrzeugkabine einzubauen, die Blick, Blinzelrate, Kopfhaltung und Gesichtsmikroausdrücke überwachen und Warnungen ausgeben, wenn Schwellenwerte überschritten werden. Das Mandat schafft eine fest installierte Basis von Dutzenden Millionen Sensoreinheiten pro Jahr und treibt Erstausrüstungslieferanten dazu an, konforme Systeme rasch zu zertifizieren. Ähnliche Harmonisierungsdiskussionen im asiatisch-pazifischen Raum und in Nordamerika signalisieren die Entstehung eines globalen Fahrerüberwachungs-Ökosystems rund um Hardware und Inferenz-Software.

Hemmnis-Wirkungsanalyse

| Hemmnis | (~) % Auswirkung auf die CAGR-Prognose | Geografische Relevanz | Zeithorizont der Auswirkung |

|---|---|---|---|

| Strenge Datenschutzvorschriften (DSGVO, CPRA usw.) | -1.5% | Global, mit erheblichen Auswirkungen in Europa und Nordamerika | Kurzfristig (≤ 2 Jahre) |

| Verzerrungen und Genauigkeitsprobleme bei Gesichtsemotions-Datensätzen | -1.2% | Global | Mittelfristig (2–4 Jahre) |

| Hohe Latenz und Bandbreitenkosten bei der Echtzeit-Videoanalyse | -0.8% | Schwellenmärkte in Asien-Pazifik, Naher Osten und Afrika | Kurzfristig (≤ 2 Jahre) |

| Ethischer Gegenwind gegen Emotionsüberwachung in Schulen und am Arbeitsplatz | -0.6% | Nordamerika und Europa | Kurzfristig (≤ 2 Jahre) |

| Quelle: Mordor Intelligence | |||

Strenge Datenschutzvorschriften (DSGVO, CPRA usw.)

Artikel 9 der Datenschutz-Grundverordnung behandelt biometrische Inferenz als sensible Daten und verlangt ausdrückliche Einwilligung, Zweckbindung und strenge Aufbewahrungsfristen. Der California Privacy Rights Act unterliegt ähnlichen Regeln für biometrische Kennzeichen und ergänzt diese um Löschungsrechte und Erklärungen zu algorithmischen Entscheidungen. Der bevorstehende Rechtsakt der Europäischen Union über künstliche Intelligenz wird Emotionsanalytik in Schulen und am Arbeitsplatz als Hochrisikoanwendung einstufen und Konformitätsbewertungen sowie Marktüberwachung nach der Markteinführung vorschreiben.[3]Europäische Kommission, "Verordnung (EU) 2019/2144," europa.eu Der Compliance-Aufwand erhöht die Bereitstellungskosten und verzögert die Beschaffung für kleine Unternehmen. Datenschutzwahrende Tools wie föderiertes Lernen und homomorphe Verschlüsselung mindern die Risiken, fügen jedoch Latenz und Rechenaufwand hinzu, was globale Einführungen verlangsamt.

Verzerrungen und Genauigkeitsprobleme bei Gesichtsemotions-Datensätzen

Audits zeigen höhere Fehlerquoten bei dunklerhäutigen Personen und Frauen, was demografische Verzerrungen in kommerziellen Klassifikatoren offenlegt. Eine Studie aus dem Jahr 2024 stellte Fehlklassifikationen in nicht-westlichen kulturellen Kontexten fest, in denen emotionale Normen von westlich geprägten Trainingsdaten abweichen. Forscher berichten zudem von geringer Übereinstimmung bei subtilen Zuständen, beispielsweise bei höflichen gegenüber echten Lächeln, was die Verlässlichkeit von Benchmarks in Frage stellt. Solche Lücken bergen rechtliche und reputationsbezogene Risiken bei Anwendungsfällen in Personalwesen, Bildung und psychischer Gesundheit. Die Nachfrage nach unabhängigen Fairness-Tests und erklärbaren KI-Dashboards, die Konfidenzintervalle und demografische Leistungsaufschlüsselungen offenlegen, steigt.

Segmentanalyse

Nach Bereitstellung: Edge-Inferenz gewinnt an Dynamik

Die Edge- und On-Device-Bereitstellung wird voraussichtlich zwischen 2026 und 2031 mit einer CAGR von 10,11 % wachsen, da Unternehmen die Inferenz näher an Sensoren verlagern, um Anforderungen an Datensouveränität und Latenz im Millisekundenbereich zu erfüllen. Cloud-Architekturen hielten 2025 noch immer 54,57 % des Emotionsanalyse-Marktanteils dank elastischer Rechenkapazität und zentralisierter Modellaktualisierungen. Jedoch machen Hin- und Rücklaufverzögerungen die Cloud für sicherheitskritische Fahrerüberwachung oder Telemedizin-Sitzungen für psychische Gesundheit, die Rückmeldungen unter einer Sekunde erfordern, unpraktisch. On-Premise-Stacks sind attraktiv für Banken und Krankenhäuser, die den Abfluss biometrischer Daten untersagen, erfordern jedoch Investitionen in lokale Beschleuniger und qualifizierte Mitarbeiter für maschinelles Lernen.

Technische Fortschritte senken die Hürden für den Betrieb von Modellen am Edge. Die im Jahr 2025 veröffentlichte Open-Source-Plattform BioGAP-Ultra verarbeitet Elektroenzephalografie-, Elektromyografie-, Elektrokardiogramm- und Photoplethysmografie-Signale auf energieeffizienten Mikrocontrollern und beweist, dass präzise Emotionsinferenz ohne Cloud-Konnektivität möglich ist. Federated-Learning-Toolkits ermöglichen es Tausenden von Geräten, ein gemeinsames Modell zu trainieren, während die Rohdaten lokal verbleiben, wodurch Bandbreitenkosten gesenkt und die Einhaltung von Artikel 9 der Datenschutz-Grundverordnung erleichtert wird. Da Chip-Hersteller neuronale Verarbeitungseinheiten in Standard-System-on-Chip-Designs integrieren und Modellkomprimierungsmethoden die Ressourcennutzung verringern, schließt sich die wirtschaftliche Lücke zwischen Edge und Cloud weiter.

Notiz: Segmentanteile aller einzelnen Segmente sind nach dem Kauf des Berichts verfügbar

Nach Komponente: Hardware-Sensoren beschleunigen sich

Hardware-Sensoren, einschließlich Kameras, Elektroenzephalografie-Headsets, Ringe zur Messung der galvanischen Hautreaktion und Elektrokardiogramm-Module, werden bis 2031 voraussichtlich mit einer CAGR von 9,43 % wachsen – der schnellsten Rate unter allen Komponentengruppen. Software-Schichten (Software Development Kits, Application Programming Interfaces und verwaltete Dashboards) entfielen 2025 auf 45,72 % der Emotionsanalyse-Marktgröße, was die anfängliche Leichtigkeit der Einrichtung von Cloud-APIs widerspiegelt. Dienstleistungsangebote, die Integration und maßgeschneidertes Modelltraining bündeln, wachsen parallel, da Käufer schlüsselfertige Lösungen anstreben.

Vorschriften und die Verbreitung von Wearables erklären die Hardware-Dynamik. EU-Vorschriften zur Fahrerüberwachung verpflichten Automobilhersteller, Infrarotkameras in jede neue Fahrzeugkabine einzubauen. Im Gesundheitswesen und bei der betrieblichen Gesundheitsförderung wird das Emotiv Epoc X 14-Kanal-Elektroenzephalografie-Headset mit vorab trainierten Stress- und Engagement-Metriken ausgeliefert, was die Einstiegshürde für Nicht-Fachleute senkt.[4]Emotiv Inc., "Epoc X 14-Kanal-EEG-Headset," emotiv.com Der BIOPAC Research Ring kombiniert galvanische Hautreaktion, Photoplethysmografie, Elektrokardiogramm, Temperatur und Beschleunigungsmessersignale in einem am Finger getragenen Formfaktor und bietet Forschern eine multimodale Option, wenn Datenschutzrichtlinien Videoaufnahmen einschränken. Fortlaufende Sensor-Miniaturisierung und steigende Produktionsmengen werden Hardware von Labors in Consumer-Wearables und Systeme für Umgebungsintelligenz überführen.

Nach Analysemodalität: Biosignal-Multimodalsysteme im Aufwind

Die Gesichtsemotionserkennung entfiel 2025 auf 38,82 % des Umsatzes, angetrieben durch ausgereifte Computer-Vision-Pipelines und weitverbreitete Kamerainfrastruktur. Biosignal-Multimodalsysteme, die Elektroenzephalografie, Elektrokardiografie und galvanische Hautreaktion kombinieren, werden voraussichtlich mit einer CAGR von 10,96 % wachsen – der schnellsten unter den Modalitäten. Videobasierte Multimodalmaschinen fügen Körpersprache und Szenenkontexte hinzu, während Sprachanalyse Tonhöhenkontur und Energiemuster erfasst, die mit Erregung verknüpft sind. Textsentiment-Modelle analysieren Polarität und Absicht aus schriftlichem Feedback in sozialen Kanälen und Support-Tickets.

Die Überlegenheit physiologischer Fusion resultiert aus der Verringerung von Verzerrungen und kontinuierlicher Abdeckung. Signale des autonomen Nervensystems variieren weniger zwischen demografischen Gruppen als Gesichtslandmarken, was Fairness-Lücken reduziert, die in vielen rein auf Bildverarbeitung basierenden Klassifikatoren dokumentiert wurden. Wearable-Biosensoren funktionieren zudem in schwach beleuchteten oder verdeckten Umgebungen wie Fahrzeugkabinen bei Nacht. Das LLaMAC-Korpus vom Dezember 2025 kombiniert Epoc-X-Elektroenzephalografie- und Empatica-E4-Handgelenkdaten mit synchronisierten Video- und Audiodaten und bietet Entwicklern einen umfangreichen offenen Datensatz zum Trainieren und Benchmarken multimodaler Fusionsarchitekturen. Da physiologische Daten eine Person nicht in gleicher Weise identifizieren wie ein Gesicht, behandelt das europäische Datenschutzrecht sie mit weniger Einschränkungen, was Einwilligungsabläufe für Längsschnittstudien vereinfacht.

Notiz: Segmentanteile aller einzelnen Segmente sind nach dem Kauf des Berichts verfügbar

Nach Anwendung: Gesundheitswesen führt beim Wachstum

Kundenservice und Kontaktzentren entfielen 2025 auf 55,47 % des Umsatzes, nachdem Unternehmen schnellere Anrufabwicklung und höhere Kundenzufriedenheitswerte verzeichneten. Anwendungsfälle in Gesundheitswesen und Wohlbefinden werden bis 2031 voraussichtlich mit einer CAGR von 9,08 % wachsen und damit das am schnellsten wachsende Segment darstellen. Versicherungen, Krankenhäuser und Anbieter digitaler Therapien setzen empathische Chatbots und Dashboards zur Fernpatientenüberwachung ein, die in Echtzeit auf Belastung oder mangelnde Therapietreue hinweisen. Anwendungen in Automobil und Transport profitieren von gesetzlich vorgeschriebener Fahrerstatusüberwachung, während Bildungspilotprojekte aufgrund von Überwachungsbedenken in gemessenem Tempo fortgeführt werden.

Klinische Validierung ebnet den Weg für die Erstattung. Eine Metaanalyse aus dem Jahr 2025 in JMIR Mental Health stellte fest, dass konversationelle Agenten Effektgrößen von 0,62 bei Angst und 0,74 bei Depression erzielten – Zahlen, die Kostenträger und Regulierungsbehörden nun bei der Prüfung von Deckungsanträgen anführen. Plattformen wie Woebot und Replika optimieren große Sprachmodelle auf Psychotherapietranskripte, um rund um die Uhr Coaching zu liefern. Die US-amerikanische Behörde für Lebens- und Arzneimittel berief 2025 Expertengremien ein, um Leitlinien für Software als Medizinprodukt für generative künstliche Intelligenz zu erarbeiten, was darauf hindeutet, dass klare Zulassungspfade bevorstehen. Mit dem Entstehen von Erstattungscodes erhalten Käufer im Gesundheitswesen die Budgetsicherheit, die für eine Ausweitung der Implementierungen erforderlich ist.

Geografische Analyse

Nordamerika entfiel 2025 auf 36,64 % des Umsatzes, angetrieben durch frühe Pilotprojekte, Risikokapital und Cloud-Kredite von Hyperscale-Anbietern. Der asiatisch-pazifische Raum wird bis 2031 voraussichtlich eine CAGR von 11,61 % verzeichnen – die steilste regionale Wachstumskurve. China fördert Emotionsanalyse im Rahmen von Programmen für intelligente Fahrzeuge und Kameras für intelligente Städte, während Japan in Pflegeroboter investiert, die Affekte verfolgen, um das Engagement zu verbessern. Indiens Business-Process-Outsourcing-Hubs integrieren Sentiment-Dashboards in Qualitätssicherungsabläufe, und südkoreanische Elektronikunternehmen integrieren Stimmungserkennungsfunktionen in Smartphones und Fernsehgeräte.

Europa wächst langsamer, da Anbieter die Einhaltung sowohl der Datenschutz-Grundverordnung (Artikel 9) als auch des bevorstehenden Rechtsakts über künstliche Intelligenz nachweisen müssen. Lieferanten, die Federated-Learning-Pipelines und homomorphe Verschlüsselung einbinden, werden bei der Beschaffung bevorzugt.

Südamerika, der Nahe Osten und Afrika berichten von frühen Pilotprojekten im Einzel- und Gastgewerbe sowie in der öffentlichen Sicherheit, doch Bandbreiten- und Infrastrukturlücken dämpfen die kurzfristigen Beiträge. Insgesamt wird der regionale Umsatzmix diversifiziert werden, da der asiatisch-pazifische Raum im Prognosezeitraum den Abstand zu Nordamerika verringert.

Wettbewerbslandschaft

Fragmentierung prägt die Ausgangslage 2025, da kein Anbieter einen zweistelligen globalen Marktanteil hält, während Hyperscale-Cloud-Anbieter (Microsoft Azure AI, Google Cloud, Amazon Web Services und IBM Watson) mit spezialisierten Unternehmen wie Smart Eye Affectiva, Realeyes, Entropik Technologies, iMotions und Cogito konkurrieren. Etablierte Anbieter monetarisieren ihre Vertriebsreichweite, indem sie Sentiment-Analyse-Application-Programming-Interfaces in umfassendere Cloud-Suiten bündeln, während spezialisierte Anbieter auf vertikale Datensätze, proprietäre Biosensoren und Domänen-Know-how setzen, um Verträge in den Bereichen Automobil, Gesundheitswesen oder Marktforschung zu gewinnen. Beschaffungsteams gewichten zunehmend Datenschutztechnik-Referenzen und Drittanbieter-Fairness-Audits neben reinen Genauigkeitswerten – ein Wandel, der Anbieter begünstigt, die bereit sind, Modellkarten und demografische Testergebnisse offenzulegen.

Plattformerweiterungen und Partnerschaftsabschlüsse nahmen im Zeitraum 2025–2026 zu. Im Januar 2025 verknüpften Affectiva und iMotions ihre Toolkits zur Gesichtsausdruckskodierung und physiologischen Signalverarbeitung, sodass Nutzererfahrungsforscher einen synchronisierten multimodalen Workflow nutzen können. Realeyes folgte im Oktober 2025 mit der Optimierung seiner leichtgewichtigen Transformer-Bibliothek für Intel-Movidius-Vision-Prozessoren, wodurch der Stromverbrauch von Laptops um 37 % gesenkt und ein neuer Vertriebskanal für Unterhaltungselektronik erschlossen wurde. Diese Schritte veranschaulichen drei übergreifende Strategien: Hinzufügen neuer Modalitäten zur Schaffung von Full-Stack-Inferenz-Suiten, vertikale Integration, die Hardware mit Algorithmen verbindet, und siliziumseitige Co-Entwicklung zur Erfüllung von Latenz- und Wärmeanforderungen in Fahrzeugen und Wearables.

Open-Source-Alternativen üben ebenfalls Wettbewerbsdruck aus. Die modulare Edge-KI-Plattform BioGAP-Ultra, die 2025 als Preprint veröffentlicht wurde, ermöglicht es Startups, multimodale Biosignal-Inferenz auf energieeffizienten Mikrocontrollern zu vernachlässigbaren Lizenzkosten einzurichten. Käufer, die Verpflichtungen aus der Datenschutz-Grundverordnung und dem California Privacy Rights Act unterliegen, honorieren Anbieter, die Modelle mit Federated-Learning- und homomorpher Verschlüsselungsfähigkeit ausliefern, was die Nachfrage in Richtung datenschutzwahrender Architekturen lenkt. Da die fünf größten Anbieter zusammen rund 32 % des Umsatzes 2025 kontrollierten, erwarten Analysten selektive Fusionen und Datenaustauschallianzen statt einer Dominanz einzelner Gewinner, insbesondere da regionale Vorschriften die Bereitstellungsanforderungen weiterhin fragmentieren.

Marktführer der Emotionsanalyse-Branche

-

IBM Corporation

-

Affectiva Inc.

-

Clarifai Inc.

-

Sensum Co.

-

Realeyes OÜ

- *Haftungsausschluss: Hauptakteure in keiner bestimmten Reihenfolge sortiert

Jüngste Branchenentwicklungen

- Dezember 2025: Nature Scientific Data veröffentlichte den Open-Access-LLaMAC-Korpus, der 14-Kanal-Elektroenzephalografie-Daten des Emotiv Epoc X und am Handgelenk getragene physiologische Signale des Empatica E4 mit synchronisierten Video- und Audiodaten über mehrere affektive Aufgaben hinweg kombiniert und Forschern ein umfangreiches multimodales Trainings- und Benchmarking-Set bereitstellt.

- April 2025: Emotiv aktualisierte die Produktseite des Epoc X und hob Stressaudits am Arbeitsplatz sowie Tests zur Nutzererfahrung bei Unternehmenskunden hervor; das 14-Kanal-Headset zum Preis von 999 USD wird mit vorab trainierten Engagement-, Entspannungs- und Stressmetriken ausgeliefert.

- Januar 2025: Affectiva und iMotions starteten eine Integration, die Gesichtsausdruckskodierung mit galvanischer Hautreaktion, Elektrokardiogramm- und Herzfrequenz-Streams synchronisiert, sodass Teams in Neuromarketing und Nutzererfahrung multimodale Ground-Truth-Daten aufbauen können, ohne auf Selbstauskünfte angewiesen zu sein.

- Januar 2025: BIOPAC Systems erweiterte die Research-Ring-Produktlinie um Photoplethysmografie-, Elektrokardiogramm-, Temperatur-, Beschleunigungsmesser- und galvanische-Hautreaktion-Kanäle in einem am Finger getragenen Gerät für unauffälliges kontinuierliches Monitoring in Labor- und Feldstudien.

Berichtsumfang des globalen Emotionsanalyse-Marktes

Der Emotionsanalyse-Marktbericht ist segmentiert nach Bereitstellung (On-Premise, Cloud und Edge), Komponente (Software, Hardware und Dienste), Analysemodalität (Gesicht, Video, Sprache, Text, Biosignal), Anwendung (Kundenservice, Marktforschung, Gesundheitswesen, Automobil, Bildung, Gaming und Sicherheit) sowie Geografie (Nordamerika, Südamerika, Europa, Asien-Pazifik, Naher Osten, Afrika). Die Marktprognosen sind in Wert (USD) angegeben.

| On-Premise |

| Cloudbasiert |

| Edge/On-Device |

| Software (SDK/API) |

| Hardware (Sensoren/Kamera) |

| Dienste (Integration und verwaltete Dienste) |

| Gesichtsemotionserkennung |

| Videobasierte multimodale Analyse |

| Sprache und Stimmton |

| Text und Sentiment |

| Biosignal (EEG/EKG/GSR) Multimodal |

| Kundenservice und Kontaktzentren |

| Produkt- und Marktforschung |

| Gesundheitswesen und Wohlbefinden |

| Automobil und Transport |

| Bildung und E-Learning |

| Gaming und Unterhaltung |

| Sicherheit und öffentliche Sicherheit |

| Nordamerika | Vereinigte Staaten |

| Kanada | |

| Mexiko | |

| Südamerika | Brasilien |

| Argentinien | |

| Übriges Südamerika | |

| Europa | Deutschland |

| Vereinigtes Königreich | |

| Frankreich | |

| Italien | |

| Spanien | |

| Übriges Europa | |

| Asien-Pazifik | China |

| Japan | |

| Indien | |

| Südkorea | |

| ASEAN | |

| Übriger Asien-Pazifik-Raum | |

| Naher Osten | Saudi-Arabien |

| Vereinigte Arabische Emirate | |

| Übriger Naher Osten | |

| Afrika | Südafrika |

| Nigeria | |

| Übriges Afrika |

| Nach Bereitstellung | On-Premise | |

| Cloudbasiert | ||

| Edge/On-Device | ||

| Nach Komponente | Software (SDK/API) | |

| Hardware (Sensoren/Kamera) | ||

| Dienste (Integration und verwaltete Dienste) | ||

| Nach Analysemodalität | Gesichtsemotionserkennung | |

| Videobasierte multimodale Analyse | ||

| Sprache und Stimmton | ||

| Text und Sentiment | ||

| Biosignal (EEG/EKG/GSR) Multimodal | ||

| Nach Anwendung | Kundenservice und Kontaktzentren | |

| Produkt- und Marktforschung | ||

| Gesundheitswesen und Wohlbefinden | ||

| Automobil und Transport | ||

| Bildung und E-Learning | ||

| Gaming und Unterhaltung | ||

| Sicherheit und öffentliche Sicherheit | ||

| Nach Geografie | Nordamerika | Vereinigte Staaten |

| Kanada | ||

| Mexiko | ||

| Südamerika | Brasilien | |

| Argentinien | ||

| Übriges Südamerika | ||

| Europa | Deutschland | |

| Vereinigtes Königreich | ||

| Frankreich | ||

| Italien | ||

| Spanien | ||

| Übriges Europa | ||

| Asien-Pazifik | China | |

| Japan | ||

| Indien | ||

| Südkorea | ||

| ASEAN | ||

| Übriger Asien-Pazifik-Raum | ||

| Naher Osten | Saudi-Arabien | |

| Vereinigte Arabische Emirate | ||

| Übriger Naher Osten | ||

| Afrika | Südafrika | |

| Nigeria | ||

| Übriges Afrika | ||

Im Bericht beantwortete Schlüsselfragen

Welchen prognostizierten Wert wird der Emotionsanalyse-Markt im Jahr 2031 erreichen?

Der Emotionsanalyse-Markt wird bis 2031 voraussichtlich einen Wert von 7,70 Milliarden USD erreichen und mit einer CAGR von 8,93 % wachsen.

Welches Bereitstellungsmodell wächst innerhalb der Emotionsanalyse am schnellsten?

Edge- und On-Device-Inferenz wird bis 2031 voraussichtlich mit einer CAGR von 10,11 % wachsen, bedingt durch Vorteile bei Latenz und Datensouveränität.

Welche Komponentenkategorie wird voraussichtlich das Gesamtmarktwachstum übertreffen?

Hardware-Module wie spezialisierte Kameras und Biosignal-Sensoren werden bis 2031 mit einer CAGR von 9,43 % expandieren.

Welche Region weist die höchste zukünftige Wachstumsrate auf?

Der asiatisch-pazifische Raum wird voraussichtlich von 2026 bis 2031 eine CAGR von 11,61 % verzeichnen, angetrieben durch Einsätze in Automobil und Fertigung.

Was ist die wichtigste regulatorische Hürde für Emotionsanalyse in Europa?

Artikel 9 der Datenschutz-Grundverordnung behandelt biometrische Inferenz als Daten besonderer Kategorien und erfordert ausdrückliche Einwilligung sowie datenschutzwahrende Architekturen.

Warum gewinnen Biosignal-Multimodalsysteme an Bedeutung?

Die Integration von Elektroenzephalografie-, Elektrokardiogramm- und galvanischen Hautreaktionsdaten liefert physiologische Grundwahrheit, die demografische Verzerrungen reduziert, die rein bildverarbeitungsbasierten Modellen inhärent sind.

Seite zuletzt aktualisiert am: