Taille et part de marché des accélérateurs de centres de données

Analyse du marché des accélérateurs de centres de données par Mordor Intelligence

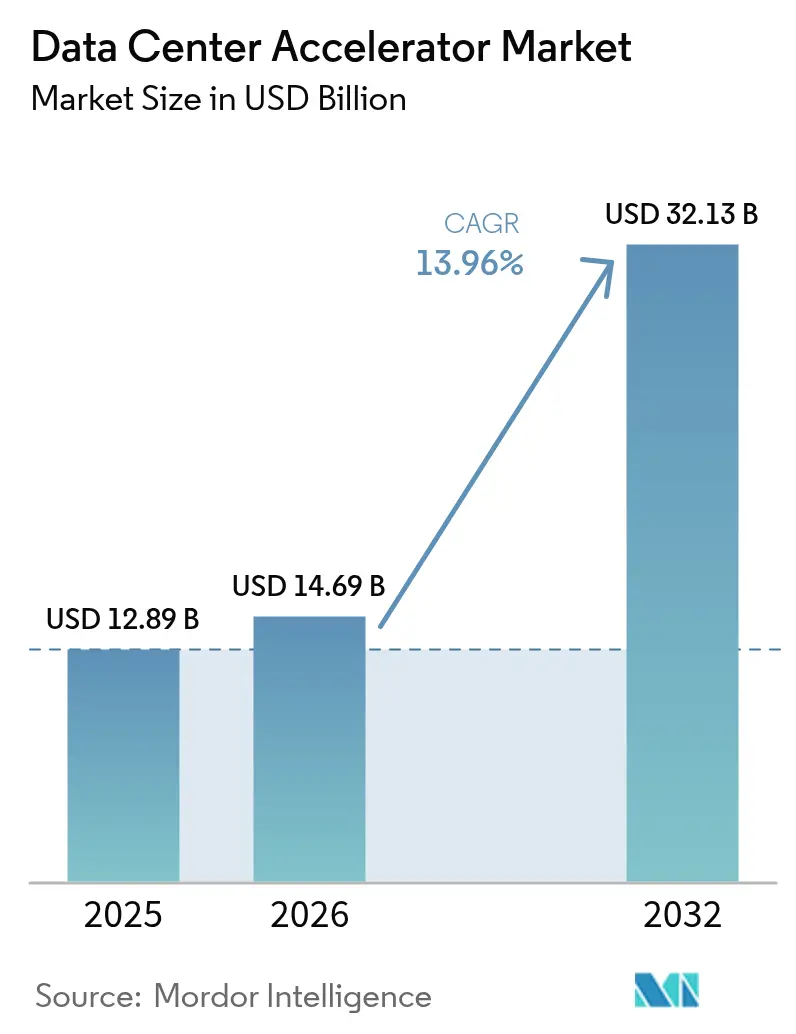

La taille du marché des accélérateurs de centres de données en 2026 est estimée à 14,69 milliards USD, en progression par rapport à la valeur de 2025 de 12,89 milliards USD, avec des projections pour 2032 indiquant 32,13 milliards USD, soit une croissance à un TCAC de 13,96 % sur la période 2026-2032. L'intensification des cycles d'entraînement de l'intelligence artificielle, la prolifération des infrastructures hyperscale et le basculement vers les GPU, ASIC et autres puces conçues à des fins spécifiques constituent les principaux moteurs de cette expansion. Les programmes de cloud souverain, les régimes de contrôle des exportations et les impératifs de durabilité reconfigurent les schémas d'investissement régionaux, poussant les acheteurs vers des accélérateurs d'origine nationale et des infrastructures plus respectueuses de l'environnement. Les contraintes pesant sur la capacité des substrats de conditionnement et les pénuries de mémoire à large bande passante (HBM) tempèrent la disponibilité des matériels à court terme, incitant les fournisseurs cloud à prioriser les configurations à plus forte marge. Parallèlement, les rétroaménagements en refroidissement liquide et les contrats d'achat d'énergie renouvelable émergent comme des critères de sélection déterminants pour les projets d'investissement, signalant que l'efficacité énergétique est désormais un facteur de différenciation concurrentielle plutôt qu'un simple poste de coût.

Points clés du rapport

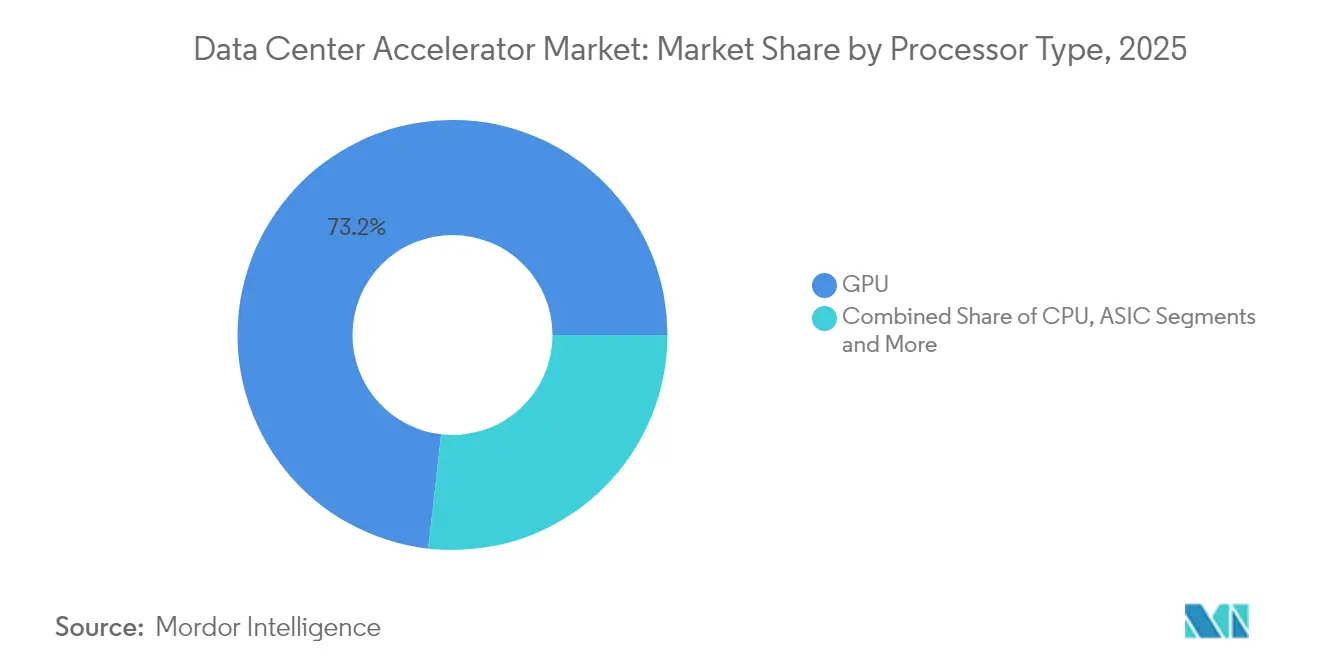

- Par type de processeur, les GPU ont dominé avec une part de revenus de 73,20 % en 2025 ; les ASIC devraient progresser à un TCAC de 15,42 % d'ici 2032.

- Par application, l'entraînement de l'IA a représenté 49,30 % de la part de marché des accélérateurs de centres de données en 2025, tandis que l'inférence IA progresse à un TCAC de 15,55 % d'ici 2032.

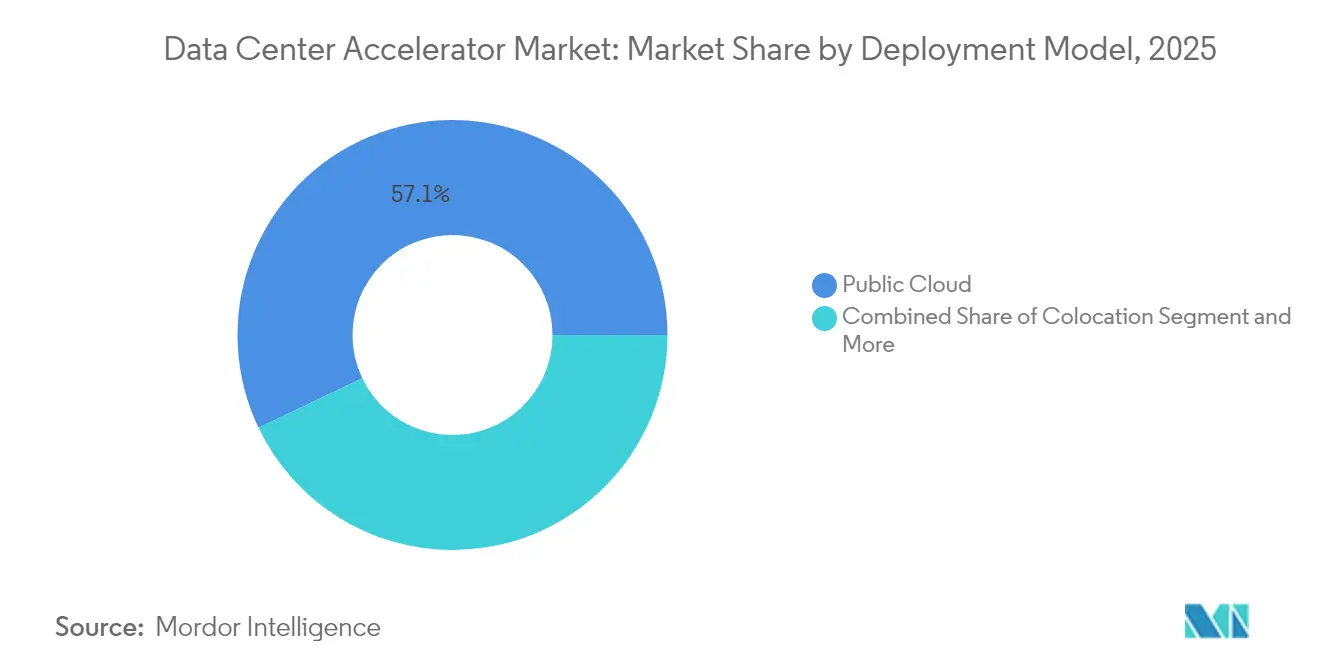

- Par modèle de déploiement, le cloud public a capté 57,10 % de la taille du marché des accélérateurs de centres de données en 2025 ; les configurations hybrides et en périphérie progressent à un TCAC de 15,72 % jusqu'en 2032.

- Par secteur d'utilisation final, l'informatique et les télécommunications ont détenu une part de revenus de 39,40 % en 2025, tandis que la santé et les sciences de la vie devraient croître à un TCAC de 14,62 % d'ici 2032.

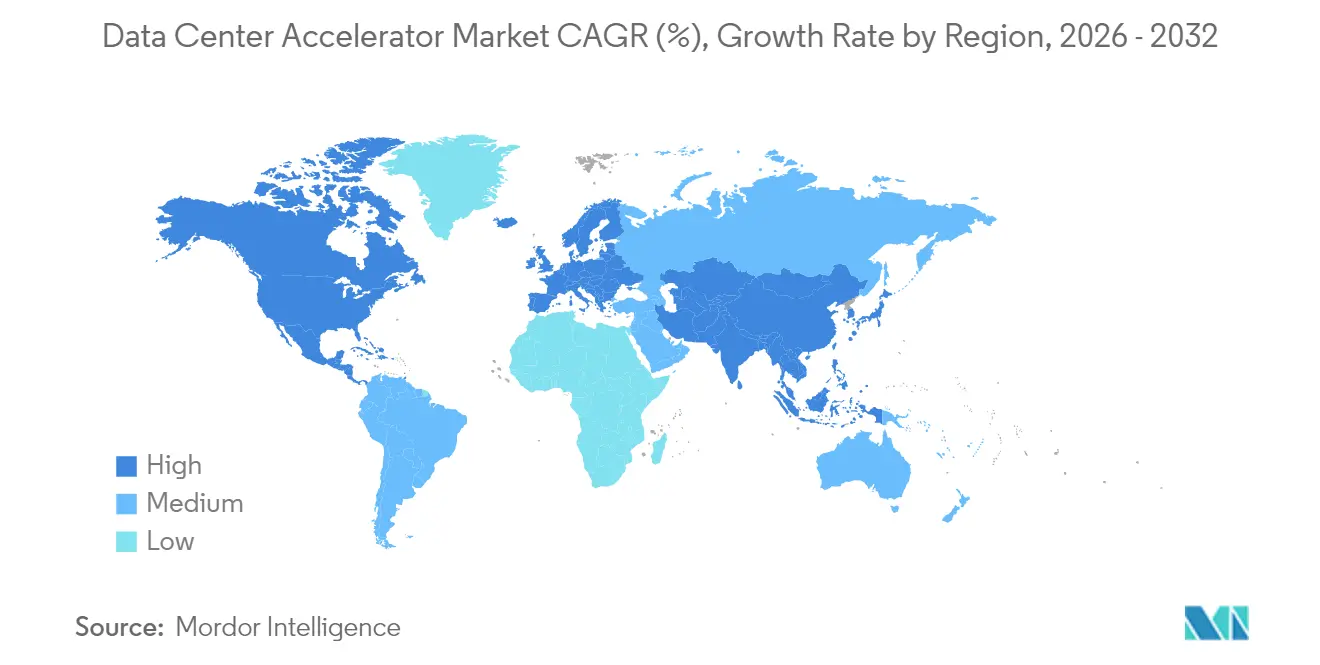

- Par géographie, l'Amérique du Nord a conservé la plus grande part régionale en 2025, tandis que l'APAC devrait enregistrer le TCAC le plus élevé d'ici 2032.

Remarque : Les chiffres de la taille du marché et des prévisions de ce rapport sont générés à l’aide du cadre d’estimation propriétaire de Mordor Intelligence, mis à jour avec les données et analyses les plus récentes disponibles en 2026.

Tendances et perspectives mondiales du marché des accélérateurs de centres de données

Analyse de l'impact des moteurs*

| MOTEUR | (~) % D'IMPACT SUR LES PRÉVISIONS DE TCAC | PERTINENCE GÉOGRAPHIQUE | CALENDRIER D'IMPACT |

|---|---|---|---|

| Hausse des charges de travail d'entraînement IA/ML dans les centres de données hyperscale | +4.2% | Amérique du Nord, APAC | Moyen terme (2 à 4 ans) |

| Pénurie de GPU stimulant la location d'accélérateurs basés sur le cloud | +2.8% | Amérique du Nord, Europe | Court terme (≤ 2 ans) |

| Adoption rapide de l'IA générative dans les plateformes SaaS | +3.1% | Amérique du Nord, Europe | Moyen terme (2 à 4 ans) |

| Algorithmes d'inspiration quantique exigeant des accélérateurs hétérogènes | +1.5% | Amérique du Nord, Europe, APAC | Long terme (≥ 4 ans) |

| Orchestration des charges de travail de la périphérie vers le cœur de réseau | +2.3% | APAC, Europe | Moyen terme (2 à 4 ans) |

| Programmes de cloud souverain subventionnant les usines d'accélérateurs domestiques | +1.8% | APAC, MEA, Europe | Long terme (≥ 4 ans) |

| Source: Mordor Intelligence | |||

Hausse des charges de travail d'entraînement IA/ML dans les centres de données hyperscale

Les opérateurs hyperscale déploient désormais des salles de données spécifiquement conçues pour l'IA, exigeant une densité de calcul 10 à 100 fois supérieure à celle des charges de travail d'entreprise héritées. Le campus d'Indiana de Meta, évalué à 800 millions USD, illustre ce changement en standardisant les racks refroidis par liquide pour accueillir des clusters GPU de plusieurs pétaflops. Microsoft a alloué plus de 80 milliards USD à des installations d'IA américaines pour l'exercice fiscal 2025, soulignant la concentration géographique des infrastructures d'entraînement. L'expansion d'Amazon de 100 milliards USD dans plusieurs États confirme également que les hyperscaleurs cloud poursuivent des économies d'échelle, mais chaque nouveau mégawatt doit répondre aux seuils internes d'énergie renouvelable.[3]Datacenters.com Staff, "Amazon's $100 Billion Data Center Expansion", datacenters.com Un équilibre délicat émerge tandis que les entreprises passent des modèles prototypes aux pipelines d'inférence, aboutissant à des conceptions de racks plus hétérogènes intégrant des nœuds GPU, CPU et ASIC. Les institutions financières illustrent cette construction à double voie, en allouant des clusters GPU discrets pour la détection de fraudes en temps réel tout en maintenant des fermes d'analyse à forte composante CPU pour les rapports réglementaires.

Pénurie de GPU stimulant la location d'accélérateurs basés sur le cloud

Les pénuries chroniques de GPU haut de gamme ont engendré des plateformes de GPU en tant que service (GPU-as-a-Service) qui dissocient la propriété du matériel de son utilisation. Le supercluster d'Oracle Cloud Infrastructure prend en charge 16 384 GPU AMD Instinct MI300X et propose des portails web à la consommation, réduisant les délais d'approvisionnement de plusieurs mois à quelques minutes.[1]Oracle Newsroom, "Oracle and AMD Collaborate to Help Customers Deliver Breakthrough Performance", oracle.com Les sites de minage de cryptomonnaies reconvertis en Amérique du Nord et en Europe contribuent à un parc immobilier à forte densité de puissance, permettant aux opérateurs de monétiser les capacités électriques inutilisées. Le modèle de location démocratise l'accès pour les petites et moyennes organisations qui ne pouvaient auparavant pas justifier la mise de fonds nécessaire pour des accélérateurs de premier rang. Les fournisseurs de services gagnent également en levier lors des négociations d'allocations avec les fournisseurs, renforçant la résilience face aux contraintes d'un fournisseur unique.

Adoption rapide de l'IA générative dans les plateformes SaaS

Les éditeurs de logiciels en tant que service (SaaS) intègrent l'IA générative directement dans leurs suites de collaboration, de service client et d'analyse, une démarche qui augmente considérablement les transactions d'inférence par utilisateur actif. Le cluster de grands modèles de langage de Together AI souligne les différences matérielles entre l'inférence et l'entraînement ; la bande passante mémoire et la latence éclipsent les FLOPS de pointe comme goulots d'étranglement. Les exemples SaaS dans le secteur de la santé, tels que les API d'imagerie diagnostique, doivent traiter des images chiffrées en temps réel, ce qui favorise les ASIC optimisés pour l'inférence par petits lots. Dans les services financiers, les modèles de risque de crédit en temps réel exigent des réponses en quelques millisecondes, stimulant l'adoption de structures de calcul en mémoire. Il en résulte un marché soutenu pour les accélérateurs optimisés pour l'efficacité énergétique et la latence déterministe plutôt que pour le débit absolu.

Algorithmes d'inspiration quantique exigeant des accélérateurs hétérogènes

Bien que les ordinateurs quantiques pratiques restent à plusieurs années, les algorithmes classiques d'inspiration quantique sont entrés en phase pilote dans la cryptographie, l'optimisation de portefeuille et la modélisation de découverte de médicaments. Ces flux de travail associent un prétraitement CPU à des couches d'émulation GPU ou FPGA et nécessitent des topologies de systèmes hybrides différentes des clusters IA standard. Les programmes de recherche gouvernementaux et les contrats de défense alimentent les premiers financements, signalant une courbe de demande à longue traîne qui commence dans les laboratoires nationaux et les installations de défense avant de filtrer vers les secteurs commerciaux.[2]Département de la défense, "AI-Enabled Detection System Set to Replace Aging Airspace Awareness System", diu.mil Les fournisseurs capables de combiner des moteurs de simulation quantique avec des accélérateurs grand public occuperont une niche défendable à mesure que le marché évolue.

Analyse de l'impact des freins*

| FREINS | (~) % D'IMPACT SUR LES PRÉVISIONS DE TCAC | PERTINENCE GÉOGRAPHIQUE | CALENDRIER D'IMPACT |

|---|---|---|---|

| Approvisionnement mondial tendu en substrats de conditionnement avancés | -2.1% | Hubs de fabrication APAC | Court terme (≤ 2 ans) |

| Courbe d'apprentissage abrupte pour les modèles de programmation hétérogènes | -1.4% | Mondial | Moyen terme (2 à 4 ans) |

| Objectifs croissants d'émissions de portée 3 contraignant les méga-clusters GPU | -1.8% | Amérique du Nord, Europe, APAC | Moyen terme (2 à 4 ans) |

| Régimes de contrôle des exportations sur les GPU et ASIC haut de gamme | -1.2% | Chine, Russie | Long terme (≥ 4 ans) |

| Source: Mordor Intelligence | |||

Approvisionnement mondial tendu en substrats de conditionnement avancés

Les accélérateurs intégrant des piles HBM et des chiplets reposent sur le film de renforcement Ajinomoto (ABF) et le conditionnement CoWoS, des matériaux désormais soumis à des délais d'approvisionnement d'un an. Les fournisseurs donnent la priorité aux références à forte marge, laissant les petits fournisseurs se démener pour obtenir des allocations limitées. Des expérimentations sur les interposeurs organiques sont en cours, mais elles ne soulageront pas significativement les contraintes avant au moins deux cycles de production. Taïwan et la Corée du Sud ont annoncé des expansions agressives de leur capacité de substrats, mais la fenêtre de montée en charge s'étend au-delà des points d'inflexion actuels de la demande.

Courbe d'apprentissage abrupte pour les modèles de programmation hétérogènes

À mesure que les puces se diversifient, les développeurs doivent adopter plusieurs chaînes d'outils, de CUDA à ROCm en passant par les SDK propriétaires des fournisseurs. Les pénuries de compétences augmentent les coûts d'intégration et prolongent les délais de preuve de concept. Les initiatives de normes ouvertes telles que OneAPI tentent de combler les lacunes, mais les cadences de publication décalées entre les générations de matériel compliquent la maintenance. Les marchés émergents font face aux obstacles les plus importants, car les universités locales accusent un retard dans les offres de programmes spécialisés.

*Nos prévisions mises à jour traitent les impacts des moteurs et des freins comme directionnels et non additifs. Les prévisions d’impact révisées reflètent la croissance de base, les effets de mix et les interactions entre variables.

Analyse des segments

Par type de processeur : les ASIC émergent comme champions de l'inférence

Les processeurs GPU ont conservé une part de 73,20 % en 2025, reflétant leur polyvalence tant pour les tâches d'entraînement de modèles que d'inférence. Les livraisons d'ASIC devraient cependant progresser à un TCAC de 15,42 % d'ici 2032, à mesure que les entreprises les optimisent pour une consommation d'énergie réduite lors des charges de travail d'inférence en régime permanent. La TPU v6 développée en interne par Google illustre la tendance au silicium maison qui équilibre performance et coût. Parallèlement, la famille AMD Instinct MI350 étend la capacité HBM à 288 Go, ciblant les modèles de transformeurs limités par la mémoire. Les sockets CPU orchestrent toujours les tâches d'E/S et de maintenance, tandis que les cartes FPGA maintiennent leur pertinence dans les nœuds de périphérie des télécommunications qui nécessitent une latence déterministe.

La croissance des ASIC illustre l'évolution des priorités des acheteurs. Les budgets d'alimentation à l'intérieur des baies de colocation augmentent rarement de manière linéaire avec la densité des racks, ce qui pousse les opérateurs à privilégier les métriques TOPS par watt. Les offres SaaS à forte densité d'inférence, telles que les chatbots de support client et les moteurs de personnalisation en temps réel, nécessitent une latence prévisible que les conceptions ASIC offrent désormais. Les charges de travail d'entraînement se concentreront toujours sur des clusters multi-GPU, mais une partie des cycles de calcul migre vers des moteurs tensoriels spécialisés intégrés dans les GPU de prochaine génération, brouillant les frontières catégorielles. Dans l'ensemble, la diversité des processeurs renforce la concurrence entre les fournisseurs, offrant aux acheteurs un levier sur les prix et la continuité de l'approvisionnement.

Note: Les parts de segment de tous les segments individuels sont disponibles à l'achat du rapport

Par application : l'inférence IA accélère au-delà de l'entraînement

L'entraînement de l'IA a représenté 49,30 % des revenus du marché des accélérateurs de centres de données en 2025, mais les charges de travail d'inférence enregistreront un TCAC plus rapide de 15,55 % d'ici 2032. Les entreprises, autrefois satisfaites des projets pilotes, lancent désormais en production des chatbots, des modèles de recommandation et des services d'analyse d'images, où les dérives de latence se traduisent directement par un taux d'attrition des clients. Le calcul haute performance reste une niche stable centrée sur la modélisation météorologique, la génomique et la dynamique des fluides computationnelle, reposant sur des GPU avec de plus grandes piles HBM plutôt que sur des ASIC purs.

La croissance de l'inférence se répercute sur la sélection du matériel. La variabilité de la taille des lots et les accords de niveau de service stricts nécessitent des accélérateurs qui optimisent la bande passante mémoire plutôt que le débit brut en virgule flottante. Les prestataires de soins de santé utilisent des cartes optimisées pour l'inférence afin d'effectuer une imagerie diagnostique au point de soin, réduisant le délai de diagnostic pour des affections telles que l'AVC. Les institutions financières s'appuient également sur des accélérateurs pour la notation des risques en temps réel, intégrant des nœuds de calcul dans des environnements de cloud privé à des fins de conformité réglementaire. L'évolution du mix d'applications continuera de diversifier les critères d'achat, la maturité de l'écosystème logiciel orientant de plus en plus les décisions d'achat.

Par modèle de déploiement : les configurations hybrides en périphérie stimulent la croissance

Les locataires du cloud public ont consommé 57,10 % de la taille du marché des accélérateurs de centres de données en 2025. Mais les installations hybrides en périphérie progresseront à un TCAC de 15,72 % à mesure que les organisations rapprochent les moteurs d'inférence des sources de données. Les opérateurs de télécommunications modernisent leurs centraux téléphoniques en micro-centres de données pour traiter le trafic provenant des véhicules autonomes et des flux de réalité augmentée. Les fournisseurs de colocation répondent par des rétroaménagements en refroidissement liquide et des zones de cloud souverain pour séduire les secteurs réglementés.

Les options sur site regagnent du terrain là où la souveraineté des données ou la prévisibilité des coûts l'emportent sur la commodité hyperscale. Les détaillants, par exemple, exécutent des analyses vidéo sur des serveurs de périphérie en magasin pour éviter la latence du transport réseau. Les équipes de développement envoient toujours des tâches d'entraînement vers le cloud public, mais rapatrient de plus en plus les modèles pour l'inférence. Le pluralisme architectural qui en résulte alimente la demande de plateformes de gestion qui orchestrent les charges de travail sur les clouds, les sites de colocation et les campus des clients.

Note: Les parts de segment de tous les segments individuels sont disponibles à l'achat du rapport

Par secteur d'utilisation final : la santé mène la trajectoire de croissance

Les opérateurs informatiques et de télécommunications représentaient 39,40 % des revenus de 2025, les opérateurs ayant modernisé leurs réseaux pour le découpage de cœur 5G et la virtualisation des fonctions réseau. La santé et les sciences de la vie seront cependant le secteur vertical à la croissance la plus rapide, avec un TCAC de 14,62 % d'ici 2032. Les pipelines de génomique dépendent d'un débit à l'échelle du pétaoctet, tandis que les instruments d'imagerie diagnostique nécessitent une inférence IA en périphérie pour guider les médecins en temps réel. Les services de données synthétiques de Gretel utilisent des accélérateurs pour générer des ensembles de données préservant la vie privée, aidant les hôpitaux à se conformer aux cadres réglementaires stricts.

Les charges de travail des services financiers se concentrent sur la détection de fraudes à la nanoseconde et les simulations de trading algorithmique, nécessitant des pools d'accélérateurs dédiés dans des clouds privés. Les utilisateurs gouvernementaux et de défense, soutenus par des programmes d'acquisition IA de plusieurs centaines de millions de dollars, privilégient des infrastructures sécurisées en réseau isolé. Les studios de médias et de divertissement adoptent des fermes de rendu GPU pour accélérer la création de contenu et le streaming en temps réel. Ces exigences diverses soutiennent la dynamique du marché et favorisent la spécialisation parmi les fabricants de puces et les intégrateurs de systèmes.

Analyse géographique

L'Amérique du Nord reste le plus grand acheteur, soutenue par les plans de dépenses d'investissement hyperscale d'Amazon, Microsoft et Google. Les dépenses de Microsoft seules dépassent 80 milliards USD pour les installations nationales en 2025. Le Canada et le Mexique émergent comme options de proximité qui équilibrent les considérations de coût énergétique et de latence tout en restant dans les cadres réglementaires nord-américains.

L'APAC affichera le TCAC le plus élevé, soutenu par les mandats de cloud souverain et la construction d'immenses campus tels que le complexe de 35 milliards USD de la Corée du Sud. La Chine fait progresser des accélérateurs domestiques comme la série Ascend de Huawei Technologies Co. Ltd. pour contourner les limitations dues au contrôle des exportations. Le consortium Rapidus du Japon et les initiatives de puces de SoftBank, aidés par des fonds publics, visent à retrouver une pertinence dans la fabrication de semi-conducteurs.

Les programmes GAIA-X et IPCEI-CIS d'Europe favorisent les clouds transfrontaliers de souveraineté des données. L'engagement de Blackstone de 13 milliards USD dans les centres de données au Royaume-Uni souligne la confiance des investisseurs dans la demande régionale en IA. La croissance au Moyen-Orient et en Afrique dépend du soutien des fonds souverains, les avantages en matière de prix de l'énergie soutenant les installations énergivores aux Émirats arabes unis et en Arabie saoudite.

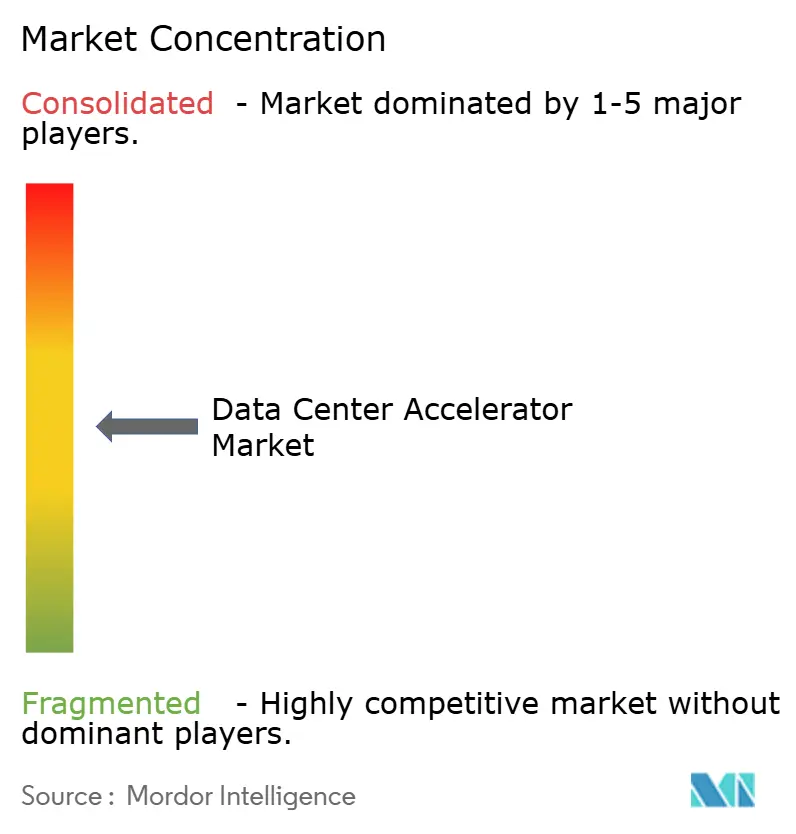

Paysage concurrentiel

Le marché des accélérateurs de centres de données affiche une concentration modérée. NVIDIA domine les clusters d'entraînement, mais AMD compresse sa feuille de route GPU, avançant le lancement du MI350 au début 2025 pour remporter des sockets hyperscale. Intel positionne ses accélérateurs Gaudi sur des niches prix-performance, tandis que Google et Amazon déploient des TPU et des puces Inferentia propriétaires pour réduire leur dépendance au silicium marchand.

La diversité architecturale invite des entrants agiles. Cerebras Systems Inc. cible l'IA à l'échelle de la tranche, Tenstorrent Inc. pousse des conceptions RISC-V, et la gamme Hanguang d'Alibaba Cloud sert les clouds chinois domestiques. Les écosystèmes logiciels deviennent déterminants ; les fournisseurs regroupent des compilateurs, des API de bas niveau et des utilitaires d'optimisation de modèles pour fidéliser les développeurs. Le risque lié à la chaîne d'approvisionnement remodèle les stratégies d'approvisionnement, les clients diversifiant leurs sources de GPU et de cartes ASIC pour se couvrir contre les pénuries de substrats.

Des accords stratégiques soulignent la course aux armements. Oracle s'associe à AMD pour déployer des superclusters MI300X, offrant aux clients une alternative à NVIDIA. Microsoft collabore avec des spécialistes du refroidissement liquide pour des clusters sur site dans des zones à haute densité. Les dépôts de brevets dans les interconnexions de chiplets augmentent, les entreprises cherchant des positions de propriété intellectuelle défendables, témoignant d'un pivot des puces monolithiques vers les architectures modulaires.

Leaders du secteur des accélérateurs de centres de données

-

Intel Corporation

-

NVIDIA Corporation

-

Advanced Micro Devices Inc.

-

Achronix Semiconductor Corporation

-

Xilinx Inc. (Advanced Micro Devices Inc.)

- *Avis de non-responsabilité : les principaux acteurs sont triés sans ordre particulier

Développements récents dans le secteur

- Mai 2025 : Red Hat a lancé la communauté llm-d pour l'inférence d'IA générative à grande échelle, soutenue par CoreWeave, Google Cloud, IBM Research et NVIDIA, en se concentrant sur l'architecture Kubernetes native et les capacités d'inférence distribuée basées sur vLLM.

- Février 2025 : AMD a annoncé les accélérateurs Instinct MI325X avec 256 Go de mémoire HBM3e et une bande passante de 6 To/s, promettant des performances d'inférence 1,4 fois supérieures à celles des concurrents et permettant aux entreprises d'obtenir de meilleurs résultats avec moins de GPU.

- Octobre 2024 : MITRE a lancé le bac à sable IA fédéral (Federal AI Sandbox) en partenariat avec NVIDIA, comprenant un supercalculateur de 20 millions USD propulsé par NVIDIA DGX SuperPOD avec 248 GPU H100 pour le développement et le déploiement sécurisés de l'IA par les agences fédérales.

- Octobre 2024 : AMD a livré des performances IA de premier plan avec les accélérateurs MI325X offrant 1,3 fois de meilleures performances de calcul théorique de pointe, avec des livraisons de production débutant au quatrième trimestre 2024 et une large disponibilité attendue au premier trimestre 2025.

Portée du rapport mondial sur le marché des accélérateurs de centres de données

Les accélérateurs de centres de données sont des matériels conçus et utilisés pour traiter des données visuelles. Il s'agit de dispositifs matériels ou de programmes logiciels qui améliorent les performances globales des ordinateurs. Les accélérateurs de centres de données contribuent à augmenter la demande de données des consommateurs et utilisent des services basés sur l'IA pour stimuler la demande de centres de données centrés sur l'IA.

Le marché mondial des accélérateurs de centres de données est segmenté par type de processeur (CPU, GPU, FPGA, ASIC), application (calcul haute performance, intelligence artificielle) et géographie (Amérique du Nord, Europe, Asie-Pacifique, Amérique latine, Moyen-Orient et Afrique). La taille du marché et les prévisions sont fournies en termes de valeur (USD) pour tous les segments ci-dessus.

| CPU |

| GPU |

| FPGA |

| ASIC |

| Calcul haute performance |

| Entraînement de l'intelligence artificielle |

| Inférence de l'intelligence artificielle |

| Autres charges de travail |

| Sur site / Entreprise / Périphérie |

| Colocation |

| Cloud public |

| Informatique et télécommunications |

| BFSI |

| Santé et sciences de la vie |

| Gouvernement et défense |

| Médias et divertissement |

| Autres utilisateurs finaux |

| Amérique du Nord | États-Unis | |

| Mexique | ||

| Canada | ||

| Amérique du Sud | Brésil | |

| Reste de l'Amérique du Sud | ||

| Europe | Allemagne | |

| Royaume-Uni | ||

| France | ||

| Russie | ||

| Reste de l'Europe | ||

| Asie-Pacifique | Chine | |

| Japon | ||

| Inde | ||

| Corée du Sud | ||

| Reste de l'Asie-Pacifique | ||

| Moyen-Orient et Afrique | Moyen-Orient | Arabie saoudite |

| Émirats arabes unis | ||

| Turquie | ||

| Afrique | Afrique du Sud | |

| Reste de l'Afrique | ||

| Par type de processeur | CPU | ||

| GPU | |||

| FPGA | |||

| ASIC | |||

| Par application | Calcul haute performance | ||

| Entraînement de l'intelligence artificielle | |||

| Inférence de l'intelligence artificielle | |||

| Autres charges de travail | |||

| Par modèle de déploiement | Sur site / Entreprise / Périphérie | ||

| Colocation | |||

| Cloud public | |||

| Par secteur d'utilisation final | Informatique et télécommunications | ||

| BFSI | |||

| Santé et sciences de la vie | |||

| Gouvernement et défense | |||

| Médias et divertissement | |||

| Autres utilisateurs finaux | |||

| Par géographie | Amérique du Nord | États-Unis | |

| Mexique | |||

| Canada | |||

| Amérique du Sud | Brésil | ||

| Reste de l'Amérique du Sud | |||

| Europe | Allemagne | ||

| Royaume-Uni | |||

| France | |||

| Russie | |||

| Reste de l'Europe | |||

| Asie-Pacifique | Chine | ||

| Japon | |||

| Inde | |||

| Corée du Sud | |||

| Reste de l'Asie-Pacifique | |||

| Moyen-Orient et Afrique | Moyen-Orient | Arabie saoudite | |

| Émirats arabes unis | |||

| Turquie | |||

| Afrique | Afrique du Sud | ||

| Reste de l'Afrique | |||

Questions clés auxquelles le rapport répond

À quelle vitesse la demande d'accélérateurs devrait-elle croître d'ici 2032 ?

Le marché des accélérateurs de centres de données devrait progresser à un TCAC de 13,96 %, plus que doublant de 12,89 milliards USD en 2025 à 32,13 milliards USD d'ici 2032.

Quel segment de processeurs gagnera le plus de parts d'ici 2032 ?

Les accélérateurs à base d'ASIC devraient afficher un TCAC de 15,42 %, réduisant l'écart avec les GPU pour les charges de travail à forte densité d'inférence.

Pourquoi les entreprises adoptent-elles des déploiements hybrides et en périphérie ?

Les charges de travail sensibles à la latence (5G, véhicules autonomes et Internet des objets industriel) nécessitent une inférence locale, ce qui génère un TCAC de 15,72 % pour les installations hybrides en périphérie.

Quel est le principal frein auquel font face les fournisseurs d'accélérateurs aujourd'hui ?

Les pénuries de substrats de conditionnement avancés tels que l'ABF et le CoWoS limitent la capacité de production à court terme, réduisant la croissance des expéditions d'environ 2,1 points de pourcentage.

Quel secteur vertical affiche la croissance des dépenses la plus rapide ?

La santé et les sciences de la vie mèneront avec un TCAC de 14,62 % car les flux de travail de génomique, de découverte de médicaments et d'imagerie diagnostique exigent des capacités de calcul spécialisées.

Dernière mise à jour de la page le: