Tamaño y Cuota del Mercado de Aceleradores para Centros de Datos

Análisis del Mercado de Aceleradores para Centros de Datos por Mordor Intelligence

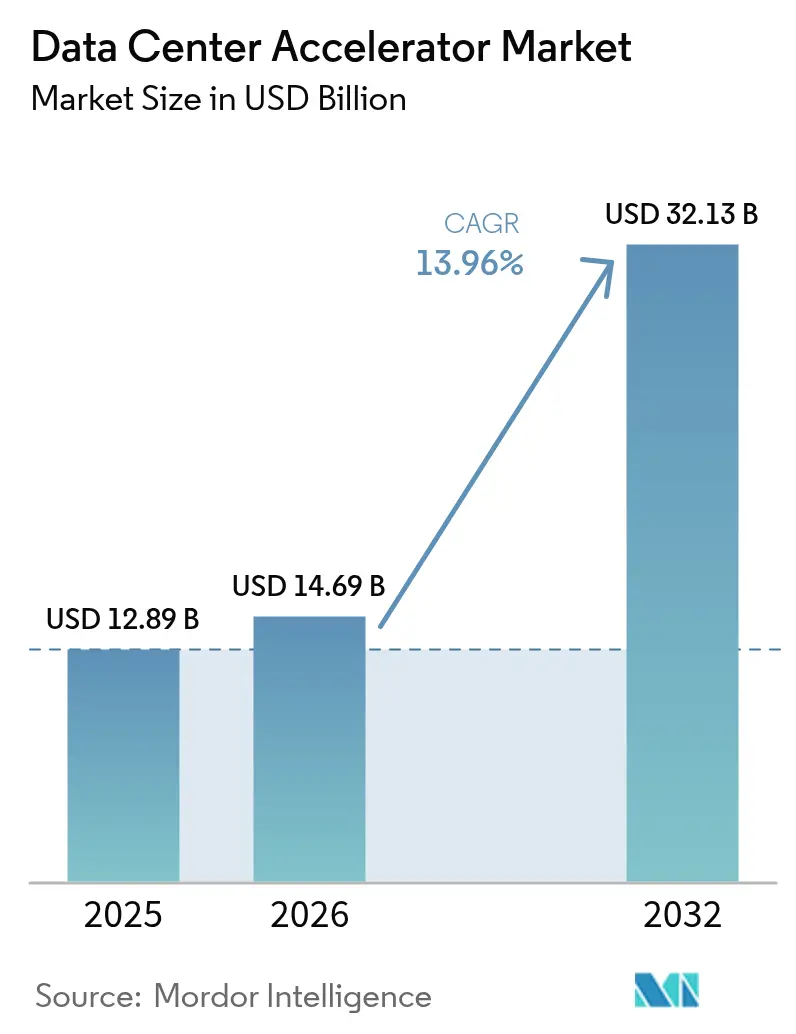

El tamaño del mercado de Aceleradores para Centros de Datos en 2026 se estima en 14.690 millones de USD, creciendo desde el valor de 2025 de 12.890 millones de USD con proyecciones para 2032 que muestran 32.130 millones de USD, creciendo a una CAGR del 13,96% durante el período 2026-2032. Los ciclos de entrenamiento de inteligencia artificial en escalada, la proliferación de instalaciones de hiperescala y el giro hacia GPU, ASIC y otros chips de propósito específico son los principales motores detrás de esta expansión. Los programas de nube soberana, los regímenes de control de exportaciones y los mandatos de sostenibilidad están reformando los patrones de inversión regionales, impulsando a los compradores hacia aceleradores de origen doméstico e infraestructura más ecológica. La escasez de capacidad en sustratos de empaquetado y la escasez de memoria de alto ancho de banda están moderando la disponibilidad de hardware a corto plazo, lo que lleva a los proveedores de nube a priorizar las configuraciones de mayor margen. Al mismo tiempo, las retrofits de enfriamiento líquido y los acuerdos de compra de energía renovable están emergiendo como criterios de selección críticos para proyectos de capital, lo que señala que la eficiencia energética es ahora un diferenciador competitivo en lugar de un centro de costos.

Conclusiones Clave del Informe

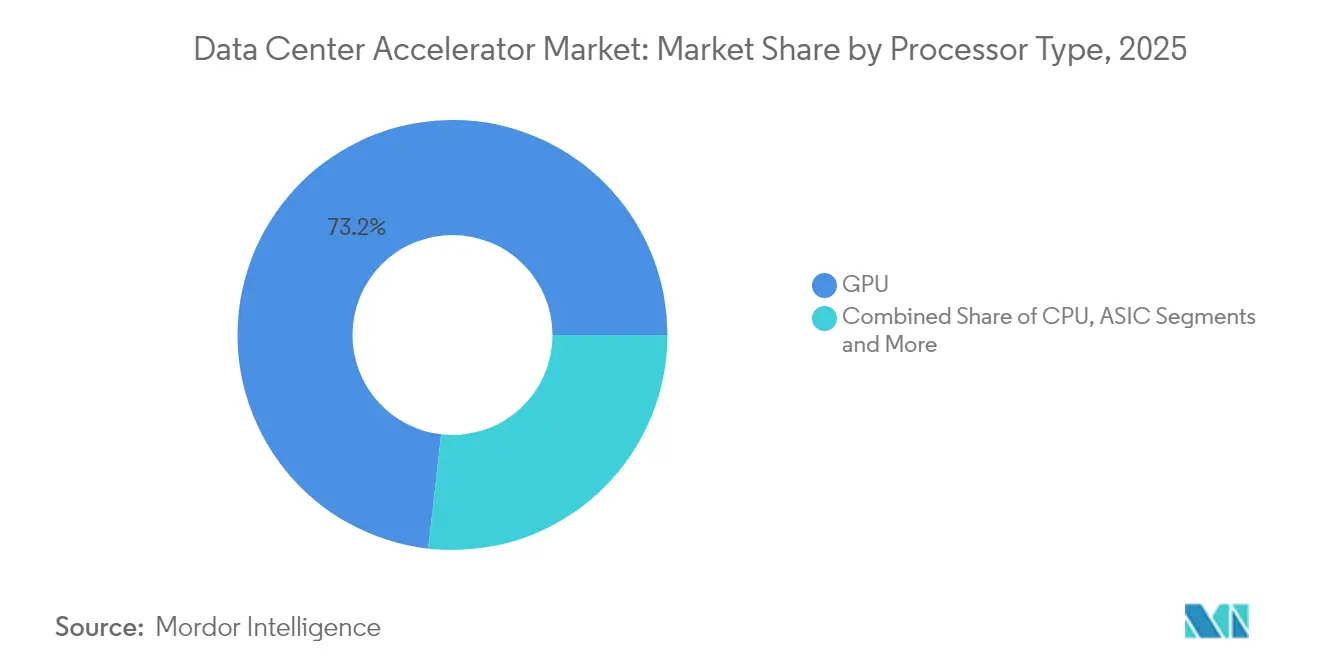

- Por tipo de procesador, las GPU lideraron con una cuota de ingresos del 73,20% en 2025; se proyecta que los ASIC se expandirán a una CAGR del 15,42% hasta 2032.

- Por aplicación, el entrenamiento de IA representó el 49,30% de la cuota del mercado de Aceleradores para Centros de Datos en 2025, mientras que la inferencia de IA avanza a una CAGR del 15,55% hasta 2032.

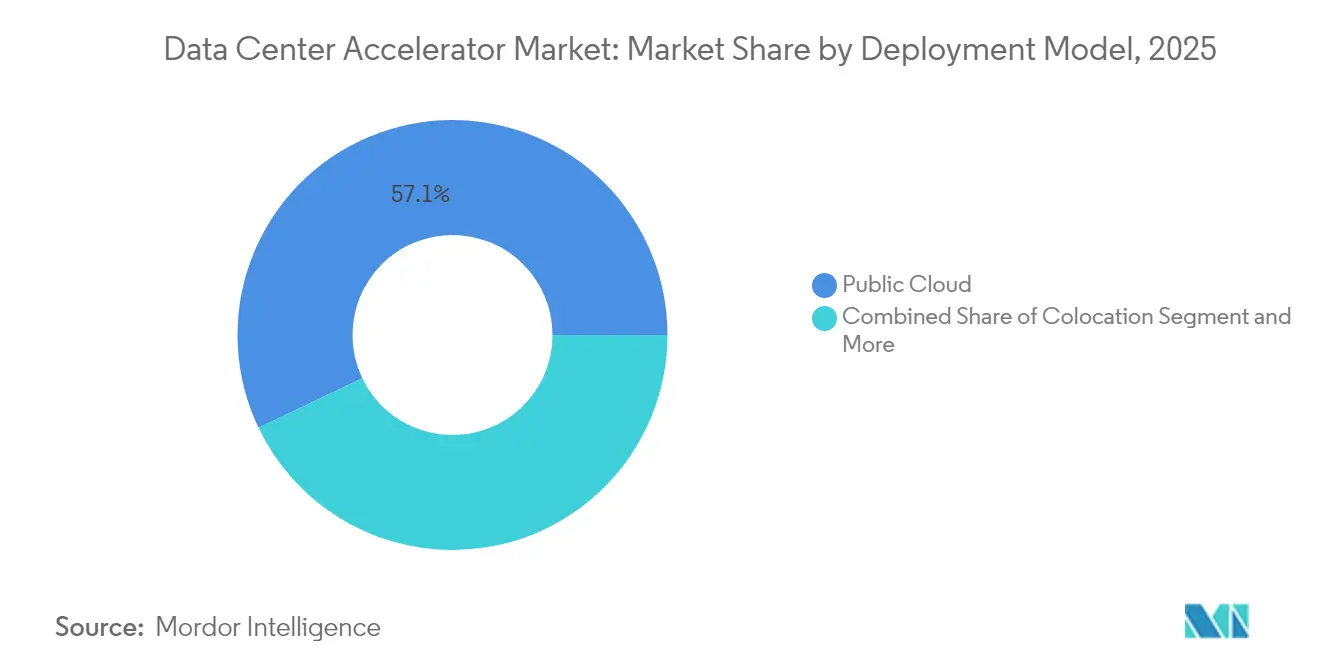

- Por modelo de implementación, la nube pública capturó el 57,10% del tamaño del mercado de Aceleradores para Centros de Datos en 2025; las configuraciones híbridas y de borde se están expandiendo a una CAGR del 15,72% hasta 2032.

- Por industria del usuario final, TI y telecomunicaciones mantuvieron una cuota de ingresos del 39,40% en 2025, mientras que se prevé que la atención sanitaria y las ciencias de la vida crezcan a una CAGR del 14,62% hasta 2032.

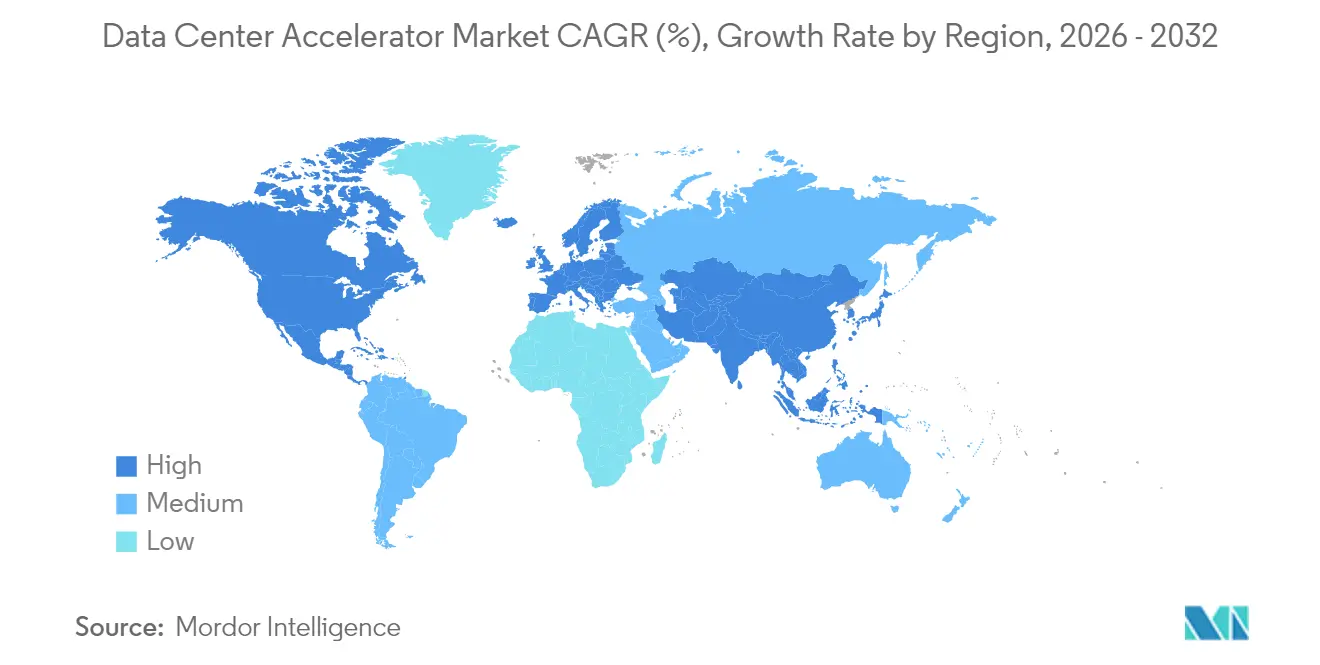

- Por geografía, América del Norte retuvo la mayor participación regional en 2025, mientras que APAC está proyectado para registrar la CAGR más rápida hasta 2032.

Nota: Las cifras de tamaño del mercado y previsión de este informe se generan utilizando el marco de estimación propietario de Mordor Intelligence, actualizado con los últimos datos e información disponibles a partir de 2026.

Tendencias e Información del Mercado Global de Aceleradores para Centros de Datos

Análisis del Impacto de los Impulsores*

| IMPULSOR | (~) % DE IMPACTO EN LA PREVISIÓN DE CAGR | RELEVANCIA GEOGRÁFICA | HORIZONTE TEMPORAL DE IMPACTO |

|---|---|---|---|

| Crecientes cargas de trabajo de entrenamiento de IA/ML en centros de datos de hiperescala | +4.2% | América del Norte, APAC | Mediano plazo (2-4 años) |

| Escasez de GPU que impulsa el alquiler de aceleradores basados en la nube | +2.8% | América del Norte, Europa | Corto plazo (≤ 2 años) |

| Adopción rápida de IA generativa en plataformas de Software como Servicio | +3.1% | América del Norte, Europa | Mediano plazo (2-4 años) |

| Algoritmos de inspiración cuántica que demandan aceleradores heterogéneos | +1.5% | América del Norte, Europa, APAC | Largo plazo (≥ 4 años) |

| Orquestación de cargas de trabajo del borde al núcleo | +2.3% | APAC, Europa | Mediano plazo (2-4 años) |

| Programas de nube soberana que subvencionan fábricas de aceleradores domésticos | +1.8% | APAC, MEA, Europa | Largo plazo (≥ 4 años) |

| Fuente: Mordor Intelligence | |||

Crecientes Cargas de Trabajo de Entrenamiento de IA/ML en Centros de Datos de Hiperescala

Los operadores de hiperescala ahora implementan salas de datos construidas específicamente para IA que demandan una densidad de cómputo entre 10 y 100 veces mayor que las cargas de trabajo empresariales heredadas. El campus de Indiana de Meta valorado en 800 millones de USD ejemplifica el cambio al estandarizar racks de enfriamiento líquido para acomodar clústeres de GPU de múltiples petaflops. Microsoft destinó más de 80.000 millones de USD para instalaciones de IA en Estados Unidos en el año fiscal 2025, lo que subraya la concentración geográfica de la infraestructura de entrenamiento. La expansión multiestatal de 100.000 millones de USD de Amazon señala además que los hiperescaladores en la nube persiguen economías de escala, pero cada nuevo megavatio debe cumplir con los umbrales internos de energía renovable.[3]Personal de Datacenters.com, "Amazon's $100 Billion Data Center Expansion", datacenters.com Está emergiendo un acto de equilibrio a medida que las empresas pasan de modelos prototipo a canalizaciones de inferencia, lo que resulta en diseños de rack más heterogéneos que integran nodos de GPU, CPU y ASIC. Las instituciones financieras ejemplifican esta construcción de doble vía, asignando clústeres de GPU discretos para la detección de fraude en tiempo real mientras mantienen granjas de análisis con gran cantidad de CPU para informes regulatorios.

Escasez de GPU que Impulsa el Alquiler de Aceleradores Basados en la Nube

La escasez crónica de GPU de primera calidad ha dado lugar a plataformas de GPU como Servicio que desvinculan la propiedad del hardware del uso. El superclúster de Oracle Cloud Infrastructure admite 16.384 GPU AMD Instinct MI300X y ofrece portales web basados en consumo, reduciendo los tiempos de adquisición de meses a minutos.[1]Sala de prensa de Oracle, "Oracle and AMD Collaborate to Help Customers Deliver Breakthrough Performance", oracle.com Los sitios de minería de criptomonedas reconvertidos en América del Norte y Europa contribuyen con bienes raíces de alta densidad de energía, lo que permite a los operadores monetizar la capacidad eléctrica varada. El modelo de alquiler democratiza el acceso para organizaciones pequeñas y medianas que anteriormente no podían justificar el desembolso de capital para aceleradores de primer nivel. Los proveedores de servicios también ganan influencia al negociar asignaciones de proveedores, mejorando la resiliencia frente a las restricciones de un único proveedor.

Adopción Rápida de IA Generativa en Plataformas de Software como Servicio

Los proveedores de Software como Servicio están incorporando IA generativa directamente en suites de colaboración, servicio al cliente y análisis, un movimiento que aumenta considerablemente las transacciones de inferencia por usuario activo. El clúster de modelos de lenguaje de gran escala de Together AI subraya las diferencias de hardware entre inferencia y entrenamiento; el ancho de banda de memoria y la latencia eclipsan los FLOPS máximos como cuellos de botella. Los ejemplos de Software como Servicio en el sector sanitario, como las API de imágenes diagnósticas, deben procesar imágenes cifradas en tiempo real, favoreciendo así los ASIC ajustados para inferencia en lotes pequeños. En los servicios financieros, los modelos de riesgo crediticio en tiempo real exigen respuestas en milisegundos, lo que impulsa la adopción de tejidos de computación en memoria. El resultado es un mercado sostenido de aceleradores optimizados para la eficiencia energética y la latencia determinista en lugar del rendimiento absoluto.

Algoritmos de Inspiración Cuántica que Demandan Aceleradores Heterogéneos

Aunque los ordenadores cuánticos prácticos siguen estando a años de distancia, los algoritmos clásicos de inspiración cuántica han entrado en uso piloto en criptografía, optimización de carteras y modelado de descubrimiento de fármacos. Estos flujos de trabajo combinan el preprocesamiento de CPU con capas de emulación de GPU o FPGA y requieren topologías de sistema híbrido distintas a los clústeres de IA estándar. Los programas de investigación gubernamentales y los contratos de defensa están impulsando la financiación inicial, lo que señala una curva de demanda de larga cola que comienza en laboratorios nacionales e instalaciones de defensa antes de filtrarse a los sectores comerciales.[2]Departamento de Defensa, "AI-Enabled Detection System Set to Replace Aging Airspace Awareness System," diu.mil Los proveedores capaces de combinar motores de simulación cuántica con aceleradores convencionales ocuparán un nicho defendible a medida que el mercado evolucione.

Análisis del Impacto de las Restricciones*

| RESTRICCIONES | (~) % DE IMPACTO EN LA PREVISIÓN DE CAGR | RELEVANCIA GEOGRÁFICA | HORIZONTE TEMPORAL DE IMPACTO |

|---|---|---|---|

| Escasez global de sustratos de empaquetado avanzado | -2.1% | Centros de fabricación de APAC | Corto plazo (≤ 2 años) |

| Pronunciada curva de aprendizaje para modelos de programación heterogéneos | -1.4% | Global | Mediano plazo (2-4 años) |

| Aumento de los objetivos de emisiones de Alcance 3 que restringen los megaclústeres de GPU | -1.8% | América del Norte, Europa, APAC | Mediano plazo (2-4 años) |

| Regímenes de control de exportaciones sobre GPU y ASIC de alta gama | -1.2% | China, Rusia | Largo plazo (≥ 4 años) |

| Fuente: Mordor Intelligence | |||

Escasez Global de Sustratos de Empaquetado Avanzado

Los aceleradores que integran pilas HBM y chiplets dependen de la Película de Construcción de Ajinomoto y el empaquetado CoWoS, materiales actualmente sujetos a tiempos de entrega de un año. Los proveedores priorizan los SKU de mayor margen, dejando a los proveedores más pequeños a la búsqueda de asignaciones limitadas. La experimentación con interposers orgánicos está en curso, pero no aliviará significativamente las restricciones durante al menos dos ciclos de producción. Taiwán y Corea del Sur han anunciado expansiones agresivas de capacidad de sustratos, aunque la ventana de aceleración se extiende más allá de los puntos de inflexión de la demanda actual.

Pronunciada Curva de Aprendizaje para Modelos de Programación Heterogéneos

A medida que los chips se diversifican, los desarrolladores deben adoptar múltiples cadenas de herramientas, desde CUDA hasta ROCm y los SDK específicos de cada proveedor. La escasez de habilidades aumenta los costos de integración y prolonga los plazos de prueba de concepto. Los esfuerzos de estándares abiertos como OneAPI intentan cerrar las brechas, pero los calendarios de lanzamiento desajustados entre generaciones de hardware complican el mantenimiento. Los mercados emergentes enfrentan los mayores obstáculos porque las universidades locales están rezagadas en ofertas de planes de estudio especializados.

*Nuestras previsiones actualizadas tratan los impactos de los impulsores y las restricciones como direccionales, no aditivos. Las previsiones de impacto revisadas reflejan el crecimiento base, los efectos de mezcla y las interacciones entre variables.

Análisis de Segmentos

Por Tipo de Procesador: Los ASIC Emergen como Campeones de la Inferencia

Los procesadores GPU retuvieron una participación del 73,20% en 2025, lo que refleja su versatilidad tanto en tareas de entrenamiento de modelos como de inferencia. Sin embargo, se proyecta que los envíos de ASIC aumentarán a una CAGR del 15,42% hasta 2032 a medida que las empresas se ajustan para lograr un menor consumo de energía durante las cargas de trabajo de inferencia en estado estacionario. La TPU v6 desarrollada internamente por Google ejemplifica la tendencia del silicio propio que equilibra rendimiento y costo. Mientras tanto, la familia Instinct MI350 de AMD amplía la capacidad HBM a 288 GB, apuntando a modelos transformadores con restricciones de memoria. Los zócalos de CPU aún orquestan las tareas de E/S y mantenimiento, mientras que las tarjetas FPGA mantienen relevancia en los nodos de borde de telecomunicaciones que requieren latencia determinista.

El crecimiento de los ASIC ilustra el cambio en las prioridades de los compradores. Los presupuestos de energía dentro de las jaulas de coubicación rara vez escalan linealmente con la densidad de los racks, lo que lleva a los operadores a favorecer las métricas de TOPS por vatio. Las ofertas de Software como Servicio con gran densidad de inferencia, como los chatbots de atención al cliente y los motores de personalización en tiempo real, requieren una latencia predecible que los diseños ASIC ahora ofrecen. Las cargas de trabajo de entrenamiento seguirán concentradas en clústeres de múltiples GPU, aunque una parte de los ciclos de cómputo migra a motores tensoriales especializados integrados en las GPU de próxima generación, difuminando los límites categóricos. En general, la diversidad de procesadores fortalece la competencia entre proveedores, ofreciendo a los compradores ventaja en precios y continuidad de suministro.

Nota: Las cuotas de segmento de todos los segmentos individuales están disponibles al adquirir el informe

Por Aplicación: La Inferencia de IA Acelera Más Allá del Entrenamiento

El entrenamiento de IA representó el 49,30% de los ingresos del mercado de Aceleradores para Centros de Datos en 2025, pero las cargas de trabajo de inferencia registrarán una CAGR más rápida del 15,55% hasta 2032. Las empresas que antes se conformaban con proyectos piloto ahora están lanzando chatbots, modelos de recomendación y servicios de análisis de imágenes a producción, donde el deslizamiento de latencia se traduce directamente en abandono de clientes. La computación de alto rendimiento sigue siendo un nicho estable centrado en el modelado meteorológico, la genómica y la dinámica de fluidos computacional, que depende de GPU con pilas HBM más grandes en lugar de ASIC puros.

El crecimiento de la inferencia repercute en la selección de hardware. La variabilidad del tamaño de los lotes y los estrictos acuerdos de nivel de servicio requieren aceleradores que optimicen el ancho de banda de memoria sobre el rendimiento de punto flotante sin procesar. Los proveedores de atención sanitaria emplean tarjetas optimizadas para inferencia para realizar imágenes diagnósticas en el punto de atención, acortando el tiempo de diagnóstico para afecciones como el accidente cerebrovascular. Las instituciones financieras también aprovechan los aceleradores para la puntuación de riesgo en tiempo real, integrando nodos de cómputo dentro de entornos de nube privada para el cumplimiento normativo. La creciente combinación de aplicaciones continuará diversificando los criterios de compra, con la madurez del ecosistema de software influyendo cada vez más en las decisiones de compra.

Por Modelo de Implementación: Las Configuraciones Híbridas de Borde Impulsan el Crecimiento

Los inquilinos de nube pública consumieron el 57,10% del tamaño del mercado de Aceleradores para Centros de Datos en 2025. Pero las instalaciones híbridas de borde se expandirán a una CAGR del 15,72% a medida que las organizaciones coubican los motores de inferencia más cerca de las fuentes de datos. Las empresas de telecomunicaciones actualizan las oficinas centrales en microcentros de datos para procesar el tráfico de vehículos autónomos y flujos de realidad aumentada. Los proveedores de coubicación responden con retrofits de enfriamiento líquido y zonas de nube soberana para atraer a las industrias reguladas.

Las opciones en las instalaciones recuperan tracción donde la soberanía de datos o la previsibilidad de costos superan la conveniencia de la hiperescala. Los minoristas, por ejemplo, ejecutan análisis de video en servidores de borde dentro de las tiendas para evitar la latencia de retroceso. Los equipos de desarrollo aún envían trabajos de entrenamiento a la nube pública, pero cada vez repatrian más modelos para la inferencia. El pluralismo arquitectónico resultante impulsa la demanda de plataformas de gestión que orquestan cargas de trabajo a través de nubes, sitios de coubicación y campus de clientes.

Nota: Las cuotas de segmento de todos los segmentos individuales están disponibles al adquirir el informe

Por Industria del Usuario Final: La Atención Sanitaria Lidera la Trayectoria de Crecimiento

Los operadores de TI y telecomunicaciones representaron el 39,40% de los ingresos de 2025 a medida que los operadores modernizaban las redes para el corte de núcleo 5G y la virtualización de funciones de red. Sin embargo, la atención sanitaria y las ciencias de la vida serán el segmento vertical de más rápido crecimiento con una CAGR del 14,62% hasta 2032. Los flujos de trabajo de genómica dependen de un rendimiento a escala de petabytes, mientras que los instrumentos de imágenes diagnósticas requieren inferencia de IA en el borde para guiar a los médicos en tiempo real. Los servicios de datos sintéticos de Gretel emplean aceleradores para generar conjuntos de datos que preservan la privacidad, ayudando a los hospitales a cumplir con estrictos marcos regulatorios.

Las cargas de trabajo de servicios financieros se centran en la detección de fraude a nivel de nanosegundos y las simulaciones de negociación algorítmica, lo que requiere grupos de aceleradores dedicados dentro de nubes privadas. Los usuarios gubernamentales y de defensa, respaldados por programas de adquisición de IA de cientos de millones de dólares, favorecen infraestructuras seguras con separación física de redes. Los estudios de medios y entretenimiento adoptan granjas de renderizado con GPU para acelerar la creación de contenido y la transmisión en tiempo real. Estos diversos requisitos sostienen el impulso del mercado y fomentan la especialización entre los proveedores de chips e integradores de sistemas.

Análisis Geográfico

América del Norte sigue siendo el mayor comprador, respaldada por los planes de gastos de capital en hiperescala de Amazon, Microsoft y Google. El gasto de Microsoft solo supera los 80.000 millones de USD para instalaciones domésticas en 2025. Canadá y México emergen como opciones cercanas que equilibran el costo de energía y las consideraciones de latencia mientras permanecen dentro de los marcos regulatorios de América del Norte.

APAC registrará la CAGR más alta, impulsada por los mandatos de nube soberana y la construcción de enormes campus como el complejo de 35.000 millones de USD de Corea del Sur. China avanza en aceleradores domésticos como la serie Ascend de Huawei para navegar las limitaciones de control de exportaciones. El consorcio Rapidus de Japón y las iniciativas de chips de SoftBank, con el apoyo de financiación pública, apuntan a recuperar relevancia en la fabricación de semiconductores.

Los programas GAIA-X e IPCEI-CIS de Europa fomentan nubes de soberanía de datos transfronterizas. El compromiso de 13.000 millones de USD de Blackstone con centros de datos en el Reino Unido subraya la confianza de los inversores en la demanda regional de IA. El crecimiento en Oriente Medio y África depende del respaldo de los fondos soberanos de riqueza, con ventajas en el precio de la energía que respaldan instalaciones de alto consumo energético en los Emiratos Árabes Unidos y Arabia Saudita.

Panorama Competitivo

El mercado de Aceleradores para Centros de Datos muestra una concentración moderada. NVIDIA domina los clústeres de entrenamiento, aunque AMD comprime su hoja de ruta de GPU, adelantando el lanzamiento de MI350 a principios de 2025 para ganar zócalos de hiperescala. Intel posiciona los aceleradores Gaudi para nichos de precio-rendimiento, mientras que Google y Amazon despliegan TPU e chips Inferentia propietarios para reducir la dependencia del silicio de terceros.

La diversidad arquitectónica invita a participantes ágiles. Cerebras apunta a la IA a escala de obleas, Tenstorrent impulsa diseños RISC-V y la línea Hanguang de Alibaba sirve a las nubes chinas domésticas. Los ecosistemas de software se vuelven decisivos; los proveedores agrupan compiladores, API de bajo nivel y utilidades de optimización de modelos para fidelizar a los desarrolladores. El riesgo en la cadena de suministro reformula las estrategias de aprovisionamiento a medida que los clientes obtienen GPU y tarjetas ASIC de doble fuente para protegerse contra la escasez de sustratos.

Los acuerdos estratégicos subrayan la carrera armamentística. Oracle se asocia con AMD para implementar superclústeres MI300X, ofreciendo a los clientes una alternativa a NVIDIA. Microsoft colabora con especialistas en enfriamiento líquido para clústeres en las instalaciones en zonas de alta densidad. Las solicitudes de patentes en interconexiones de chiplets se disparan a medida que las empresas buscan posiciones de propiedad intelectual defendibles, lo que evidencia un giro de los chips monolíticos a las arquitecturas modulares.

Líderes de la Industria de Aceleradores para Centros de Datos

-

Intel Corporation

-

NVIDIA Corporation

-

Advanced Micro Devices Inc.

-

Achronix Semiconductor Corporation

-

Xilinx Inc. (Advanced Micro Devices Inc.)

- *Nota aclaratoria: los principales jugadores no se ordenaron de un modo en especial

Desarrollos Recientes de la Industria

- Mayo de 2025: Red Hat lanzó la comunidad llm-d para inferencia escalable de IA generativa, apoyada por CoreWeave, Google Cloud, IBM Research y NVIDIA, con enfoque en la arquitectura nativa de Kubernetes y capacidades de inferencia distribuida basadas en vLLM.

- Febrero de 2025: AMD anunció los aceleradores Instinct MI325X con 256 GB de memoria HBM3e y 6 TB/s de ancho de banda, prometiendo un rendimiento de inferencia 1,4 veces superior al de los competidores y permitiendo a las empresas lograr mejores resultados con menos GPU.

- Octubre de 2024: MITRE lanzó el Entorno Seguro de IA Federal en asociación con NVIDIA, con un superordenador de 20 millones de USD impulsado por NVIDIA DGX SuperPOD con 248 GPU H100 para el desarrollo y despliegue seguro de IA por parte de agencias federales.

- Octubre de 2024: AMD ofreció un rendimiento de IA líder con los aceleradores MI325X con un rendimiento computacional teórico máximo 1,3 veces mayor, iniciando envíos de producción en el cuarto trimestre de 2024 con disponibilidad generalizada esperada en el primer trimestre de 2025.

Alcance del Informe del Mercado Global de Aceleradores para Centros de Datos

Los aceleradores para centros de datos son hardware diseñado y utilizado para procesar datos visuales. Es un dispositivo de hardware o programa de software que mejora el rendimiento general de los ordenadores. Los aceleradores para centros de datos ayudan a aumentar la demanda de datos impulsada por los consumidores y utilizan servicios basados en IA para impulsar la demanda de centros de datos centrados en IA.

El Mercado Global de Aceleradores para Centros de Datos está segmentado por tipo de procesador (CPU, GPU, FPGA, ASIC), aplicación (computación de alto rendimiento, inteligencia artificial) y geografía (América del Norte, Europa, Asia Pacífico, América Latina, Oriente Medio y África). El tamaño del mercado y las previsiones se proporcionan en términos de valor (USD) para todos los segmentos anteriores.

| CPU |

| GPU |

| FPGA |

| ASIC |

| Computación de Alto Rendimiento |

| Entrenamiento de Inteligencia Artificial |

| Inferencia de Inteligencia Artificial |

| Otras Cargas de Trabajo |

| En las Instalaciones / Empresarial / Borde |

| Coubicación |

| Nube Pública |

| TI y Telecomunicaciones |

| Banca, Servicios Financieros y Seguros |

| Atención Sanitaria y Ciencias de la Vida |

| Gobierno y Defensa |

| Medios y Entretenimiento |

| Otros Usuarios Finales |

| América del Norte | Estados Unidos | |

| México | ||

| Canadá | ||

| América del Sur | Brasil | |

| Resto de América del Sur | ||

| Europa | Alemania | |

| Reino Unido | ||

| Francia | ||

| Rusia | ||

| Resto de Europa | ||

| Asia-Pacífico | China | |

| Japón | ||

| India | ||

| Corea del Sur | ||

| Resto de Asia-Pacífico | ||

| Oriente Medio y África | Oriente Medio | Arabia Saudita |

| Emiratos Árabes Unidos | ||

| Turquía | ||

| África | Sudáfrica | |

| Resto de África | ||

| Por Tipo de Procesador | CPU | ||

| GPU | |||

| FPGA | |||

| ASIC | |||

| Por Aplicación | Computación de Alto Rendimiento | ||

| Entrenamiento de Inteligencia Artificial | |||

| Inferencia de Inteligencia Artificial | |||

| Otras Cargas de Trabajo | |||

| Por Modelo de Implementación | En las Instalaciones / Empresarial / Borde | ||

| Coubicación | |||

| Nube Pública | |||

| Por Industria del Usuario Final | TI y Telecomunicaciones | ||

| Banca, Servicios Financieros y Seguros | |||

| Atención Sanitaria y Ciencias de la Vida | |||

| Gobierno y Defensa | |||

| Medios y Entretenimiento | |||

| Otros Usuarios Finales | |||

| Por Geografía | América del Norte | Estados Unidos | |

| México | |||

| Canadá | |||

| América del Sur | Brasil | ||

| Resto de América del Sur | |||

| Europa | Alemania | ||

| Reino Unido | |||

| Francia | |||

| Rusia | |||

| Resto de Europa | |||

| Asia-Pacífico | China | ||

| Japón | |||

| India | |||

| Corea del Sur | |||

| Resto de Asia-Pacífico | |||

| Oriente Medio y África | Oriente Medio | Arabia Saudita | |

| Emiratos Árabes Unidos | |||

| Turquía | |||

| África | Sudáfrica | ||

| Resto de África | |||

Preguntas Clave Respondidas en el Informe

¿A qué velocidad se espera que crezca la demanda de aceleradores hasta 2032?

Se proyecta que el mercado de Aceleradores para Centros de Datos crecerá a una CAGR del 13,96%, más que duplicándose de 12.890 millones de USD en 2025 a 32.130 millones de USD en 2032.

¿Qué segmento de procesadores ganará mayor cuota para 2032?

Se prevé que los aceleradores basados en ASIC registren una CAGR del 15,42%, reduciendo la brecha con las GPU para cargas de trabajo con gran intensidad de inferencia.

¿Por qué las empresas están adoptando implementaciones híbridas y de borde?

Las cargas de trabajo de 5G, vehículos autónomos e Internet Industrial de las Cosas sensibles a la latencia requieren inferencia local, lo que impulsa una CAGR del 15,72% para las instalaciones híbridas de borde.

¿Cuál es la mayor restricción que enfrentan los proveedores de aceleradores hoy en día?

La escasez de sustratos de empaquetado avanzado como ABF y CoWoS limita la capacidad de producción a corto plazo, frenando el crecimiento de los envíos en un estimado de 2,1 puntos porcentuales.

¿Qué segmento vertical de la industria muestra el crecimiento más rápido del gasto?

La atención sanitaria y las ciencias de la vida liderarán con una CAGR del 14,62% a medida que los flujos de trabajo de genómica, descubrimiento de fármacos e imágenes diagnósticas demandan cómputo especializado.

Última actualización de la página el: