Marktgröße und Marktanteil für Rechenzentrumsbeschleuniger

Marktanalyse für Rechenzentrumsbeschleuniger von Mordor Intelligence

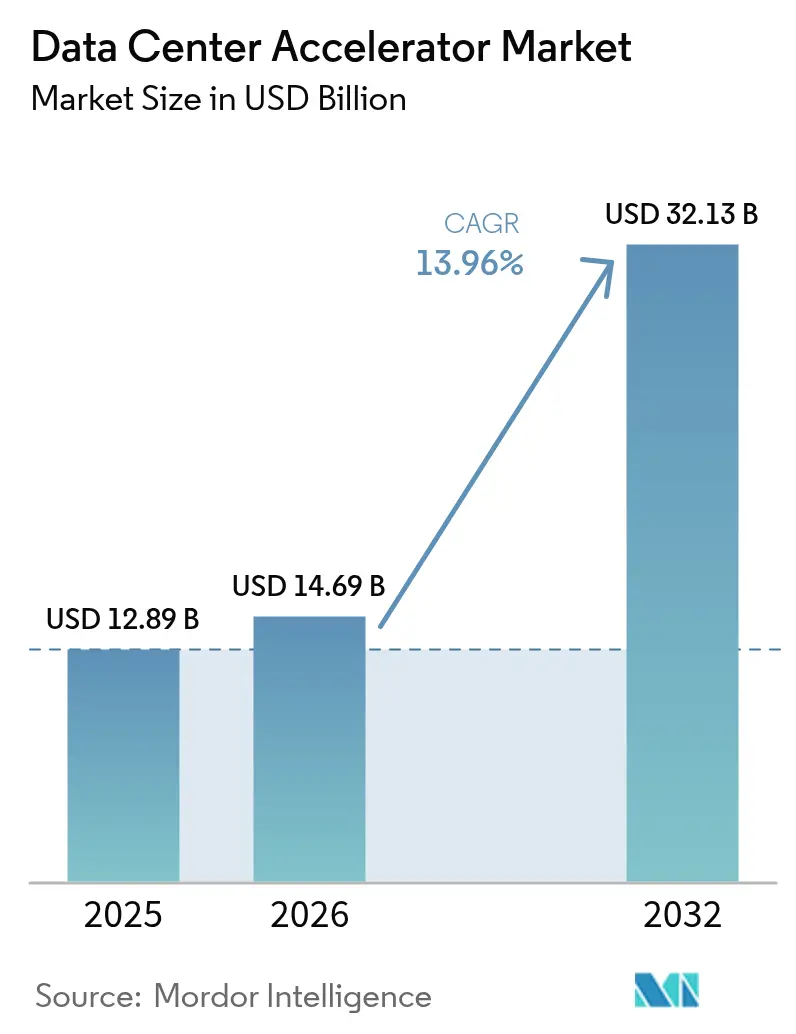

Die Marktgröße für Rechenzentrumsbeschleuniger wird im Jahr 2026 auf 14,69 Milliarden USD geschätzt und wächst gegenüber dem Wert von 12,89 Milliarden USD im Jahr 2025, wobei die Prognosen für 2032 einen Wert von 32,13 Milliarden USD ausweisen, was einem CAGR von 13,96 % im Zeitraum 2026-2032 entspricht. Zunehmende Trainingszyklen für künstliche Intelligenz, die Verbreitung von Hyperscale-Rechenzentren sowie der Wechsel zu GPU-, ASIC- und anderen zweckgebundenen Chips sind die primären Wachstumstreiber dieser Expansion. Souveräne-Cloud-Programme, Exportkontrollregime und Nachhaltigkeitsauflagen formen die regionalen Investitionsmuster neu und drängen Käufer zu im Inland beschafften Beschleunigern und einer umweltfreundlicheren Infrastruktur. Engpässe bei der Kapazität für Verpackungssubstrate und Knappheiten bei Hochbandbreitenspeichern dämpfen die kurzfristige Hardware-Verfügbarkeit und veranlassen Cloud-Anbieter, die Konfigurationen mit den höchsten Margen zu priorisieren. Gleichzeitig entwickeln sich Nachrüstungen mit Flüssigkühlung und Kaufverträge für erneuerbare Energien zu wichtigen Auswahlkriterien für Kapitalinvestitionen, was signalisiert, dass Energieeffizienz nun ein Wettbewerbsdifferenziator und kein reines Kostenzentrum mehr ist.

Wichtigste Erkenntnisse des Berichts

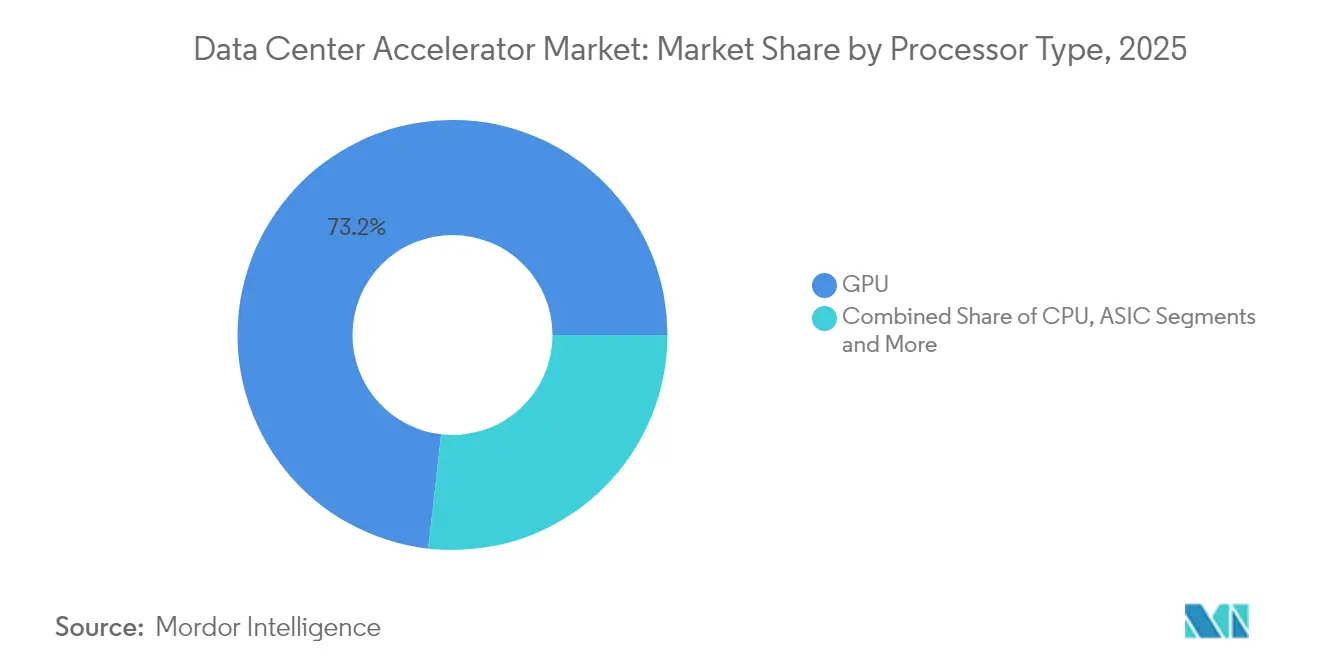

- Nach Prozessortyp führten GPUs im Jahr 2025 mit einem Umsatzanteil von 73,20 %; ASICs werden bis 2032 voraussichtlich mit einem CAGR von 15,42 % wachsen.

- Nach Anwendung entfielen im Jahr 2025 49,30 % des Marktanteils für Rechenzentrumsbeschleuniger auf das KI-Training, während KI-Inferenz bis 2032 mit einem CAGR von 15,55 % wächst.

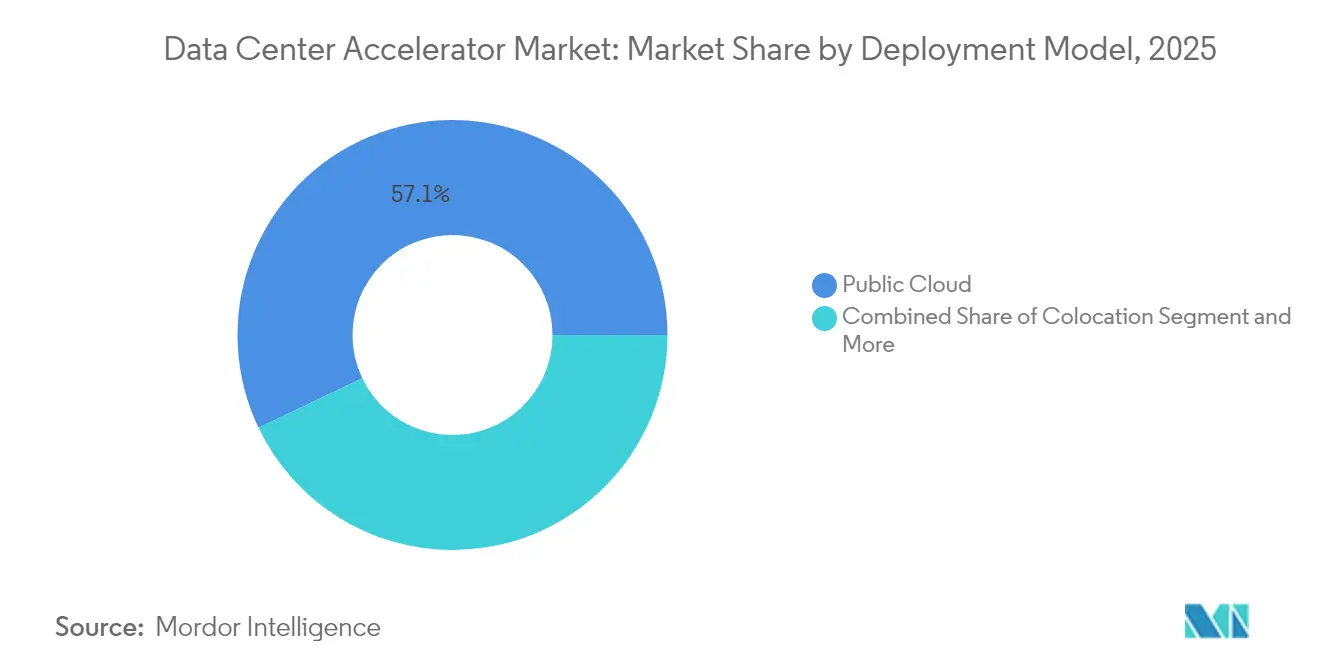

- Nach Bereitstellungsmodell entfielen im Jahr 2025 57,10 % der Marktgröße für Rechenzentrumsbeschleuniger auf die öffentliche Cloud; Hybrid- und Edge-Konfigurationen wachsen bis 2032 mit einem CAGR von 15,72 %.

- Nach Endbenutzerbranche hielt IT und Telekommunikation im Jahr 2025 einen Umsatzanteil von 39,40 %, während für das Gesundheitswesen und die Biowissenschaften bis 2032 ein CAGR von 14,62 % prognostiziert wird.

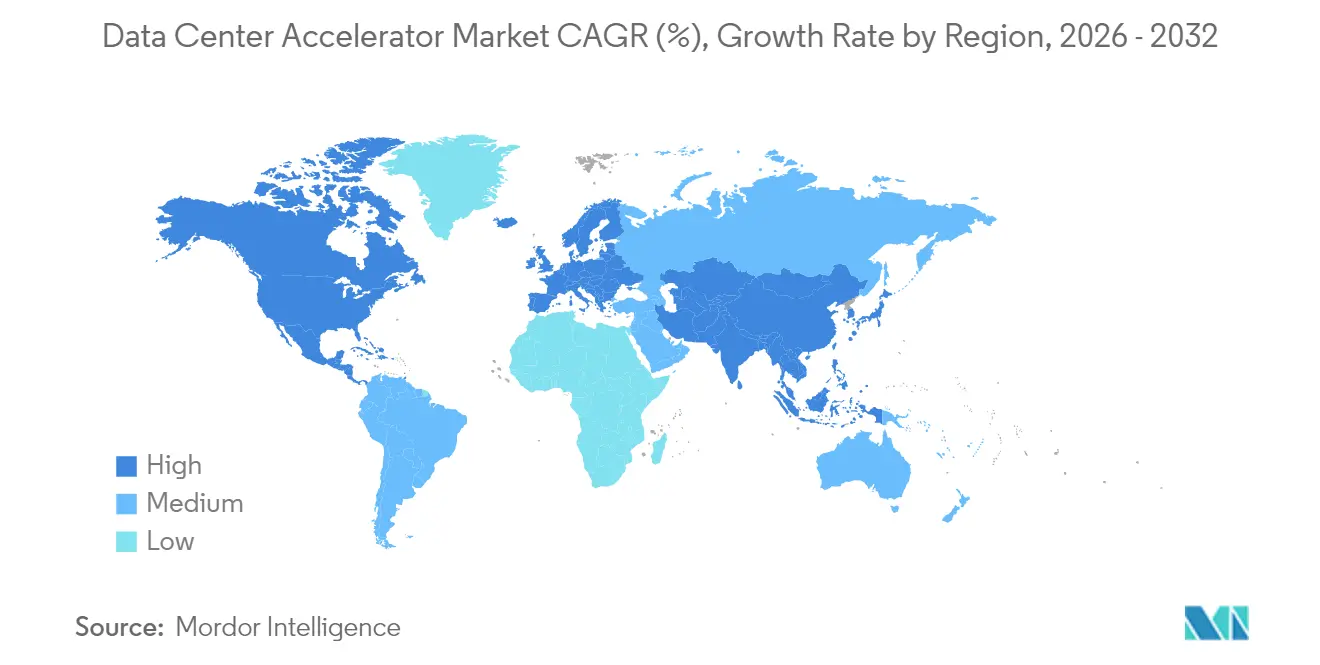

- Nach Geografie behielt Nordamerika im Jahr 2025 den größten regionalen Anteil, während der asiatisch-pazifische Raum bis 2032 den höchsten CAGR verzeichnen soll.

Hinweis: Die Marktgrößen- und Prognosezahlen in diesem Bericht werden mithilfe des proprietären Schätzrahmens von Mordor Intelligence erstellt und mit den neuesten verfügbaren Daten und Erkenntnissen bis 2026 aktualisiert.

Globale Markttrends und Einblicke für Rechenzentrumsbeschleuniger

Auswirkungsanalyse der Treiber*

| TREIBER | (~) % AUSWIRKUNG AUF DIE CAGR-PROGNOSE | GEOGRAFISCHE RELEVANZ | ZEITHORIZONT DER AUSWIRKUNG |

|---|---|---|---|

| Stark steigende KI/ML-Trainingsworkloads in Hyperscale-Rechenzentren | +4.2% | Nordamerika, asiatisch-pazifischer Raum | Mittelfristig (2-4 Jahre) |

| GPU-Knappheit treibt die Vermietung cloudbasierter Beschleuniger an | +2.8% | Nordamerika, Europa | Kurzfristig (≤ 2 Jahre) |

| Schnelle Akzeptanz von generativer KI in Software-als-Dienstleistung-Plattformen | +3.1% | Nordamerika, Europa | Mittelfristig (2-4 Jahre) |

| Quanteninspirierte Algorithmen, die heterogene Beschleuniger erfordern | +1.5% | Nordamerika, Europa, asiatisch-pazifischer Raum | Langfristig (≥ 4 Jahre) |

| Workload-Orchestrierung vom Edge zum Kern | +2.3% | Asiatisch-pazifischer Raum, Europa | Mittelfristig (2-4 Jahre) |

| Souveräne-Cloud-Programme zur Subventionierung inländischer Beschleuniger-Fertigungsanlagen | +1.8% | Asiatisch-pazifischer Raum, Naher Osten und Afrika, Europa | Langfristig (≥ 4 Jahre) |

| Quelle: Mordor Intelligence | |||

Stark steigende KI/ML-Trainingsworkloads in Hyperscale-Rechenzentren

Hyperscale-Betreiber errichten nun speziell für KI konzipierte Rechenzentrumseinheiten, die eine 10- bis 100-fach höhere Rechendichte als herkömmliche Unternehmensworkloads erfordern. Metas 800 Millionen USD teurer Universitätscampus in Indiana veranschaulicht diesen Wandel, da er flüssiggekühlte Racks zur Unterbringung von Multi-Petaflop-GPU-Clustern standardisiert. Microsoft hat für das Fiskaljahr 2025 mehr als 80 Milliarden USD für KI-Anlagen in den Vereinigten Staaten bereitgestellt, was die geografische Konzentration der Trainingsinfrastruktur unterstreicht. Amazons Expansion in mehreren Bundesstaaten im Wert von 100 Milliarden USD signalisiert weiter, dass Cloud-Hyperscaler auf Skaleneffekte setzen, jedoch muss jedes neue Megawatt interne Schwellenwerte für erneuerbare Energien erfüllen.[3]Datacenters.com-Mitarbeiter, "Amazons 100-Milliarden-Dollar-Rechenzentrumserweiterung", datacenters.com Es entsteht ein Balanceakt, da Unternehmen von Prototyp-Modellen zu Inferenz-Pipelines übergehen, was zu heterogeneren Rack-Designs führt, die GPU-, CPU- und ASIC-Knoten integrieren. Finanzinstitute sind ein Beispiel für diesen zweigleisigen Ausbau: Sie reservieren separate GPU-Cluster für die Echtzeit-Betrugserkennung und behalten gleichzeitig CPU-intensive Analyse-Farmen für regulatorisches Reporting bei.

GPU-Knappheit treibt die Vermietung cloudbasierter Beschleuniger an

Chronische Knappheiten bei Premium-GPUs haben GPU-als-Dienstleistung-Plattformen hervorgebracht, die den Hardware-Besitz von der Nutzung entkoppeln. Die Supercluster-Infrastruktur von Oracle Cloud Infrastructure unterstützt 16.384 AMD Instinct MI300X GPUs und bietet verbrauchsbasierte Webportale, die die Beschaffungsvorlaufzeiten von Monaten auf Minuten reduzieren.[1]Oracle Newsroom, "Oracle und AMD arbeiten zusammen, um Kunden zu bahnbrechender Leistung zu verhelfen", oracle.com Umgewidmete Kryptowährungs-Mining-Standorte in Nordamerika und Europa tragen leistungsstarke Immobilien bei und ermöglichen es Betreibern, brachliegende elektrische Kapazitäten zu monetarisieren. Das Mietmodell demokratisiert den Zugang für kleine und mittelgroße Organisationen, die bisher keine Kapitalausgaben für erstklassige Beschleuniger rechtfertigen konnten. Dienstleister gewinnen auch bei Verhandlungen über Lieferantenzuweisungen an Einfluss, was die Widerstandsfähigkeit gegenüber Einzel-Lieferanten-Abhängigkeiten erhöht.

Schnelle Akzeptanz von generativer KI in Software-als-Dienstleistung-Plattformen

Software-als-Dienstleistung-Anbieter integrieren generative KI direkt in Kollaborations-, Kundenservice- und Analyse-Suiten, ein Schritt, der die Inferenztransaktionen pro aktivem Nutzer deutlich erhöht. Der Großsprachmodell-Cluster von Together AI unterstreicht die Hardware-Unterschiede zwischen Inferenz und Training; Speicherbandbreite und Latenz übertreffen den Spitzen-FLOPS-Wert als Engpässe. Beispiele aus dem Gesundheitswesen, wie APIs für diagnostische Bildgebung, müssen verschlüsselte Bilder in Echtzeit verarbeiten und bevorzugen daher ASICs, die für Inferenz mit kleinen Batches optimiert sind. Im Finanzdienstleistungsbereich erfordern Echtzeit-Kreditrisikomodelle Millisekundenantworten, was die Einführung von In-Memory-Computing-Strukturen vorantreibt. Das Ergebnis ist ein nachhaltiger Markt für Beschleuniger, die auf Energieeffizienz und deterministische Latenz statt auf absoluten Durchsatz optimiert sind.

Quanteninspirierte Algorithmen, die heterogene Beschleuniger erfordern

Obwohl praktische Quantencomputer noch Jahre entfernt sind, haben quanteninspirierte klassische Algorithmen in der Kryptografie, Portfoliooptimierung und der Modellierung zur Wirkstoffforschung Einzug in Pilotanwendungen gehalten. Diese Arbeitsabläufe kombinieren CPU-Vorverarbeitung mit GPU- oder FPGA-Emulationsschichten und erfordern hybride Systemtopologien, die sich von standardmäßigen KI-Clustern unterscheiden. Staatliche Forschungsprogramme und Verteidigungsverträge treiben die frühe Finanzierung voran und signalisieren eine langfristige Nachfragekurve, die in nationalen Labors und Verteidigungsanlagen beginnt, bevor sie in kommerzielle Sektoren übergeht.[2]Verteidigungsministerium, "AI-Enabled Detection System Set to Replace Aging Airspace Awareness System", diu.mil Anbieter, die quanteninspirierte Simulations-Engines mit herkömmlichen Beschleunigern kombinieren können, werden eine verteidigungsfähige Nische einnehmen, während sich der Markt weiterentwickelt.

Auswirkungsanalyse der Hemmnisse*

| HEMMNISSE | (~) % AUSWIRKUNG AUF DIE CAGR-PROGNOSE | GEOGRAFISCHE RELEVANZ | ZEITHORIZONT DER AUSWIRKUNG |

|---|---|---|---|

| Knappes globales Angebot an fortschrittlichen Verpackungssubstraten | -2.1% | Fertigungszentren im asiatisch-pazifischen Raum | Kurzfristig (≤ 2 Jahre) |

| Steile Lernkurve für heterogene Programmiermodelle | -1.4% | Weltweit | Mittelfristig (2-4 Jahre) |

| Steigende Scope-3-Emissionsziele, die Mega-GPU-Cluster einschränken | -1.8% | Nordamerika, Europa, asiatisch-pazifischer Raum | Mittelfristig (2-4 Jahre) |

| Exportkontrollregime für hochwertige GPUs und ASICs | -1.2% | China, Russland | Langfristig (≥ 4 Jahre) |

| Quelle: Mordor Intelligence | |||

Knappes globales Angebot an fortschrittlichen Verpackungssubstraten

Beschleuniger, die HBM-Stapel und Chiplets integrieren, sind auf den Ajinomoto Build-Up Film und CoWoS-Verpackung angewiesen - Materialien, die nun Lieferzeiten von einem Jahr unterliegen. Lieferanten priorisieren Artikelnummern mit hohen Margen, sodass kleinere Anbieter um begrenzte Zuteilungen kämpfen. Experimente mit organischen Zwischenträgern sind im Gange, werden die Engpässe jedoch für mindestens zwei Produktionszyklen nicht nennenswert entschärfen. Taiwan und Südkorea haben aggressive Kapazitätserweiterungen für Substrate angekündigt, doch das Hochlaufen erstreckt sich über die aktuellen Nachfrageinfektionspunkte hinaus.

Steile Lernkurve für heterogene Programmiermodelle

Da sich die Chips diversifizieren, müssen Entwickler mehrere Toolchains übernehmen - von CUDA über ROCm bis hin zu anbieterspezifischen Softwareentwicklungskits. Fachkräftemangel erhöht die Integrationskosten und verlängert die Zeitrahmen für Machbarkeitsnachweise. Bemühungen um offene Standards wie OneAPI versuchen, Lücken zu überbrücken, aber nicht aufeinander abgestimmte Veröffentlichungszyklen über Hardware-Generationen hinweg erschweren die Wartung. Schwellenländer stehen vor den größten Hürden, da lokale Universitäten beim Angebot spezialisierter Lehrpläne hinterherhinken.

*Unsere aktualisierten Prognosen behandeln die Auswirkungen von Treibern und Hemmnissen als richtungsweisend und nicht additiv. Die überarbeiteten Wirkungsprognosen spiegeln das Basiswachstum, Mixeffekte und Wechselwirkungen zwischen Variablen wider.

Segmentanalyse

Nach Prozessortyp: ASICs entwickeln sich zu Inferenz-Champions

GPU-Prozessoren hielten im Jahr 2025 einen Anteil von 73,20 % und spiegeln ihre Vielseitigkeit sowohl für Modelltraining als auch für Inferenzaufgaben wider. ASIC-Lieferungen werden jedoch bis 2032 voraussichtlich mit einem CAGR von 15,42 % steigen, da Unternehmen auf niedrigere Energieverbräuche bei gleichmäßigen Inferenz-Workloads optimieren. Googles intern entwickelter TPU v6 ist ein Beispiel für den Trend zu unternehmenseigenem Silizium, der Leistung und Kosten in Einklang bringt. Inzwischen erweitert AMDs Instinct MI350-Familie die HBM-Kapazität auf 288 GB und zielt auf speicherbegrenzte Transformer-Modelle ab. CPU-Sockel orchestrieren weiterhin Ein-/Ausgabe- und Verwaltungsaufgaben, während FPGA-Karten in Telekommunikations-Edge-Knoten relevant bleiben, die deterministische Latenz erfordern.

Das ASIC-Wachstum veranschaulicht sich verschiebende Käuferprioritäten. Leistungsbudgets in Co-Location-Käfigen skalieren selten linear mit der Rack-Dichte, was Betreiber dazu veranlasst, TOPS-pro-Watt-Metriken zu bevorzugen. Inferenzintensive Software-als-Dienstleistung-Angebote, wie Kundensupport-Chatbots und Echtzeit-Personalisierungsmaschinen, erfordern vorhersehbare Latenz, die ASIC-Designs nun liefern. Trainingsworkloads werden sich weiterhin auf Multi-GPU-Cluster konzentrieren, doch ein Teil der Rechenzyklen wandert zu spezialisierten Tensor-Engines, die in Grafikkarten der nächsten Generation integriert sind, wodurch kategoriale Grenzen verschwimmen. Insgesamt stärkt die Prozessordiversität den Wettbewerb zwischen Anbietern und bietet Käufern Einfluss auf Preisgestaltung und Versorgungskontinuität.

Notiz: Segmentanteile aller einzelnen Segmente sind nach dem Kauf des Berichts verfügbar

Nach Anwendung: KI-Inferenz überholt das Training

Das KI-Training machte im Jahr 2025 49,30 % des Umsatzes auf dem Markt für Rechenzentrumsbeschleuniger aus, aber Inferenz-Workloads werden bis 2032 mit einem schnelleren CAGR von 15,55 % wachsen. Unternehmen, die einst mit Pilotprojekten zufrieden waren, bringen nun Chatbots, Empfehlungsmodelle und Bildanalyse-Dienste in die Produktion, wo Latenzverzögerungen direkt in Kundenabwanderung münden. Hochleistungsrechnen bleibt eine stabile Nische, die sich auf Wettermodellierung, Genomik und numerische Strömungsmechanik konzentriert und auf GPUs mit größeren HBM-Stapeln statt auf reine ASICs setzt.

Das Inferenzwachstum wirkt sich auf die Hardwareauswahl aus. Variabilität der Stapelgröße und strenge Servicevereinbarungen erfordern Beschleuniger, die Speicherbandbreite gegenüber rohem Gleitkomma-Durchsatz optimieren. Gesundheitsdienstleister setzen inferenzoptimierte Platinen ein, um diagnostische Bildgebung am Point-of-Care durchzuführen und die Zeit bis zur Diagnose bei Erkrankungen wie Schlaganfall zu verkürzen. Finanzinstitute nutzen Beschleuniger ebenfalls für Echtzeit-Risikobewertung und betten Rechenknoten in private Cloud-Umgebungen für regulatorische Compliance ein. Der wachsende Anwendungsmix wird die Kaufkriterien weiter diversifizieren, wobei die Reife des Software-Ökosystems die Kaufentscheidungen zunehmend beeinflusst.

Nach Bereitstellungsmodell: Hybride Edge-Konfigurationen treiben das Wachstum an

Öffentliche Cloud-Nutzer verbrauchten im Jahr 2025 57,10 % der Marktgröße für Rechenzentrumsbeschleuniger. Hybrid-Edge-Installationen werden jedoch mit einem CAGR von 15,72 % wachsen, da Organisationen Inferenz-Engines näher an die Datenquellen verlagern. Telekommunikationsunternehmen rüsten Vermittlungsstellen zu Mikro-Rechenzentren auf, um den Datenverkehr von autonomen Fahrzeugen und Augmented-Reality-Streams zu verarbeiten. Co-Location-Anbieter reagieren mit Flüssigkühlungs-Nachrüstungen und souveränen Cloud-Zonen, um regulierte Branchen anzulocken.

On-Premise-Optionen gewinnen wieder an Bedeutung, wo Datensouveränität oder Kostenplanungssicherheit die Vorteile von Hyperscale überwiegen. Einzelhändler betreiben beispielsweise Videoanalysen auf In-Store-Edge-Servern, um Backhaul-Latenz zu vermeiden. Entwicklungsteams übertragen Trainingsaufgaben weiterhin in die öffentliche Cloud, lagern Modelle jedoch zunehmend für die Inferenz zurück. Der daraus resultierende architektonische Pluralismus fördert die Nachfrage nach Verwaltungsplattformen, die Workloads über Clouds, Co-Location-Standorte und Kundencampusse hinweg orchestrieren.

Notiz: Segmentanteile aller einzelnen Segmente sind nach dem Kauf des Berichts verfügbar

Nach Endbenutzerbranche: Gesundheitswesen führt die Wachstumskurve an

IT- und Telekommunikationsanbieter repräsentierten im Jahr 2025 39,40 % des Umsatzes, da Netzbetreiber ihre Netzwerke für 5G-Core-Slicing und Netzwerkfunktionsvirtualisierung modernisierten. Das Gesundheitswesen und die Biowissenschaften werden jedoch mit einem CAGR von 14,62 % bis 2032 das am schnellsten wachsende Segment sein. Genomik-Pipelines sind auf Petabyte-Durchsatz angewiesen, während diagnostische Bildgebungsinstrumente KI-Inferenz am Edge erfordern, um Ärzte in Echtzeit zu unterstützen. Die synthetischen Datendienste von Gretel setzen Beschleuniger ein, um datenschutzwahrende Datensätze zu generieren und Krankenhäusern zu helfen, strenge regulatorische Rahmenbedingungen einzuhalten.

Workloads im Finanzdienstleistungsbereich konzentrieren sich auf Betrugserkennung im Nanosekunden-Bereich und Simulationen des algorithmischen Handels, was dedizierte Beschleuniger-Pools in privaten Clouds erfordert. Regierungs- und Verteidigungsnutzer, gestärkt durch KI-Beschaffungsprogramme in Höhe von mehreren hundert Millionen Dollar, bevorzugen sichere, luftabgeschottete Infrastrukturen. Studios für Medien und Unterhaltung setzen GPU-Render-Farmen ein, um die Inhaltserstellung und das Echtzeit-Streaming zu beschleunigen. Diese vielfältigen Anforderungen erhalten die Marktdynamik aufrecht und fördern die Spezialisierung unter Chip-Anbietern und Systemintegratoren.

Geografische Analyse

Nordamerika bleibt der größte Käufer, gestützt auf die Investitionspläne von Amazon, Microsoft und Google im Hyperscale-Bereich. Allein Microsofts Ausgaben übersteigen im Jahr 2025 80 Milliarden USD für inländische Anlagen. Kanada und Mexiko entwickeln sich zu Nearshore-Optionen, die Stromkosten und Latenzüberlegungen in Einklang bringen und gleichzeitig innerhalb der nordamerikanischen Regulierungsrahmen bleiben.

Der asiatisch-pazifische Raum wird den höchsten CAGR verzeichnen, gestützt durch souveräne Cloud-Mandate und den Bau enormer Campusse wie Südkoreas 35 Milliarden USD teurem Komplex. China treibt inländische Beschleuniger wie die Ascend-Serie von Huawei voran, um Exportkontrollbeschränkungen zu navigieren. Das Rapidus-Konsortium in Japan und die Chip-Initiativen von SoftBank, unterstützt durch öffentliche Mittel, zielen darauf ab, die Relevanz der Halbleiterfertigung zurückzugewinnen.

Die Programme GAIA-X und IPCEI-CIS in Europa fördern grenzüberschreitende Datensouveränitäts-Clouds. Blackstones 13 Milliarden USD schweres Engagement in britischen Rechenzentren unterstreicht das Vertrauen der Investoren in die regionale KI-Nachfrage. Das Wachstum im Nahen Osten und Afrika hängt von der Unterstützung durch Staatsfonds ab, wobei Energiepreisvorteile stromhungrige Installationen in den Vereinigten Arabischen Emiraten und Saudi-Arabien begünstigen.

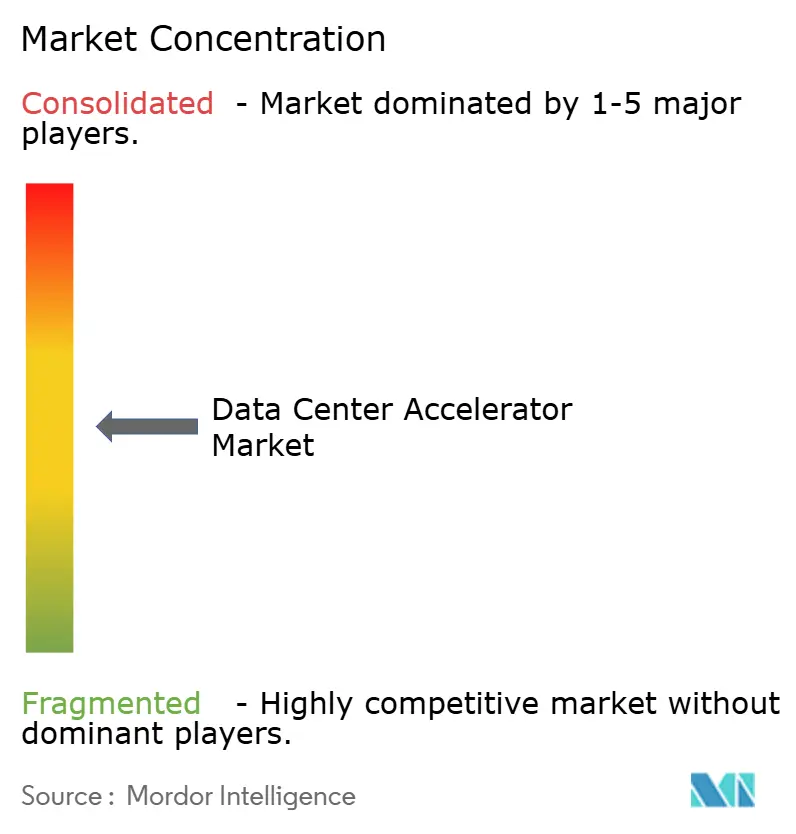

Wettbewerbslandschaft

Der Markt für Rechenzentrumsbeschleuniger weist eine moderate Konzentration auf. NVIDIA dominiert Trainingscluster, während AMD seinen GPU-Fahrplan verdichtet und den Start der MI350 auf Anfang 2025 vorzieht, um Hyperscale-Sockel zu gewinnen. Intel positioniert Gaudi-Beschleuniger für Preis-Leistungs-Nischen, während Google und Amazon eigene TPUs und Inferentia-Chips einsetzen, um die Abhängigkeit von handelsüblichem Silizium zu reduzieren.

Die architektonische Vielfalt lädt agile Neueinsteiger ein. Cerebras zielt auf Wafer-Scale-KI, Tenstorrent setzt auf RISC-V-Designs und die Hanguang-Linie von Alibaba bedient inländische chinesische Clouds. Software-Ökosysteme werden entscheidend; Anbieter bündeln Compiler, Low-Level-APIs und Modelloptimierungsdienstprogramme, um Entwickler zu binden. Das Lieferketten-Risiko gestaltet Beschaffungsstrategien um, da Kunden GPU- und ASIC-Platinen von zwei Quellen beziehen, um sich gegen Substratknappheiten abzusichern.

Strategische Deals unterstreichen das Wettrüsten. Oracle kooperiert mit AMD, um MI300X-Supercluster einzusetzen und Kunden eine Alternative zu NVIDIA zu bieten. Microsoft arbeitet mit Flüssigkühlungsspezialisten für On-Premise-Cluster in Hochdichtezonen zusammen. Patentanmeldungen im Bereich Chiplet-Verbindungen steigen rasant, da Unternehmen verteidigungsfähige geistige Eigentumsrechte anstreben, was auf einen Wechsel von monolithischen Dies zu modularen Architekturen hindeutet.

Marktführer für Rechenzentrumsbeschleuniger

-

Intel Corporation

-

NVIDIA Corporation

-

Advanced Micro Devices Inc.

-

Achronix Semiconductor Corporation

-

Xilinx Inc. (Advanced Micro Devices Inc.)

- *Haftungsausschluss: Hauptakteure in keiner bestimmten Reihenfolge sortiert

Jüngste Branchenentwicklungen

- Mai 2025: Red Hat startete die llm-d-Community für skalierbare generative KI-Inferenz, unterstützt von CoreWeave, Google Cloud, IBM Research und NVIDIA, mit Fokus auf nativer Kubernetes-Architektur und vLLM-basierter verteilter Inferenz.

- Februar 2025: AMD kündigte Instinct MI325X-Beschleuniger mit 256 GB HBM3e-Speicher und 6 TB/s Bandbreite an und versprach eine 1,4-fach höhere Inferenzleistung im Vergleich zu Wettbewerbern, was Unternehmen ermöglicht, mit weniger GPUs bessere Ergebnisse zu erzielen.

- Oktober 2024: MITRE startete die Federal AI Sandbox in Partnerschaft mit NVIDIA, ausgestattet mit einem 20 Millionen USD teuren Supercomputer, betrieben von NVIDIA DGX SuperPOD mit 248 H100-GPUs für sichere KI-Entwicklung und -Bereitstellung bei Bundesbehörden.

- Oktober 2024: AMD lieferte führende KI-Leistung mit MI325X-Beschleunigern, die eine 1,3-fach höhere theoretische Spitzenrechenleistung bieten, und begann im vierten Quartal 2024 mit Produktionslieferungen, wobei eine breite Verfügbarkeit für das erste Quartal 2025 erwartet wird.

Berichtsumfang des globalen Markts für Rechenzentrumsbeschleuniger

Rechenzentrum-Beschleuniger sind Hardware, die zur Verarbeitung visueller Daten entwickelt und eingesetzt wird. Es handelt sich um ein Hardware-Gerät oder Softwareprogramm, das die Gesamtleistung von Computern verbessert. Rechenzentrum-Beschleuniger helfen dabei, die verbrauchergetriebene Datennachfrage zu steigern und KI-basierte Dienste einzusetzen, um die Nachfrage nach KI-zentrierten Rechenzentren anzukurbeln.

Der globale Markt für Rechenzentrumsbeschleuniger ist segmentiert nach Prozessortyp (CPU, GPU, FPGA, ASIC), Anwendung (Hochleistungsrechnen, künstliche Intelligenz) und Geografie (Nordamerika, Europa, asiatisch-pazifischer Raum, Lateinamerika, Naher Osten und Afrika). Die Marktgröße und Prognosen werden für alle oben genannten Segmente in Werten (USD) angegeben.

| CPU |

| GPU |

| FPGA |

| ASIC |

| Hochleistungsrechnen |

| Training mit künstlicher Intelligenz |

| Inferenz mit künstlicher Intelligenz |

| Sonstige Workloads |

| On-Premise / Unternehmen / Edge |

| Colocation |

| Öffentliche Cloud |

| IT und Telekommunikation |

| Banken, Finanzdienstleistungen und Versicherungen |

| Gesundheitswesen und Biowissenschaften |

| Regierung und Verteidigung |

| Medien und Unterhaltung |

| Sonstige Endnutzer |

| Nordamerika | Vereinigte Staaten | |

| Mexiko | ||

| Kanada | ||

| Südamerika | Brasilien | |

| Rest von Südamerika | ||

| Europa | Deutschland | |

| Vereinigtes Königreich | ||

| Frankreich | ||

| Russland | ||

| Rest von Europa | ||

| Asien-Pazifik | China | |

| Japan | ||

| Indien | ||

| Südkorea | ||

| Rest von Asien-Pazifik | ||

| Naher Osten und Afrika | Naher Osten | Saudi-Arabien |

| Vereinigte Arabische Emirate | ||

| Türkei | ||

| Afrika | Südafrika | |

| Rest von Afrika | ||

| Nach Prozessortyp | CPU | ||

| GPU | |||

| FPGA | |||

| ASIC | |||

| Nach Anwendung | Hochleistungsrechnen | ||

| Training mit künstlicher Intelligenz | |||

| Inferenz mit künstlicher Intelligenz | |||

| Sonstige Workloads | |||

| Nach Bereitstellungsmodell | On-Premise / Unternehmen / Edge | ||

| Colocation | |||

| Öffentliche Cloud | |||

| Nach Endbenutzerbranche | IT und Telekommunikation | ||

| Banken, Finanzdienstleistungen und Versicherungen | |||

| Gesundheitswesen und Biowissenschaften | |||

| Regierung und Verteidigung | |||

| Medien und Unterhaltung | |||

| Sonstige Endnutzer | |||

| Nach Geografie | Nordamerika | Vereinigte Staaten | |

| Mexiko | |||

| Kanada | |||

| Südamerika | Brasilien | ||

| Rest von Südamerika | |||

| Europa | Deutschland | ||

| Vereinigtes Königreich | |||

| Frankreich | |||

| Russland | |||

| Rest von Europa | |||

| Asien-Pazifik | China | ||

| Japan | |||

| Indien | |||

| Südkorea | |||

| Rest von Asien-Pazifik | |||

| Naher Osten und Afrika | Naher Osten | Saudi-Arabien | |

| Vereinigte Arabische Emirate | |||

| Türkei | |||

| Afrika | Südafrika | ||

| Rest von Afrika | |||

Im Bericht beantwortete Schlüsselfragen

Wie schnell wird die Nachfrage nach Beschleunigern bis 2032 voraussichtlich wachsen?

Der Markt für Rechenzentrumsbeschleuniger wird voraussichtlich mit einem CAGR von 13,96 % wachsen und sich von 12,89 Milliarden USD im Jahr 2025 auf 32,13 Milliarden USD bis 2032 mehr als verdoppeln.

Welches Prozessorsegment wird bis 2032 den größten Marktanteil gewinnen?

ASIC-basierte Beschleuniger werden voraussichtlich einen CAGR von 15,42 % verzeichnen und den Abstand zu GPUs bei inferenzintensiven Workloads verringern.

Warum setzen Unternehmen auf hybride und Edge-Bereitstellungen?

Latenzsensitive 5G-, autonome Fahrzeug- und industrielle IoT-Workloads erfordern lokale Inferenz und treiben einen CAGR von 15,72 % für hybride Edge-Installationen an.

Was ist das größte Hemmnis für Beschleuniger-Lieferanten heute?

Engpässe bei fortschrittlichen Verpackungssubstraten wie ABF und CoWoS begrenzen die kurzfristige Produktionskapazität und dämpfen das Lieferwachstum um geschätzte 2,1 Prozentpunkte.

Welches Branchensegment verzeichnet das stärkste Ausgabenwachstum?

Das Gesundheitswesen und die Biowissenschaften werden mit einem CAGR von 14,62 % führen, da Genomik-, Wirkstoffforschungs- und diagnostische Bildgebungs-Workflows spezialisierte Rechenkapazitäten erfordern.

Seite zuletzt aktualisiert am: