Tamanho e Participação do Mercado de Aceleradores de Data Center

Análise do Mercado de Aceleradores de Data Center por Mordor Intelligence

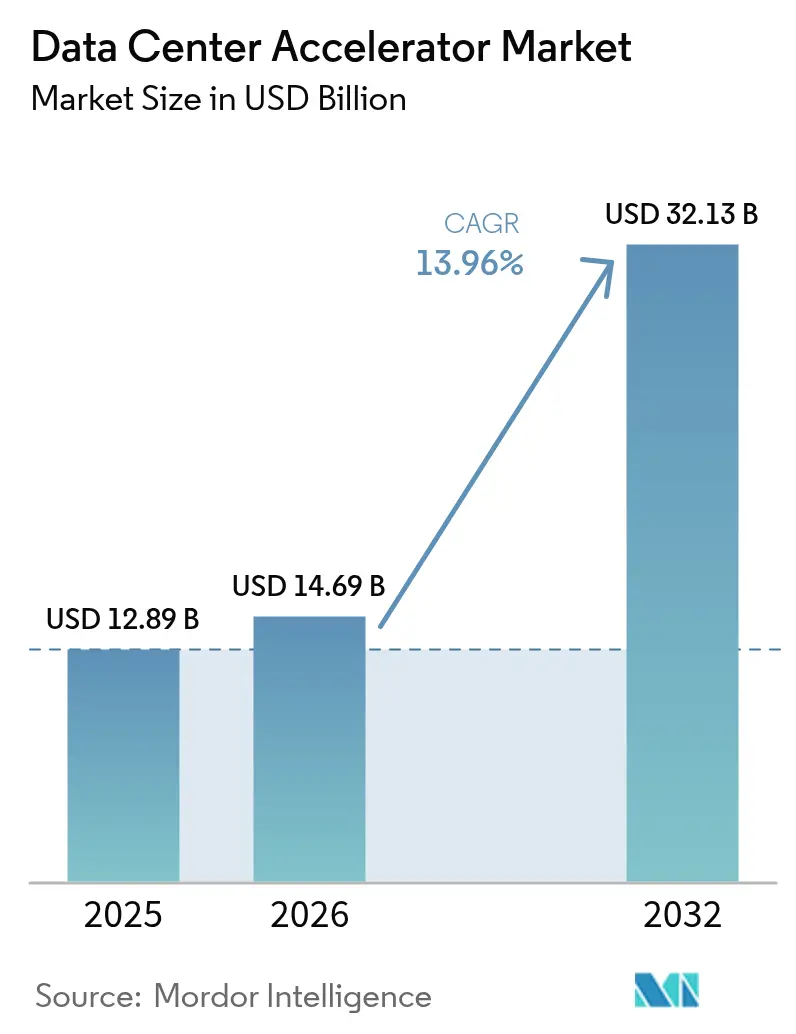

O tamanho do mercado de Aceleradores de Data Center em 2026 é estimado em USD 14,69 bilhões, crescendo a partir do valor de 2025 de USD 12,89 bilhões com projeções para 2032 mostrando USD 32,13 bilhões, crescendo a uma CAGR de 13,96% no período de 2026 a 2032. Os crescentes ciclos de treinamento de inteligência artificial, a proliferação de instalações de hiperescala e a transição em direção a GPUs, ASICs e outros chips desenvolvidos especificamente para finalidades determinadas são os principais motores desta expansão. Programas de nuvem soberana, regimes de controle de exportações e mandatos de sustentabilidade estão remodelando os padrões de investimento regionais, direcionando os compradores para aceleradores de origem doméstica e infraestrutura mais sustentável. A capacidade restrita de substratos de embalagem e a escassez de memória de alta largura de banda estão atenuando a disponibilidade de hardware no curto prazo, levando os provedores de nuvem a priorizar as configurações de maior margem. Ao mesmo tempo, retrofits de resfriamento líquido e acordos de compra de energia renovável estão emergindo como critérios de seleção críticos para projetos de capital, sinalizando que a eficiência energética é agora um diferencial competitivo e não mais um centro de custos.

Principais Conclusões do Relatório

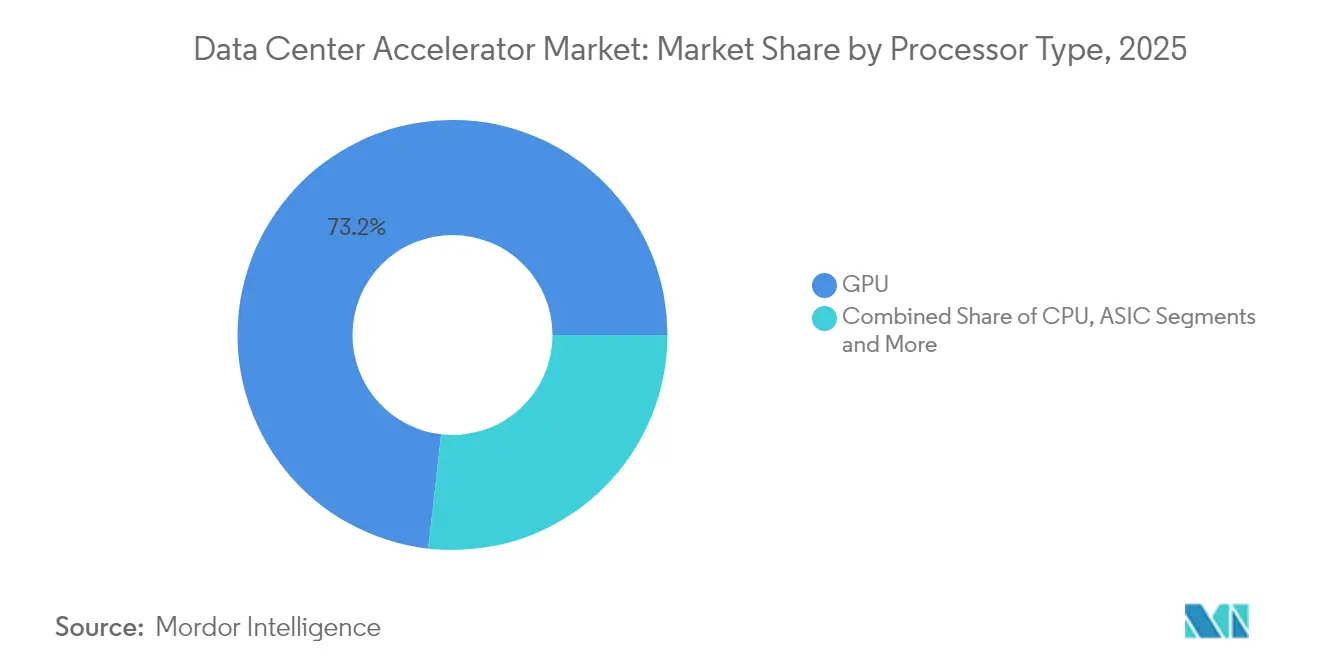

- Por tipo de processador, as GPUs lideraram com 73,20% de participação na receita em 2025; os ASICs estão projetados para se expandir a uma CAGR de 15,42% até 2032.

- Por aplicação, o treinamento de IA representou 49,30% da participação de mercado de Aceleradores de Data Center em 2025, enquanto a inferência de IA avança a uma CAGR de 15,55% até 2032.

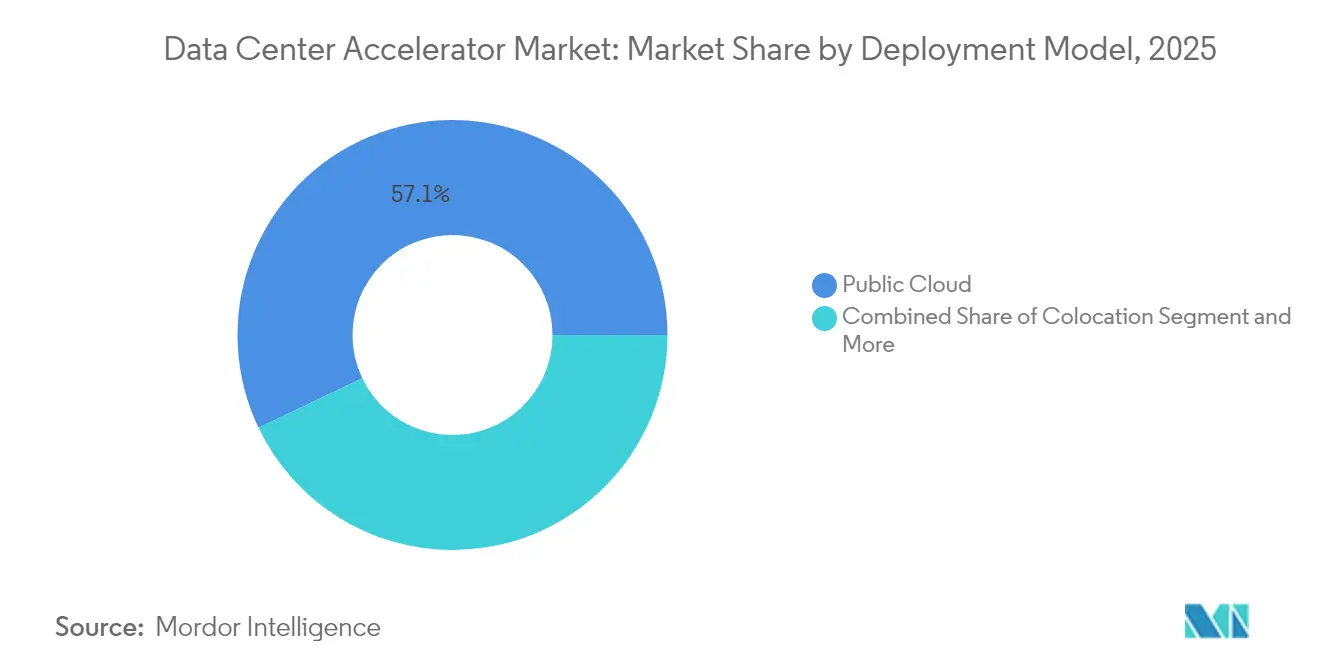

- Por modelo de implantação, a nuvem pública capturou 57,10% do tamanho do mercado de Aceleradores de Data Center em 2025; as configurações híbridas e de borda estão se expandindo a uma CAGR de 15,72% até 2032.

- Por setor do usuário final, TI e telecomunicações detinham 39,40% de participação na receita em 2025, enquanto a área de saúde e ciências da vida está prevista para crescer a uma CAGR de 14,62% até 2032.

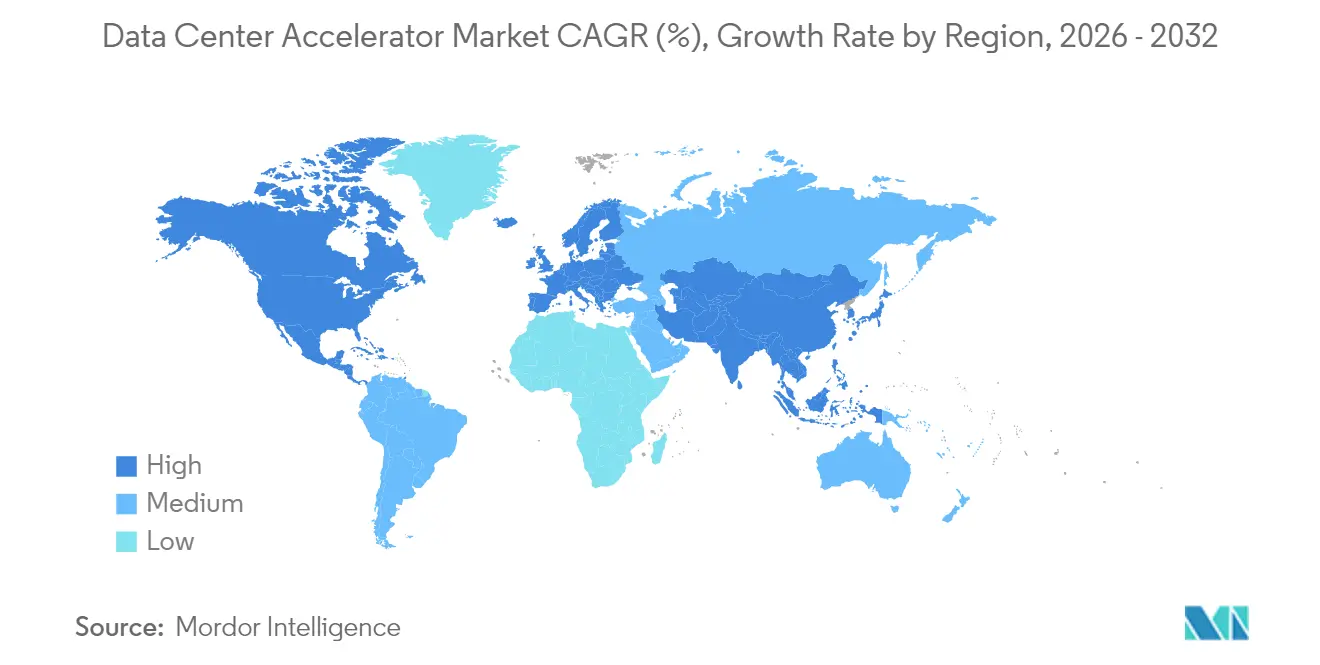

- Por geografia, a América do Norte manteve a maior participação regional em 2025, enquanto a APAC está projetada para registrar a CAGR mais alta até 2032.

Nota: Os números de tamanho de mercado e previsão neste relatório são gerados usando a estrutura de estimativa proprietária da Mordor Intelligence, atualizada com os dados e insights mais recentes disponíveis até 2026.

Tendências e Perspectivas do Mercado Global de Aceleradores de Data Center

Análise de Impacto dos Impulsionadores*

| IMPULSIONADOR | (~) % DE IMPACTO NA PREVISÃO DE CAGR | RELEVÂNCIA GEOGRÁFICA | PRAZO DE IMPACTO |

|---|---|---|---|

| Crescimento acelerado das cargas de trabalho de treinamento de IA/ML em data centers de hiperescala | +4.2% | América do Norte, APAC | Médio prazo (2-4 anos) |

| Escassez de GPUs impulsionando o aluguel de aceleradores baseados em nuvem | +2.8% | América do Norte, Europa | Curto prazo (≤ 2 anos) |

| Adoção rápida de IA generativa em plataformas de SaaS | +3.1% | América do Norte, Europa | Médio prazo (2-4 anos) |

| Algoritmos inspirados em computação quântica exigindo aceleradores heterogêneos | +1.5% | América do Norte, Europa, APAC | Longo prazo (≥ 4 anos) |

| Orquestração de cargas de trabalho da borda ao núcleo | +2.3% | APAC, Europa | Médio prazo (2-4 anos) |

| Programas de nuvem soberana subsidiando fábricas domésticas de aceleradores | +1.8% | APAC, MEA, Europa | Longo prazo (≥ 4 anos) |

| Fonte: Mordor Intelligence | |||

Crescimento Acelerado das Cargas de Trabalho de Treinamento de IA/ML em Data Centers de Hiperescala

Os operadores de hiperescala agora implantam salas de dados construídas especificamente para IA que exigem de 10 a 100 vezes mais densidade de computação do que as cargas de trabalho empresariais legadas. O campus de USD 800 milhões da Meta em Indiana exemplifica essa mudança ao padronizar racks resfriados a líquido para acomodar clusters de GPU com múltiplos petaflops. A Microsoft reservou mais de USD 80 bilhões para instalações de IA nos Estados Unidos no ano fiscal de 2025, ressaltando a concentração geográfica da infraestrutura de treinamento. A expansão multiestadual de USD 100 bilhões da Amazon sinaliza ainda mais que os hiperescaladores de nuvem estão buscando economias de escala, mas cada novo megawatt deve atender aos limites internos de energia renovável.[3]Equipe do Datacenters.com, "Expansão do data center de US$ 100 bilhões da Amazon", datacenters.com Um equilíbrio está surgindo à medida que as empresas migram de modelos de protótipo para pipelines de inferência, resultando em designs de rack mais heterogêneos que integram nós de GPU, CPU e ASIC. As instituições financeiras exemplificam essa construção em duas vias, alocando clusters de GPU dedicados para detecção de fraudes em tempo real enquanto mantêm fazendas de análise intensivas em CPU para relatórios regulatórios.

Escassez de GPUs Impulsionando o Aluguel de Aceleradores Baseados em Nuvem

As escassez crônicas de GPUs premium deram origem a plataformas de GPU como Serviço que dissociam a propriedade do hardware do uso. O supercluster da Oracle Cloud Infrastructure suporta 16.384 GPUs AMD Instinct MI300X e oferece portais da web baseados em consumo, reduzindo os prazos de aquisição de meses para minutos.[1]Oracle Newsroom, "Oracle e AMD colaboram para ajudar os clientes a oferecer um desempenho revolucionário", oracle.com Sites de mineração de criptomoedas reconvertidos na América do Norte e na Europa contribuem com imóveis de alta densidade de energia, permitindo que os operadores monetizem a capacidade elétrica ociosa. O modelo de aluguel democratiza o acesso para organizações pequenas e médias que anteriormente não podiam justificar o investimento de capital em aceleradores de alto nível. Os provedores de serviços também ganham alavancagem ao negociar alocações de fornecedores, aumentando a resiliência contra restrições de fornecedor único.

Adoção Rápida de IA Generativa em Plataformas de Software como Serviço

Os fornecedores de Software como Serviço estão integrando IA generativa diretamente em suítes de colaboração, atendimento ao cliente e análise, uma iniciativa que aumenta acentuadamente as transações de inferência por usuário ativo. O cluster de modelos de linguagem de grande escala da Together AI ressalta as diferenças de hardware entre inferência e treinamento; a largura de banda de memória e a latência superam os FLOPS de pico como gargalos. Exemplos de Software como Serviço na área da saúde, como APIs de imagens de diagnóstico, devem processar imagens criptografadas em tempo real, favorecendo assim os ASICs ajustados para inferência em lotes pequenos. Nos serviços financeiros, os modelos de risco de crédito em tempo real exigem respostas em milissegundos, impulsionando a adoção de malhas de computação em memória. O resultado é um mercado sustentado de aceleradores otimizados para eficiência energética e latência determinística, em vez de throughput absoluto.

Algoritmos Inspirados em Computação Quântica Exigindo Aceleradores Heterogêneos

Embora os computadores quânticos práticos ainda estejam a anos de distância, os algoritmos clássicos inspirados em computação quântica já entraram em uso piloto em criptografia, otimização de portfólio e modelagem de descoberta de fármacos. Esses fluxos de trabalho combinam pré-processamento de CPU com camadas de emulação de GPU ou FPGA e exigem topologias de sistema híbrido, ao contrário dos clusters de IA padrão. Programas de pesquisa governamentais e contratos de defesa estão impulsionando o financiamento inicial, sinalizando uma curva de demanda de longa cauda que começa em laboratórios nacionais e instalações de defesa antes de se filtrar para os setores comerciais.[2]Departamento de Defesa, "AI-Enabled Detection System Set to Replace Aging Airspace Awareness System", diu.mil Os fornecedores capazes de combinar mecanismos de simulação quântica com aceleradores convencionais ocuparão um nicho defensável à medida que o mercado evolui.

Análise de Impacto das Restrições*

| RESTRIÇÕES | (~) % DE IMPACTO NA PREVISÃO DE CAGR | RELEVÂNCIA GEOGRÁFICA | PRAZO DE IMPACTO |

|---|---|---|---|

| Oferta global restrita de substratos de embalagem avançados | -2.1% | Centros de fabricação da APAC | Curto prazo (≤ 2 anos) |

| Acentuada curva de aprendizagem para modelos de programação heterogêneos | -1.4% | Global | Médio prazo (2-4 anos) |

| Crescentes metas de emissão de Escopo 3 restringindo mega-clusters de GPU | -1.8% | América do Norte, Europa, APAC | Médio prazo (2-4 anos) |

| Regimes de controle de exportações sobre GPUs e ASICs de alto desempenho | -1.2% | China, Rússia | Longo prazo (≥ 4 anos) |

| Fonte: Mordor Intelligence | |||

Oferta Global Restrita de Substratos de Embalagem Avançados

Os aceleradores que integram pilhas de HBM e chiplets dependem do Filme de Construção em Camadas da Ajinomoto e da embalagem CoWoS, materiais agora sujeitos a prazos de entrega de até um ano. Os fornecedores priorizam os SKUs de maior margem, deixando os fornecedores menores a disputar alocações limitadas. A experimentação com interposers orgânicos está em curso, mas não aliviará significativamente as restrições por pelo menos dois ciclos de produção. Taiwan e Coreia do Sul anunciaram expansões agressivas de capacidade de substratos, mas o período de aumento está além dos pontos de inflexão da demanda atual.

Acentuada Curva de Aprendizagem para Modelos de Programação Heterogêneos

À medida que os chips se diversificam, os desenvolvedores precisam adotar múltiplas cadeias de ferramentas, desde CUDA até ROCm e SDKs específicos de fornecedores. A escassez de mão de obra especializada aumenta os custos de integração e prolonga os cronogramas de prova de conceito. Esforços de padrões abertos como o OneAPI tentam preencher as lacunas, mas os ciclos de lançamento incompatíveis entre as gerações de hardware complicam a manutenção. Os mercados emergentes enfrentam os maiores obstáculos porque as universidades locais estão atrasadas nas ofertas de currículo especializado.

*Nossas previsões atualizadas tratam os impactos de impulsionadores e restrições como direcionais, não aditivos. As previsões de impacto revisadas refletem o crescimento base, os efeitos de mix e as interações entre variáveis.

Análise de Segmentos

Por Tipo de Processador: ASICs Emergem como Campeões de Inferência

Os processadores GPU mantiveram uma participação de 73,20% em 2025, refletindo sua versatilidade tanto nas tarefas de treinamento de modelos quanto de inferência. No entanto, as remessas de ASICs estão projetadas para crescer a uma CAGR de 15,42% até 2032, à medida que as empresas otimizam para menor consumo de energia durante cargas de trabalho de inferência em estado estacionário. A TPU v6 desenvolvida internamente pelo Google exemplifica a tendência de silício interno que equilibra desempenho e custo. Enquanto isso, a família Instinct MI350 da AMD expande a capacidade de HBM para 288 GB, visando modelos transformadores limitados pela memória. Os soquetes de CPU ainda orquestram tarefas de E/S e administração, enquanto as placas FPGA mantêm relevância nos nós de borda de telecomunicações que exigem latência determinística.

O crescimento dos ASICs ilustra as prioridades em mudança dos compradores. Os orçamentos de energia dentro das gaiolas de colocalização raramente escalam linearmente com a densidade do rack, levando os operadores a favorecer as métricas de TOPS por watt. As ofertas de Software como Serviço com inferência intensa, como chatbots de suporte ao cliente e mecanismos de personalização em tempo real, exigem latência previsível que os designs de ASIC agora oferecem. As cargas de trabalho de treinamento ainda se concentrarão em clusters com múltiplas GPUs, mas uma parte dos ciclos de computação migra para mecanismos de tensor especializados integrados às GPUs de próxima geração, tornando as fronteiras categoriais mais tênues. No geral, a diversidade de processadores fortalece a competição entre fornecedores, oferecendo aos compradores alavancagem em preços e continuidade de fornecimento.

Nota: As participações de segmentos de todos os segmentos individuais estão disponíveis mediante a compra do relatório

Por Aplicação: A Inferência de IA Acelera Além do Treinamento

O treinamento de IA representou 49,30% da receita do mercado de Aceleradores de Data Center em 2025, mas as cargas de trabalho de inferência registrarão uma CAGR mais rápida de 15,55% até 2032. Empresas que antes se contentavam com projetos piloto agora estão lançando chatbots, modelos de recomendação e serviços de análise de imagens em produção, onde a deterioração da latência se traduz diretamente em perda de clientes. A computação de alto desempenho permanece um nicho estável centrado em modelagem meteorológica, genômica e dinâmica de fluidos computacional, dependendo de GPUs com pilhas de HBM maiores em vez de ASICs puros.

O crescimento da inferência repercute na seleção de hardware. A variabilidade do tamanho do lote e os rígidos acordos de nível de serviço exigem aceleradores que otimizem a largura de banda de memória em detrimento do throughput bruto de ponto flutuante. Os provedores de saúde empregam placas otimizadas para inferência para realizar imagens de diagnóstico no ponto de atendimento, reduzindo o tempo de diagnóstico para condições como acidente vascular cerebral. As instituições financeiras também aproveitam os aceleradores para pontuação de risco em tempo real, incorporando nós de computação em ambientes de nuvem privada para conformidade regulatória. A crescente combinação de aplicações continuará a diversificar os critérios de compra, com a maturidade do ecossistema de software cada vez mais influenciando as decisões de compra.

Por Modelo de Implantação: Configurações de Borda Híbrida Impulsionam o Crescimento

Os locatários de nuvem pública consumiram 57,10% do tamanho do mercado de Aceleradores de Data Center em 2025. Mas as instalações de borda híbrida se expandirão a uma CAGR de 15,72% à medida que as organizações colocalizam mecanismos de inferência mais próximos das fontes de dados. As operadoras de telecomunicações atualizam os escritórios centrais para microdata centers para processar o tráfego de veículos autônomos e fluxos de realidade aumentada. Os provedores de colocalização respondem com retrofits de resfriamento líquido e zonas de nuvem soberana para atrair setores regulamentados.

As opções on-premise recuperam espaço onde a soberania de dados ou a previsibilidade de custos superam a conveniência da hiperescala. Os varejistas, por exemplo, executam análises de vídeo em servidores de borda nas lojas para evitar a latência de backhaul. As equipes de desenvolvimento ainda transferem trabalhos de treinamento para a nuvem pública, mas cada vez mais repatriam modelos para inferência. O pluralismo arquitetural resultante alimenta a demanda por plataformas de gerenciamento que orquestram cargas de trabalho em nuvens, sites de colocalização e campi de clientes.

Nota: As participações de segmentos de todos os segmentos individuais estão disponíveis mediante a compra do relatório

Por Setor do Usuário Final: A Área de Saúde Lidera a Trajetória de Crescimento

Os operadores de TI e telecomunicações representaram 39,40% da receita de 2025 à medida que as operadoras modernizaram as redes para fatiamento do núcleo 5G e virtualização de funções de rede. A saúde e as ciências da vida, no entanto, serão o segmento vertical de crescimento mais rápido, com uma CAGR de 14,62% até 2032. Os pipelines de genômica dependem de throughput em escala de petabytes, enquanto os instrumentos de imagens de diagnóstico exigem inferência de IA na borda para orientar os médicos em tempo real. Os serviços de dados sintéticos da Gretel empregam aceleradores para gerar conjuntos de dados que preservam a privacidade, ajudando os hospitais a cumprirem regulamentações rigorosas.

As cargas de trabalho de serviços financeiros concentram-se na detecção de fraudes em nível de nanossegundos e em simulações de negociação algorítmica, exigindo pools de aceleradores dedicados dentro de nuvens privadas. Os usuários governamentais e de defesa, apoiados por programas de aquisição de IA de centenas de milhões de dólares, favorecem infraestruturas seguras e isoladas fisicamente. Os estúdios de mídia e entretenimento adotam fazendas de renderização de GPU para acelerar a criação de conteúdo e o streaming em tempo real. Esses requisitos diversos sustentam o impulso do mercado e promovem a especialização entre fornecedores de chips e integradores de sistemas.

Análise Geográfica

A América do Norte permanece o maior comprador, sustentada pelos planos de despesas de capital de hiperescala da Amazon, Microsoft e Google. Os gastos da Microsoft por si só superam USD 80 bilhões para instalações domésticas em 2025. O Canadá e o México emergem como opções próximas que equilibram considerações de custo de energia e latência enquanto permanecem dentro dos marcos regulatórios norte-americanos.

A APAC registrará a maior CAGR, impulsionada por mandatos de nuvem soberana e pela construção de enormes campi como o complexo de USD 35 bilhões da Coreia do Sul. A China avança com aceleradores domésticos como a série Ascend da Huawei para contornar as limitações de controle de exportações. O consórcio Rapidus do Japão e as iniciativas de chips do SoftBank, auxiliadas por financiamento público, visam recuperar a relevância na fabricação de semicondutores.

Os programas GAIA-X e IPCEI-CIS da Europa promovem nuvens de soberania de dados transfronteiriças. O compromisso da Blackstone de USD 13 bilhões em data centers no Reino Unido ressalta a confiança dos investidores na demanda regional por IA. O crescimento no Oriente Médio e África depende do apoio dos fundos de riqueza soberana, com as vantagens dos preços de energia sustentando as instalações com alto consumo de energia nos Emirados Árabes Unidos e na Arábia Saudita.

Cenário Competitivo

O mercado de Aceleradores de Data Center apresenta concentração moderada. A NVIDIA domina os clusters de treinamento, mas a AMD comprime seu roteiro de GPU, antecipando o lançamento da MI350 para o início de 2025 para conquistar soquetes de hiperescala. A Intel posiciona os aceleradores Gaudi para nichos de desempenho por preço, enquanto o Google e a Amazon oferecem TPUs e chips Inferentia proprietários para reduzir a dependência de silício comercial.

A diversidade arquitetural convida à entrada de novos competidores ágeis. A Cerebras visa a IA em escala de wafer, a Tenstorrent impulsiona designs RISC-V, e a linha Hanguang da Alibaba serve às nuvens chinesas domésticas. Os ecossistemas de software se tornam decisivos; os fornecedores empacotam compiladores, APIs de baixo nível e utilitários de otimização de modelos para fidelizar os desenvolvedores. O risco da cadeia de suprimentos remodela as estratégias de fornecimento, à medida que os clientes buscam fontes duplas de placas de GPU e ASIC para se proteger contra escassez de substratos.

Acordos estratégicos ressaltam a corrida armamentista. A Oracle faz parceria com a AMD para implantar superclusters MI300X, oferecendo aos clientes uma alternativa à NVIDIA. A Microsoft colabora com especialistas em resfriamento líquido para clusters on-premise em zonas de alta densidade. Os depósitos de patentes em interconexões de chiplets aumentam à medida que as empresas buscam posições de propriedade intelectual defensáveis, evidenciando uma transição de dies monolíticos para arquiteturas modulares.

Líderes do Setor de Aceleradores de Data Center

-

Intel Corporation

-

NVIDIA Corporation

-

Advanced Micro Devices Inc.

-

Achronix Semiconductor Corporation

-

Xilinx Inc. (Advanced Micro Devices Inc.)

- *Isenção de responsabilidade: Principais participantes classificados em nenhuma ordem específica

Desenvolvimentos Recentes do Setor

- Maio de 2025: A Red Hat lançou a comunidade llm-d para inferência de IA generativa escalável, com o apoio da CoreWeave, Google Cloud, IBM Research e NVIDIA, com foco na arquitetura nativa do Kubernetes e nas capacidades de inferência distribuída baseadas em vLLM.

- Fevereiro de 2025: A AMD anunciou os aceleradores Instinct MI325X com 256 GB de memória HBM3e e largura de banda de 6 TB/s, prometendo desempenho de inferência 1,4 vezes superior em comparação com os concorrentes e permitindo que as empresas obtenham melhores resultados com menos GPUs.

- Outubro de 2024: A MITRE lançou o Sandbox Federal de IA em parceria com a NVIDIA, apresentando um supercomputador de USD 20 milhões alimentado pelo NVIDIA DGX SuperPOD com 248 GPUs H100 para desenvolvimento e implantação seguros de IA por agências federais.

- Outubro de 2024: A AMD entregou desempenho de IA de liderança com aceleradores MI325X apresentando desempenho de computação teórico de pico 1,3 vezes maior, entrando em produção em massa no quarto trimestre de 2024, com disponibilidade ampla esperada no primeiro trimestre de 2025

Escopo do Relatório Global do Mercado de Aceleradores de Data Center

Os aceleradores de data center são hardware projetado e utilizado para processar dados visuais. É um dispositivo de hardware ou programa de software que melhora o desempenho geral dos computadores. Os aceleradores de data center ajudam a aumentar a demanda de dados impulsionada pelo consumidor e usam serviços baseados em IA para impulsionar a demanda por data centers centrados em IA.

O Mercado Global de Aceleradores de Data Center é segmentado por tipo de processador (CPU, GPU, FPGA, ASIC), aplicação (computação de alto desempenho, inteligência artificial) e geografia (América do Norte, Europa, Ásia-Pacífico, América Latina, Oriente Médio e África). O tamanho do mercado e as previsões são fornecidos em termos de valor (USD) para todos os segmentos acima.

| CPU |

| GPU |

| FPGA |

| ASIC |

| Computação de Alto Desempenho |

| Treinamento de Inteligência Artificial |

| Inferência de Inteligência Artificial |

| Outras Cargas de Trabalho |

| On-Premise / Empresarial / Borda |

| Colocalização |

| Nuvem Pública |

| TI e Telecomunicações |

| BFSI |

| Saúde e Ciências da Vida |

| Governo e Defesa |

| Mídia e Entretenimento |

| Outros Usuários Finais |

| América do Norte | Estados Unidos | |

| México | ||

| Canadá | ||

| América do Sul | Brasil | |

| Restante da América do Sul | ||

| Europa | Alemanha | |

| Reino Unido | ||

| França | ||

| Rússia | ||

| Restante da Europa | ||

| Ásia-Pacífico | China | |

| Japão | ||

| Índia | ||

| Coreia do Sul | ||

| Restante da Ásia-Pacífico | ||

| Oriente Médio e África | Oriente Médio | Arábia Saudita |

| Emirados Árabes Unidos | ||

| Turquia | ||

| África | África do Sul | |

| Restante da África | ||

| Por Tipo de Processador | CPU | ||

| GPU | |||

| FPGA | |||

| ASIC | |||

| Por Aplicação | Computação de Alto Desempenho | ||

| Treinamento de Inteligência Artificial | |||

| Inferência de Inteligência Artificial | |||

| Outras Cargas de Trabalho | |||

| Por Modelo de Implantação | On-Premise / Empresarial / Borda | ||

| Colocalização | |||

| Nuvem Pública | |||

| Por Setor do Usuário Final | TI e Telecomunicações | ||

| BFSI | |||

| Saúde e Ciências da Vida | |||

| Governo e Defesa | |||

| Mídia e Entretenimento | |||

| Outros Usuários Finais | |||

| Por Geografia | América do Norte | Estados Unidos | |

| México | |||

| Canadá | |||

| América do Sul | Brasil | ||

| Restante da América do Sul | |||

| Europa | Alemanha | ||

| Reino Unido | |||

| França | |||

| Rússia | |||

| Restante da Europa | |||

| Ásia-Pacífico | China | ||

| Japão | |||

| Índia | |||

| Coreia do Sul | |||

| Restante da Ásia-Pacífico | |||

| Oriente Médio e África | Oriente Médio | Arábia Saudita | |

| Emirados Árabes Unidos | |||

| Turquia | |||

| África | África do Sul | ||

| Restante da África | |||

Principais Perguntas Respondidas no Relatório

Qual a velocidade esperada de crescimento da demanda por aceleradores até 2032?

O mercado de Aceleradores de Data Center está projetado para crescer a uma CAGR de 13,96%, mais que dobrando de USD 12,89 bilhões em 2025 para USD 32,13 bilhões até 2032.

Qual segmento de processador ganhará mais participação até 2032?

Os aceleradores baseados em ASIC estão previstos para registrar uma CAGR de 15,42%, reduzindo a diferença em relação às GPUs para cargas de trabalho intensas em inferência.

Por que as empresas estão adotando implantações híbridas e de borda?

As cargas de trabalho sensíveis à latência de 5G, veículos autônomos e Internet das Coisas Industrial exigem inferência local, impulsionando uma CAGR de 15,72% para instalações de borda híbrida.

Qual é a maior restrição que os fornecedores de aceleradores enfrentam hoje?

A escassez de substratos de embalagem avançados, como ABF e CoWoS, limita a capacidade de produção no curto prazo, reduzindo o crescimento das remessas em uma estimativa de 2,1 pontos percentuais.

Qual segmento vertical da indústria apresenta o crescimento mais rápido dos gastos?

A saúde e as ciências da vida liderarão com uma CAGR de 14,62%, à medida que os fluxos de trabalho de genômica, descoberta de fármacos e imagens de diagnóstico demandam computação especializada.

Página atualizada pela última vez em: