Taille et part du marché des unités de traitement graphique (GPU)

Analyse du marché des unités de traitement graphique (GPU) par Mordor Intelligence

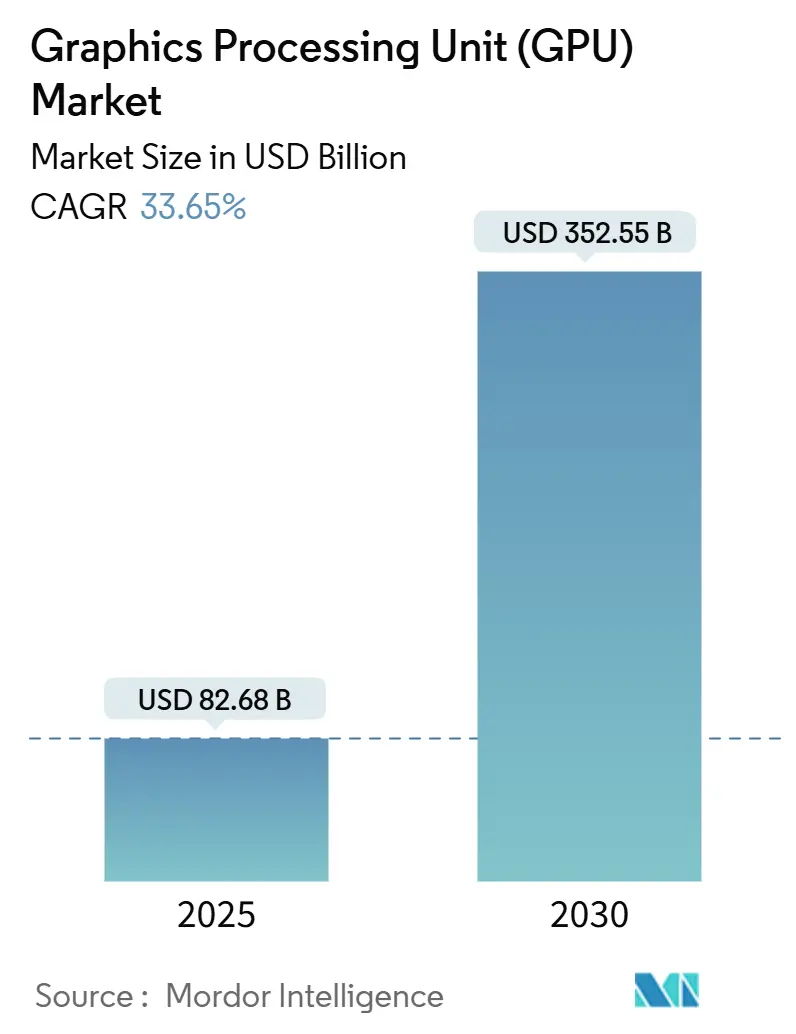

La taille du marché des unités de traitement graphique s'élève à 82,68 milliards USD en 2025 et devrait atteindre 352,55 milliards USD d'ici 2030, délivrant un TCAC de 33,65 %. Cette hausse reflète un pivot industriel des charges de travail graphiques uniquement vers le calcul centré sur l'IA, où les GPU fonctionnent comme les chevaux de bataille derrière la formation d'IA générative, l'inférence hyperscale, le jeu en nuage et les systèmes edge hétérogènes. Les initiatives d'IA souveraine accélérées, l'investissement corporate dans les modèles spécifiques aux domaines, et la maturation rapide du gaming 8K avec ray-tracing continuent d'approfondir la demande pour les dispositifs haute bande passante. La capacité serrée des nœuds avancés, couplée à la complexité des contrôles à l'exportation, canalise les commandes vers des stratégies d'approvisionnement multi-fonderies. Pendant ce temps, les conceptions basées sur chiplets et les jeux d'instructions ouverts introduisent de nouveaux vecteurs compétitifs sans déloger la concentration actuelle du secteur.

Points clés du rapport

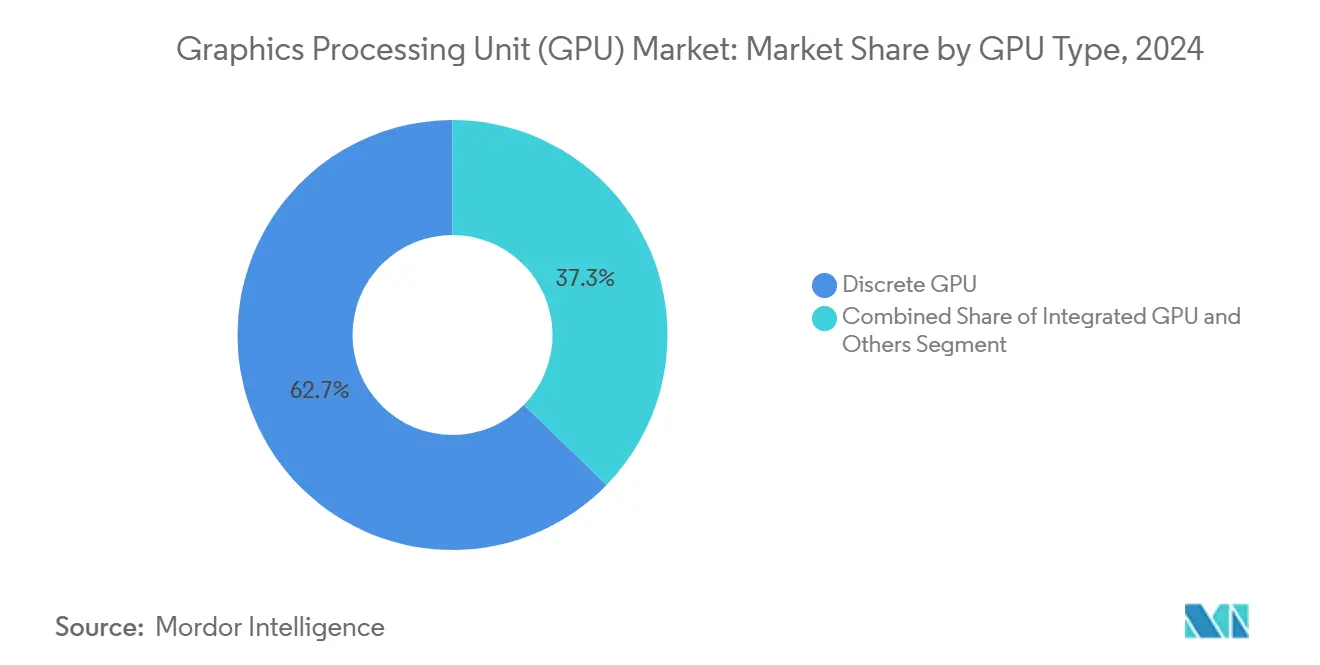

- Par type de GPU, les cartes discrètes détenaient 62,7 % de la part du marché des unités de traitement graphique en 2024 et croissent avec un TCAC de 32,7 % jusqu'en 2030.

- Par application d'appareil, les PC et stations de travail détenaient 31,4 % de la part de marché en 2024, tandis que les serveurs et accélérateurs de centres de données ont enregistré le TCAC le plus rapide de 37,6 %.

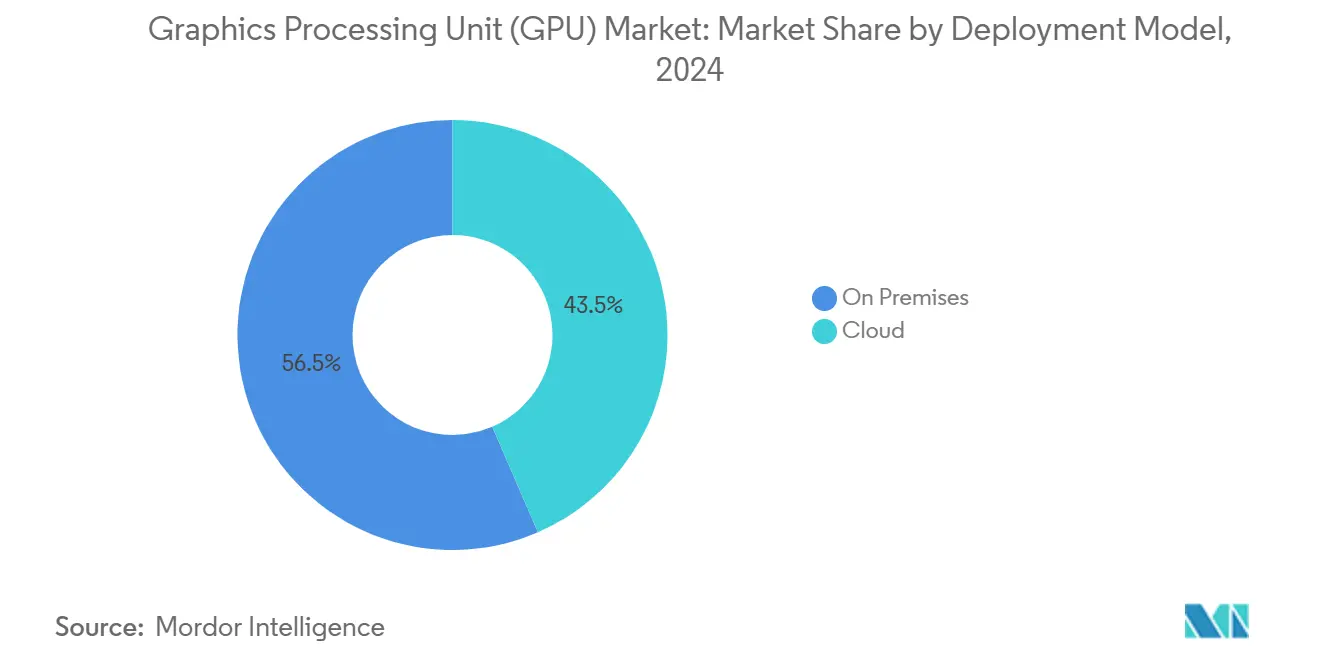

- Par modèle de déploiement, les solutions sur site représentaient 56,5 % de la part de la taille du marché des unités de traitement graphique en 2024, pourtant les charges de travail cloud s'étendent avec un TCAC de 35,3 %.

- Par architecture de jeu d'instructions, x86-64 représentait 54,3 % de la part de la taille du marché des unités de traitement graphique en 2024, pourtant RISC-V et OpenGPU s'étendent avec un TCAC de 34,8 %.

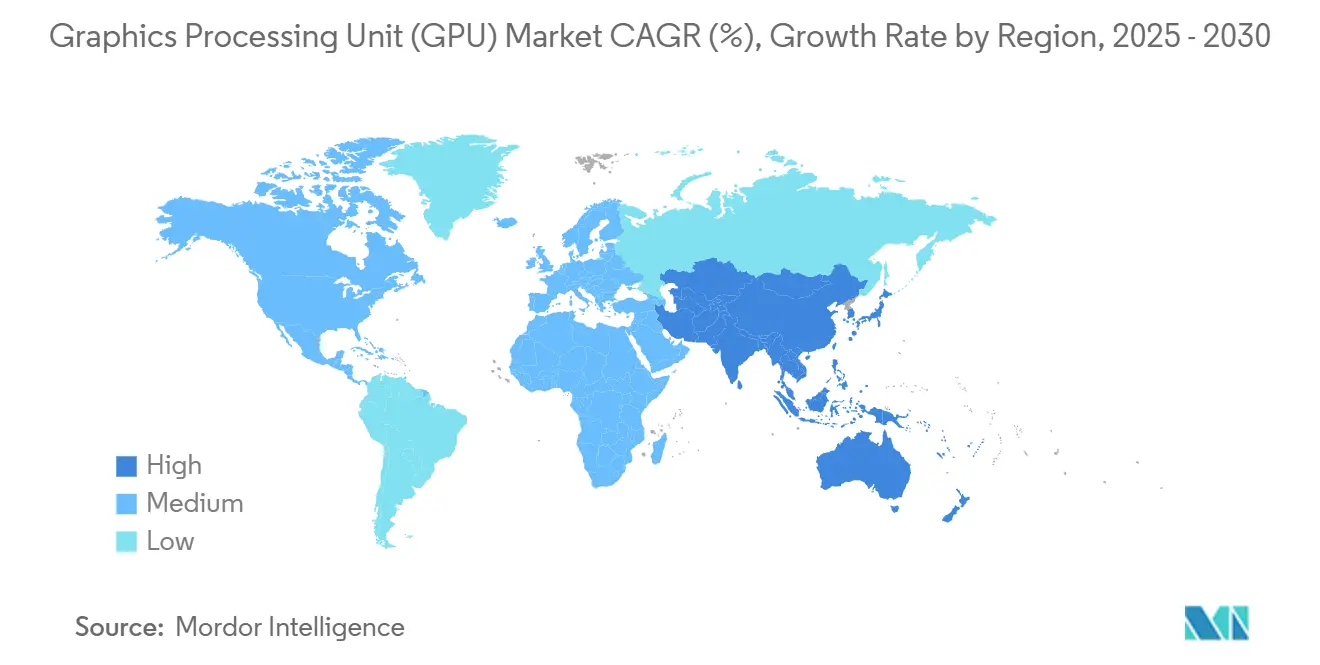

- Par géographie, l'Asie-Pacifique avance avec un TCAC de 37,4 %, dépassant la part de revenus actuelle de 43,7 % de l'Amérique du Nord.

Tendances et aperçus du marché mondial des unités de traitement graphique (GPU)

Analyse de l'impact des moteurs

| Moteur | (~) % Impact sur les prévisions TCAC | Pertinence géographique | Chronologie d'impact |

|---|---|---|---|

| Réalisme graphique en évolution dans le gaming AAA | + 4.2% | Mondial, avec concentration en Amérique du Nord et Europe | Moyen terme (2-4 ans) |

| Demande de calcul hétérogène AR/VR et dirigée par l'IA | + 6.8% | Cœur Amérique du Nord et Asie-Pacifique, débordement vers l'Europe | Long terme (≥ 4 ans) |

| Déploiements de services de gaming cloud | + 3.5% | Mondial, adoption précoce en Amérique du Nord et Europe | Court terme (≤ 2 ans) |

| Intensité GPU de formation de modèles d'IA générative | + 12.4% | Mondial, concentré en Amérique du Nord et Asie-Pacifique | Court terme (≤ 2 ans) |

| Construction de centres de données ' IA souveraine ' | + 8.9% | Cœur Asie-Pacifique, expansion Europe, Moyen-Orient | Moyen terme (2-4 ans) |

| SKU GPU personnalisés basés sur chiplets | + 2.7% | Mondial, mené par les centres technologiques d'Amérique du Nord | Long terme (≥ 4 ans) |

| Source: Mordor Intelligence | |||

Intensité GPU de formation de modèles d'IA générative

Les modèles transformateurs à grands paramètres dépassent régulièrement 100 milliards de paramètres, forçant les entreprises à exploiter des dizaines de milliers de GPU en parallèle pendant des cycles de formation de plusieurs mois, élevant le débit tensoriel au-dessus des métriques graphiques traditionnelles.[1]NVIDIA Corporation, ' NVIDIA Announces Financial Results for First Quarter Fiscal 2026 ', nvidia.com La mémoire haute bande passante, les interconnexions sans perte et les racks de refroidissement liquide sont devenus des critères d'achat standard. Les entreprises de santé, finance et manufacturing reflètent maintenant les hyperscalers en provisionnant des super-clusters dédiés pour les modèles de domaine, un modèle qui élargit la base d'utilisateurs finaux du marché des unités de traitement graphique. Les architectures mixture-of-experts amplifient la demande, car les flux de travail orchestrent des pools de GPU hétérogènes pour gérer les fragments spécifiques au contexte. Les contraintes de densité de puissance à l'intérieur des salles de données héritées accélèrent davantage la migration vers des pods IA construits à cet effet.

Construction de centres de données ' IA souveraine '

Les gouvernements considèrent le calcul IA domestique comme un actif stratégique semblable à l'énergie ou à l'infrastructure télécom. Le Canada a alloué 2 milliards USD pour une stratégie nationale de calcul IA axée sur les superordinateurs alimentés par GPU.[2]Innovation, Sciences et Développement économique Canada, ' Stratégie canadienne de calcul IA souverain ', ised-isde.canada.caLa Mission IndiaAI de l'Inde prévoit plus de 10 000 GPU pour les modèles de langues indigènes. La Corée du Sud stocke des volumes similaires pour sécuriser la parité de recherche. Ces projets convertissent les budgets publics en calendriers d'achats pluriannuels, stabilisant la demande de base à travers le marché des unités de traitement graphique. La formation de modèles spécifiques aux régions - allant de l'automatisation industrielle dans l'UE à l'analyse énergétique dans le Golfe - étend les exigences architecturales au-delà des SKU de centres de données vers les accélérateurs edge renforcés.

Demande de calcul hétérogène AR/VR et dirigée par l'IA

Les casques modernes montés sur la tête doivent rendre des lentilles 4K doubles à plus de 90 FPS tout en exécutant l'inférence de vision par ordinateur pour le suivi des mains et la cartographie spatiale. Les GPU intègrent donc des cœurs tensoriels dédiés pour décharger les tâches IA sans perturber la livraison de trames nvidia.com. Les simulations d'entreprise, l'holographie médicale et l'ingénierie de jumeaux numériques demandent davantage des cartes de classe station de travail. Les systèmes avancés d'assistance au conducteur automobile apportent le même mélange de charges de travail hétérogènes dans des facteurs de forme edge sans ventilateur, maintenant la latence temps réel sous les seuils de sécurité. Alors que l'IA compose les charges graphiques, les feuilles de route architecturales priorisent maintenant les hiérarchies de cache partagées et l'IO chiplet pour co-optimiser le rendu et l'apprentissage.

Déploiements de services de gaming cloud

Les plateformes de jeux en streaming s'appuient sur des GPU de qualité serveur équipés d'encodeurs vidéo matériels et de mise à l'échelle alimentée par l'IA pour maintenir des visuels réactifs sur une bande passante contrainte. Chaque utilisateur actif consomme des ordres de grandeur plus de calcul que les logiciels cloud basés sur texte, multipliant la demande du marché des unités de traitement graphique par rack de centre de données. L'expansion de l'empreinte mondiale oblige les fournisseurs de services à déployer des nœuds edge régionaux, tirant des commandes supplémentaires pour des traîneaux GPU compacts et haute densité. Alors que les cibles 8K et 120 FPS se profilent, les budgets silicium de nouvelle génération allouent proportionnellement une plus grande surface de puce aux moteurs média et à la logique tensorielle pour compresser efficacement les trames.

Analyse de l'impact des contraintes

| Contrainte | (~) % Impact sur les prévisions TCAC | Pertinence géographique | Chronologie d'impact |

|---|---|---|---|

| Capex initial élevé et coûts de nomenclature | -3.8% | Mondial, affectant particulièrement les marchés émergents | Court terme (≤ 2 ans) |

| Contraintes chroniques d'approvisionnement en nœuds avancés | -5.2% | Mondial, impact concentré sur les produits de pointe | Moyen terme (2-4 ans) |

| Limites de contrôle à l'exportation sur les ventes de GPU ≤7 nm | -4.6% | Axé sur la Chine, effets secondaires sur l'approvisionnement mondial | Court terme (≤ 2 ans) |

| Limites de refroidissement / densité de puissance dans les DC hyperscale | -2.9% | Mondial, aigu dans les déploiements IA haute densité | Moyen terme (2-4 ans) |

| Source: Mordor Intelligence | |||

Limites de contrôle à l'exportation sur les ventes de GPU ≤ 7 nm

Les États-Unis ont introduit une licence échelonnée pour les CI de calcul avancés, freinant effectivement les expéditions de GPU de pointe vers la Chine.[3]Olga Torres et Derrick Kyle, ' Artificial Intelligence Export Controls ', trade.govNVIDIA a comptabilisé une charge de 4,5 milliards USD liée aux accélérateurs H20 restreints, illustrant la sensibilité des revenus aux changements de licence. Les entreprises chinoises ont répondu en accélérant les projets GPU domestiques, diluant potentiellement la demande future pour la propriété intellectuelle américaine. La chaîne d'approvisionnement bifurquée force les vendeurs à maintenir plusieurs variantes de silicium, augmentant les coûts opérationnels et compliquant la planification d'inventaire à travers le marché des unités de traitement graphique.

Contraintes chroniques d'approvisionnement en nœuds avancés

La capacité de plaquettes de pointe reste hautement concentrée, avec des délais de livraison dépassant 18 mois pour les créneaux d'emballage 2-nm et CoWoS. La disponibilité limitée de substrats contraint l'intégration de mémoire haute bande passante, plafonnant la production de cartes centrées sur l'IA. Bien que des lignes supplémentaires chez Samsung et Intel Foundry soient en construction, la parité de performance et la stabilité des rendements traînent encore derrière le leader du marché, retardant le soulagement efficace. Les OEM priorisent donc l'allocation aux SKU de formation, affamant périodiquement les canaux grand public et élevant les prix de vente moyens.

Analyse des segments

Par type de GPU : les solutions discrètes pilotent l'accélération IA

Les cartes discrètes contrôlaient 62,7 % de la part du marché des unités de traitement graphique en 2024, se traduisant par la plus grande tranche de la taille du marché des unités de traitement graphique pour cette année. La demande se concentre sur la mémoire haute bande passante, les cœurs tensoriels dédiés et les interconnexions évolutives adaptées aux clusters IA. Les entreprises favorisent la modularité, permettant des mises à niveau de racks par phases sans échanges de cartes mères. Le gaming continue de valider les variantes haut de gamme en adoptant le ray tracing et les actifs 8K que les GPU intégrés ne peuvent soutenir.

L'adoption de chiplets réduit le coût par niveau de performance et améliore les rendements en assemblant de plus petites puces. La disposition multi-chiplet d'AMD et NVIDIA NVLink Fusion étendent tous deux la pertinence discrète dans les conceptions de serveurs semi-personnalisés. Pendant ce temps, les GPU intégrés restent indispensables pour les mobiles et les ordinateurs de bureau d'entrée où les budgets thermiques dominent. L'industrie des unités de traitement graphique se segmente donc le long d'un spectre mobilité-versus-débit plutôt qu'un axe de coût pur.

Note: Parts de segments de tous les segments individuels disponibles lors de l'achat du rapport

Par application d'appareil : les centres de données accélèrent l'infrastructure IA

Les serveurs et accélérateurs de centres de données devraient enregistrer le TCAC le plus rapide de 37,6 % jusqu'en 2030, soutenant le marché des unités de traitement graphique en pleine expansion. Les opérateurs hyperscale provisionnent des usines IA entières contenant des dizaines de milliers de cartes interconnectées via des tissus NVLink optiques ou PCIe 6.0. Les contrats d'approvisionnement soutenus des fournisseurs cloud, des consortiums de recherche publique et des pipelines pharmaceutiques ancrent conjointement la demande sur des horizons pluriannuels.

Les systèmes de gaming restent la plus grande catégorie de base installée, mais leur courbe de croissance est modeste comparée au cloud et à l'IA d'entreprise. L'automobile, la robotique industrielle et l'imagerie médicale représentent des verticales plus petites mais à forte marge grâce aux exigences de sécurité fonctionnelle et de support de longue durée de vie. Collectivement, ces cohortes edge diversifient les revenus de l'industrie des unités de traitement graphique loin des cycles grand public cycliques.

Par modèle de déploiement : l'adoption du cloud transforme l'infrastructure

Les installations sur site ont conservé une part de 56,5 % de la taille du marché des unités de traitement graphique en 2024, soutenues par les mandats de souveraineté des données en finance et santé. Néanmoins, les services cloud se composent à 35,3 % de TCAC alors que les entreprises passent des capex aux opex pour les charges de travail IA. L'accès par abonnement aux flottes GPU élastiques supprime le décalage de provisionnement inhérent à l'approvisionnement physique et aide les petites équipes entrant dans l'expérimentation d'IA générative.

Les constructions de cloud souverain hybride mélangent les centres de données nationaux avec l'élasticité commerciale. L'épine dorsale de supercomputing public du Canada permet aux universités d'éclater dans l'excès de capacité, s'alignant avec les cycles budgétaires tout en gardant les jeux de données sensibles dans le pays. Les déploiements edge, incluant les nœuds de gaming cloud et les passerelles d'usines intelligentes, poussent les GPU plus près des utilisateurs finaux pour satisfaire les exigences de latence sous 20 ms, élargissant davantage la diversité de déploiement à l'intérieur du marché des unités de traitement graphique.

Par architecture de jeu d'instructions : les standards ouverts défient la dominance propriétaire

Les systèmes x86-64 commandaient encore 54,3 % de part de revenus en 2024. Pourtant RISC-V et autres architectures ouvertes sont sur la voie d'un TCAC de 34,8 %, reflétant l'appétit pour la personnalisation libre de redevances. Les projets académiques tels que Vortex de Georgia Tech démontrent des GPU RISC-V capables d'OpenCL, abaissant les barrières pour les programmes de puces souveraines. Les GPU ARM, pendant ce temps, dominent les smartphones, servant l'IA edge contrainte par batterie.

Les ISA ouverts permettent aux gouvernements et startups de coder en dur les extensions de domaine - parole, vision, chiffrement - sans négocier les licences propriétaires. Cette optionalité est particulièrement attractive pour les nations opérant sous l'incertitude de contrôle à l'exportation. Pour les titulaires, la montée des architectures ouvertes injecte de nouveaux modèles de collaboration, où les piles propriétaires CUDA ou ROCm doivent de plus en plus interopérer avec les chaînes d'outils externes pour garder leur part dans le marché des unités de traitement graphique.

Analyse géographique

L'Amérique du Nord a capturé 43,7 % de la part du marché des unités de traitement graphique en 2024, ancrée par la conception de puces de Silicon Valley, les campus cloud hyperscale et les pipelines de financement venture profonds. La région bénéficie d'une intégration serrée entre les propriétaires d'IP de semi-conducteurs et les start-ups de logiciels IA, accélérant le temps-vers-volume pour les cartes de nouvelle génération. Les régimes de contrôle à l'exportation introduisent des frais généraux de conformité mais canalisent simultanément les subventions domestiques dans les lignes de fabrication et d'emballage de nœuds avancés.

L'Asie-Pacifique est le territoire à croissance la plus rapide, attendu pour afficher un TCAC de 37,4 % à 2030. La Chine accélère les programmes GPU indigènes sous les mandats de souveraineté technologique, tandis que la Mission IndiaAI de l'Inde finance les installations GPU nationales et les modèles linguistiques à l'échelle des États. Le hub de calcul d'État de 10 000 GPU de la Corée du Sud et les initiatives de réponse aux catastrophes IA du Japon étendent la demande régionale au-delà des clouds commerciaux dans le supercomputing du secteur public.

L'Europe équilibre la gouvernance IA stricte avec les objectifs de modernisation industrielle. L'Allemagne s'associe avec NVIDIA pour construire un cloud IA industriel ciblant les jumeaux numériques automobiles et de machinerie. La France, l'Italie et le Royaume-Uni priorisent les LLM multilingues et l'analyse de risque fintech, incitant les clusters GPU localisés logés dans des centres de données refroidis par quartier à haute efficacité. Le Moyen-Orient, mené par l'Arabie Saoudite et les EAU, investit massivement dans les usines IA pour diversifier les économies, élargissant davantage l'empreinte du marché des unités de traitement graphique à travers les géographies émergentes.

Paysage concurrentiel

Les partenariats stratégiques définissent les manœuvres récentes. NVIDIA et Alphabet ont élargi la collaboration pour co-optimiser les modèles agentiques, plaçant les clusters GB300 NVL72 à l'intérieur des régions Google Cloud. AMD et HUMAIN ont signé un accord de 10 milliards USD pour établir 500 MW de calcul IA sur une empreinte multi-pays, garantissant le volume pour les accélérateurs Instinct. À la périphérie, Hyundai Motor Group a adopté NVIDIA DRIVE pour raccourcir les chronologies de véhicules autonomes, illustrant les tendances d'intégration verticale.

Les feuilles de route prêtes pour chiplets remodèlent l'économie concurrentielle, permettant aux vendeurs de mélanger les puces graphiques limitées par réticule avec les tuiles IO personnalisées. Cette modularité invite les petits entrants fabless à licencier des tuiles individuelles plutôt qu'à construire des GPU monolithiques, poussant l'industrie des unités de traitement graphique vers la concurrence d'écosystème. Les efforts RISC-V open-source diluent davantage les contraintes propriétaires et pourraient créer l'équivalent futur d'un GPU ' boîte blanche ', spécialement dans les laboratoires gouvernementaux et académiques.

La granularité de contrôle à l'exportation est devenue un outil concurrentiel : les entreprises capables de fournir des substituts conformes sub-7 nm peuvent combler la demande restreinte en Chine, tout en maintenant aussi les segments premium dans les marchés non restreints. Finalement, les alliances d'emballage avancées - couvrant CoWoS, Foveros et InFO - illustrent comment la capture de valeur dérive vers l'innovation de substrat, pas seulement l'IP silicium, renforçant les interdépendances larges de fournisseurs à l'intérieur du marché des unités de traitement graphique.

Leaders de l'industrie des unités de traitement graphique (GPU)

Intel Corporation

Nvidia Corporation

Samsung Electronics Co. Ltd

Arm Ltd.

Advanced Micro Devices Inc.

- *Avis de non-responsabilité : les principaux acteurs sont triés sans ordre particulier

Développements industriels récents

- Juin 2025 : NVIDIA et Alphabet ont approfondi la coopération sur l'IA agentique et physique ; Google Cloud a adopté les GPU GB300 NVL72 et RTX PRO 6000 Blackwell pour les charges de travail de découverte de médicaments et robotique.

- Juin 2025 : NVIDIA et Deutsche Telekom ont lancé le premier cloud IA industriel d'Europe en Allemagne, provisionnant 10 000 GPU Blackwell pour l'IA manufacturière.

- Mai 2025 : AMD et HUMAIN ont dévoilé un programme de 10 milliards USD pour déployer 500 MW de capacité de calcul IA à travers les États-Unis et l'Arabie Saoudite.

- Mai 2025 : NVIDIA a introduit NVLink Fusion, permettant des systèmes IA semi-personnalisés qui combinent les GPU NVIDIA avec les CPU partenaires.

- Mai 2025 : Hyundai Motor Group a signé avec NVIDIA pour co-développer des plateformes de calcul accélérées pour la mobilité future

Portée du rapport mondial sur le marché des unités de traitement graphique (GPU)

Une unité de traitement graphique (GPU) est un circuit électronique conçu pour manipuler et altérer rapidement la mémoire afin d'accélérer la création d'images dans un tampon de trame destiné à la sortie vers un dispositif d'affichage. Les GPU sont utilisés dans les appareils mobiles, ordinateurs personnels, stations de travail, centres de données edge, automobile et consoles de gaming.

Le marché des unités de traitement graphique (GPU) est segmenté par type (GPU discrets, GPU intégrés et GPU hybrides), applications (appareils mobiles, PC et stations de travail, serveurs/centres de données, véhicules automobiles/autonomes, consoles de gaming et autres applications) et géographie (Amérique du Nord, Europe, Asie-Pacifique, Australie et Nouvelle-Zélande, Amérique latine, et Moyen-Orient et Afrique). Les tailles de marché et prévisions sont fournies en termes de valeur (USD) pour tous les segments ci-dessus.

| GPU discret |

| GPU intégré |

| Autres |

| Appareils mobiles et tablettes |

| PC et stations de travail |

| Serveurs et accélérateurs de centres de données |

| Consoles de gaming et portables |

| Automobile / ADAS |

| Autres dispositifs intégrés et edge |

| Sur site |

| Cloud |

| x86-64 |

| Arm |

| RISC-V et OpenGPU |

| Autres (Power, MIPS) |

| Amérique du Nord | États-Unis | |

| Canada | ||

| Mexique | ||

| Amérique du Sud | Brésil | |

| Argentine | ||

| Reste de l'Amérique du Sud | ||

| Europe | Allemagne | |

| Royaume-Uni | ||

| France | ||

| Italie | ||

| Reste de l'Europe | ||

| Asie-Pacifique | Chine | |

| Japon | ||

| Inde | ||

| Corée du Sud | ||

| Asie du Sud-Est | ||

| Reste de l'Asie-Pacifique | ||

| Moyen-Orient et Afrique | Moyen-Orient | Arabie Saoudite |

| Émirats Arabes Unis | ||

| Turquie | ||

| Reste du Moyen-Orient | ||

| Afrique | Afrique du Sud | |

| Égypte | ||

| Nigeria | ||

| Reste de l'Afrique | ||

| Par type de GPU | GPU discret | ||

| GPU intégré | |||

| Autres | |||

| Par application d'appareil | Appareils mobiles et tablettes | ||

| PC et stations de travail | |||

| Serveurs et accélérateurs de centres de données | |||

| Consoles de gaming et portables | |||

| Automobile / ADAS | |||

| Autres dispositifs intégrés et edge | |||

| Par modèle de déploiement | Sur site | ||

| Cloud | |||

| Par architecture de jeu d'instructions | x86-64 | ||

| Arm | |||

| RISC-V et OpenGPU | |||

| Autres (Power, MIPS) | |||

| Par géographie | Amérique du Nord | États-Unis | |

| Canada | |||

| Mexique | |||

| Amérique du Sud | Brésil | ||

| Argentine | |||

| Reste de l'Amérique du Sud | |||

| Europe | Allemagne | ||

| Royaume-Uni | |||

| France | |||

| Italie | |||

| Reste de l'Europe | |||

| Asie-Pacifique | Chine | ||

| Japon | |||

| Inde | |||

| Corée du Sud | |||

| Asie du Sud-Est | |||

| Reste de l'Asie-Pacifique | |||

| Moyen-Orient et Afrique | Moyen-Orient | Arabie Saoudite | |

| Émirats Arabes Unis | |||

| Turquie | |||

| Reste du Moyen-Orient | |||

| Afrique | Afrique du Sud | ||

| Égypte | |||

| Nigeria | |||

| Reste de l'Afrique | |||

Questions clés répondues dans le rapport

Quelle est la taille actuelle du marché des unités de traitement graphique ?

La taille du marché des unités de traitement graphique est de 82,68 milliards USD en 2025 et devrait atteindre 352,55 milliards USD d'ici 2030.

Quel segment de GPU connaît l'expansion la plus rapide ?

Les serveurs et accélérateurs de centres de données mènent avec un TCAC de 37,6 % en raison de la demande de formation d'IA générative.

Pourquoi les gouvernements investissent-ils dans les centres de données IA souverains ?

Les nations recherchent l'indépendance technologique et la souveraineté des données, incitant des approvisionnements GPU de plusieurs milliards de dollars pour les superordinateurs domestiques.

Quel rôle jouent les chiplets dans la conception GPU future ?

Les architectures chiplet améliorent le rendement et permettent aux fabricants de mélanger-et-assortir les tuiles de calcul, réduisant les coûts et accélérant les cycles de rafraîchissement de produits.

Dernière mise à jour de la page le: