Tamanho e Participação do Mercado de Data Center Otimizado por Inteligência Artificial (IA) na Ásia Pacífico

Análise do Mercado de Data Center Otimizado por Inteligência Artificial (IA) na Ásia Pacífico pela Mordor Intelligence

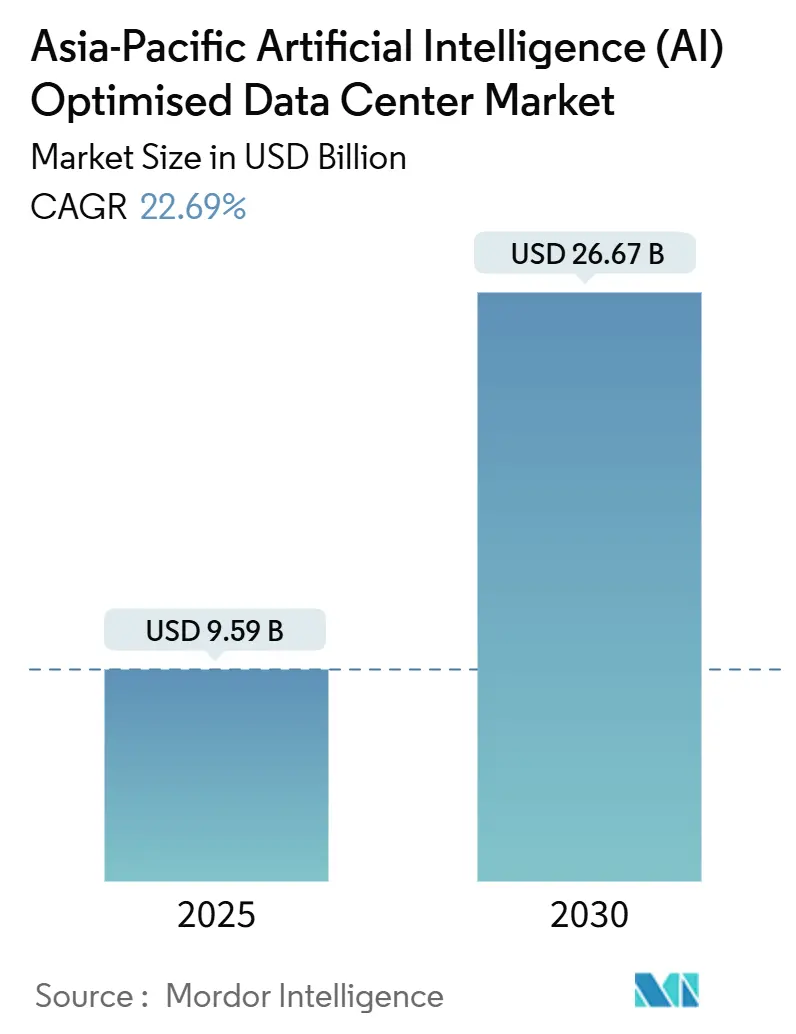

O mercado de data center de inteligência artificial na Ásia Pacífico está avaliado em USD 9,59 bilhões em 2025 e, com um CAGR de 22,69%, tem previsão de atingir USD 26,67 bilhões até 2030, sublinhando a mais forte expansão de cinco anos já observada nos gastos com infraestrutura digital regional. Os operadores de nuvem em hiperescala continuam a ancorar a demanda, mas a legislação de IA soberana, a incerteza com controles de exportação e o salto na densidade térmica vinculado às cargas de trabalho de IA generativa estão redefinindo a localização dos sites, as escolhas de resfriamento e as estratégias de aquisição de energia. Nos próximos cinco anos, as adaptações de resfriamento líquido deverão superar as novas instalações resfriadas a ar, enquanto os prazos de pré-locação em colocation se alongam à medida que bancos e agências do setor público correm para garantir capacidade doméstica de GPU. Os acordos de compra de energia regional incorporam cada vez mais garantias de energia renovável para proteger contra escassez de transformadores em cidades indianas de segundo nível, e os prêmios de talento para engenheiros de infraestrutura qualificados em IA permanecem 35-50% acima das funções tradicionais, consolidando a disponibilidade de mão de obra como um fator de risco em nível de conselho. Como resultado, os operadores que conseguirem combinar certificações de nuvem soberana com resfriamento avançado e blocos dedicados de megawatts estão posicionados para conquistar a maior participação na próxima onda de crescimento.

Principais Conclusões do Relatório

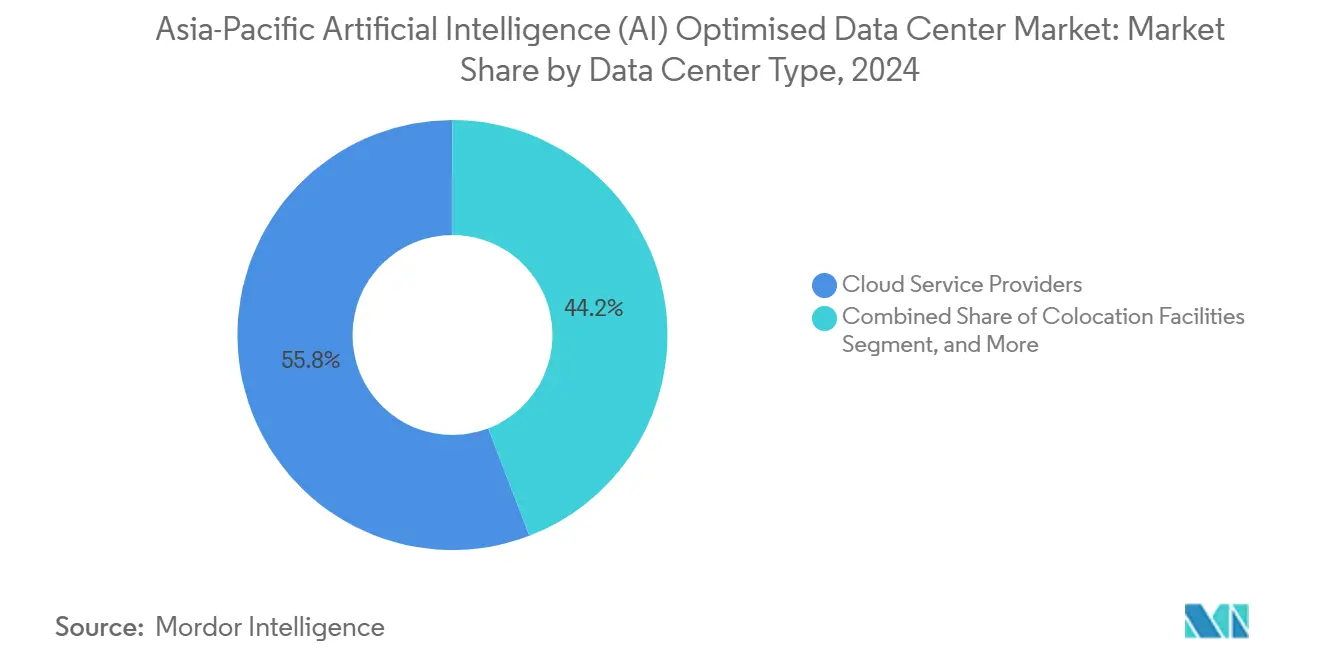

- Por tipo de data center, os provedores de nuvem em hiperescala lideraram com uma participação de 55,82% no mercado de data center de inteligência artificial na Ásia Pacífico em 2024, enquanto as instalações de colocation estão no caminho de um CAGR de 24,23% até 2030.

- Por componente, o software deteve 45,83% do tamanho do mercado de data center de inteligência artificial na Ásia Pacífico em 2024, enquanto a infraestrutura de hardware está projetada para se expandir a um CAGR de 23,67% até 2030.

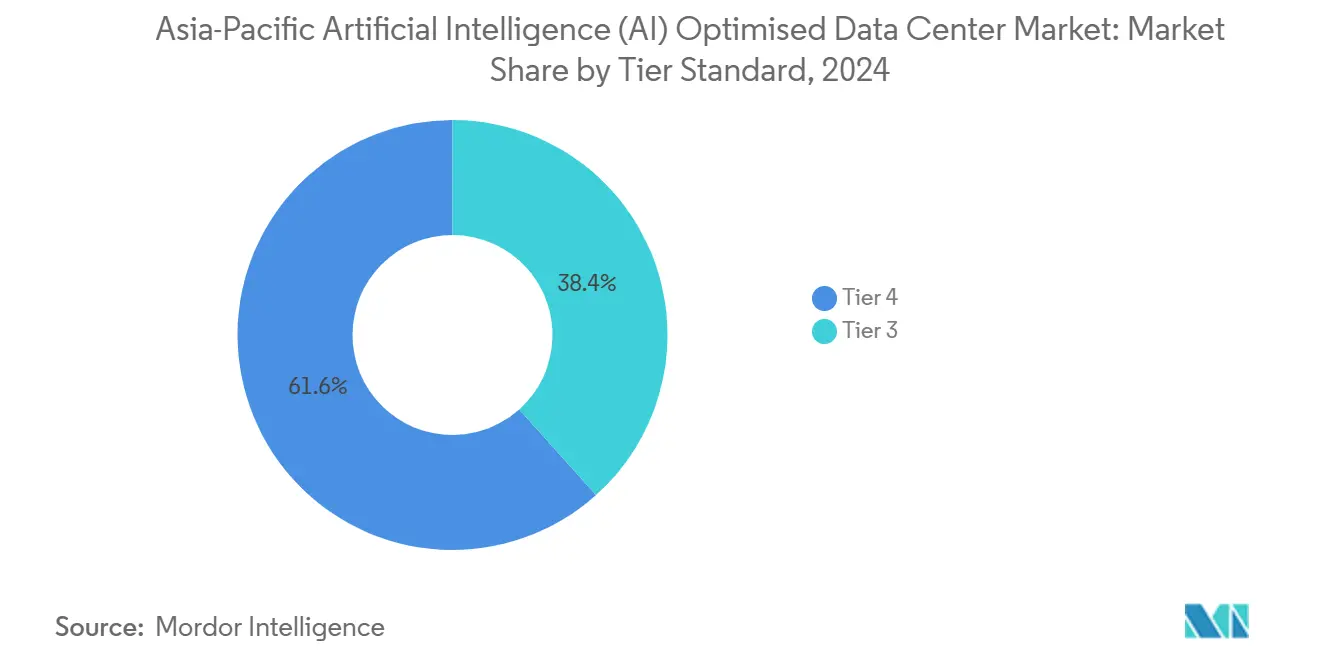

- Por padrão de nível, as instalações de Nível IV comandaram uma participação de 61,63% do tamanho do mercado de data center de inteligência artificial na Ásia Pacífico em 2024; as instalações de Nível III estão avançando a um CAGR de 24,77%.

- Por setor de usuário final, TI e ITES responderam por 33,82% do tamanho do mercado de data center de inteligência artificial na Ásia Pacífico em 2024, enquanto internet e mídia digital registra o maior CAGR de 23,45% até 2030.

Tendências e Perspectivas do Mercado de Data Center Otimizado por Inteligência Artificial (IA) na Ásia Pacífico

Análise de Impacto dos Impulsionadores

| Impulsionador | (~) % de Impacto na Previsão de CAGR | Relevância Geográfica | Horizonte Temporal de Impacto |

|---|---|---|---|

| Construção de infraestruturas hiperescala em nuvem no Sudeste Asiático | +4.2% | Núcleo do Sudeste Asiático, transbordamento para a Índia | Médio prazo (2-4 anos) |

| Subsídios governamentais para computação em IA na China e na Coreia do Sul | +5.8% | China e Coreia do Sul, contágio de políticas para a ASEAN | Curto prazo (≤ 2 anos) |

| Adaptação de instalações existentes para resfriamento líquido liderada por IA | +3.1% | Global, concentrado em mega-sites costeiros | Médio prazo (2-4 anos) |

| Tráfego crescente de inferência de IA generativa em nós de borda de telecomunicações | +2.9% | Núcleo da APAC, ganhos iniciais no Japão e Singapura | Curto prazo (≤ 2 anos) |

| Clusters de GPU locais por fabricantes keiretsu japoneses | +1.8% | Centrado no Japão, transbordamento regional limitado | Longo prazo (≥ 4 anos) |

| Mandatos de IA soberana acelerando a pré-locação de colocation na ASEAN | +4.5% | Mercados da ASEAN, influência regulatória em expansão | Médio prazo (2-4 anos) |

| Fonte: Mordor Intelligence | |||

Subsídios governamentais para computação em IA impulsionam a aceleração da infraestrutura

O programa de USD 7 bilhões da Coreia do Sul em IA, 400% acima dos orçamentos anteriores de infraestrutura, direciona 60% dos fundos para adições de capacidade doméstica, comprimindo os prazos de construção para menos de 18 meses. A exigência da China de que 80% das cargas de trabalho de treinamento de IA permaneçam no território nacional até 2026 produziu as maiores taxas de pré-locação de colocation da região e impulsionou o acúmulo de estoque de GPU para proteção contra o risco de controles de exportação. Em toda a ASEAN, mandatos semelhantes elevam os prêmios de nuvem soberana em 25-30%, especialmente em Singapura, onde as instalações certificadas já registram a menor vacância na Ásia.

Construções hiperescala em nuvem remodelam a infraestrutura do Sudeste Asiático

O plano de USD 3 bilhões da Google para a Tailândia e a Malásia confirma a vantagem de rede elétrica que esses mercados detêm sobre os centros tradicionais, enquanto a região de nuvem soberana indonésia de USD 1,7 bilhão da Microsoft posiciona a empresa à frente do prazo de localização de dados de Jacarta em 2025. Cada hiperescalador requer blocos de transformadores ao nível do terreno de 100 MW ou mais, incentivando localizações em parques industriais que possam contornar as filas da rede urbana.

Adaptação de instalações existentes para resfriamento líquido liderada por IA

Os racks de IA generativa funcionam 3-4 vezes mais quentes do que os servidores convencionais, forçando os operadores a adotar resfriamento direto para o chip a fim de manter o PUE abaixo de 1,3. A NTT relata que 40% de toda a nova capacidade japonesa comissionada em 2024 já integra resfriamento líquido. A economia de adaptação favorece as instalações existentes com carga de piso e capacidade de barramentos suficientes, reduzindo o consumo de energia por rack em 15-20% e dobrando a densidade sem o prazo de execução de novas construções.

Tráfego crescente de inferência de IA generativa em nós de borda de telecomunicações

As implantações de computação de borda de múltiplo acesso 5G estão deslocando a inferência de IA para mais perto dos usuários, reduzindo a latência e descarregando a largura de banda do backbone. O Japão e Singapura são os pioneiros, cada um posicionando clusters de GPU de pequeno porte dentro de hotéis de operadoras para servir tradução em tempo real, varejo imersivo e serviços de navegação de RA. A estratégia libera as regiões hiperescala para tarefas de treinamento, enquanto gera novas curvas de demanda de micro-colocation.

Análise de Impacto das Restrições

| Restrição | (~) % de Impacto na Previsão de CAGR | Relevância Geográfica | Horizonte Temporal de Impacto |

|---|---|---|---|

| Escassez aguda de energia de nível de transformador em cidades indianas de segundo nível | -2.1% | Cidades de segundo nível na Índia, lacunas na infraestrutura de rede | Curto prazo (≤ 2 anos) |

| Controles de exportação de ASIC/GPU que impactam os prazos de fornecimento | -3.4% | China como principal afetada, efeitos secundários em toda a APAC | Médio prazo (2-4 anos) |

| Crescentes restrições à captação de água do mar em mega-sites costeiros | -1.6% | Instalações costeiras em Singapura, Japão e Austrália | Longo prazo (≥ 4 anos) |

| Escassez de talentos para engenheiros de software de DC-IM otimizado para IA | -2.8% | Regional, aguda em Singapura, Seul e Tóquio | Médio prazo (2-4 anos) |

| Fonte: Mordor Intelligence | |||

Escassez de infraestrutura de energia limita a expansão em cidades de segundo nível

Em Pune, Hyderabad e Chennai, as alocações de rede ficam até 40% aquém da demanda de data centers, empurrando os tempos de espera por conexão para além de 18 meses e forçando os desenvolvedores a estruturas de PPA de energia renovável com custos mais elevados. Embora a energia verde suavize os perfis de emissões, o capex adicional infla as barreiras de TIR dos projetos em até 300 pontos-base.

Os controles de exportação de ASIC/GPU impactam os prazos de fornecimento

As restrições a aceleradores avançados ampliam as janelas de entrega para 6-12 meses, levando as empresas chinesas a aumentar os volumes de pedidos locais em 180% ao ano. Os compradores japoneses agora diversificam em direção a fabricantes de chips domésticos que oferecem 60-70% do desempenho de primeira linha a um custo 40% menor, mas à custa de fragmentação da pilha de software e atrasos de validação.

Análise de Segmentos

Por Tipo de Data Center: O crescimento de colocation supera as normas históricas

As instalações de colocation capturaram 28,35% dos gastos, mas se expandirão a um CAGR de 24,23%, eclipsando o crescimento hiperescala à medida que as regras de IA soberana tornam o controle doméstico de racks obrigatório para bancos, seguradoras e ministérios governamentais. Os hiperescaladores mantêm uma liderança de 55,82%, mas sua participação no mercado de data center de inteligência artificial na Ásia Pacífico atingiu um platô à medida que os nós locais e de borda proliferam. Os operadores de colocation que pré-provisionam resfriamento líquido e blocos de transformadores de 20+ MW conquistam pré-locações desproporcionais, particularmente em Singapura e Kuala Lumpur, onde os limites de terreno restringem a escala de novas construções. As implantações empresariais e de borda, favorecidas pelos keiretsu japoneses, absorvem o risco de controles de exportação ao reter a custódia física de GPU. O tamanho do mercado de data center de inteligência artificial na Ásia Pacífico vinculado aos nós locais empresariais ultrapassará USD 3 bilhões até 2030, refletindo uma diversificação sustentada para longe da nuvem pública. Ao longo do horizonte de previsão, espera-se que as construções de hiperescaladores se consolidem em torno de cinco corredores ricos em energia, cimentando seu papel nas cargas de trabalho de treinamento enquanto transferem a inferência crítica em termos de latência para pods de colo de borda.

Ao longo de 2025-2030, as promessas de expansão dos hiperescaladores, os USD 2,9 bilhões da Microsoft no Japão e os USD 3 bilhões da Google no Sudeste Asiático continental, elevam o CAGR histórico do segmento de 18,4% para 21,8%. Os provedores que integram direitos de atracagem de cabos submarinos com capacidade direta de GPU criam um fosso defensável contra os concorrentes domésticos. Enquanto isso, o mercado de data center de inteligência artificial na Ásia Pacífico continua a recompensar os grupos de colocation que obtêm selos de governança de IA e empacotam tecidos de interconexão de baixa latência, permitindo que os inquilinos conectem clusters privados a GPUs hiperescala quando os limites de exportação se relaxarem.

Por Componente: O crescimento do hardware chega à medida que a IA passa do piloto para a produção

O software ainda comanda 45,83% dos gastos de 2024 porque os frameworks de modelos, as camadas de orquestração e as plataformas de observabilidade permanecem fundamentais para a construção de IA. No entanto, o hardware, a fatia de crescimento mais rápido a um CAGR de 23,67%, está previsto para ultrapassar USD 10 bilhões do tamanho do mercado de data center de inteligência artificial na Ásia Pacífico até 2030, impulsionado pela mudança da experimentação baseada em nuvem para clusters de inferência em escala que sobrecarregam os limiares de densidade de rack. Os operadores agora reservam mais da metade do capex de 2025 para circuitos de resfriamento, barramentos e chaves de média tensão que possam sustentar térmicas acima de 40 kW por rack.

Energia e resfriamento consomem o maior gasto em hardware; cada rack de GPU consome até 10× a corrente de um rack de CPU, levando muitas instalações a alimentações de utilidade de 30 MVA. Somente a aquisição de resfriamento líquido está crescendo a 35% ao ano no Japão, aumentando a participação de mercado de data center de inteligência artificial do país dentro da categoria de hardware. Os serviços, representando 31,52% dos gastos, estão se inclinando para ofertas gerenciadas à medida que os clientes terceirizam o ajuste de réplicas, pontos de verificação de gradiente e agendamento com consciência energética. O crescimento de serviços profissionais fica para trás à medida que os hiperescaladores internalizam habilidades de design e provedores menores dependem de arquiteturas de referência de fornecedores como a Schneider Electric. Em toda a região, as restrições da cadeia de suprimentos em GPUs e tecido de rede fazem com que os operadores mantenham buffers de estoque de três meses, imobilizando capital de giro, mas garantindo a continuidade da implantação.

Por Padrão de Nível: O momentum do Nível III se constrói na borda

As instalações de Nível IV ainda dominam com 61,63% de participação porque o tempo de inatividade no treinamento de IA pode apagar semanas de trabalho de computação e transbordar para os orçamentos de retreinamento de modelos. Mesmo assim, os locais de Nível III, previstos com um CAGR de 24,77%, capturam nova demanda por inferência, onde breves interrupções podem ser absorvidas por meio de roteamento de tráfego e reagendamento de microlotes. O tamanho do mercado de data center de inteligência artificial na Ásia Pacífico vinculado a instalações de Nível III ultrapassará USD 6 bilhões até 2030, auxiliado por implantações de borda em trocas de telecomunicações e abrigos de fibra metropolitana.

As cargas de trabalho de IA soberana da China continuam a insistir na redundância de Nível IV, mas o Sudeste Asiático relaxa para níveis de Nível III que trocam cinco noves por tempos de construção mais rápidos e capex 18-20% menor. Os reguladores japoneses agora aceitam pods de Nível III modulares dentro de fábricas para encurtar os ciclos de design de semicondutores. Enquanto isso, o crescimento do Nível IV avança para um CAGR de 22,1% à medida que os hiperescaladores ricos em capital duplicam os acordos de liquidez com fornecedores para garantir chaves e resfriadores com 12 meses de antecedência. A divisão de participação de mercado de data center de inteligência artificial na Ásia Pacífico entre os níveis se estreitará, mas ambos permanecem indispensáveis: um para treinamento ininterrupto e o outro para inferência sensível à latência na borda da rede.

Por Setor de Usuário Final: Internet e Mídia Digital disparam à frente

TI e ITES detiveram 33,82% dos gastos de 2024 graças à adoção antecipada de pipelines de integração contínua e frameworks de testes automatizados alimentados por modelos de linguagem de grande porte. Em contraste, Internet e Mídia Digital cresce a um CAGR de 23,45%, impulsionado pela geração de conteúdo em tempo real, mecanismos de recomendação e experiências sociais imersivas que requerem inferência em nível de milissegundos. O setor de data center de inteligência artificial na Ásia Pacífico está testemunhando as telecomunicações alocarem 18,7% dos gastos para nós de borda de múltiplo acesso para permitir sobreposições de RA de visão computacional para assinantes 5G.[1]Equipe de Redes Futuras da GSMA, "Multi-access edge computing overview", GSMA, gsma.com

A participação de 15,2% do BFSI é estável porque as equipes de risco e conformidade devem hospedar ciclos de ajuste fino dentro das fronteiras nacionais, elevando os prêmios de nuvem soberana. Saúde e Ciências da Vida adicionam 22,8% de CAGR aproveitando a IA generativa na descoberta de medicamentos e triagem de radiologia, frequentemente sob regras de privacidade de grau hospitalar.[2]Editores de tecnologia da saúde, "AI accelerates drug discovery and imaging", Nature Medicine, nature.com Os casos de uso em manufatura se agrupam em torno de manutenção preditiva e detecção de defeitos em linha, exigindo integração de borda de controlador que favorece clusters locais dentro de fábricas. Governo e Defesa, embora menores, desfrutam de acesso prioritário a blocos de transformadores e direitos sobre a água, garantindo que as instalações alcancem a prontidão antes de suas contrapartes civis.

Análise Geográfica

A China domina o mercado de data center de inteligência artificial na Ásia Pacífico com uma participação de 42,74% em 2024, protegida por diretivas que exigem que 80% das cargas de trabalho de treinamento permaneçam no território nacional até 2026. O crescimento anual acelera para 22,3% à medida que os ventos contrários dos controles de exportação estimulam aumentos de 180% ano a ano nas implantações domésticas de GPU. Os mandatos de resfriamento líquido apoiados por Pequim para instalações acima de 10 MW desencadeiam booms de adaptação em campi legados, sustentando a taxa de execução de CAPEX desproporcional do país.

O Japão, com uma participação de 21,3%, aproveita o investimento direto estrangeiro recorde, os USD 8 bilhões da Oracle e os USD 2,9 bilhões da Microsoft, para cimentar seu papel como o laboratório de resfriamento mais avançado da região. As aprovações aceleradas nacionais para instalações com PUE abaixo de 1,3 permitem que os projetos iniciem a construção em 90 dias, e os acionistas keiretsu adicionam USD 2 bilhões em clusters locais para proteger a propriedade intelectual de design.

A Coreia do Sul registra o CAGR mais rápido da região de 26,61% com base em um estímulo de IA de USD 7 bilhões focado em subsídios de capacidade doméstica e créditos fiscais. O mandato de computação de borda do regulador de telecomunicações para 2025 inclina ainda mais os gastos para nós 5G distribuídos, criando trilhas de demanda paralelas para operadores hiperescala e de micro-colo.

A participação de 18,9% da Índia permanece limitada por gargalos de transformadores e filas de rede em metrópoles de segundo nível, mas os PPAs de energia renovável e o banco de terrenos ao longo de corredores costeiros mantêm as perspectivas de longo prazo intactas. A Austrália e a Nova Zelândia detêm conjuntamente uma participação de 8,4%, atraindo investidores com carve-outs de nuvem soberana destinados a agências de defesa e saúde.[3]Claire Jones, "Australia sovereign cloud AI infrastructure", Australian Financial Review, afr.com Singapura, embora representando apenas 6,1% por receita, exerce influência regulatória desproporcional; seu framework de governança de IA agora serve como modelo de certificação em toda a ASEAN. As demais nações do Sudeste Asiático exploram os impulsos de capex dos hiperescaladores para superar a infraestrutura legada, posicionando o corredor como a adjacência de mais alto crescimento do mundo para cargas de trabalho de IA.

Cenário Competitivo

A concentração do mercado de data center de inteligência artificial na Ásia Pacífico é moderada, à medida que hiperescaladores, telecomunicações regionais e empresas independentes de colocation perseguem estratégias sobrepostas. Alibaba Cloud, Tencent Cloud, AWS e Microsoft continuam a empacotar serviços em nuvem com imóveis próprios, mas as crescentes regras de residência de dados permitem que campeões domésticos como NTT Global Data Centers e STT GDC defendam participação por meio de certificações de conformidade e circuitos de resfriamento líquido pré-instalados.

Os movimentos estratégicos incluem as parcerias de nuvem soberana da Microsoft com ministérios tailandeses, o megacluster Tóquio-Osaka da Oracle otimizado para racks de IA de 40 kW e a aquisição de USD 800 milhões da STT GDC de instalações indianas já equipadas para densidades de GPU acima de 30 kW. As alianças tecnológicas se aprofundam: Schneider Electric e Vertiv fornecem skids de resfriamento em circuito fechado, enquanto NVIDIA e Huawei competem por vitórias no design de aceleradores em meio a restrições de exportação. Os operadores com propriedade intelectual de resfriamento líquido interna capturam aluguéis premium e podem adiar amortizações de instalações existentes ao dobrar a densidade de rack sem ampliar as instalações.

A escassez de talentos molda a lógica de fusões e aquisições; as empresas veem o quadro de engenharia como um ativo escasso e pagam prêmios de aquisição por equipes que possam integrar resfriamento direto para o chip, agendadores de cargas de trabalho de IA e software de DC-IM adaptativo em termos de energia. A intensidade competitiva também aumenta na borda, onde NTT e Singtel aproveitam os direitos de acesso a fibra para implantar pods de micro-colo que vinculam sites de RAN 5G a aceleradores GPU, reduzindo assim a latência do último quilômetro para cargas de trabalho de RA e jogos. No geral, o mercado recompensa os players capazes de unir garantia de conformidade, resfriamento de alta densidade e resiliência energética em uma única oferta comercial.

Líderes do Setor de Data Center Otimizado por Inteligência Artificial (IA) na Ásia Pacífico

NVIDIA Corporation

Huawei Technologies Co., Ltd.

Sunbird Software, Inc.

Delta Electronics

Daikin Industries

- *Isenção de responsabilidade: Principais participantes classificados em nenhuma ordem específica

Desenvolvimentos Recentes do Setor

- Março de 2025: A Alibaba Cloud apresentou sua mais nova adição à "série Qwen" de modelos de inteligência artificial. Este lançamento ocorre em meio à intensificação da concorrência na arena de modelos de linguagem de grande porte da China, especialmente após o notável "momento DeepSeek". O modelo recém-introduzido,

Qwen2.5-Omni-7B,

possui capacidades multimodais, permitindo-lhe lidar com entradas diversas, como texto, imagens, áudio e vídeo. Em troca, gera saídas de texto instantâneas e fala natural. - Fevereiro de 2025: A Daikin apresentou sua mais nova oferta, o Manipulador de Ar para Sala de Computadores Pro-C (CRAH), reforçando sua linha de produtos para Data Centers. Adaptada para atender a diversas necessidades de resfriamento de Data Centers, a unidade apresenta um design aprimorado e mecanismos de controle sofisticados.

- Janeiro de 2025: A Microsoft adicionou USD 1,5 bilhão à construção de IA na Tailândia, introduzindo zonas de nuvem soberana para clientes do setor financeiro e do setor público.

- Dezembro de 2024: A Oracle abriu o primeiro tranche de USD 8 bilhões de instalações de GPU no Japão em Tóquio e Osaka com racks resfriados a líquido de 40 kW.

Escopo do Relatório de Mercado de Data Center Otimizado por Inteligência Artificial (IA) na Ásia Pacífico

O termo "Inteligência Artificial (IA) em data centers" aprofunda-se na integração de diversas tecnologias de IA, abrangendo aprendizado de máquina, aprendizado profundo, processamento de linguagem natural e visão computacional nas operações dos data centers. Essas operações abrangem um espectro de componentes, desde infraestrutura e gestão de energia até armazenamento, redes, segurança cibernética e automação de instalações.

O Relatório de Mercado de Data Center de Inteligência Artificial (IA) da Ásia Pacífico é Segmentado por Tipo de Data Center (Data Centers de CSP, Data Centers de Colocation e Outros (Empresarial e Borda), por Componente (Hardware (Energia, Resfriamento, Equipamentos de TI e Outros), Tecnologia de Software (Aprendizado de Máquina, Aprendizado Profundo, Processamento de Linguagem Natural e Visão Computacional)) e Serviços, e por País (China, Índia, Japão, Malásia, Austrália, Singapura, Indonésia, Tailândia, Coreia do Sul e Restante da Ásia Pacífico). Os Tamanhos e Previsões de Mercado são Fornecidos em Valores (USD) para todos os Segmentos acima.

| Provedores de Serviços em Nuvem |

| Instalações de Colocation |

| Empresarial / Local / Borda |

| Hardware | Infraestrutura de Energia |

| Infraestrutura de Resfriamento | |

| Equipamentos de TI | |

| Racks e Outros Hardwares | |

| Tecnologia de Software | Aprendizado de Máquina |

| Aprendizado Profundo | |

| Processamento de Linguagem Natural | |

| Visão Computacional | |

| Serviços | Serviços Gerenciados |

| Serviços Profissionais |

| Nível III |

| Nível IV |

| TI e ITES |

| Internet e Mídia Digital |

| Operadoras de Telecomunicações |

| BFSI |

| Saúde e Ciências da Vida |

| Manufatura e IoT Industrial |

| Governo e Defesa |

| China |

| Japão |

| Índia |

| Malásia |

| Coreia do Sul |

| Singapura |

| Restante da Ásia Pacífico |

| Por Tipo de Data Center | Provedores de Serviços em Nuvem | |

| Instalações de Colocation | ||

| Empresarial / Local / Borda | ||

| Por Componente | Hardware | Infraestrutura de Energia |

| Infraestrutura de Resfriamento | ||

| Equipamentos de TI | ||

| Racks e Outros Hardwares | ||

| Tecnologia de Software | Aprendizado de Máquina | |

| Aprendizado Profundo | ||

| Processamento de Linguagem Natural | ||

| Visão Computacional | ||

| Serviços | Serviços Gerenciados | |

| Serviços Profissionais | ||

| Por Padrão de Nível | Nível III | |

| Nível IV | ||

| Por Setor de Usuário Final | TI e ITES | |

| Internet e Mídia Digital | ||

| Operadoras de Telecomunicações | ||

| BFSI | ||

| Saúde e Ciências da Vida | ||

| Manufatura e IoT Industrial | ||

| Governo e Defesa | ||

| Por País | China | |

| Japão | ||

| Índia | ||

| Malásia | ||

| Coreia do Sul | ||

| Singapura | ||

| Restante da Ásia Pacífico | ||

Principais Questões Respondidas no Relatório

Qual taxa de crescimento está prevista para o mercado de data center de inteligência artificial na Ásia Pacífico até 2030?

O mercado está projetado para se expandir a um CAGR de 22,69%, atingindo USD 26,67 bilhões até 2030.

Qual segmento cresce mais rapidamente dentro dos data centers de IA da Ásia Pacífico?

As instalações de colocation lideram com um CAGR de 24,23% à medida que as regras de IA soberana impulsionam a demanda doméstica por racks.

Por que as adaptações de resfriamento líquido estão se acelerando nas instalações de GPU da Ásia Pacífico?

Os racks de IA generativa geram 3-4× o calor dos servidores tradicionais, e o resfriamento líquido mantém o PUE abaixo de 1,3 enquanto dobra a densidade dos racks.

Qual país apresenta o ritmo de crescimento mais elevado?

A Coreia do Sul registra o CAGR mais forte de 26,61%, apoiado por USD 7 bilhões em incentivos específicos para data centers de IA.

Como os controles de exportação influenciam as estratégias de infraestrutura de IA regional?

As restrições ampliam os prazos de entrega de GPU para 6-12 meses, levando empresas chinesas e japonesas a acumular aceleradores e a favorecer clusters locais.

Página atualizada pela última vez em: