Tamanho e Participação do Mercado de Orquestração de AI Agêntica e Sistemas de Memória

Análise do Mercado de Orquestração de AI Agêntica e Sistemas de Memória pela Mordor Intelligence

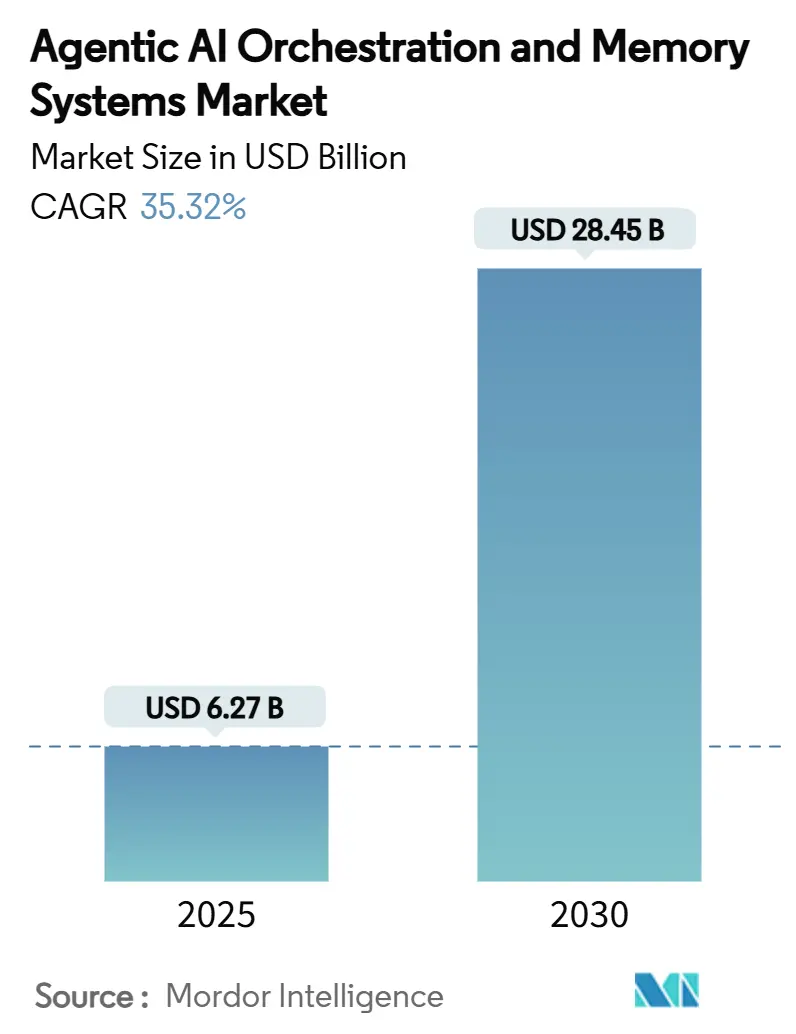

O tamanho do Mercado de Orquestração de AI Agêntica e Sistemas de Memória é estimado em USD 6,27 bilhões em 2025, e espera-se que alcance USD 28,45 bilhões até 2030, a um CAGR de 35,32% durante o período de previsão (2025-2030). O salto de dois dígitos decorre da migração das empresas de projetos-piloto para fluxos de trabalho autônomos de múltiplos agentes em nível de produção, que reduzem os pontos de contato manuais nas operações centrais. O valor de negócio agora gira em torno de camadas de orquestração que coordenam raciocínio e ação, enquanto sistemas de memória prontos para uso mantêm o contexto de longo horizonte disponível para cada agente. Bancos de dados vetoriais integrados a APIs de orquestração fornecem essa memória persistente, e as plataformas de nuvem incorporam a capacidade como um serviço gerenciado, reduzindo o atrito de construção e operação. A intensidade competitiva está aumentando à medida que grandes empresas de tecnologia empacotam arquiteturas de referência que eliminam a incerteza arquitetural, mas startups especializadas defendem sua participação com busca vetorial mais profunda, maior observabilidade e lógica de fluxo de trabalho específica para domínios. O mercado de orquestração de AI agêntica também se beneficia de mandatos de conformidade que exigem trilhas de auditoria completas para a atividade de modelos de linguagem de grande escala (LLM), tornando a retenção de contexto uma prioridade no nível do conselho[1]Microsoft Corporation, "Azure AI Agent Service," MICROSOFT.COM.

Principais Conclusões do Relatório

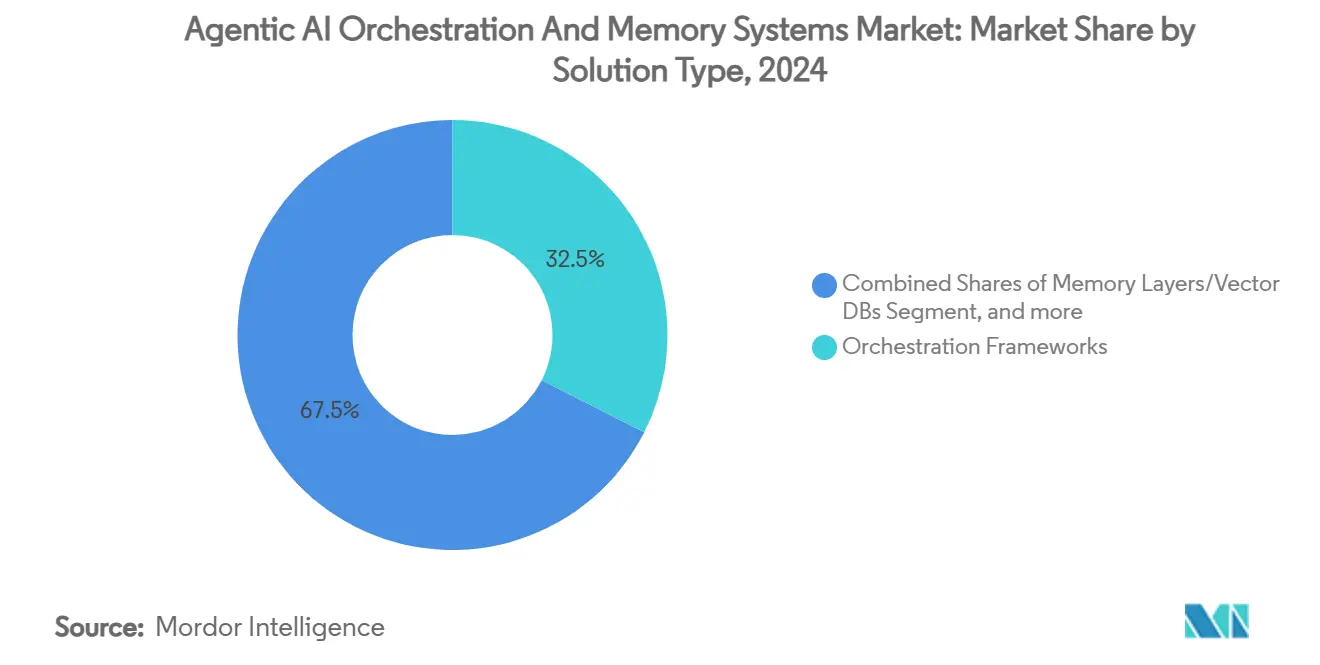

- Por tipo de solução, os frameworks de orquestração detinham 32,45% da participação do mercado de orquestração de AI agêntica em 2024, enquanto as ferramentas de observabilidade e testes estão acelerando a um CAGR de 37,45% até 2030.

- Por modo de implantação, as plataformas de nuvem comandavam 67,84% do tamanho do mercado de orquestração de AI agêntica em 2024 e estão avançando a um CAGR de 36,50% até 2030.

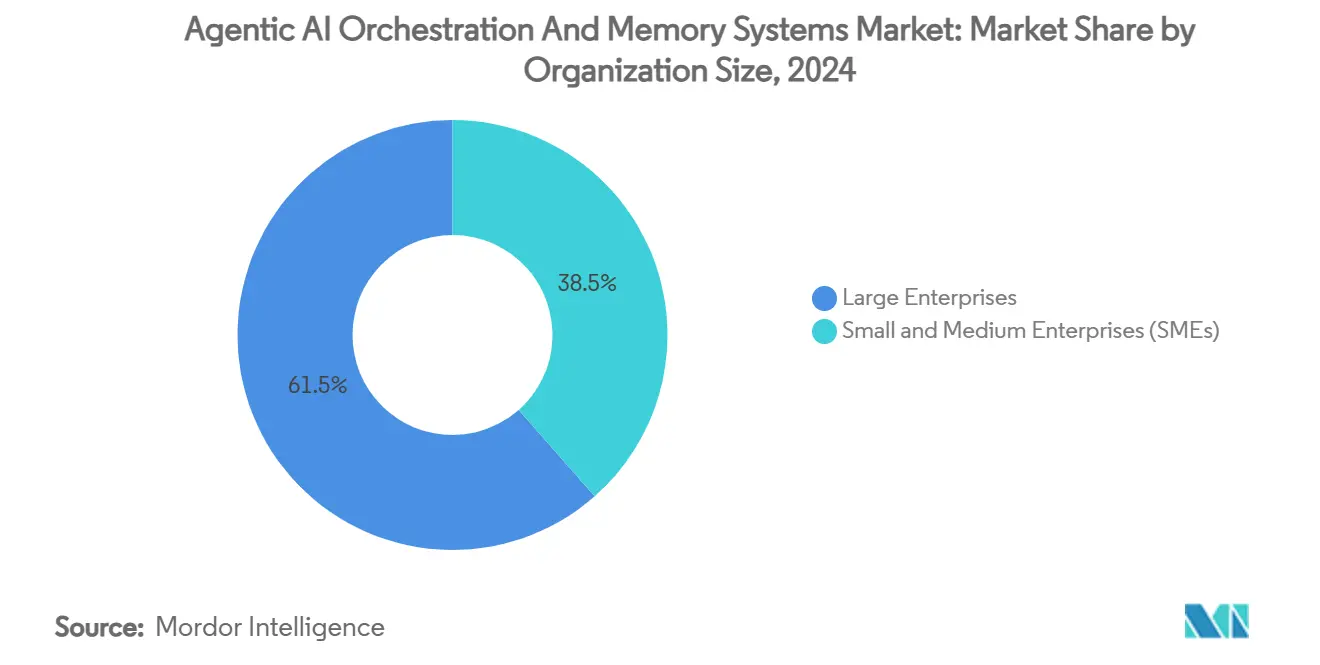

- Por tamanho de organização, as grandes empresas lideraram com 61,47% de participação na receita em 2024; as pequenas e médias empresas estão expandindo a um CAGR de 38,10% até 2030.

- Por setor do usuário final, TI e telecomunicações capturaram 23,40% da participação do mercado de orquestração de AI agêntica em 2024, enquanto o varejo e o comércio eletrônico deve crescer a um CAGR de 37,19% até 2030.

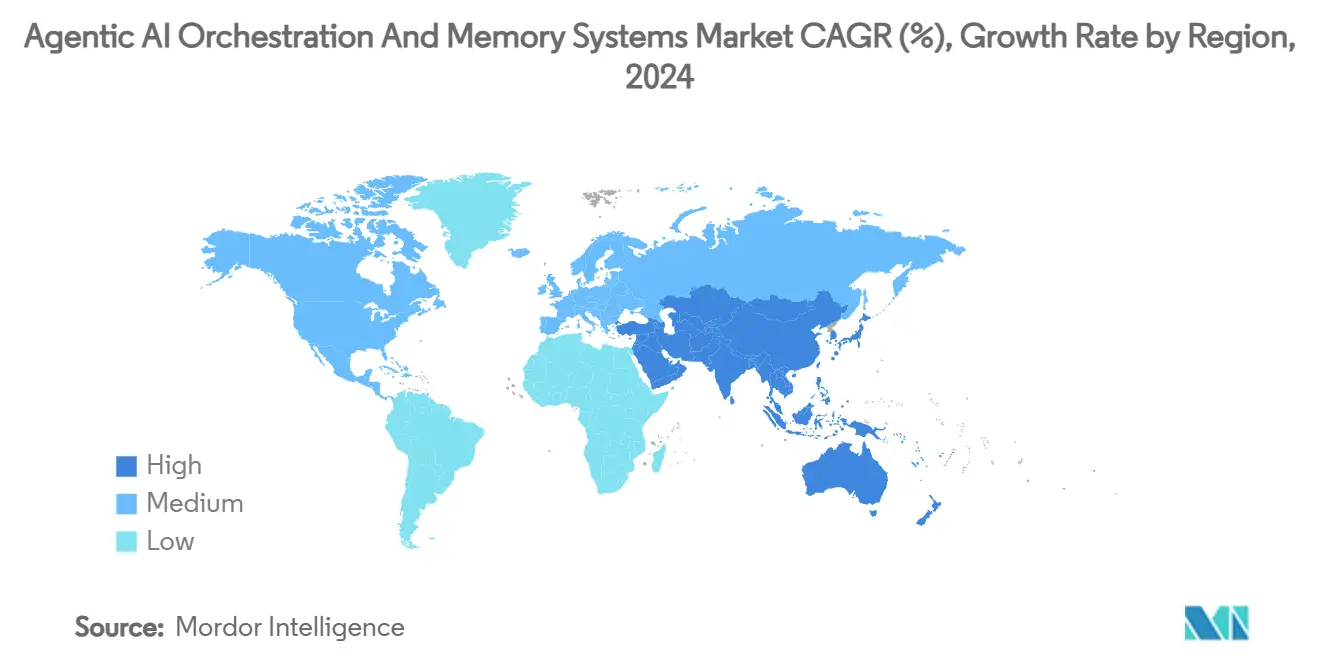

- Por geografia, a América do Norte respondeu por 40,40% da receita de 2024; a Ásia-Pacífico registra o CAGR mais rápido de 37,89% até 2030.

Tendências e Perspectivas do Mercado Global de Orquestração de AI Agêntica e Sistemas de Memória

Análise de Impacto dos Impulsionadores

| Impulsionador | (~) % de Impacto na Previsão de CAGR | Relevância Geográfica | Prazo de Impacto |

|---|---|---|---|

| Pilhas de operações de agentes nativas em nuvem ganhando atenção dos CIOs | +8.20% | Global, com ganhos iniciais na América do Norte e na UE | Médio prazo (2-4 anos) |

| Convergência de bancos de dados vetoriais e APIs de orquestração em camadas de memória prontas para uso | +7.80% | Global | Curto prazo (≤ 2 anos) |

| Projetos-piloto de múltiplos agentes empresariais migrando de provas de conceito para produção em 2025 | +6.50% | América do Norte e UE como núcleo, com expansão para a APAC | Curto prazo (≤ 2 anos) |

| Arquiteturas de referência de grandes fornecedores de tecnologia reduzindo o risco de adoção | +5.90% | Global | Médio prazo (2-4 anos) |

| Crescentes mandatos de conformidade para trilhas de auditoria de LLM impulsionando a memória persistente | +4.70% | América do Norte e UE, expandindo para a APAC | Longo prazo (≥ 4 anos) |

| Surgimento de protocolos abertos (A2A, MCP) habilitando malhas de agentes plug-and-play | +3.10% | Global | Longo prazo (≥ 4 anos) |

| Fonte: Mordor Intelligence | |||

Pilhas de Operações de Agentes Nativas em Nuvem Ganhando Atenção dos CIOs

Os diretores de informação classificam os sistemas de orquestração e memória como infraestrutura estratégica, substituindo a percepção da AI agêntica como um complemento experimental. Os gastos migram para plataformas de operações de agentes nativas em nuvem porque se integram perfeitamente aos pipelines de DevOps e às ferramentas de segurança existentes. O Azure AI Agent Service da Microsoft incorpora a orquestração diretamente nos limites de redes virtuais, permitindo que as empresas iniciem fluxos de múltiplos agentes sem sobrecarga adicional de integração. Os primeiros adotantes relatam economias de 30 a 40% nas despesas operacionais quando agentes de raciocínio substituem tarefas humanas repetitivas[2] Boston Consulting Group, "How AI Agents Are Opening the Golden Era of Customer Experience," BCG.COM . Os módulos de governança integrados satisfazem as verificações regulatórias de explicabilidade, posicionando as arquiteturas nativas em nuvem como o padrão para novas implantações até 2030. À medida que projetos de grande porte atingem escala, os CIOs avaliam os roteiros dos fornecedores em três métricas — latência sob concorrência, segurança de implantação automatizada e registro completo de linhagem — convertendo esses critérios em contratos de plataforma plurianuais.

Convergência de Bancos de Dados Vetoriais e APIs de Orquestração em Camadas de Memória Prontas para Uso

As limitações de agentes sem estado estão desaparecendo porque a indexação de armazenamentos vetoriais e a lógica de orquestração agora se interligam em uma única camada gerenciada. A Mem0 AI combina busca semântica de alta recuperação com gatilhos de fluxo de trabalho, de modo que cada chamada de agente recupera, atualiza e persiste o contexto na mesma transação atômica[3] Mem0 AI, "Memory Layer Platform," MEM0.AI . As empresas que instalam essas camadas de memória prontas para uso registram precisão de conclusão de tarefas 40 a 60% maior do que as linhas de base sem estado. O avanço técnico decorre da vinculação tardia de embeddings: as gravações de memória ocorrem apenas quando as pontuações de relevância ultrapassam os limites de política, controlando a expansão desordenada do armazenamento vetorial. Com a persistência resolvida, os arquitetos estão redesenhando processos de negócios de ponta a ponta — por exemplo, os fluxos de pedido a recebimento agora abrangem múltiplos ciclos fiscais sem perda de contexto, e os agentes referenciam negociações com fornecedores de meses atrás durante decisões de precificação em tempo real. Essa capacidade estrutural está redefinindo as expectativas sobre o que os sistemas autônomos podem cobrir nos fluxos de trabalho corporativos.

Projetos-Piloto de Múltiplos Agentes Empresariais Migrando de Provas de Conceito para Produção em 2025

A fase de prova de conceito desaparece para muitas empresas da Fortune 1000 em 2025. O Wells Fargo colocou em produção uma malha de agentes de atendimento ao cliente em canais de voz, chat e e-mail e publicou reduções mensuráveis no tempo médio de atendimento, além de um aumento nos índices de satisfação do cliente. A prontidão para produção foi acelerada porque as pilhas de observabilidade agora capturam cada árvore de decisão do agente, permitindo que os responsáveis pela conformidade reproduzam as interações sob demanda. Os dados de pesquisa da Databricks mostram que 60% das empresas migrarão pelo menos um projeto-piloto para produção durante 2025, um salto três vezes maior em relação a 2024. Esse pipeline de entradas em produção pressiona os fornecedores a garantir disponibilidade de quatro noves para os motores de orquestração e a oferecer estratégias de reversão quando o comportamento emergente dos agentes se desvia da política. À medida que os ambientes de produção crescem, os compradores avaliam cada vez mais os SLAs de suporte dos fornecedores e os frameworks de resposta a incidentes com o mesmo peso que os benchmarks brutos de qualidade de modelo.

Arquiteturas de Referência de Grandes Fornecedores de Tecnologia Reduzindo o Risco de Adoção

Microsoft, Google e AWS utilizam seus parques de nuvem ao disponibilizar designs de referência de pilha completa. O Memory Bank do Vertex AI do Google integra memória vetorial persistente às políticas existentes de Gerenciamento de Identidade e Acesso, acelerando as revisões de segurança. O AWS Bedrock Agents pré-empacota salvaguardas em nível de token, permitindo que instituições financeiras superem obstáculos de conformidade em semanas em vez de trimestres. As empresas que adotam esses modelos relatam ciclos de implantação reduzidos em 50 a 70%, levando a aprovações no nível do conselho para implementações mais amplas. As arquiteturas de referência codificam as melhores práticas, de modo que mesmo empresas com equipes de AI enxutas podem implantar aplicações de múltiplos agentes que passam pelos conselhos internos de revisão de arquitetura. Esses blueprints consolidam os grandes fornecedores de tecnologia no núcleo de orquestração, mas também expandem o gasto total endereçável ao tranquilizar setores avessos ao risco, como saúde e governo.

Análise de Impacto das Restrições

| Restrição | (~) % de Impacto na Previsão de CAGR | Relevância Geográfica | Prazo de Impacto |

|---|---|---|---|

| Cadeia de ferramentas de observabilidade e depuração imatura para fluxos de trabalho de múltiplos agentes | -4.20% | Global | Curto prazo (≤ 2 anos) |

| Altos custos de inferência de armazenamento vetorial em escala para contexto de longo prazo | -3.80% | Global | Médio prazo (2-4 anos) |

| Padrões fragmentados criando sobrecarga de interoperabilidade | -2.90% | Global | Longo prazo (≥ 4 anos) |

| Preocupações com soberania de dados limitando a replicação de memória transfronteiriça | -2.10% | UE e APAC como núcleo, com repercussão regulatória global | Longo prazo (≥ 4 anos) |

| Fonte: Mordor Intelligence | |||

Cadeia de Ferramentas de Observabilidade e Depuração Imatura para Fluxos de Trabalho de Múltiplos Agentes

As empresas enfrentam lacunas de monitoramento porque os painéis tradicionais de Gerenciamento de Desempenho de Aplicações não analisam rastros de raciocínio de agentes ou padrões emergentes de colaboração. A Deepchecks lista apenas um punhado de produtos de observabilidade de LLM desenvolvidos especificamente para esse fim, e a paridade de recursos com suítes de Gerenciamento de Desempenho de Aplicações maduras ainda está ausente[4] Deepchecks, "Top 5 LLM Observability Tools," DEEPCHECKS.COM . Sem introspecção completa, as equipes têm dificuldade em ajustar funções de recompensa ou isolar condições de corrida quando os agentes coordenam entre microsserviços. A XenonStack observa que 40 a 50% das implantações em produção paralisadas citam a ausência de telemetria de depuração como causa raiz. Essa barreira desacelera desproporcionalmente os setores regulados que devem evidenciar cada etapa algorítmica. Os fornecedores estão correndo para disponibilizar visualizadores de rastreamento e detectores de anomalias adaptados a grafos de agentes, mas até que a cobertura alcance a paridade com as expectativas de DevSecOps, o risco de implantação continua a frear o crescimento de curto prazo.

Altos Custos de Inferência de Armazenamento Vetorial em Escala para Contexto de Longo Prazo

Manter janelas de memória de milhões de documentos dentro de bancos de dados vetoriais é computacionalmente intensivo, especialmente quando os embeddings são reprocessados após o ajuste fino. A AI Multiple calcula que a recuperação vetorial pode representar 30 a 40% dos custos operacionais de agentes em produção em verticais com alta densidade de dados[5] AI Multiple, "AI Agent Performance: Success Rates & ROI in 2025," AIMULTIPLE.COM . A Rapid Innovation relata proporções de custo semelhantes durante implementações de cadeia de suprimentos, onde os agentes recuperam históricos de remessas de um ano inteiro. A curva de preços sobe de forma não linear porque as buscas por similaridade acessam grandes partições de índice à medida que o contexto se expande. As empresas menores, portanto, limitam a profundidade vetorial, prejudicando a qualidade do raciocínio dos agentes. Os fornecedores estão experimentando memória híbrida que descarrega vetores frios para armazenamento de objetos e os reidrata sob demanda, mas as provas comerciais ainda são limitadas. Até que as curvas de custo se estabilizem, alguns CFOs limitarão o escopo dos projetos, reduzindo a trajetória de adoção que de outra forma seria acentuada.

Análise de Segmentos

Por Tipo de Solução: Ferramentas de Observabilidade Impulsionam a Confiança Empresarial

As plataformas de observabilidade e testes registraram o CAGR mais rápido de 37,45% até 2030, à medida que as empresas aprenderam que agentes de produção confiáveis exigem instrumentação profunda. O segmento ganhou impulso quando rastros de agentes, atribuição em nível de token e alertas de violação de política tornaram-se requisitos de auditoria no nível do conselho. Em 2024, os frameworks de orquestração ainda detinham a maior participação de 32,45% do tamanho do mercado de orquestração de AI agêntica, embora o crescimento tenha moderado à medida que os frameworks amadureceram e os novos compradores priorizaram complementos de monitoramento. A AgentOps e fornecedores similares monetizaram essa lacuna com painéis que reproduzem cada etapa de raciocínio e apresentam diagnósticos de causa raiz[6] AgentOps, "AgentOps Platform," AGENTOPS.AI . A alta adoção nos setores de serviços financeiros e saúde sinaliza que a observabilidade não é mais opcional.

Camadas de memória sofisticadas que combinam busca vetorial com controles de acesso baseados em função constituíram a segunda maior fatia de receita. Os motores de fluxo de trabalho continuam gerando renovações de assinatura estáveis porque permanecem a espinha dorsal para o sequenciamento de tarefas entre agentes. Os SDKs de gerenciamento de contexto atraem equipes de ferramentas para desenvolvedores que precisam de abstrações para o gerenciamento de estado de agentes e versionamento de prompts. A diversidade de conjuntos de ferramentas destaca que a orquestração de múltiplos agentes é um ecossistema e não uma única categoria de produto, e os compradores frequentemente agrupam múltiplos componentes de diferentes fornecedores para satisfazer os requisitos completos do ciclo de vida.

Nota: As participações de segmento de todos os segmentos individuais estão disponíveis mediante a compra do relatório

Por Modo de Implantação: Dominância da Nuvem Acelera

A implantação em nuvem capturou 67,84% da participação do mercado de orquestração de AI agêntica em 2024 e deve crescer a um CAGR de 36,50%, superando em muito as instalações locais. Os provedores de nuvem pública abstraem a complexidade operacional de fragmentar armazenamentos vetoriais, rolar automaticamente janelas de contexto e corrigir runtimes de orquestração. As empresas gravitam em direção a endpoints gerenciados que expõem governança baseada em função enquanto escalam horizontalmente sob demanda. Padrões híbridos ainda aparecem onde dados classificados como altamente confidenciais residem em clusters privados, mas o tráfego de orquestração e inferência permanece em VPCs de nuvem. A camada de controle da Nexos.ai que roteia consultas por mais de 200 endpoints de LLM exemplifica por que as empresas preferem gateways como serviço em vez de clusters autogerenciados[7] Nexos.ai, "AI Gateway: Next-Level LLM Management for Enterprises," NEXOS.AI .

As implantações locais continuam em defesa e em certos contextos do setor público da UE, onde as regras de soberania de dados impedem o armazenamento externo. Mesmo nesses casos, os fornecedores disponibilizam appliances prontos para uso que imitam pilhas de orquestração em nuvem atrás de firewalls corporativos. O contínuo fortalecimento das zonas de nuvem soberana no Japão e na Índia reduz a hesitação entre os setores regulados, sugerindo que a participação da nuvem crescerá mesmo em ambientes historicamente dominados por implantações locais. Dadas essas tendências, os investidores esperam que os pools de lucro bruto das plataformas de nuvem se ampliem porque os serviços de orquestração com margens elevadas se vendem naturalmente como complemento aos gastos existentes em computação e armazenamento.

Por Tamanho de Organização: PMEs Impulsionam a Democratização

As pequenas e médias empresas cresceram a um impressionante CAGR de 38,10% até 2030, embora as grandes empresas ainda dominem a receita devido a tamanhos de negócios que incluem centenas de assentos de agentes e armazenamentos vetoriais em escala de terabytes. O arco de democratização se sustenta na eficiência de custos: as PMEs agora podem iniciar projetos de orquestração de nível básico por USD 20.000 a USD 60.000, um limite alcançável a partir de orçamentos operacionais em vez de CAPEX plurianual. Modelos prontos para uso para automação de marketing ou triagem de help-desk permitem que empresas menores dispensem contratações de cientistas de dados que não podem pagar. A análise da OCDE indica que as lacunas de competências permanecem o principal obstáculo à adoção, de modo que os fornecedores incorporam estúdios de orquestração de baixo código e bibliotecas de prompts integradas para reduzir as curvas de aprendizado.

As grandes empresas mantêm a liderança porque integram agentes em redes de ERP, CRM e cadeia de suprimentos, criando engajamentos de serviços de alto valor para integradores de sistemas. Elas também negociam descontos por volume em armazenamento vetorial e suporte prioritário. No entanto, à medida que as bibliotecas de modelos proliferam, o crescimento das PMEs sustentará as métricas de volume usadas pelos fornecedores de nuvem para justificar os contínuos investimentos em pesquisa e desenvolvimento em recursos de orquestração.

Por Setor do Usuário Final: Transformação do Varejo Lidera o Crescimento

TI e telecomunicações capturaram 23,40% da receita de 2024 porque as operadoras de telecomunicações precisavam de agentes autônomos de monitoramento de rede, e os terceirizadores de TI agruparam a orquestração em serviços gerenciados. O varejo e o comércio eletrônico, no entanto, impulsionarão o CAGR mais alto de 37,19%, à medida que os agentes de compras conversacionais e de precificação dinâmica demonstram ganhos imediatos de receita. A Fast Company documenta ganhos de conversão de dois dígitos para marcas que implantam concierges de compras com AI que lembram navegações anteriores, negociam descontos e preenchem automaticamente os fluxos de checkout. A adoção no setor de Serviços Bancários, Financeiros e de Seguros (BFSI) segue de perto com agentes de detecção de fraudes que cruzam padrões contextuais com latência de milissegundos. A saúde adota a orquestração para o gerenciamento de dados de ensaios clínicos apesar da sobrecarga regulatória, enquanto a manufatura aplica o planejamento autônomo à manutenção preditiva.

O tamanho do mercado de orquestração de AI agêntica para agentes de personalização no varejo deve superar USD 4 bilhões até 2030, refletindo como os ganhos de receita na linha de frente justificam os custos de implantação do sistema. A adoção industrial cresce de forma constante à medida que as fábricas instrumentam a robótica, mas a participação geral fica atrás dos setores de serviços, onde as interações digitais dominam.

Análise Geográfica

A América do Norte manteve 40,40% da receita de 2024 devido aos projetos-piloto empresariais de primeira geração e a um conjunto fragmentado de regulamentações que exige trilhas de auditoria verificáveis, empurrando os compradores em direção a pilhas de orquestração maduras dos Estados Unidos. A Ásia-Pacífico agora registra o CAGR mais acentuado de 37,89% até 2030, porque os orçamentos de AI soberana na China, no Japão e na Índia financiam orquestradores desenvolvidos localmente e otimizados para regras de conformidade locais. Os subsídios nacionais reduzem os obstáculos de aquisição, e os grandes players da manufatura retrofitam malhas de agentes em torres de controle da cadeia de suprimentos. O crescimento da Europa é estável, mas comparativamente mais lento porque o GDPR e o próximo Regulamento de AI da UE prolongam os ciclos de due diligence dos fornecedores. Ainda assim, as plataformas de origem europeia que incorporam privacidade por design ganham tração entre os setores sensíveis a dados.

A América do Sul registra adoção inicial concentrada no setor de bancos digitais do Brasil. O Oriente Médio e a África acompanham as agendas de digitalização do setor de petróleo e gás e do governo, embora as escassez de competências modere o ritmo. No geral, a expansão da APAC remodela os roteiros dos fornecedores: suporte a idiomas, adaptadores de conformidade regional e presença de data centers onshore tornam-se requisitos básicos para fornecedores globais.

Cenário Competitivo

O campo competitivo exibe fragmentação moderada. Microsoft, Google e AWS agrupam a orquestração em contas de nuvem, aproveitando âncoras de gastos existentes para vender serviços avançados de agentes como complemento. A Azure delineia um modelo de responsabilidade compartilhada que atribui a linhagem de dados ao cliente enquanto a Microsoft gerencia o runtime de orquestração, agradando às equipes de risco que desejam clareza sobre a responsabilidade por violações. Google e AWS seguem estratégias paralelas com bancos de memória gerenciados e políticas de salvaguarda. Sua escala permite preços preferenciais de GPU e aprovações de segurança nacional, ajudando-os a conquistar contas fortemente reguladas.

Os especialistas contra-atacam aprofundando a capacidade vertical. A Pinecone foca em busca vetorial de latência ultrabaixa com controles de acesso empresariais. A LangChain oferece um framework de código aberto que acelera a integração de desenvolvedores por meio de cadeias de prompts combináveis e suporta auto-hospedagem para empresas receosas de dependência da nuvem. A Mem0 AI captura conjuntos de dados onde a retenção de contexto abrange anos, como registros de clientes de gestão de patrimônio. Startups como a CrewAI Labs se diferenciam com algoritmos de planejamento iterativo que otimizam a colaboração de múltiplos agentes em fluxos de trabalho complexos.

A aquisição de USD 700 milhões da Run:ai pela NVIDIA sublinha como a orquestração não é mais uma camada de funcionalidade, mas um ponto de controle estratégico para a infraestrutura de AI[8] TechCrunch, "Nvidia Acquires AI Workload Management Startup Run:ai for USD 700 Million," TECHCRUNCH.COM . Da mesma forma, as iniciativas de protocolo aberto (A2A, MCP) empurram os fornecedores em direção à interoperabilidade, à medida que os arquitetos empresariais se rebelam contra ecossistemas fechados. A fronteira competitiva de longo prazo, portanto, depende de duas questões: quem garante a menor latência total do prompt à ação, e quem oferece a linguagem de definição de agente mais portátil que sobrevive a trocas de provedor sem reengenharia.

Líderes do Setor de Orquestração de AI Agêntica e Sistemas de Memória

-

Pinecone Inc.

-

LangChain Technologies Ltd.

-

OpenAI LLC

-

UiPath Inc.

-

ServiceNow Inc.

- *Isenção de responsabilidade: Principais participantes classificados em nenhuma ordem específica

Desenvolvimentos Recentes do Setor

- Janeiro de 2025: A Nexos.ai captou USD 8 milhões para lançar um gateway que roteia tráfego por mais de 200 LLMs comerciais e aplica políticas de segurança unificadas. O financiamento sublinha a convicção do capital de risco de que a orquestração de múltiplos modelos reduz a dependência de fornecedores e otimiza o custo por token. A estratégia centra-se em posicionar a Nexos.ai como uma camada de intermediação neutra que as empresas inserem acima dos endpoints proprietários.

- Dezembro de 2024: A NVIDIA concluiu a aquisição de USD 700 milhões da Run:ai para incorporar o agendamento de GPU e o gerenciamento de cargas de trabalho de AI diretamente nos pipelines de orquestração. A movimentação fortalece o domínio da NVIDIA sobre a pilha de inferência, oferecendo aos clientes provisionamento com um clique desde a fatia de GPU até a implantação de múltiplos agentes, o que pode desviar participação dos orquestradores de software puro que carecem de otimização de hardware.

- Novembro de 2024: A disponibilidade geral do Azure AI Agent Service da Microsoft entregou orquestração de nível empresarial mais bibliotecas de modelos para finanças, saúde e varejo. O lançamento visa reduzir os prazos de prova de conceito e consolidar o Azure como a plataforma de lançamento padrão para ambientes de agentes em produção que exigem salvaguardas de conformidade.

- Outubro de 2024: O Google introduziu o Vertex AI Memory Bank com replicação entre regiões e controles de privacidade. O lançamento ataca o ponto de dor do contexto persistente e tem como alvo clientes da UE que exigem garantias de residência de dados. A aposta do Google é que as certificações de privacidade integradas desbloquearão verticais reguladas que anteriormente hesitavam em armazenar embeddings no exterior.

- Setembro de 2024: A LangChain Technologies captou USD 25 milhões em financiamento da Série A liderado pela Sequoia Capital para fortalecer seu framework de código aberto para cargas de trabalho empresariais. Os recursos financiam itens do roteiro como controle de acesso baseado em função nativo, linhagem de versão de prompts e níveis de suporte premium, convertendo a tração da comunidade em serviços monetizáveis enquanto preserva a abertura.

Escopo do Relatório Global do Mercado de Orquestração de AI Agêntica e Sistemas de Memória

| Frameworks de Orquestração |

| Camadas de Memória / Bancos de Dados Vetoriais |

| Motores de Fluxo de Trabalho |

| SDKs de Gerenciamento de Contexto |

| Ferramentas de Observabilidade e Testes |

| Nuvem |

| Local / Auto-Hospedado |

| Grandes Empresas |

| Pequenas e Médias Empresas (PMEs) |

| TI e Telecomunicações |

| BFSI |

| Saúde e Ciências da Vida |

| Varejo e Comércio Eletrônico |

| Manufatura |

| Outros (Governo, Educação, etc.) |

| América do Norte | Estados Unidos | |

| Canadá | ||

| México | ||

| América do Sul | Brasil | |

| Argentina | ||

| Colômbia | ||

| Restante da América do Sul | ||

| Europa | Reino Unido | |

| Alemanha | ||

| França | ||

| Itália | ||

| Espanha | ||

| Rússia | ||

| Restante da Europa | ||

| Ásia-Pacífico | China | |

| Japão | ||

| Coreia do Sul | ||

| Índia | ||

| Austrália | ||

| Restante da Ásia-Pacífico | ||

| Oriente Médio e África | Oriente Médio | Arábia Saudita |

| Emirados Árabes Unidos | ||

| Restante do Oriente Médio | ||

| África | África do Sul | |

| Egito | ||

| Restante da África | ||

| Por Tipo de Solução | Frameworks de Orquestração | ||

| Camadas de Memória / Bancos de Dados Vetoriais | |||

| Motores de Fluxo de Trabalho | |||

| SDKs de Gerenciamento de Contexto | |||

| Ferramentas de Observabilidade e Testes | |||

| Por Modo de Implantação | Nuvem | ||

| Local / Auto-Hospedado | |||

| Por Tamanho de Organização | Grandes Empresas | ||

| Pequenas e Médias Empresas (PMEs) | |||

| Por Setor do Usuário Final | TI e Telecomunicações | ||

| BFSI | |||

| Saúde e Ciências da Vida | |||

| Varejo e Comércio Eletrônico | |||

| Manufatura | |||

| Outros (Governo, Educação, etc.) | |||

| Por Geografia | América do Norte | Estados Unidos | |

| Canadá | |||

| México | |||

| América do Sul | Brasil | ||

| Argentina | |||

| Colômbia | |||

| Restante da América do Sul | |||

| Europa | Reino Unido | ||

| Alemanha | |||

| França | |||

| Itália | |||

| Espanha | |||

| Rússia | |||

| Restante da Europa | |||

| Ásia-Pacífico | China | ||

| Japão | |||

| Coreia do Sul | |||

| Índia | |||

| Austrália | |||

| Restante da Ásia-Pacífico | |||

| Oriente Médio e África | Oriente Médio | Arábia Saudita | |

| Emirados Árabes Unidos | |||

| Restante do Oriente Médio | |||

| África | África do Sul | ||

| Egito | |||

| Restante da África | |||

Principais Questões Respondidas no Relatório

O que está impulsionando o rápido crescimento do mercado de orquestração de AI agêntica?

Camadas de memória persistente, implantação nativa em nuvem e arquiteturas de referência prontas para uso reduziram o risco de implementação e desbloquearam um crescimento de CAGR de 35,32% até 2030.

Qual será o tamanho do mercado de orquestração de AI agêntica até 2030?

As previsões situam o tamanho do mercado de orquestração de AI agêntica em USD 28,45 bilhões até 2030, com base no momentum sustentado de implantação empresarial.

Qual segmento de solução está se expandindo mais rapidamente?

As ferramentas de observabilidade e testes estão escalando a um CAGR de 37,45% porque os sistemas em produção precisam de monitoramento e depuração profundos.

Por que as PMEs estão adotando a AI agêntica agora?

Modelos de nuvem e estúdios de baixo código reduziram os custos de entrada para USD 20.000 a USD 60.000, ajudando as PMEs a superar lacunas de competências e implantar fluxos de trabalho de múltiplos agentes.

Qual região contribuirá com a maior receita nova?

A Ásia-Pacífico lidera com um CAGR de 37,89%, apoiada por financiamento de AI soberana e pesadas iniciativas de automação da manufatura.

Página atualizada pela última vez em: