Taille et part du marché du stockage flash d'entreprise

Analyse du marché du stockage flash d'entreprise par Mordor Intelligence

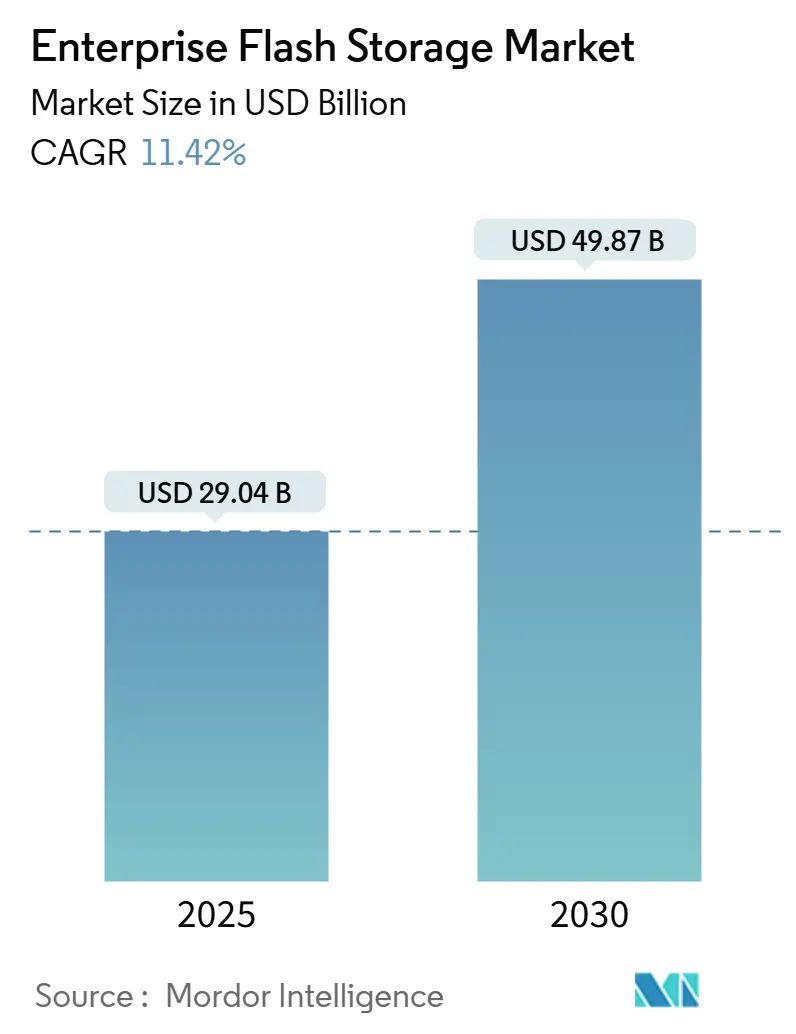

La taille du marché du stockage flash d'entreprise devrait atteindre 29,04 milliards USD en 2025 et devrait se développer à un TCAC de 11,42 % pour atteindre 49,87 milliards USD d'ici 2030. Cette croissance reflète la forte baisse du coût par bit de la mémoire NAND, la montée en puissance des charges de travail d'intelligence artificielle exigeant une latence inférieure à la milliseconde, et les stratégies de consolidation des centres de données qui récompensent une densité de baie plus élevée. Les baies tout-flash gèrent désormais des charges de travail de production mixtes à parité de coût total de possession avec les systèmes à disques, un jalon atteint lorsque le prix de la mémoire NAND QLC de qualité entreprise est tombé à 0,08 USD par Go fin 2024. Sur la période de prévision, les baies flash hybrides resteront pertinentes pour les archives de données tièdes dans les secteurs réglementés, tandis que les architectures NVMe-over-Fabrics poussent la désagrégation du stockage vers les clouds de niveau deux et les grandes entreprises. L'innovation en matière de facteur de forme, menée par les lecteurs E3.S, améliore la densité volumétrique et l'efficacité thermique, et l'intégration verticale des hyperscalers remodèle la concurrence entre fournisseurs en internalisant la conception des contrôleurs.

Points clés du rapport

- Par type de produit, les baies tout-flash ont dominé avec 69,23 % de la taille du marché du stockage flash d'entreprise en 2024, tandis que les baies flash hybrides devraient enregistrer la croissance la plus rapide avec un TCAC de 11,71 % jusqu'en 2030.

- Par protocole d'interface, NVMe a capturé 48,14 % de la taille du marché du stockage flash d'entreprise en 2024 et devrait se développer à un TCAC de 12,39 % jusqu'en 2030, le taux le plus rapide parmi tous les protocoles.

- Par facteur de forme, les lecteurs 2,5 pouces U.2/U.3 représentaient 42,86 % de la taille du marché du stockage flash d'entreprise en 2024, tandis que les lecteurs E3.S/E3.L représentent la tranche à la croissance la plus rapide avec un TCAC de 12,54 %.

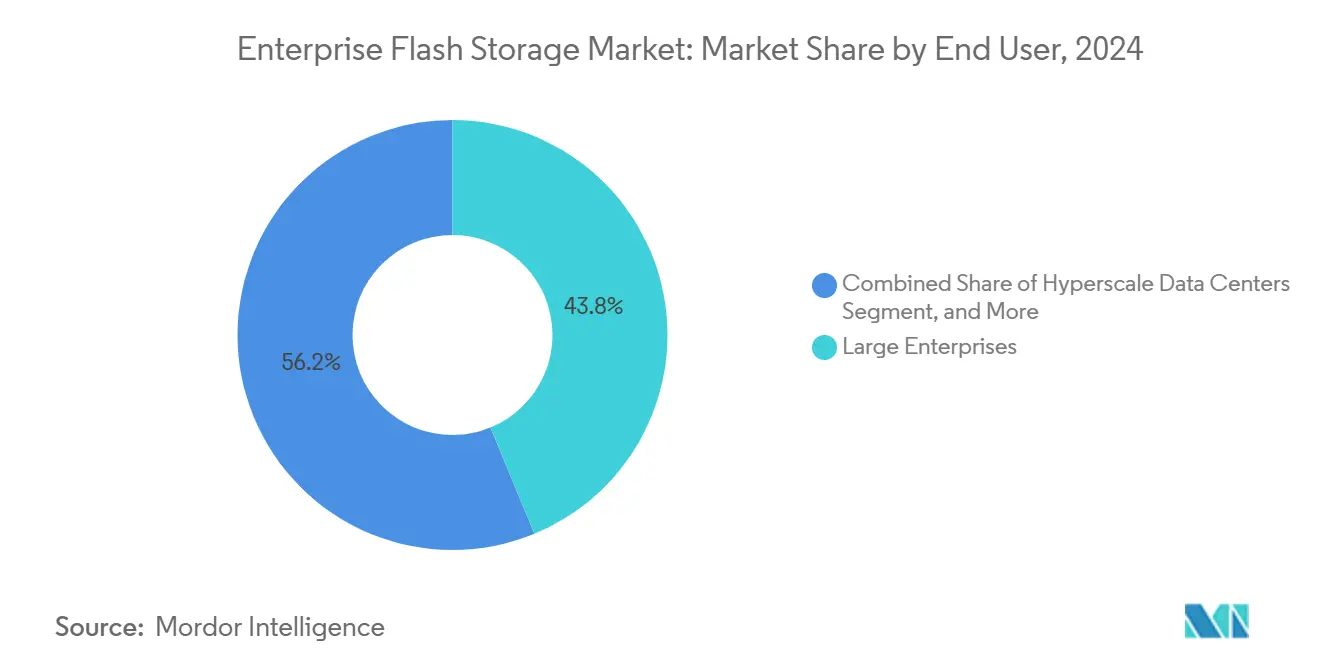

- Par utilisateur final, les grandes entreprises détenaient 43,78 % de la taille du marché du stockage flash d'entreprise en 2024 ; cependant, les centres de données hyperscale devraient progresser à un TCAC de 12,42 %, dépassant la croissance du segment.

- Par application, le traitement des bases de données et des transactions a généré 33,71 % de la taille du marché du stockage flash d'entreprise en 2024, tandis que les charges de travail d'intelligence artificielle et d'apprentissage automatique devraient progresser à un TCAC de 12,33 % jusqu'en 2030.

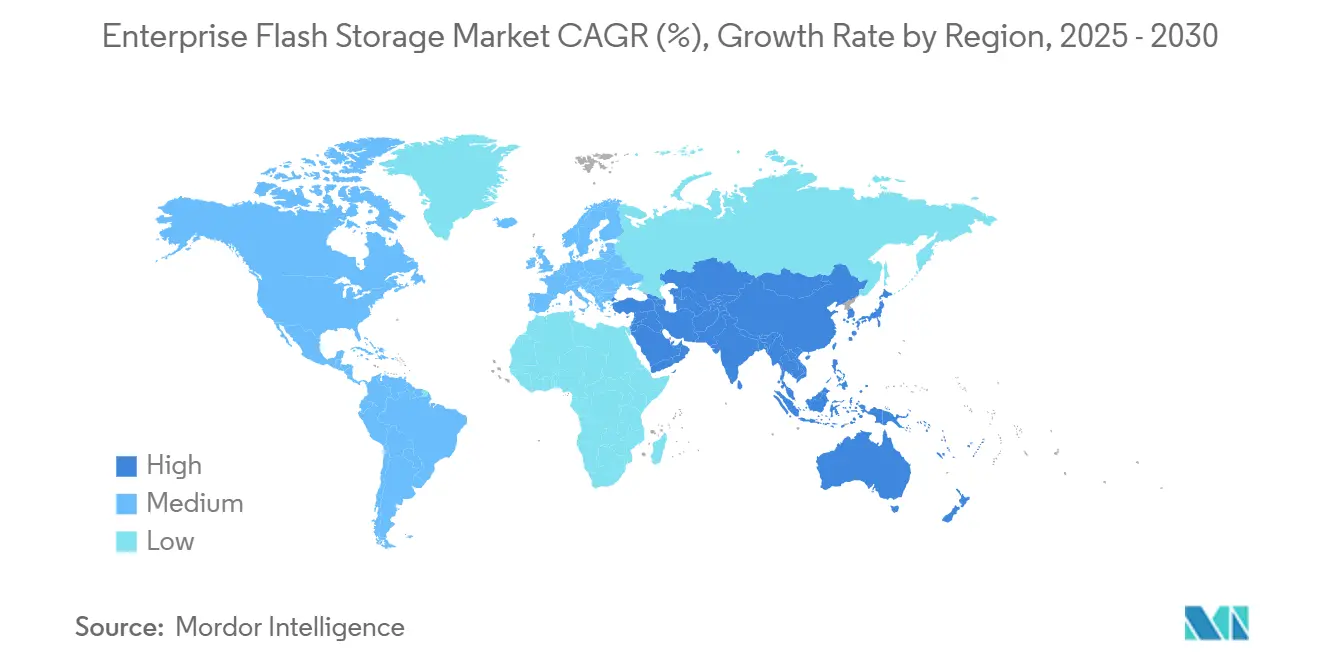

- Par géographie, l'Amérique du Nord a représenté 35,83 % de la taille du marché du stockage flash d'entreprise en 2024, tandis que l'Asie-Pacifique devrait réaliser la croissance régionale la plus élevée avec un TCAC de 12,49 % jusqu'en 2030.

Tendances et perspectives du marché mondial du stockage flash d'entreprise

Analyse de l'impact des moteurs

| Moteur | (~) % d'impact sur les prévisions de TCAC | Pertinence géographique | Horizon temporel de l'impact |

|---|---|---|---|

| Déclin rapide du coût par bit de la mémoire NAND Flash | +2.8% | Mondial, avec une adoption accélérée en Asie-Pacifique et en Amérique du Sud | Moyen terme (2 à 4 ans) |

| Exigences de performance des charges de travail activées par l'intelligence artificielle | +2.5% | Amérique du Nord et Europe en cœur, expansion vers les hyperscalers d'Asie-Pacifique | Court terme (≤ 2 ans) |

| Consolidation des centres de données et optimisation de la densité des baies | +1.9% | Mondial, concentré dans les centres de données de niveau trois en Amérique du Nord et en Europe | Moyen terme (2 à 4 ans) |

| Prolifération des écosystèmes NVMe-over-Fabrics | +1.6% | Opérateurs hyperscale en Amérique du Nord et en Asie-Pacifique, débordement vers l'Europe | Moyen terme (2 à 4 ans) |

| Impératifs de durabilité favorisant un stockage économe en énergie | +1.2% | Europe et Amérique du Nord, portées par les mandats réglementaires | Long terme (≥ 4 ans) |

| Émergence du stockage computationnel pour les baies flash en périphérie | +0.9% | Mondial, adoption précoce dans les sites périphériques des télécommunications et de la fabrication | Long terme (≥ 4 ans) |

| Source: Mordor Intelligence | |||

Déclin rapide du coût par bit de la mémoire NAND Flash

Les prix de vente moyens des SSD d'entreprise ont chuté de 23 % en glissement annuel au quatrième trimestre 2024, positionnant les baies flash en dessous des plateformes à disques durs sur le coût total de possession sur cinq ans pour les charges de travail dépassant 5 000 IOPS.[1]Samsung Electronics, "Technologie V-NAND de 9e génération," samsung.com La transition vers la mémoire NAND 3D de plus de 200 couches a doublé la densité de bits par tranche et réduit le coût de fabrication par Go de 18 %. Les organisations qui limitaient autrefois le flash aux niveaux d'accélération déploient désormais le tout-flash comme stockage primaire, réduisant la complexité de la hiérarchisation et aplanissant les valeurs aberrantes de latence. Les fournisseurs freinent les expansions de capacité pour éviter une surabondance de l'offre similaire à celle de 2019, mais la mémoire QLC représente désormais 41 % des expéditions d'entreprise, élargissant les charges de travail adressables. Les contraintes d'endurance limitent toutefois encore la mémoire QLC aux scénarios d'écriture unique et de lecture multiple, préservant une niche pour la mémoire TLC dans les bases de données à forte intensité d'écriture.

Exigences de performance des charges de travail activées par l'intelligence artificielle

L'entraînement de grands modèles de langage dépassant 100 milliards de paramètres nécessite un stockage capable d'un débit séquentiel de 400 Go/s, un seuil que les baies flash avec NVMe-over-Fabrics atteignent tandis que le stockage en réseau bloque les GPU à moins de 40 % d'utilisation.[2]Storage Networking Industry Association, "Guide de déploiement NVMe-oF 2024," snia.org Les pipelines d'inférence sensibles à la latence favorisent les supports NVMe attachés localement, incitant les hyperscalers à adopter une infrastructure composable liée via Compute Express Link fonctionnant à 64 GT/s. Les ajouts de traitement en mémoire au sein des contrôleurs NAND déchargent les tâches de compression et de filtrage, réduisant le trafic réseau de 38 % et la puissance d'inférence par requête de 22 %. Ces gains combinés élèvent le flash du niveau de performance au rang d'épine dorsale des systèmes d'intelligence artificielle au sein du marché du stockage flash d'entreprise.

Consolidation des centres de données et optimisation de la densité des baies

Les renouvellements de contrats de colocation avec des hausses de loyer supérieures à 30 % incitent les opérateurs à réduire leur empreinte en migrant vers des baies denses centrées sur le flash. Le flash offre une densité de stockage 18 fois supérieure par unité de baie par rapport aux boîtiers HDD, permettant la mise hors service de 12 baies héritées pour chaque baie E3.S et libérant de l'énergie pour les clusters GPU.[3]Open Compute Project, "Facteurs de forme EDSFF E3," opencompute.org Sur les marchés soumis à des moratoires de construction, comme Singapour, des métriques de watts par téraoctet plus faibles font pencher les achats vers le flash. Les lecteurs NVMe de Western Digital sont en veille à 0,9 W/To, réduisant la facture d'électricité annuelle de 1 340 USD par Po dans les régions facturant 0,12 USD/kWh. La consolidation stimule également l'intérêt pour la mémoire de classe stockage qui s'adapte aux emplacements DIMM, réduisant la latence à 8 µs.

Prolifération des écosystèmes NVMe-over-Fabrics

NVMe-over-Fabrics réduit la latence baie-hôte en dessous de 100 µs, soit 73 % en dessous d'iSCSI, et prend en charge la désagrégation du stockage qui s'aligne sur la mise à l'échelle de type cloud. La ratification de NVMe 2.0 avec des espaces de noms zonés a réduit l'amplification des écritures de 34 %, prolongeant la durée de vie des lecteurs. Pure Storage a quantifié des économies réseau de 47 000 USD par Po après l'élimination des commutateurs Fibre Channel dans les déploiements RDMA-over-Converged-Ethernet. Des obstacles à l'adoption persistent autour des formats de métadonnées propriétaires, mais le retour sur investissement intervient en moins de 18 mois grâce à une réduction des licences CPU et à une simplification du câblage.

Analyse de l'impact des contraintes

| Contrainte | (~) % d'impact sur les prévisions de TCAC | Pertinence géographique | Horizon temporel de l'impact |

|---|---|---|---|

| Volatilité de la chaîne d'approvisionnement dans la production de mémoire NAND Flash | -1.4% | Mondial, impact aigu dans les centres de fabrication d'Asie-Pacifique | Court terme (≤ 2 ans) |

| Dépenses d'investissement initiales élevées pour les baies flash | -1.1% | Petites et moyennes entreprises dans le monde, concentrées en Amérique du Sud et en Afrique | Moyen terme (2 à 4 ans) |

| Défis de compatibilité avec l'infrastructure héritée | -0.8% | Secteurs des services financiers et de la santé en Amérique du Nord et en Europe | Long terme (≥ 4 ans) |

| Sensibilité à la latence dans les environnements multi-locataires | -0.6% | Fournisseurs de services cloud et centres de données hyperscale dans le monde | Moyen terme (2 à 4 ans) |

| Source: Mordor Intelligence | |||

Volatilité de la chaîne d'approvisionnement dans la production de mémoire NAND Flash

Quatre fournisseurs contrôlent 87 % de la production mondiale de bits, de sorte que les catastrophes naturelles ou les tensions géopolitiques se répercutent rapidement sur les prix et les délais de livraison. Le tremblement de terre de Taïwan d'avril 2024 a fait passer les délais de livraison des SSD d'entreprise de 8 à 14 semaines, bloquant les déploiements de serveurs hyperscale et retardant 620 millions USD de revenus pour les fournisseurs. Les contrôles à l'exportation limitant les expéditions de lithographie avancée vers la Chine risquent de diviser la chaîne d'approvisionnement en nœuds technologiques divergents. Les réallocations internes — Samsung a redirigé 23 % de sa production NAND 2024 vers son propre cloud — réduisent encore davantage les approvisionnements des producteurs de baies tiers. Chaque fab de pointe nécessitant 18 milliards USD de dépenses d'investissement, les nouveaux entrants restent rares, prolongeant l'oligopole et la volatilité qui en découle.

Dépenses d'investissement initiales élevées pour les baies flash

Une baie tout-flash de 500 To avec sept ans de support est proposée entre 420 000 et 780 000 USD, soit environ 3,2 fois le prix d'un système à disques, poussant les petites entreprises vers le stockage en tant que service. Des enquêtes montrent que 64 % des entreprises indiennes et brésiliennes citent les dépenses d'investissement comme le principal obstacle au flash, tout en reconnaissant les économies sur le cycle de vie. Les modèles d'abonnement des fournisseurs abaissent les points d'entrée mais exigent encore des minimums annuels de 150 000 USD, excluant 78 % des PME. Des cycles de renouvellement plus courts — quatre à cinq ans pour le flash contre sept à huit pour les disques — augmentent les coûts de possession annualisés. Des taux de financement par crédit-bail proches de 10 % érodent les économies opérationnelles pour les entreprises pouvant autofinancer des alternatives à disques moins coûteuses.

Analyse des segments

Par type de produit : les baies hybrides réémergent comme équilibreurs de coûts

Les baies tout-flash ont dominé les revenus avec une part de marché du stockage flash d'entreprise de 69,23 % en 2024, reflétant leur primauté dans les environnements de virtualisation et de bases de données critiques en termes de latence. Les baies hybrides, cependant, devraient croître à un taux composé de 11,71 % jusqu'en 2030, ancrées par les archives de conformité dans la finance et la santé qui exigent une rétention pluriannuelle tout en tolérant la latence des disques rotatifs. Les algorithmes de hiérarchisation automatisée prédisent désormais la température des données avec une précision de 91 %, garantissant que les données chaudes restent sur le flash. La sensibilité aux coûts dans les marchés émergents et les mandats de durabilité qui favorisent les HDD à faible consommation dans les niveaux tièdes soutiennent l'adoption des baies hybrides. Les fournisseurs positionnés sur les deux architectures bénéficient des clients qui mélangent performance et capacité dans un seul châssis.

Le marché du stockage flash d'entreprise continue de débattre d'un avenir exclusivement flash, mais les responsables des applications de niveau un restent réticents à confier les référentiels d'archives au flash lorsque les disques durs offrent un coût par To inférieur de 60 %. La gamme FAS renouvelée de NetApp démontre comment la hiérarchisation par apprentissage automatique peut coexister avec les services de données ONTAP, tandis que les fournisseurs purement tout-flash se concentrent sur la tarification basée sur les services pour contrer l'avantage initial des baies hybrides. Sur la période de prévision, le tout-flash devrait absorber les charges de travail OLTP et d'entraînement d'intelligence artificielle supplémentaires, tandis que les baies hybrides défendront la croissance des archives à long terme.

Par protocole d'interface : NVMe déplace SCSI

NVMe détenait 48,14 % des revenus en 2024 et est projeté à un TCAC de 12,39 % grâce à son architecture à 64 000 files d'attente qui supprime les goulots d'étranglement SCSI qui limitaient auparavant l'utilisation des SSD. Les protocoles SAS et SATA hérités persistent dans les cycles de remplacement, tandis que le Fibre Channel hérite de 18 % des revenus des réseaux SAN critiques où la stabilité prime sur la vitesse brute. La convergence Ethernet s'accélère à mesure que les cartes réseau compatibles RDMA tombent en dessous de 400 USD, amplifiant l'adoption de NVMe-over-TCP. La taille du marché du stockage flash d'entreprise liée aux déploiements NVMe devrait dépasser 25 milliards USD d'ici 2030, soutenue par la préférence des hyperscalers pour l'uniformité des protocoles sur les structures de calcul et de stockage.

La mémoire de classe stockage Compute Express Link émergente promet des niveaux inférieurs à la microseconde, mais le jeu de commandes simplifié de NVMe et les gains de déchargement CPU garantissent sa longévité. Les fournisseurs exposent désormais des espaces de noms zonés pour le contrôle de l'amplification des écritures, intégrant les applications à la gestion des supports et libérant 14 % de la surcharge de cache auparavant consacrée à la collecte des déchets. L'interopérabilité reste un point de friction ; les métadonnées propriétaires peuvent enfermer les clients dans des écosystèmes à fournisseur unique jusqu'à ce que les normes se stabilisent.

Par facteur de forme : les lecteurs EDSFF élèvent la densité

Le standard 2,5 pouces U.2/U.3 a conservé 42,86 % de part en 2024, en raison de la compatibilité ascendante avec les serveurs existants. Les lecteurs E3.S et E3.L, cependant, se développent à un TCAC de 12,54 %, offrant une densité volumétrique supérieure de 30 % et une puissance de conception thermique par To inférieure de 18 %. Le lecteur E3.S de 61,44 To d'Intel permet des nœuds de 1 Po dans des serveurs 1U, remodelant l'économie des baies. La taille du marché du stockage flash d'entreprise attribuée aux lecteurs E3 devrait atteindre 9 milliards USD d'ici 2030. L'adoption est en retard dans les sites existants en attente de renouvellements de cartes mères, maintenant la domination du format U.2 jusqu'en 2027.

Les modules M.2 prospèrent en périphérie où les priorités d'encombrement éclipsent les exigences de capacité, et les cartes d'extension PCIe satisfont les systèmes de trading à latence inférieure à 10 µs. Les modules DIMM de mémoire de classe stockage fournissent une latence de 8 µs pour l'analytique en mémoire mais affichent un prix 4,2 fois supérieur à celui de NVMe, limitant leur portée aux charges de travail en temps réel de niche. Collectivement, ces choix ajoutent de la complexité aux feuilles de route des fournisseurs mais permettent aux acheteurs d'optimiser la puissance, la capacité ou la latence dans des environnements hétérogènes.

Par utilisateur final : les hyperscalers étendent la courbe

Les grandes entreprises ont généré 43,78 % des revenus de 2024, tirant parti de charges de travail diversifiées et de remises négociées. Les hyperscalers, se développant à un TCAC de 12,42 %, internalisent la propriété intellectuelle des contrôleurs pour réduire les coûts par To de 27 % et adapter le micrologiciel aux profils d'application. La taille du marché du stockage flash d'entreprise liée aux petites et moyennes entreprises s'oriente vers des modèles d'abonnement qui transforment les dépenses d'investissement en dépenses opérationnelles, mais les seuils d'éligibilité limitent la pénétration. Les gouvernements et la défense restent régis par les mandats FIPS 140-3 qui contraignent les options des fournisseurs.

Les hyperscalers achètent en pods de plus de 500 unités, obtenant des remises importantes qui se répercutent sur les fournisseurs de puces marchandes. En revanche, les acheteurs d'entreprise maintiennent des parcs hétérogènes auprès de quatre à sept fournisseurs, fragmentant le levier de négociation et maintenant des prix de vente moyens plus élevés. À mesure que les politiques de cloud souverain se multiplient, les déploiements hyperscale régionaux dépasseront les cycles de renouvellement des entreprises, déplaçant progressivement les revenus de l'ouest vers l'est.

Note: Les parts de segment de tous les segments individuels sont disponibles à l'achat du rapport

Par application : l'intelligence artificielle et l'apprentissage automatique stimulent la demande de débit

Les bases de données ont contribué à 33,71 % des revenus en 2024, validant les racines du flash dans les environnements OLTP à forte intensité d'IOPS. Les charges de travail d'intelligence artificielle et d'apprentissage automatique, cependant, enregistreront un TCAC de 12,33 % jusqu'en 2030, à mesure que les ensembles d'entraînement dépassent 10 Po et que les latences d'inférence tombent à la milliseconde. Le marché du stockage flash d'entreprise s'est donc orienté vers des baies avec une structure 100 GbE, un déchargement RDMA et des pipelines de données optimisés pour les GPU. L'infrastructure de bureau virtuel valorise toujours la faible latence de queue du flash pour survivre aux tempêtes de démarrage, tandis que le calcul haute performance favorise la bande passante séquentielle, rendant la mémoire QLC attrayante pour les espaces de travail pétascale moins coûteux.

L'analytique en temps réel ingère des flux d'écriture de 50 Go/s tout en servant des requêtes de tableau de bord, sollicitant l'endurance ; par conséquent, le surprovisionnement augmente à 30 % pour préserver la durée de vie des lecteurs sur cinq ans. Les exigences des applications influencent la préférence en matière de facteur de forme : les clusters d'intelligence artificielle gravitent vers les lecteurs E3.S attachés localement pour un nombre de sauts minimal, tandis que les déploiements de bases de données acceptent une infrastructure NVMe-oF partagée pour la cohérence transactionnelle.

Analyse géographique

L'Amérique du Nord a maintenu une part de 35,83 % en 2024 grâce aux expansions des hyperscalers en Virginie, en Oregon et au Texas, où l'énergie à moins de 0,07 USD/kWh et les échanges internet denses prévalent. Les clusters d'entraînement d'intelligence artificielle ont consommé 47 % des expéditions régionales de flash, et les agences fédérales ont accéléré les migrations sur site après des événements de cybersécurité. Les mandats du Département de l'énergie pour des PUE inférieurs à 1,4 favorisent également le flash pour sa faible consommation en watts par To. Les règles de résidence des données au Canada dispersent l'infrastructure entre les provinces, atténuant légèrement les avantages de densité, tandis que le boom de la délocalisation au Mexique installe des baies hybrides pour la télémétrie de fabrication.

L'Asie-Pacifique est prévue pour un TCAC de 12,49 % et dépassera l'Amérique du Nord en capacité incrémentale d'ici 2029. Le plan de double circulation de la Chine canalise 47 milliards USD dans les lignes de semi-conducteurs nationales, tandis que l'incitation liée à la production de l'Inde alloue 2,3 milliards USD à l'électronique, ancrant les usines locales de contrôleurs et d'emballage. Alibaba et Tencent ont déployé 8,7 exaoctets de flash en 2024, et les méga-banques japonaises migrent vers des baies NVMe pour l'analytique de détection de fraude en temps réel. La Corée du Sud tire parti de son approvisionnement captif en NAND pour proposer des prix inférieurs à ceux des fournisseurs étrangers. La dichotomie australienne entre l'hyperscale côtier et la télémétrie minière intérieure se poursuit, tandis que l'Asie du Sud-Est se concentre sur les modèles d'abonnement pour l'accessibilité des PME.

L'Europe équilibre la souveraineté numérique avec des réglementations énergétiques fixant des objectifs de PUE inférieurs à 1,3 d'ici 2030. Les usines Industrie 4.0 d'Allemagne exigent une latence de stockage de 10 ms, et les salles de marché du Royaume-Uni renouvellent leurs baies NVMe pour un basculement sans intervention. L'initiative de cloud souverain de la France augmente les coûts de construction nationaux de 23 %, mais sécurise la résidence des données. Les déploiements russes s'appuient sur la mémoire NAND chinoise à 128 couches dans un contexte de contrôles à l'exportation. L'Arabie Saoudite et les Émirats arabes unis investissent dans des clouds souverains, NEOM budgétisant 1,2 exaoctet pour la télémétrie des villes intelligentes. Le secteur financier d'Afrique du Sud et l'agrotechnologie du Brésil mènent l'adoption ailleurs.

Paysage concurrentiel

La concentration des revenus est modérée : les cinq plus grands fournisseurs ont capturé 61 % en 2024, mais la concurrence s'intensifie à mesure que les hyperscalers internalisent la propriété intellectuelle des contrôleurs et banalisent le matériel des baies. Les fabricants d'équipements d'origine défendent leurs parts grâce à des abonnements qui découplent la capacité du renouvellement du matériel, maintenant des marges brutes proches de 58 %. Les couches définies par logiciel abstraient désormais les lecteurs banalisés, tandis que les fournisseurs de NAND captifs comme Samsung exploitent l'intégration verticale pour proposer des prix 19 % inférieurs à ceux de leurs pairs. Le stockage computationnel différencie les nouveaux entrants NGD Systems et ScaleFlux, dont l'exécution de requêtes in situ réduit la latence analytique de 47 %. Les fournisseurs vantent des garanties de réduction des données de 4 pour 1 et une télémétrie de santé des lecteurs basée sur l'intelligence artificielle, déposant en 2024 des brevets pour les métadonnées NVMe-oF et le nivellement de l'usure.

Les dynamiques régionales comptent : Huawei et Inspur détiennent ensemble 34 % de part en Chine mais font face à des restrictions occidentales ; Fujitsu et Hitachi Vantara conservent des positions dans les gouvernements et la finance japonais malgré des primes de coût de 20 %. Les marques axées sur les PME privilégient le prix aux fonctionnalités, offrant des services de données minimaux. Les tendances à la désagrégation menacent d'éroder l'économie du regroupement matériel-logiciel, tandis que les coûts de certification FIPS 140-3 dissuadent les nouveaux entrants dans le secteur de la défense.

Leaders du secteur du stockage flash d'entreprise

Pure Storage Inc.

NetApp Inc.

Dell Technologies Inc.

Hewlett Packard Enterprise Company

International Business Machines Corporation

- *Avis de non-responsabilité : les principaux acteurs sont triés sans ordre particulier

Développements récents du secteur

- Septembre 2025 : Samsung Electronics a lancé la production en masse de mémoire V-NAND à 286 couches offrant des SSD de 122,88 To au format 2,5 pouces.

- Août 2025 : Pure Storage s'est associé à NVIDIA pour intégrer FlashArray avec DGX SuperPOD, maintenant un débit de 2 To/s pour l'entraînement de grands modèles de langage.

- Juillet 2025 : Micron Technology a achevé une expansion d'usine à Singapour de 3,7 milliards USD ajoutant une capacité NAND à 232 couches pour la production du premier trimestre 2026.

- Juin 2025 : NetApp a publié ONTAP 10.2 avec une hiérarchisation guidée par l'intelligence artificielle et une prise en charge améliorée de NVMe-oF RDMA.

Portée du rapport mondial sur le marché du stockage flash d'entreprise

Le rapport sur le marché du stockage flash d'entreprise est segmenté par type de produit (baies tout-flash, baies flash hybrides), protocole d'interface (SCSI à connexion série, Serial ATA, mémoire express non volatile, Fibre Channel, Ethernet), facteur de forme (lecteurs 2,5 pouces U.2/U.3, lecteurs M.2, cartes d'extension PCI Express, lecteurs E3.S/E3.L, modules de mémoire de classe stockage), utilisateur final (grandes entreprises, petites et moyennes entreprises, fournisseurs de services cloud, centres de données hyperscale, gouvernement et défense), application (traitement des bases de données et des transactions, virtualisation et VDI, intelligence artificielle et apprentissage automatique, calcul haute performance, analytique en temps réel), et géographie (Amérique du Nord, Europe, Asie-Pacifique, Moyen-Orient et Afrique, Amérique du Sud). Les prévisions du marché sont fournies en termes de valeur (USD).

| Baies tout-flash (AFA) |

| Baies flash hybrides (HFA) |

| SCSI à connexion série (SAS) |

| Serial ATA (SATA) |

| Mémoire express non volatile (NVMe) |

| Fibre Channel |

| Ethernet (iSCSI, NVMe-oF/TCP, RDMA) |

| Lecteurs 2,5 pouces U.2/U.3 |

| Lecteurs M.2 |

| Cartes d'extension PCI Express |

| Lecteurs E3.S/E3.L |

| Modules de mémoire de classe stockage |

| Grandes entreprises |

| Petites et moyennes entreprises |

| Fournisseurs de services cloud |

| Centres de données hyperscale |

| Gouvernement et défense |

| Traitement des bases de données et des transactions |

| Virtualisation et VDI |

| Intelligence artificielle et apprentissage automatique |

| Calcul haute performance |

| Analytique en temps réel |

| Amérique du Nord | États-Unis | |

| Canada | ||

| Mexique | ||

| Europe | Allemagne | |

| Royaume-Uni | ||

| France | ||

| Russie | ||

| Reste de l'Europe | ||

| Asie-Pacifique | Chine | |

| Japon | ||

| Inde | ||

| Corée du Sud | ||

| Australie | ||

| Reste de l'Asie-Pacifique | ||

| Moyen-Orient et Afrique | Moyen-Orient | Arabie Saoudite |

| Émirats arabes unis | ||

| Reste du Moyen-Orient | ||

| Afrique | Afrique du Sud | |

| Égypte | ||

| Reste de l'Afrique | ||

| Amérique du Sud | Brésil | |

| Argentine | ||

| Reste de l'Amérique du Sud | ||

| Par type de produit | Baies tout-flash (AFA) | ||

| Baies flash hybrides (HFA) | |||

| Par protocole d'interface | SCSI à connexion série (SAS) | ||

| Serial ATA (SATA) | |||

| Mémoire express non volatile (NVMe) | |||

| Fibre Channel | |||

| Ethernet (iSCSI, NVMe-oF/TCP, RDMA) | |||

| Par facteur de forme | Lecteurs 2,5 pouces U.2/U.3 | ||

| Lecteurs M.2 | |||

| Cartes d'extension PCI Express | |||

| Lecteurs E3.S/E3.L | |||

| Modules de mémoire de classe stockage | |||

| Par utilisateur final | Grandes entreprises | ||

| Petites et moyennes entreprises | |||

| Fournisseurs de services cloud | |||

| Centres de données hyperscale | |||

| Gouvernement et défense | |||

| Par application | Traitement des bases de données et des transactions | ||

| Virtualisation et VDI | |||

| Intelligence artificielle et apprentissage automatique | |||

| Calcul haute performance | |||

| Analytique en temps réel | |||

| Par géographie | Amérique du Nord | États-Unis | |

| Canada | |||

| Mexique | |||

| Europe | Allemagne | ||

| Royaume-Uni | |||

| France | |||

| Russie | |||

| Reste de l'Europe | |||

| Asie-Pacifique | Chine | ||

| Japon | |||

| Inde | |||

| Corée du Sud | |||

| Australie | |||

| Reste de l'Asie-Pacifique | |||

| Moyen-Orient et Afrique | Moyen-Orient | Arabie Saoudite | |

| Émirats arabes unis | |||

| Reste du Moyen-Orient | |||

| Afrique | Afrique du Sud | ||

| Égypte | |||

| Reste de l'Afrique | |||

| Amérique du Sud | Brésil | ||

| Argentine | |||

| Reste de l'Amérique du Sud | |||

Questions clés auxquelles le rapport répond

Quelle est la valeur projetée du marché du stockage flash d'entreprise en 2030 ?

Les prévisions placent le marché à 49,87 milliards USD d'ici 2030 sur la base d'un TCAC de 11,42 %.

Quel type de produit se développe le plus rapidement ?

Les baies flash hybrides sont prévues pour la croissance la plus rapide, enregistrant un TCAC de 11,71 % jusqu'en 2030.

Pourquoi NVMe supplante-t-il les protocoles de stockage hérités ?

Les files d'attente à 64 000 niveaux de NVMe et la réduction de la surcharge CPU élèvent l'utilisation des lecteurs et réduisent la latence des applications, entraînant un TCAC de 12,39 %.

Comment l'Asie-Pacifique influencera-t-elle la demande future ?

Les incitations régionales pour la capacité nationale de semi-conducteurs et les déploiements hyperscale propulsent l'Asie-Pacifique à un TCAC de 12,49 %, le plus rapide au niveau mondial.

Quelle contrainte clé limite l'adoption du flash parmi les PME ?

Les dépenses d'investissement initiales élevées — de 420 000 à 780 000 USD pour une baie de 500 To — orientent les petites entreprises vers des modèles de stockage en tant que service.

Quelle technologie émergente pourrait redéfinir l'efficacité du stockage ?

Le stockage computationnel qui exécute le filtrage des données à l'intérieur des contrôleurs SSD peut réduire le trafic réseau de 38 % pour les charges de travail de recommandation d'intelligence artificielle.

Dernière mise à jour de la page le: