Taille et Part du Marché des Centres de Données Optimisés par l'Intelligence Artificielle (IA) en Asie Pacifique

Analyse du Marché des Centres de Données Optimisés par l'Intelligence Artificielle (IA) en Asie Pacifique par Mordor Intelligence

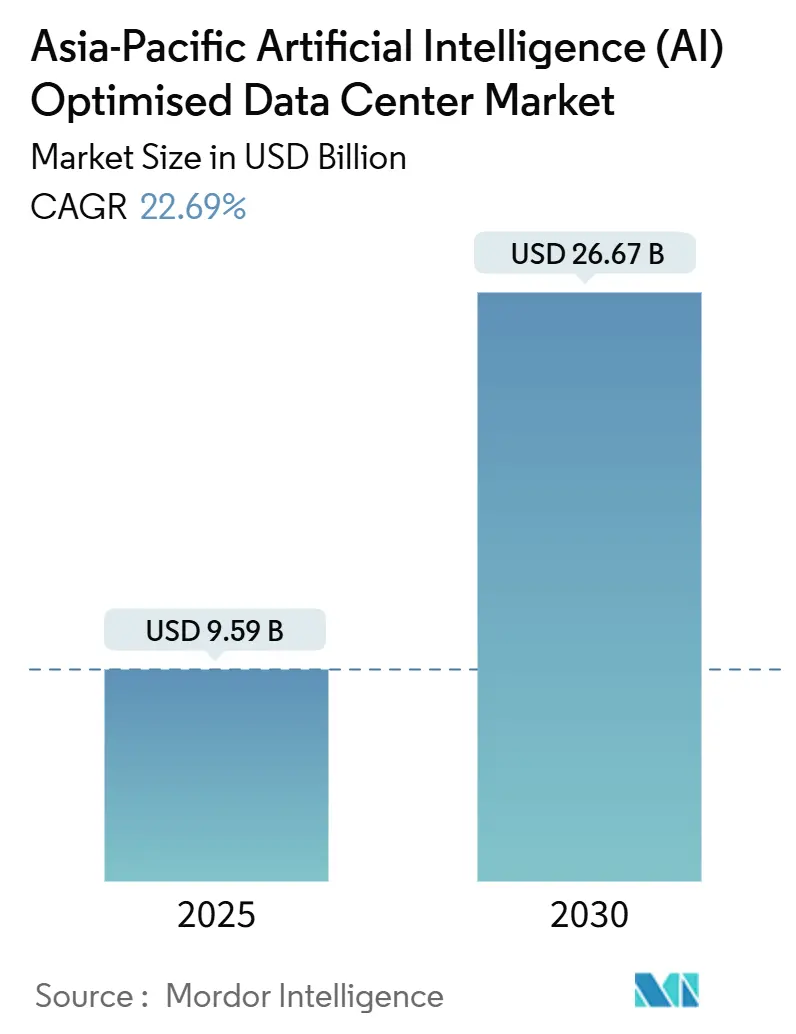

Le marché des centres de données d'intelligence artificielle en Asie Pacifique est évalué à 9,59 milliards USD en 2025 et, avec un CAGR de 22,69%, devrait atteindre 26,67 milliards USD d'ici 2030, soulignant la plus forte expansion quinquennale jamais observée dans les dépenses d'infrastructure numérique régionale. Les opérateurs cloud hyperscale continuent d'ancrer la demande, mais la législation sur l'IA souveraine, l'incertitude liée aux contrôles des exportations et le saut de densité thermique lié aux charges de travail d'IA générative redéfinissent le choix des sites, les solutions de refroidissement et les stratégies d'approvisionnement en énergie. Au cours des cinq prochaines années, les modernisations avec refroidissement liquide devraient dépasser la construction de nouvelles salles refroidies par air, tandis que les durées de pré-location en colocation s'allongent à mesure que les banques et les agences du secteur public s'empressent de sécuriser des capacités GPU domestiques. Les accords d'achat d'énergie régionaux attachent de plus en plus des garanties d'énergie renouvelable pour couvrir les pénuries de transformateurs dans les villes indiennes de niveau 2, et les primes de talents pour les ingénieurs d'infrastructure qualifiés en IA restent 35 à 50% supérieures aux rôles traditionnels, cimentant la disponibilité de la main-d'œuvre comme facteur de risque au niveau du conseil d'administration. En conséquence, les opérateurs capables d'associer des certifications de cloud souverain à un refroidissement avancé et des blocs de mégawatts dédiés sont en position de capter la plus grande part de la prochaine vague de croissance.

Points Clés du Rapport

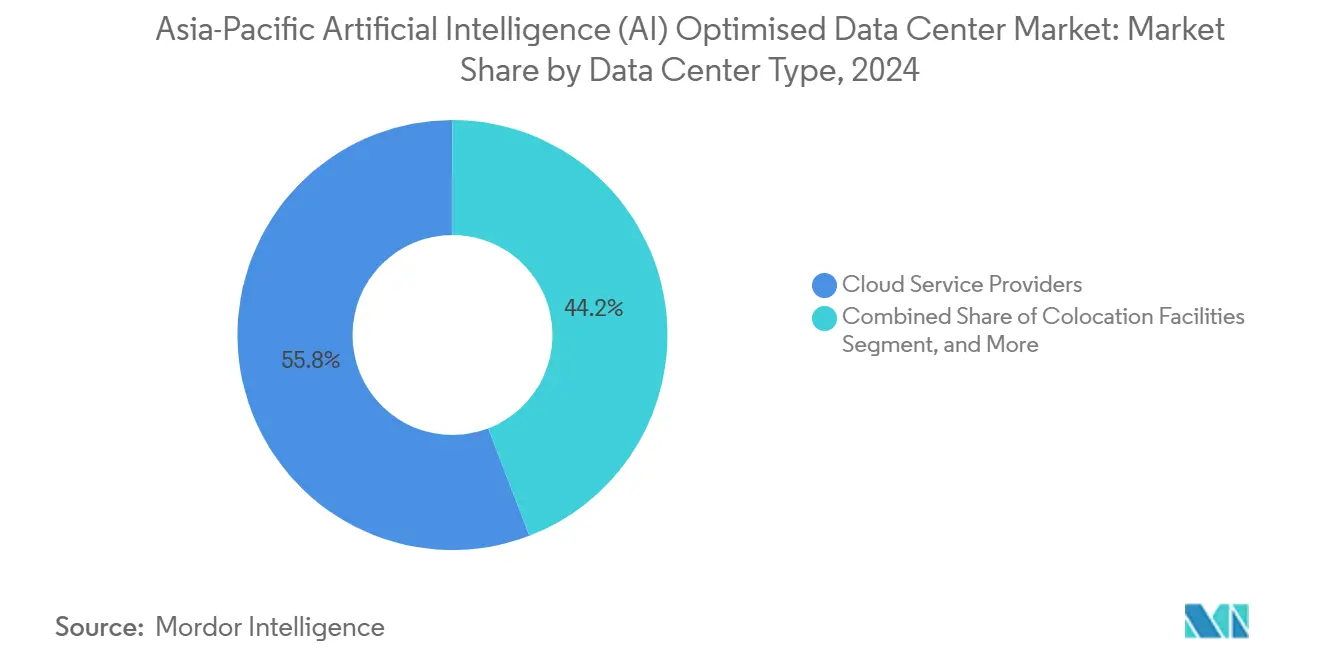

- Par type de centre de données, les fournisseurs de cloud hyperscale ont mené avec une part de marché de 55,82% dans le marché des centres de données d'intelligence artificielle en Asie Pacifique en 2024, tandis que les installations de colocation sont en bonne voie pour un CAGR de 24,23% jusqu'en 2030.

- Par composant, les logiciels détenaient 45,83% de la taille du marché des centres de données d'intelligence artificielle en Asie Pacifique en 2024, tandis que l'infrastructure matérielle devrait se développer à un CAGR de 23,67% jusqu'en 2030.

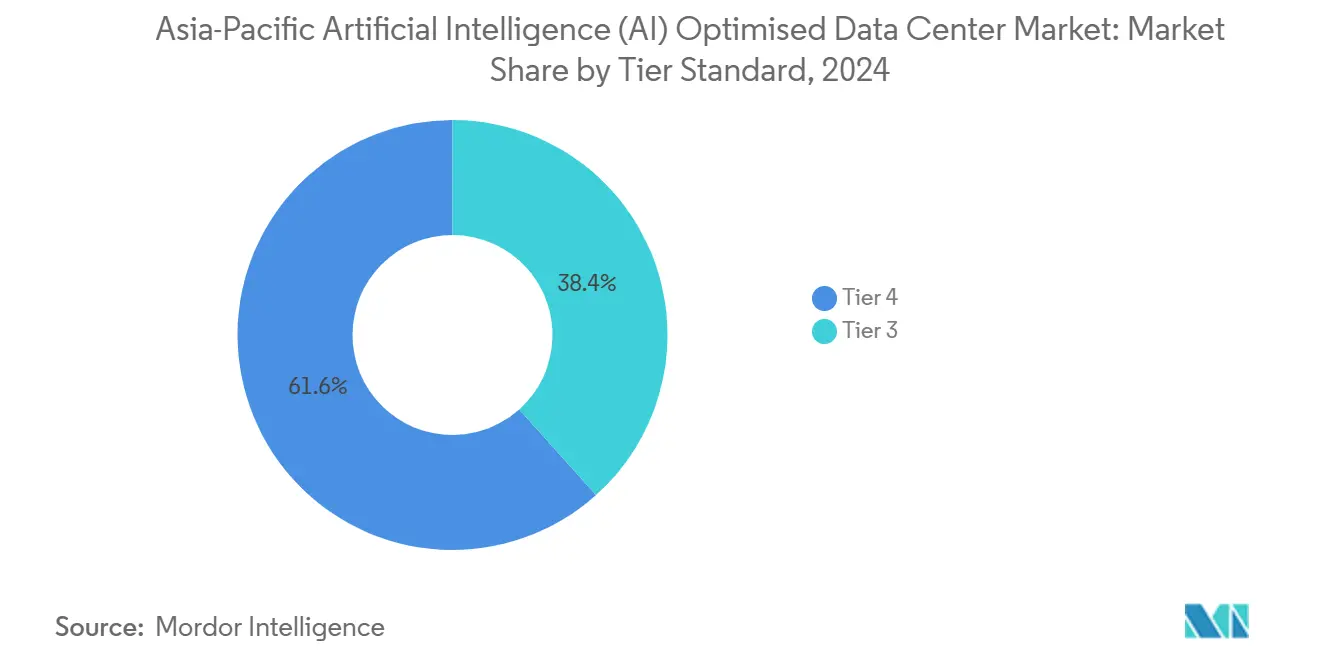

- Par norme de niveau, les installations de Niveau IV commandaient 61,63% de la taille du marché des centres de données d'intelligence artificielle en Asie Pacifique en 2024 ; les installations de Niveau III progressent à un CAGR de 24,77%.

- Par secteur d'utilisation final, l'informatique et les services informatiques représentaient 33,82% de la taille du marché des centres de données d'intelligence artificielle en Asie Pacifique en 2024, tandis qu'internet et les médias numériques affichent le CAGR le plus élevé de 23,45% jusqu'en 2030.

Tendances et Perspectives du Marché des Centres de Données Optimisés par l'Intelligence Artificielle (IA) en Asie Pacifique

Analyse de l'Impact des Facteurs Moteurs

| Facteur Moteur | (~) % d'Impact sur les Prévisions du CAGR | Pertinence Géographique | Calendrier d'Impact |

|---|---|---|---|

| Développements hyperscale cloud en Asie du Sud-Est | +4.2% | Noyau de l'Asie du Sud-Est, débordement vers l'Inde | Moyen terme (2-4 ans) |

| Subventions gouvernementales pour le calcul IA en Chine et en Corée du Sud | +5.8% | Chine et Corée du Sud, contagion des politiques vers l'ASEAN | Court terme (≤ 2 ans) |

| Modernisation par l'IA des installations existantes vers le refroidissement liquide | +3.1% | Mondial, concentré sur les méga-sites côtiers | Moyen terme (2-4 ans) |

| Trafic d'inférence d'IA générative en hausse aux nœuds de périphérie télécom | +2.9% | Noyau APAC, gains précoces au Japon, Singapour | Court terme (≤ 2 ans) |

| Clusters GPU sur site des fabricants keiretsu japonais | +1.8% | Centré sur le Japon, débordement régional limité | Long terme (≥ 4 ans) |

| Mandats d'IA souveraine accélérant la pré-location de colocation en ASEAN | +4.5% | Marchés ASEAN, influence réglementaire en expansion | Moyen terme (2-4 ans) |

| Source: Mordor Intelligence | |||

Les subventions gouvernementales pour le calcul IA accélèrent l'infrastructure

Le programme IA de 7 milliards USD de la Corée du Sud, 400% au-dessus des budgets d'infrastructure précédents, dirige 60% des fonds vers des ajouts de capacité domestique, comprimant les délais de construction à moins de 18 mois. L'exigence de la Chine que 80% des charges de travail d'entraînement IA restent en territoire national d'ici 2026 a produit les taux de pré-location en colocation les plus élevés de la région et a propulsé la constitution de stocks de GPU pour couvrir le risque lié aux contrôles des exportations. À travers l'ASEAN, des mandats similaires font augmenter les primes de cloud souverain de 25 à 30%, en particulier à Singapour, où les installations certifiées affichent déjà le taux de vacance le plus bas en Asie.

Les développements hyperscale cloud restructurent l'infrastructure en Asie du Sud-Est

Le plan de 3 milliards USD de Google pour la Thaïlande et la Malaisie confirme l'avantage que ces marchés détiennent sur les réseaux électriques par rapport aux pôles traditionnels, tandis que la région cloud souveraine indonésienne de Microsoft à 1,7 milliard USD positionne l'entreprise en avance sur l'échéance de localisation des données de Jakarta en 2025. Chaque hyperscaler nécessite des blocs de transformateurs de niveau parcellaire de 100 MW ou plus, ce qui incite à choisir des emplacements dans des parcs industriels capables de contourner les files d'attente urbaines sur le réseau électrique.

Modernisation par l'IA des installations existantes vers le refroidissement liquide

Les racks d'IA générative fonctionnent 3 à 4 fois plus chaud que les serveurs conventionnels, obligeant les opérateurs à recourir au refroidissement direct vers la puce pour maintenir le PUE en dessous de 1,3. NTT rapporte que 40% de toutes les nouvelles capacités japonaises mises en service en 2024 intègrent déjà le refroidissement liquide. L'économie de la modernisation favorise les salles existantes disposant d'une charge au sol et d'une capacité de chemin de câbles suffisantes, réduisant la consommation d'énergie par rack de 15 à 20% et doublant la densité sans les délais d'une construction sur terrain vierge.

Trafic d'inférence d'IA générative en hausse aux nœuds de périphérie télécom

Les déploiements de calcul de périphérie à accès multiple 5G déplacent l'inférence IA plus près des utilisateurs, réduisant la latence et déchargeant la bande passante du réseau dorsal. Le Japon et Singapour sont les premiers adoptants, superposant chacun des clusters GPU à faible empreinte dans les hôtels d'opérateurs pour servir des services de traduction en temps réel, de commerce de détail immersif et de navigation en réalité augmentée. La stratégie libère les régions hyperscale pour les tâches d'entraînement tout en générant de nouvelles courbes de demande en micro-colocation.

Analyse de l'Impact des Facteurs de Restriction

| Facteur de Restriction | (~) % d'Impact sur les Prévisions du CAGR | Pertinence Géographique | Calendrier d'Impact |

|---|---|---|---|

| Pénuries aiguës d'énergie de qualité transformateur dans les villes indiennes de niveau 2 | -2.1% | Villes indiennes de niveau 2, lacunes d'infrastructure réseau | Court terme (≤ 2 ans) |

| Contrôles des exportations d'ASIC/GPU impactant les délais d'approvisionnement | -3.4% | Chine en premier lieu, effets secondaires dans toute l'APAC | Moyen terme (2-4 ans) |

| Restrictions croissantes sur les prises d'eau de mer aux méga-sites côtiers | -1.6% | Installations côtières à Singapour, au Japon, en Australie | Long terme (≥ 4 ans) |

| Pénurie de talents pour les ingénieurs en logiciels DC-IM optimisés par l'IA | -2.8% | Régional, critique à Singapour, Séoul, Tokyo | Moyen terme (2-4 ans) |

| Source: Mordor Intelligence | |||

Les pénuries d'infrastructure électrique contraignent l'expansion dans les villes de niveau 2

À Pune, Hyderabad et Chennai, les allocations du réseau électrique sont inférieures à la demande des centres de données de jusqu'à 40%, repoussant les délais de raccordement au-delà de 18 mois et contraignant les développeurs à adopter des structures d'accord d'achat d'énergie renouvelable plus coûteuses. Bien que l'énergie verte améliore les profils d'émissions, les dépenses d'investissement supplémentaires gonflent les seuils de TRI des projets de jusqu'à 300 points de base.

Les contrôles des exportations d'ASIC/GPU impactent les délais d'approvisionnement

Les restrictions sur les accélérateurs avancés allongent les fenêtres de livraison à 6 à 12 mois, incitant les entreprises chinoises à augmenter leurs volumes de commandes sur site de 180% d'une année sur l'autre. Les acheteurs japonais diversifient désormais leurs achats vers des fabricants de puces domestiques offrant 60 à 70% des performances de premier ordre à un coût inférieur de 40%, mais au détriment de la fragmentation de la pile logicielle et des retards de validation.

Analyse des Segments

Par type de centre de données : La croissance de la colocation éclipse les normes historiques

Les installations de colocation ont capté 28,35% des dépenses mais se développeront à un CAGR de 24,23%, éclipsant la croissance hyperscale à mesure que les règles d'IA souveraine rendent le contrôle des racks domestiques obligatoire pour les banques, les assureurs et les ministères gouvernementaux. Les hyperscalers conservent une avance de 55,82%, mais leur part de marché des centres de données d'intelligence artificielle en Asie Pacifique a plafonné à mesure que les nœuds sur site et de périphérie prolifèrent. Les opérateurs de colocation qui pré-provisionnent le refroidissement liquide et des blocs de transformateurs de 20+ MW remportent des pré-locations disproportionnées, en particulier à Singapour et à Kuala Lumpur où les plafonds fonciers limitent l'échelle sur terrain vierge. Les déploiements en entreprise et en périphérie, favorisés par les keiretsu japonais, absorbent le risque lié aux contrôles des exportations en conservant la garde physique des GPU. La taille du marché des centres de données d'intelligence artificielle en Asie Pacifique liée aux nœuds sur site d'entreprise dépassera 3 milliards USD d'ici 2030, reflétant une diversification soutenue par rapport au cloud public. Sur l'horizon de prévision, les développements hyperscale devraient se consolider autour de cinq corridors riches en énergie, cimentant leur rôle dans les charges de travail d'entraînement tout en déchargeant l'inférence critique en termes de latence vers les pods de colocation en périphérie.

De 2025 à 2030, les engagements d'expansion hyperscale, 2,9 milliards USD de Microsoft au Japon et 3 milliards USD de Google en Asie du Sud-Est continentale, font passer le CAGR historique du segment de 18,4% à 21,8%. Les fournisseurs qui intègrent les droits d'atterrissage de câbles sous-marins avec une capacité GPU directe créent un avantage défendable contre les concurrents nationaux. Par ailleurs, le marché des centres de données d'intelligence artificielle en Asie Pacifique continue de récompenser les groupes de colocation qui obtiennent des certifications de gouvernance IA et intègrent des infrastructures d'interconnexion à faible latence, permettant aux locataires de relier des clusters privés aux GPU hyperscale lorsque les limites d'exportation se relâchent.

Note: Les parts de segments de tous les segments individuels sont disponibles à l'achat du rapport

Par composant : La montée en puissance du matériel arrive au moment où l'IA passe du pilote à la production

Les logiciels commandent toujours 45,83% des dépenses de 2024 parce que les cadres de modèles, les couches d'orchestration et les plateformes d'observabilité restent fondamentaux pour le développement de l'IA. Pourtant, le matériel, la tranche à la croissance la plus rapide avec un CAGR de 23,67%, devrait dépasser 10 milliards USD de la taille du marché des centres de données d'intelligence artificielle en Asie Pacifique d'ici 2030, propulsé par le pivot de l'expérimentation basée sur le cloud vers des clusters d'inférence à grande échelle qui sollicitent les seuils de densité des racks. Les opérateurs réservent désormais plus de la moitié des dépenses d'investissement de 2025 pour les boucles de refroidissement, les chemins de câbles et l'appareillage de commutation à moyenne tension pouvant maintenir des thermiques supérieurs à 40 kW par rack.

L'alimentation et le refroidissement absorbent les dépenses matérielles les plus importantes ; chaque rack GPU consomme jusqu'à 10 fois le courant d'un rack CPU, poussant de nombreuses salles vers des alimentations d'utilité de 30 MVA. L'approvisionnement en refroidissement liquide croît seul à 35% annuellement au Japon, augmentant la part de marché des centres de données d'intelligence artificielle du pays en Asie Pacifique dans la catégorie matériel. Les services, représentant 31,52% des dépenses, s'orientent vers des offres gérées à mesure que les clients externalisent l'optimisation des répliques, des points de contrôle de gradient et de la planification adaptée à l'énergie. La croissance des services professionnels est à la traîne car les hyperscalers internalisent les compétences en conception et les petits fournisseurs s'appuient sur des architectures de référence de fournisseurs comme Schneider Electric. Dans toute la région, les contraintes de chaîne d'approvisionnement en GPU et en infrastructure réseau amènent les opérateurs à maintenir des stocks tampons de trois mois, immobilisant du fonds de roulement mais assurant la continuité du déploiement.

Par norme de niveau : La dynamique du Niveau III se développe en périphérie

Les salles de Niveau IV dominent toujours avec une part de 61,63% car les temps d'arrêt lors de l'entraînement IA peuvent effacer des semaines de travail de calcul et empiéter sur les budgets de ré-entraînement des modèles. Cependant, les sites de Niveau III, prévus à un CAGR de 24,77%, captent une nouvelle demande pour l'inférence, où de brèves interruptions peuvent être absorbées par le routage du trafic et la replanification par micro-lots. La taille du marché des centres de données d'intelligence artificielle en Asie Pacifique liée aux empreintes de Niveau III dépassera 6 milliards USD d'ici 2030, aidée par les déploiements en périphérie dans les centraux téléphoniques et les armoires de fibres métropolitaines.

Les charges de travail d'IA souveraine de la Chine continuent d'insister sur la redondance de Niveau IV, mais l'Asie du Sud-Est se détend jusqu'aux niveaux de Niveau III qui échangent les cinq neuf de disponibilité contre des délais de construction plus courts et des dépenses d'investissement inférieures de 18 à 20%. Les régulateurs japonais acceptent désormais des pods de Niveau III modulaires dans les usines pour raccourcir les boucles de conception de semi-conducteurs. Pendant ce temps, la croissance du Niveau IV progresse légèrement vers un CAGR de 22,1% à mesure que les hyperscalers riches en capitaux doublent les accords de liquidité avec les fournisseurs pour sécuriser l'appareillage de commutation et les refroidisseurs 12 mois à l'avance. La répartition de la part de marché des centres de données d'intelligence artificielle en Asie Pacifique entre les niveaux se réduira, mais les deux restent indispensables : l'un pour l'entraînement ininterrompu et l'autre pour l'inférence sensible à la latence en périphérie du réseau.

Par secteur d'utilisation final : Internet et Médias Numériques en forte progression

L'informatique et les services informatiques détenaient 33,82% des dépenses de 2024 grâce à l'adoption précoce des pipelines d'intégration continue et des cadres de tests automatisés alimentés par des grands modèles de langage. En revanche, Internet et Médias Numériques croît à un CAGR de 23,45%, porté par la génération de contenu en temps réel, les moteurs de recommandation et les expériences sociales immersives qui nécessitent une inférence de l'ordre de la milliseconde. Le secteur des centres de données d'intelligence artificielle en Asie Pacifique est témoin de la part des télécommunications de 18,7% des dépenses vers des nœuds de périphérie à accès multiple pour permettre des superpositions de réalité augmentée par vision par ordinateur pour les abonnés 5G.[1]GSMA Future Networks Team, "Multi-access edge computing overview", GSMA, gsma.com

La part de 15,2% du secteur BFSI est stable car les équipes de risque et de conformité doivent héberger les cycles d'ajustement fin à l'intérieur des frontières nationales, faisant monter les primes de cloud souverain. Santé et Sciences de la Vie ajoutent 22,8% de CAGR en exploitant l'IA générative dans la découverte de médicaments et le triage en radiologie, souvent sous des règles de confidentialité de niveau hospitalier.[2]Health-Tech Editors, "AI accelerates drug discovery and imaging", Nature Medicine, nature.com Les cas d'utilisation en fabrication se regroupent autour de la maintenance prédictive et de la détection de défauts en ligne, nécessitant une intégration de périphérie avec contrôleur qui favorise les clusters sur site dans les usines. Gouvernement et Défense, bien que plus petits, bénéficient d'un accès prioritaire aux blocs de transformateurs et aux droits sur l'eau, garantissant que les installations atteignent l'état de préparation avant leurs homologues civils.

Analyse Géographique

La Chine domine le marché des centres de données d'intelligence artificielle en Asie Pacifique avec une part de 42,74% en 2024, protégée par des directives exigeant que 80% des charges de travail d'entraînement restent en territoire national d'ici 2026. La croissance annuelle s'accélère à 22,3% alors que les vents contraires des contrôles des exportations provoquent des pics de 180% d'une année sur l'autre dans les déploiements de GPU domestiques. Les mandats de refroidissement liquide soutenus par Pékin pour les salles de plus de 10 MW déclenchent des booms de modernisation dans les campus traditionnels, soutenant le rythme de dépenses d'investissement démesurées du pays.

Le Japon, avec une part de 21,3%, tire parti des investissements directs étrangers record, 8 milliards USD d'Oracle et 2,9 milliards USD de Microsoft, pour consolider son rôle de laboratoire de refroidissement le plus avancé de la région. Les approbations nationales accélérées pour les salles dont le PUE est inférieur à 1,3 permettent aux projets de commencer les travaux dans les 90 jours, et les parties prenantes keiretsu ajoutent 2 milliards USD en clusters sur site pour sécuriser la propriété intellectuelle de conception.

La Corée du Sud affiche le CAGR le plus rapide de la région à 26,61% grâce à un stimulus IA de 7 milliards USD axé sur les subventions de capacité domestique et les crédits d'impôt. Le mandat de calcul de périphérie 2025 du régulateur des télécommunications oriente davantage les dépenses vers des nœuds 5G distribués, créant des pistes de demande parallèles pour les opérateurs hyperscale et de micro-colocation.

La part de l'Inde de 18,9% reste plafonnée par les goulots d'étranglement des transformateurs et les files d'attente réseau dans les métropoles de niveau 2, mais les accords d'achat d'énergie renouvelable et la constitution de réserves foncières le long des corridors côtiers maintiennent les perspectives à long terme intactes. L'Australie et la Nouvelle-Zélande détiennent conjointement 8,4% de part, attirant les investisseurs avec des compartiments de cloud souverain destinés aux agences de défense et de santé.[3]Claire Jones, "Australia sovereign cloud AI infrastructure", Australian Financial Review, afr.com Singapour, bien que représentant seulement 6,1% par chiffre d'affaires, exerce une influence réglementaire disproportionnée ; son cadre de gouvernance IA sert désormais de modèle de certification dans toute l'ASEAN. Les nations restantes d'Asie du Sud-Est exploitent les poussées de dépenses d'investissement des hyperscalers pour sauter par-dessus l'infrastructure héritée, positionnant le corridor comme l'adjacence à la croissance la plus élevée au monde pour les charges de travail IA.

Paysage Concurrentiel

La concentration du marché des centres de données d'intelligence artificielle en Asie Pacifique est modérée car les hyperscalers, les opérateurs télécom régionaux et les entreprises de colocation indépendantes poursuivent des stratégies qui se recoupent. Alibaba Cloud, Tencent Cloud, AWS et Microsoft continuent d'associer des services cloud à des actifs immobiliers détenus en propre, mais la montée des règles de résidence des données permet à des champions nationaux comme NTT Global Data Centers et STT GDC de défendre leurs parts de marché grâce à des certifications de conformité et des boucles de refroidissement liquide pré-installées.

Les mouvements stratégiques comprennent les partenariats de cloud souverain de Microsoft avec les ministères thaïlandais, le méga-cluster Tokyo-Osaka d'Oracle optimisé pour les racks IA de 40 kW, et l'acquisition par STT GDC pour 800 millions USD de salles indiennes déjà équipées pour des densités GPU supérieures à 30 kW. Les alliances technologiques s'approfondissent : Schneider Electric et Vertiv fournissent des modules de refroidissement en boucle fermée, tandis que NVIDIA et Huawei se disputent les victoires en conception d'accélérateurs dans le contexte des restrictions à l'exportation. Les opérateurs disposant d'une propriété intellectuelle de refroidissement liquide en interne capturent des loyers premium et peuvent différer les dépréciations des sites existants en doublant la densité des racks sans agrandir leurs empreintes.

La pénurie de talents façonne la logique des fusions-acquisitions ; les entreprises considèrent les effectifs d'ingénierie comme un actif rare et paient des primes d'acquisition pour les équipes capables d'intégrer le refroidissement direct vers la puce, les planificateurs de charges de travail IA et les logiciels DC-IM adaptatifs à l'énergie. L'intensité concurrentielle augmente également en périphérie, où NTT et Singtel exploitent les droits d'accès à la fibre pour déployer des pods de micro-colocation qui relient les sites de réseau d'accès radio 5G aux accélérateurs GPU, réduisant ainsi la latence du dernier kilomètre pour les charges de travail de réalité augmentée et de jeux vidéo. Dans l'ensemble, le marché récompense les acteurs capables d'unifier la conformité réglementaire, le refroidissement haute densité et la résilience énergétique dans une seule offre commerciale.

Leaders du Secteur des Centres de Données Optimisés par l'Intelligence Artificielle (IA) en Asie Pacifique

NVIDIA Corporation

Huawei Technologies Co., Ltd.

Sunbird Software, Inc.

Delta Electronics

Daikin Industries

- *Avis de non-responsabilité : les principaux acteurs sont triés sans ordre particulier

Développements Récents du Secteur

- Mars 2025 : Alibaba Cloud a dévoilé sa dernière addition à la ' série Qwen ' de modèles d'intelligence artificielle. Ce lancement intervient dans un contexte de concurrence accrue sur l'arène des grands modèles de langage en Chine, notamment après le célèbre ' moment DeepSeek '. Le nouveau modèle,

Qwen2.5-Omni-7B,

dispose de capacités multimodales, lui permettant de traiter des entrées diverses telles que du texte, des images, de l'audio et de la vidéo. En retour, il génère des sorties de texte instantanées et de parole naturelle. - Février 2025 : Daikin a dévoilé sa dernière offre, le Pro-C Computer Room Air Handler (CRAH), renforçant sa gamme de produits pour centres de données. Conçu pour répondre aux diverses exigences de refroidissement des centres de données, l'unité présente une conception améliorée et des mécanismes de contrôle sophistiqués.

- Janvier 2025 : Microsoft a ajouté 1,5 milliard USD au développement IA de la Thaïlande, introduisant des zones de cloud souverain pour les clients du secteur financier et du secteur public.

- Décembre 2024 : Oracle a ouvert la première tranche de 8 milliards USD de salles GPU au Japon à Tokyo et à Osaka avec des racks refroidis par liquide de 40 kW.

Périmètre du Rapport sur le Marché des Centres de Données Optimisés par l'Intelligence Artificielle (IA) en Asie Pacifique

Le terme ' Intelligence Artificielle (IA) dans les centres de données ' explore l'intégration de diverses technologies d'IA, couvrant l'apprentissage automatique, l'apprentissage profond, le traitement du langage naturel et la vision par ordinateur dans les opérations des centres de données. Ces opérations englobent un spectre de composants, allant de l'infrastructure et la gestion de l'énergie au stockage, la mise en réseau, la cybersécurité et l'automatisation des installations.

Le rapport sur le marché des centres de données d'intelligence artificielle (IA) en Asie Pacifique est segmenté par type de centre de données (centres de données de fournisseurs de services cloud, centres de données en colocation, et autres (entreprise et périphérie), par composant (matériel (alimentation, refroidissement, équipement informatique et autres), technologie logicielle (apprentissage automatique, apprentissage profond, traitement du langage naturel et vision par ordinateur)), et services, et par pays (Chine, Inde, Japon, Malaisie, Australie, Singapour, Indonésie, Thaïlande, Corée du Sud et reste de l'Asie Pacifique). Les tailles de marché et les prévisions sont fournies en valeurs (USD) pour tous les segments ci-dessus.

| Fournisseurs de Services Cloud |

| Installations de Colocation |

| Entreprise / Sur Site / Périphérie |

| Matériel Informatique | Infrastructure d'Alimentation |

| Infrastructure de Refroidissement | |

| Équipement Informatique | |

| Racks et Autre Matériel Informatique | |

| Technologie Logicielle | Apprentissage Automatique |

| Apprentissage Profond | |

| Traitement du Langage Naturel | |

| Vision par Ordinateur | |

| Services | Services Gérés |

| Services Professionnels |

| Niveau III |

| Niveau IV |

| Informatique et Services Informatiques |

| Internet et Médias Numériques |

| Opérateurs de Télécommunications |

| BFSI |

| Santé et Sciences de la Vie |

| Fabrication et IoT Industriel |

| Gouvernement et Défense |

| Chine |

| Japon |

| Inde |

| Malaisie |

| Corée du Sud |

| Singapour |

| Reste de l'Asie Pacifique |

| Par Type de Centre de Données | Fournisseurs de Services Cloud | |

| Installations de Colocation | ||

| Entreprise / Sur Site / Périphérie | ||

| Par Composant | Matériel Informatique | Infrastructure d'Alimentation |

| Infrastructure de Refroidissement | ||

| Équipement Informatique | ||

| Racks et Autre Matériel Informatique | ||

| Technologie Logicielle | Apprentissage Automatique | |

| Apprentissage Profond | ||

| Traitement du Langage Naturel | ||

| Vision par Ordinateur | ||

| Services | Services Gérés | |

| Services Professionnels | ||

| Par Norme de Niveau | Niveau III | |

| Niveau IV | ||

| Par Secteur d'Utilisation Final | Informatique et Services Informatiques | |

| Internet et Médias Numériques | ||

| Opérateurs de Télécommunications | ||

| BFSI | ||

| Santé et Sciences de la Vie | ||

| Fabrication et IoT Industriel | ||

| Gouvernement et Défense | ||

| Par Pays | Chine | |

| Japon | ||

| Inde | ||

| Malaisie | ||

| Corée du Sud | ||

| Singapour | ||

| Reste de l'Asie Pacifique | ||

Questions Clés Répondues dans le Rapport

Quel taux de croissance est prévu pour le marché des centres de données d'intelligence artificielle en Asie Pacifique jusqu'en 2030 ?

Le marché devrait se développer à un CAGR de 22,69%, atteignant 26,67 milliards USD d'ici 2030.

Quel segment connaît la croissance la plus rapide dans les centres de données IA en Asie Pacifique ?

Les installations de colocation mènent avec un CAGR de 24,23% car les règles d'IA souveraine stimulent la demande en racks domestiques.

Pourquoi les modernisations par refroidissement liquide s'accélèrent-elles dans les salles GPU en Asie Pacifique ?

Les racks d'IA générative génèrent 3 à 4 fois la chaleur des serveurs traditionnels, et le refroidissement liquide maintient le PUE en dessous de 1,3 tout en doublant la densité des racks.

Quel pays affiche le rythme de croissance le plus élevé ?

La Corée du Sud affiche le CAGR le plus fort à 26,61%, soutenu par 7 milliards USD d'incitations spécifiques aux centres de données IA.

Comment les contrôles des exportations influencent-ils les stratégies d'infrastructure IA régionales ?

Les restrictions allongent les délais de livraison des GPU à 6 à 12 mois, poussant les entreprises chinoises et japonaises à constituer des stocks d'accélérateurs et à favoriser les clusters sur site.

Dernière mise à jour de la page le: