Taille et Part du Marché des Systèmes d'Orchestration et de Mémoire d'IA Agentique

Analyse du Marché des Systèmes d'Orchestration et de Mémoire d'IA Agentique par Mordor Intelligence

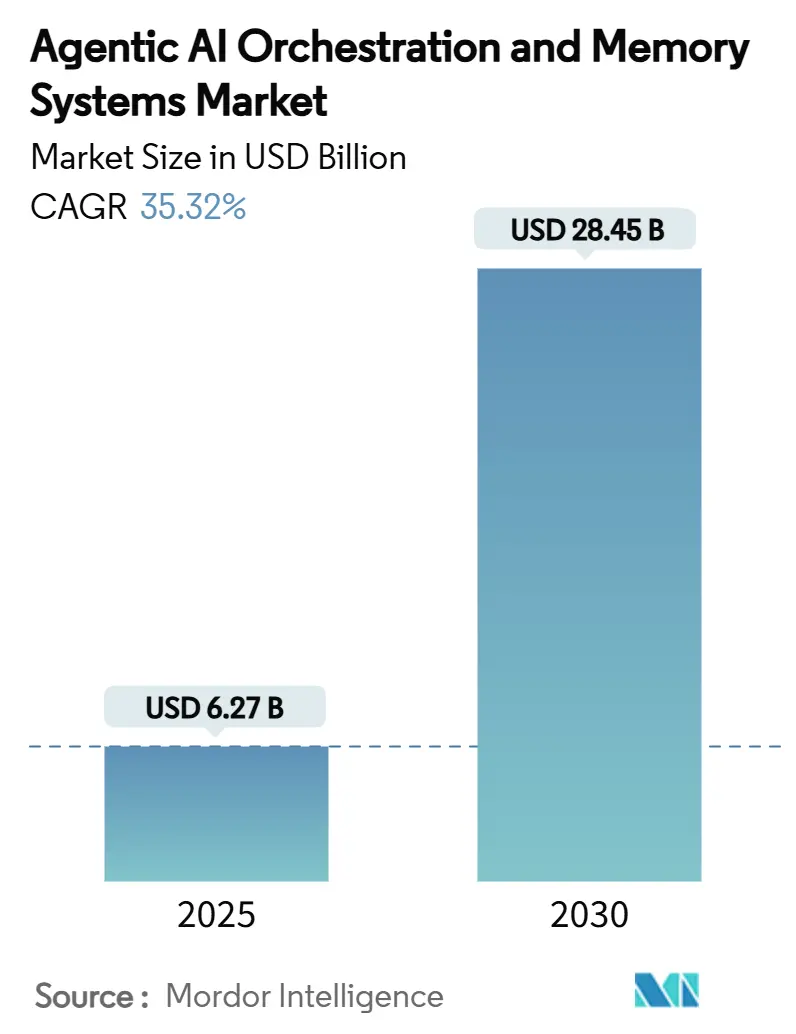

La taille du Marché des Systèmes d'Orchestration et de Mémoire d'IA Agentique est estimée à 6,27 milliards USD en 2025, et devrait atteindre 28,45 milliards USD d'ici 2030, à un CAGR de 35,32% durant la période de prévision (2025-2030). La forte hausse à deux chiffres découle du passage des entreprises au-delà des projets pilotes vers des flux de travail multi-agents autonomes de niveau production qui réduisent les points de contact manuels dans les opérations essentielles. La valeur commerciale repose désormais sur des couches d'orchestration qui coordonnent le raisonnement et l'action, tandis que les systèmes de mémoire clés en main maintiennent le contexte à long horizon disponible pour chaque agent. Les bases de données vectorielles intégrées aux API d'orchestration fournissent cette mémoire persistante, et les plateformes cloud intègrent cette capacité en tant que service géré, réduisant les frictions de construction et d'exploitation. L'intensité concurrentielle s'accroît à mesure que les grands acteurs technologiques proposent des architectures de référence qui éliminent l'incertitude architecturale, tandis que des start-ups spécialisées défendent leurs parts avec une recherche vectorielle plus approfondie, une meilleure observabilité et une logique de flux de travail spécifique au domaine. Le marché d'orchestration d'IA agentique bénéficie également des mandats de conformité qui exigent des pistes d'audit complètes pour l'activité des grands modèles de langage (LLM), faisant de la rétention de contexte une priorité au niveau du conseil d'administration[1]Microsoft Corporation, "Azure AI Agent Service," MICROSOFT.COM.

Principaux Enseignements du Rapport

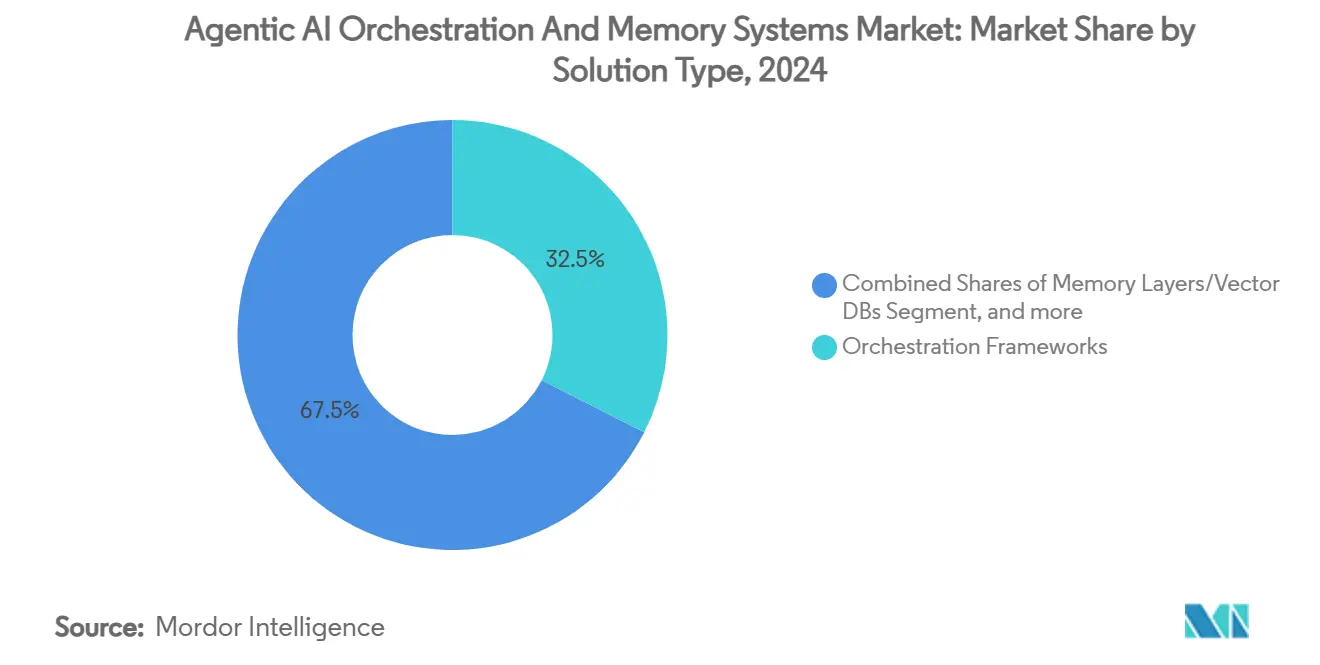

- Par type de solution, les cadres d'orchestration détenaient 32,45% de la part du marché d'orchestration d'IA agentique en 2024, tandis que les outils d'observabilité et de test s'accélèrent à un CAGR de 37,45% jusqu'en 2030.

- Par mode de déploiement, les plateformes cloud représentaient 67,84% de la taille du marché d'orchestration d'IA agentique en 2024 et progressent à un CAGR de 36,50% jusqu'en 2030.

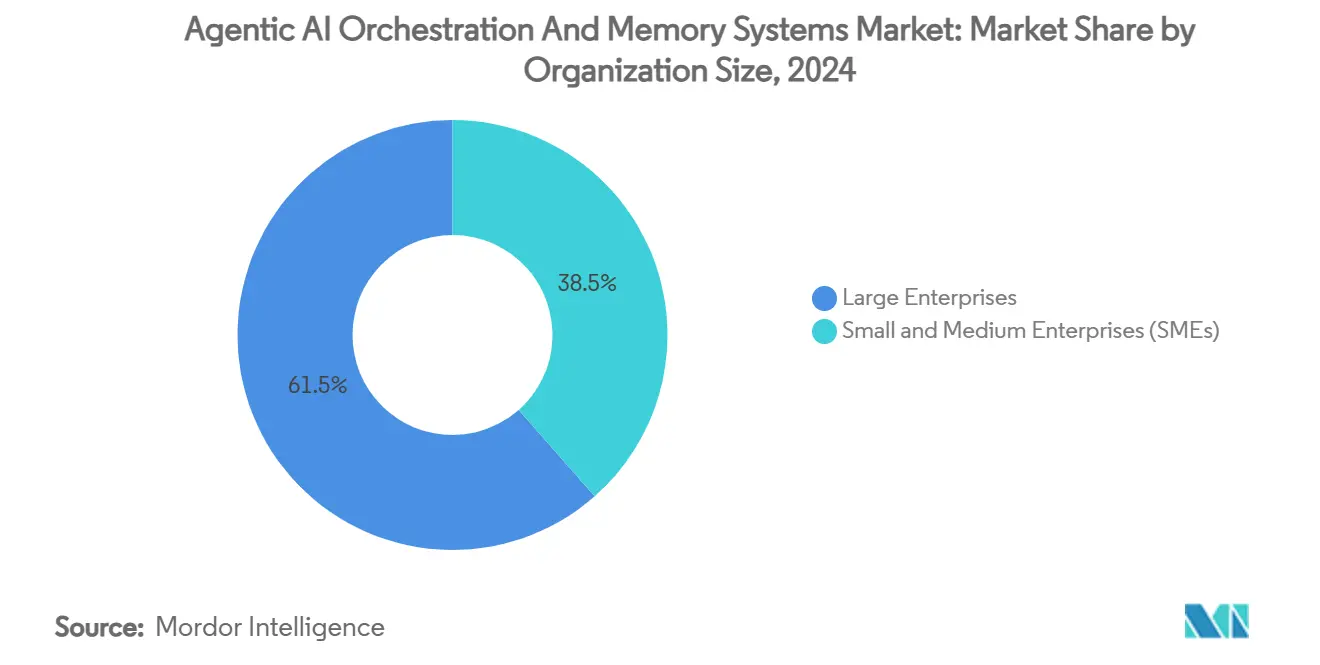

- Par taille d'organisation, les grandes entreprises étaient en tête avec 61,47% de part de revenus en 2024 ; les petites et moyennes entreprises se développent à un CAGR de 38,10% jusqu'en 2030.

- Par secteur d'utilisation final, l'informatique et les télécommunications ont capturé 23,40% de la part du marché d'orchestration d'IA agentique en 2024, tandis que le commerce de détail et le commerce électronique devrait croître à un CAGR de 37,19% jusqu'en 2030.

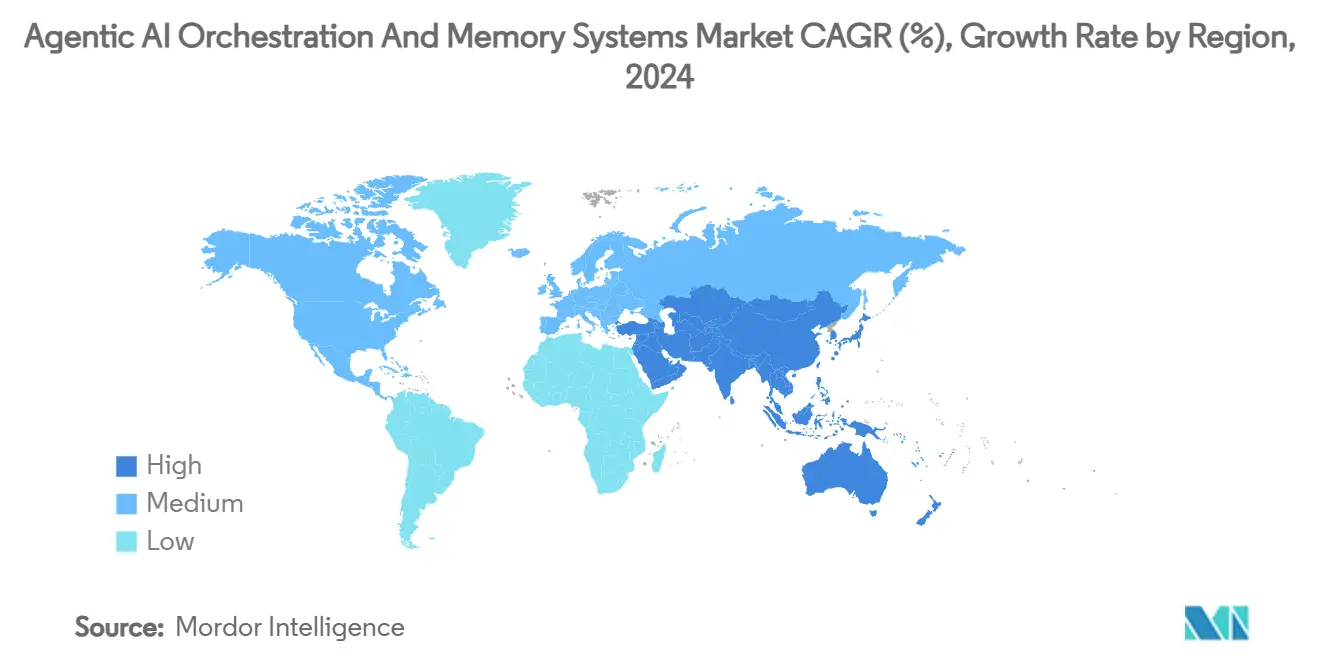

- Par géographie, l'Amérique du Nord représentait 40,40% des revenus de 2024 ; l'Asie-Pacifique enregistre le CAGR le plus rapide à 37,89% jusqu'en 2030.

Tendances et Perspectives du Marché Mondial des Systèmes d'Orchestration et de Mémoire d'IA Agentique

Analyse de l'Impact des Moteurs

| Moteur | (~) % d'Impact sur les Prévisions de CAGR | Pertinence Géographique | Horizon Temporel d'Impact |

|---|---|---|---|

| Les piles d'opérations d'agents natives du cloud gagnent en importance auprès des directeurs des systèmes d'information | +8.20% | Mondial, avec des gains précoces en Amérique du Nord et en UE | Moyen terme (2-4 ans) |

| Convergence des bases de données vectorielles et des API d'orchestration en couches mémoire clés en main | +7.80% | Mondial | Court terme (≤ 2 ans) |

| Les projets pilotes multi-agents d'entreprise passant des preuves de concept à la production en 2025 | +6.50% | Amérique du Nord et UE en cœur, extension vers l'APAC | Court terme (≤ 2 ans) |

| Les architectures de référence des grands fournisseurs technologiques réduisant le risque d'adoption | +5.90% | Mondial | Moyen terme (2-4 ans) |

| La montée des mandats de conformité pour les pistes d'audit des LLM stimulant la mémoire persistante | +4.70% | Amérique du Nord et UE, extension vers l'APAC | Long terme (≥ 4 ans) |

| L'émergence de protocoles ouverts (A2A, MCP) permettant des maillages d'agents plug-and-play | +3.10% | Mondial | Long terme (≥ 4 ans) |

| Source: Mordor Intelligence | |||

Les Piles d'Opérations d'Agents Natives du Cloud Gagnent en Importance auprès des Directeurs des Systèmes d'Information

Les directeurs des systèmes d'information classent les systèmes d'orchestration et de mémoire comme une infrastructure stratégique, remplaçant la perception de l'IA agentique comme un complément expérimental. Les dépenses se déplacent vers des plateformes d'opérations d'agents natives du cloud car elles s'articulent avec les pipelines DevOps existants et les outils de sécurité. Le service Azure AI Agent Service de Microsoft intègre l'orchestration directement dans les périmètres de réseau virtuel, permettant aux entreprises de lancer des flux multi-agents sans surcharge d'intégration supplémentaire. Les premiers adoptants rapportent des économies de 30 à 40% sur les charges d'exploitation une fois que les agents de raisonnement remplacent les tâches humaines répétitives[2] Boston Consulting Group, "How AI Agents Are Opening the Golden Era of Customer Experience," BCG.COM . Les modules de gouvernance intégrés satisfont aux contrôles réglementaires d'explicabilité, positionnant les architectures natives du cloud comme la norme par défaut pour les nouveaux déploiements jusqu'en 2030. À mesure que les grands projets atteignent l'échelle, les directeurs des systèmes d'information évaluent les feuilles de route des fournisseurs sur trois métriques — la latence sous concurrence, la sécurité du déploiement automatisé et la journalisation complète de la lignée — convertissant ces critères en contrats de plateforme pluriannuels.

Convergence des Bases de Données Vectorielles et des API d'Orchestration en Couches Mémoire Clés en Main

Les limitations des agents sans état s'estompent car l'indexation des magasins vectoriels et la logique d'orchestration s'imbriquent désormais dans une seule couche gérée. Mem0 AI associe la recherche sémantique à haute précision aux déclencheurs de flux de travail, de sorte que chaque appel d'agent récupère, met à jour et persiste le contexte dans la même transaction atomique[3] Mem0 AI, "Memory Layer Platform," MEM0.AI . Les entreprises qui installent ces couches mémoire clés en main notent une précision d'achèvement des tâches supérieure de 40 à 60% par rapport aux bases sans état. Le bond technique découle de la liaison tardive des embeddings : les écritures en mémoire ne se produisent que lorsque les scores de pertinence dépassent les seuils de politique, contrôlant ainsi l'expansion des magasins vectoriels. Avec la persistance résolue, les architectes repensent les processus métier de bout en bout — par exemple, les flux de commande à encaissement couvrent désormais plusieurs cycles fiscaux sans perte de contexte, et les agents font référence à des négociations fournisseurs vieilles de plusieurs mois lors de décisions de tarification en temps réel. Cette capacité structurelle réinitialise les attentes quant à ce que les systèmes autonomes peuvent couvrir dans les flux de travail d'entreprise.

Les Projets Pilotes Multi-Agents d'Entreprise Passant des Preuves de Concept à la Production en 2025

La phase de preuve de concept disparaît pour de nombreuses entreprises du Fortune 1000 en 2025. Wells Fargo a déployé un maillage d'agents de service client en direct sur les canaux voix, chat et e-mail et a publié des réductions mesurables du temps de traitement moyen ainsi qu'une amélioration des scores de satisfaction client. La préparation à la production s'est accélérée car les piles d'observabilité capturent désormais chaque arbre de décision des agents, permettant aux responsables de la conformité de rejouer les interactions à la demande. Les données d'enquête de Databricks montrent que 60% des entreprises migreront au moins un projet pilote vers la production en 2025, soit un triplement par rapport à 2024. Ce pipeline de mises en production pousse les fournisseurs à garantir une disponibilité à quatre neuf pour les moteurs d'orchestration et à proposer des stratégies de retour arrière lorsque le comportement émergent des agents s'écarte de la politique. À mesure que les parcs de production s'étendent, les acheteurs accordent de plus en plus d'importance aux accords de niveau de service de support des fournisseurs et aux cadres de réponse aux incidents, autant qu'à leurs benchmarks bruts de qualité de modèle.

Les Architectures de Référence des Grands Fournisseurs Technologiques Réduisant le Risque d'Adoption

Microsoft, Google et AWS exploitent leurs empreintes cloud en livrant des conceptions de référence à pile complète. La banque mémoire vectorielle persistante de Vertex AI de Google s'intègre aux politiques existantes de gestion des identités et des accès, accélérant les révisions de sécurité. AWS Bedrock Agents prépackage des garde-fous au niveau des tokens, permettant aux institutions financières de franchir les obstacles de conformité en quelques semaines plutôt qu'en trimestres. Les entreprises adoptant ces modèles rapportent une réduction des cycles de déploiement de 50 à 70%, incitant les conseils d'administration à approuver des déploiements plus larges. Les architectures de référence codifient les meilleures pratiques, de sorte que même les entreprises avec de petites équipes d'IA peuvent mettre en place des applications multi-agents qui passent les comités internes de révision d'architecture. Ces plans de référence ancrent les grands fournisseurs technologiques au cœur de l'orchestration, mais ils élargissent également les dépenses totales adressables en rassurant les secteurs averses au risque tels que la santé et le gouvernement.

Analyse de l'Impact des Contraintes

| Contrainte | (~) % d'Impact sur les Prévisions de CAGR | Pertinence Géographique | Horizon Temporel d'Impact |

|---|---|---|---|

| Chaîne d'outils d'observabilité et de débogage immature pour les flux de travail multi-agents | -4.20% | Mondial | Court terme (≤ 2 ans) |

| Coûts d'inférence élevés des magasins vectoriels à grande échelle pour le contexte à long terme | -3.80% | Mondial | Moyen terme (2-4 ans) |

| Standards fragmentés créant des surcharges d'interopérabilité | -2.90% | Mondial | Long terme (≥ 4 ans) |

| Préoccupations de souveraineté des données limitant la réplication de mémoire transfrontalière | -2.10% | UE et APAC en cœur, répercussions réglementaires mondiales | Long terme (≥ 4 ans) |

| Source: Mordor Intelligence | |||

Chaîne d'Outils d'Observabilité et de Débogage Immature pour les Flux de Travail Multi-Agents

Les entreprises font face à des lacunes de surveillance car les tableaux de bord traditionnels de gestion des performances des applications ne parsent pas les traces de pensée des agents ni les schémas de collaboration émergents. Deepchecks ne répertorie qu'une poignée de produits d'observabilité LLM conçus à cet effet, et la parité des fonctionnalités avec les suites de gestion des performances des applications matures fait encore défaut[4] Deepchecks, "Top 5 LLM Observability Tools," DEEPCHECKS.COM . Sans introspection complète, les équipes peinent à affiner les fonctions de récompense ou à isoler les conditions de course lorsque les agents se coordonnent entre les microservices. XenonStack note que 40 à 50% des déploiements de production bloqués citent l'absence de télémétrie de débogage comme cause principale. Cette barrière ralentit de manière disproportionnée les secteurs réglementés qui doivent justifier chaque étape algorithmique. Les fournisseurs s'empressent de livrer des visualiseurs de traces et des détecteurs d'anomalies adaptés aux graphes d'agents, mais jusqu'à ce que la couverture atteigne la parité avec les attentes DevSecOps, le risque de déploiement continue de freiner la croissance à court terme.

Coûts d'Inférence Élevés des Magasins Vectoriels à Grande Échelle pour le Contexte à Long Terme

Le maintien de fenêtres mémoire de millions de documents dans des bases de données vectorielles est intensif en calcul, surtout lorsque les embeddings se réorganisent après un affinage. AI Multiple calcule que la récupération vectorielle peut représenter 30 à 40% des coûts d'exploitation des agents en direct dans les secteurs à forte densité de données[5] AI Multiple, "AI Agent Performance: Success Rates & ROI in 2025," AIMULTIPLE.COM . Rapid Innovation rapporte des ratios de coûts similaires lors d'implémentations de chaîne d'approvisionnement où les agents rappellent des historiques d'expédition sur une année entière. La courbe de prix augmente de manière non linéaire car les recherches de similarité touchent de grandes partitions d'index à mesure que le contexte s'étend. Les petites entreprises plafonnent donc la profondeur vectorielle, ce qui nuit à la qualité du raisonnement des agents. Les fournisseurs expérimentent une mémoire hybride qui décharge les vecteurs froids vers le stockage d'objets et les réhydrate à la demande, mais les preuves commerciales restent limitées. Tant que les courbes de coûts ne s'aplatissent pas, certains directeurs financiers limiteront la portée des projets, réduisant la trajectoire d'adoption autrement abrupte.

Analyse des Segments

Par Type de Solution : Les Outils d'Observabilité Renforcent la Confiance des Entreprises

Les plateformes d'observabilité et de test ont enregistré le CAGR le plus rapide à 37,45% jusqu'en 2030, car les entreprises ont appris que des agents de production fiables nécessitent une instrumentation approfondie. Le segment a pris de l'élan une fois que les traces d'agents, l'attribution au niveau des tokens et les alertes de violation de politique sont devenus des exigences d'audit au niveau du conseil d'administration. En 2024, les cadres d'orchestration détenaient toujours la plus grande part de 32,45% de la taille du marché d'orchestration d'IA agentique, mais la croissance s'est modérée à mesure que les cadres ont mûri et que les nouveaux acheteurs ont priorisé les compléments de surveillance. AgentOps et des fournisseurs similaires ont monétisé cet écart avec des tableaux de bord qui rejouent chaque étape de raisonnement et exposent les diagnostics de cause première[6] AgentOps, "AgentOps Platform," AGENTOPS.AI . La forte adoption dans les secteurs des services financiers et de la santé signale que l'observabilité n'est plus optionnelle.

Les couches mémoire sophistiquées qui marient la recherche vectorielle aux contrôles d'accès basés sur les rôles constituaient la deuxième tranche de revenus la plus importante. Les moteurs de flux de travail continuent de générer des renouvellements d'abonnements réguliers car ils restent l'épine dorsale du séquençage des tâches entre les agents. Les SDK de gestion de contexte séduisent les équipes d'outillage développeur qui ont besoin d'abstractions pour la gestion de l'état des agents et la gestion des versions de prompts. La diversité des ensembles d'outils souligne que l'orchestration multi-agents est un écosystème plutôt qu'une catégorie de produit unique, et les acheteurs regroupent souvent plusieurs composants de différents fournisseurs pour satisfaire les exigences du cycle de vie complet.

Note: Les parts de segment de tous les segments individuels sont disponibles à l'achat du rapport

Par Mode de Déploiement : La Domination du Cloud s'Accélère

Le déploiement cloud a capturé 67,84% de la part du marché d'orchestration d'IA agentique en 2024 et devrait se composer à un CAGR de 36,50%, dépassant largement les installations sur site. Les fournisseurs de cloud public abstraient la complexité opérationnelle du partitionnement des magasins vectoriels, du défilement automatique des fenêtres de contexte et de la mise à jour des runtimes d'orchestration. Les entreprises gravitent vers des points de terminaison gérés qui exposent une gouvernance basée sur les rôles tout en s'adaptant horizontalement à la demande. Des schémas hybrides apparaissent encore là où les données classifiées comme hautement confidentielles résident dans des clusters privés, mais le trafic d'orchestration et d'inférence reste dans les VPC cloud. La couche de filtrage de Nexos.ai qui achemine les requêtes sur 200 points de terminaison LLM illustre pourquoi les entreprises préfèrent les passerelles en tant que service plutôt que les clusters autogérés[7] Nexos.ai, "AI Gateway: Next-Level LLM Management for Enterprises," NEXOS.AI .

Les déploiements sur site se poursuivent dans la défense et certains contextes du secteur public de l'UE où les règles de souveraineté des données excluent le stockage hors site. Même là, les fournisseurs livrent des appareils clés en main qui imitent les piles d'orchestration cloud derrière les pare-feux d'entreprise. Le renforcement continu des zones cloud souveraines au Japon et en Inde réduit les hésitations parmi les secteurs réglementés, suggérant que la part du cloud augmentera même dans les bastions historiquement sur site. Compte tenu de ces tendances, les investisseurs s'attendent à ce que les pools de bénéfices bruts des plateformes cloud s'élargissent car les services d'orchestration à forte marge se vendent naturellement en complément des dépenses existantes en calcul et en stockage.

Par Taille d'Organisation : Les PME Stimulent la Démocratisation

Les petites et moyennes entreprises ont crû à un CAGR remarquable de 38,10% jusqu'en 2030, mais les grandes entreprises dominent toujours les revenus en raison de la taille des contrats qui regroupent des centaines de postes d'agents et des magasins vectoriels à l'échelle du téraoctet. L'arc de démocratisation repose sur l'efficacité des coûts : les PME peuvent désormais lancer des projets d'orchestration de niveau d'entrée pour 20 000 à 60 000 USD, un seuil atteignable à partir des budgets opérationnels plutôt que des CAPEX pluriannuels. Les modèles prêts à l'emploi pour l'automatisation du marketing ou le triage du service d'assistance permettent aux petites entreprises de contourner les recrutements en science des données qu'elles ne peuvent pas se permettre. L'analyse de l'OCDE indique que les lacunes en compétences restent le principal obstacle à l'adoption, de sorte que les fournisseurs intègrent des studios d'orchestration à faible code et des bibliothèques de prompts intégrées pour aplatir les courbes d'apprentissage.

Les grandes entreprises conservent leur leadership car elles intègrent des agents dans les réseaux ERP, CRM et de chaîne d'approvisionnement, créant des engagements de services à prix élevé pour les intégrateurs de systèmes. Elles négocient également des remises sur volume pour le stockage vectoriel et le support prioritaire. Pourtant, à mesure que les bibliothèques de modèles prolifèrent, la croissance des PME soutiendra les métriques de volume utilisées par les fournisseurs cloud pour justifier les investissements continus en R&D dans les fonctionnalités d'orchestration.

Par Secteur d'Utilisation Final : La Transformation du Commerce de Détail Mène la Croissance

L'informatique et les télécommunications ont capturé 23,40% des revenus de 2024 car les opérateurs de télécommunications avaient besoin d'agents autonomes de surveillance réseau, et les prestataires d'externalisation informatique ont intégré l'orchestration dans les services gérés. Le commerce de détail et le commerce électronique, cependant, afficheront le CAGR le plus élevé à 37,19% car les agents de shopping conversationnel et de tarification dynamique montrent une augmentation immédiate des revenus. Fast Company documente des gains de conversion à deux chiffres pour les marques déployant des concierges d'achat IA qui se souviennent des navigations précédentes, négocient des remises et remplissent automatiquement les flux de paiement. L'adoption dans le secteur BFSI suit de près avec des agents de détection de fraude qui croisent les schémas contextuels à une latence de milliseconde. La santé adopte l'orchestration pour la gestion des données d'essais cliniques malgré les contraintes réglementaires, tandis que la fabrication applique la planification autonome à la maintenance prédictive.

La taille du marché d'orchestration d'IA agentique pour les agents de personnalisation du commerce de détail devrait dépasser 4 milliards USD d'ici 2030, reflétant comment les gains de revenus en front-office justifient les coûts de déploiement des systèmes. L'adoption industrielle croît régulièrement à mesure que les usines instrumentent la robotique, mais la part globale est en retard par rapport aux secteurs de services où les interactions numériques dominent.

Analyse Géographique

L'Amérique du Nord a maintenu 40,40% des revenus de 2024 grâce aux projets pilotes d'entreprise pionniers et à un patchwork réglementaire qui exige des pistes d'audit vérifiables, poussant les acheteurs vers des piles d'orchestration américaines matures. L'Asie-Pacifique affiche désormais le CAGR le plus élevé à 37,89% jusqu'en 2030 car les budgets d'IA souverains en Chine, au Japon et en Inde financent des orchestrateurs locaux optimisés pour les règles de conformité locales. Les subventions nationales abaissent les obstacles à l'approvisionnement, et les grands acteurs manufacturiers intègrent des maillages d'agents dans les tours de contrôle de la chaîne d'approvisionnement. La croissance de l'Europe est régulière mais comparativement plus lente car le RGPD et la prochaine loi européenne sur l'IA prolongent les cycles de diligence raisonnable des fournisseurs. Néanmoins, les plateformes nées en Europe qui intègrent la protection de la vie privée dès la conception gagnent du terrain dans les secteurs sensibles aux données.

L'Amérique du Sud connaît une adoption précoce concentrée dans le secteur de la banque numérique au Brésil. Le Moyen-Orient et l'Afrique suivent les agendas de numérisation du pétrole et du gaz ainsi que des gouvernements, bien que les pénuries de compétences tempèrent la vitesse. Dans l'ensemble, l'expansion de l'APAC remodèle les feuilles de route des fournisseurs : le support linguistique, les adaptateurs de conformité régionaux et les empreintes de centres de données onshore deviennent des prérequis incontournables pour les fournisseurs mondiaux.

Paysage Concurrentiel

Le champ concurrentiel affiche une fragmentation modérée. Microsoft, Google et AWS intègrent l'orchestration dans les comptes cloud, exploitant les ancres de dépenses existantes pour vendre des services d'agents avancés en complément. Azure délimite un modèle de responsabilité partagée qui attribue la lignée des données au client tandis que Microsoft gère le runtime d'orchestration, satisfaisant les équipes de gestion des risques qui souhaitent de la clarté sur la responsabilité en cas de violation. Google et AWS poursuivent des stratégies parallèles avec des banques mémoire gérées et des politiques de garde-fous. Leur échelle permet une tarification préférentielle des GPU et des approbations de sécurité nationale, les aidant à remporter des comptes fortement réglementés.

Les spécialistes contre-attaquent en approfondissant les capacités verticales. Pinecone se concentre sur la recherche vectorielle à ultra-faible latence avec des contrôles d'accès d'entreprise. LangChain offre un cadre open source qui accélère l'intégration des développeurs grâce à des chaînes de prompts composables et prend en charge l'auto-hébergement pour les entreprises méfiantes du verrouillage cloud. Mem0 AI capture les ensembles de données où la rétention de contexte s'étend sur des années, comme les dossiers clients de gestion de patrimoine. Des start-ups comme CrewAI Labs se différencient par des algorithmes de planification itérative qui optimisent la collaboration multi-agents dans des flux de travail complexes.

L'acquisition de Run:ai par NVIDIA pour 700 millions USD souligne que l'orchestration n'est plus une couche de fonctionnalités mais un point de contrôle stratégique pour l'infrastructure d'IA[8] TechCrunch, "Nvidia Acquires AI Workload Management Startup Run:ai for USD 700 Million," TECHCRUNCH.COM . De même, les initiatives de protocoles ouverts (A2A, MCP) poussent les fournisseurs vers l'interopérabilité à mesure que les architectes d'entreprise se rebellent contre les écosystèmes fermés. La frontière concurrentielle à long terme dépend donc de deux questions : qui garantit la latence totale la plus faible du prompt à l'action, et qui offre le langage de définition d'agent le plus portable qui survive aux changements de fournisseur sans réingénierie.

Leaders du Secteur des Systèmes d'Orchestration et de Mémoire d'IA Agentique

-

Pinecone Inc.

-

LangChain Technologies Ltd.

-

OpenAI LLC

-

UiPath Inc.

-

ServiceNow Inc.

- *Avis de non-responsabilité : les principaux acteurs sont triés sans ordre particulier

Développements Récents du Secteur

- Janvier 2025 : Nexos.ai a levé 8 millions USD pour lancer une passerelle qui achemine le trafic sur 200 LLM commerciaux et applique des politiques de sécurité unifiées. Le financement souligne la conviction des investisseurs en capital-risque que l'orchestration multi-modèles réduit le verrouillage des fournisseurs et optimise le coût par token. La stratégie consiste à positionner Nexos.ai comme une couche de courtier neutre que les entreprises insèrent au-dessus des points de terminaison propriétaires.

- Décembre 2024 : NVIDIA a finalisé son acquisition de Run:ai pour 700 millions USD afin d'intégrer la planification GPU et la gestion des charges de travail d'IA directement dans les pipelines d'orchestration. Cette démarche renforce l'emprise de NVIDIA sur la pile d'inférence, offrant aux clients un provisionnement en un clic depuis la tranche GPU jusqu'au déploiement multi-agents, ce qui pourrait faire basculer des parts au détriment des orchestrateurs purement logiciels qui manquent d'optimisation matérielle.

- Novembre 2024 : La disponibilité générale du service Azure AI Agent Service de Microsoft a fourni une orchestration de niveau entreprise ainsi que des bibliothèques de modèles pour la finance, la santé et le commerce de détail. Le déploiement vise à réduire les délais de preuve de concept et à cimenter Azure comme plateforme de lancement par défaut pour les parcs d'agents de production qui exigent des garde-fous de conformité.

- Octobre 2024 : Google a introduit la banque mémoire vectorielle persistante de Vertex AI avec réplication inter-régions et contrôles de confidentialité. Le lancement s'attaque au point de douleur du contexte persistant et cible les clients de l'UE qui exigent des garanties de résidence des données. Le pari de Google est que les certifications de confidentialité intégrées débloqueront les secteurs réglementés précédemment hésitants à stocker des embeddings hors site.

- Septembre 2024 : LangChain Technologies a obtenu un financement de série A de 25 millions USD mené par Sequoia Capital pour renforcer son cadre open source pour les charges de travail d'entreprise. Les fonds alimentent des éléments de feuille de route tels que le RBAC natif, la lignée des versions de prompts et les niveaux de support premium, transformant la traction communautaire en services monétisables tout en préservant l'ouverture.

Portée du Rapport Mondial sur le Marché des Systèmes d'Orchestration et de Mémoire d'IA Agentique

| Cadres d'Orchestration |

| Couches Mémoire / Bases de Données Vectorielles |

| Moteurs de Flux de Travail |

| SDK de Gestion de Contexte |

| Outils d'Observabilité et de Test |

| Cloud |

| Sur Site / Auto-Hébergé |

| Grandes Entreprises |

| Petites et Moyennes Entreprises (PME) |

| Informatique et Télécommunications |

| BFSI |

| Santé et Sciences de la Vie |

| Commerce de Détail et Commerce Électronique |

| Fabrication |

| Autres (Gouvernement, Éducation, etc.) |

| Amérique du Nord | États-Unis | |

| Canada | ||

| Mexique | ||

| Amérique du Sud | Brésil | |

| Argentine | ||

| Colombie | ||

| Reste de l'Amérique du Sud | ||

| Europe | Royaume-Uni | |

| Allemagne | ||

| France | ||

| Italie | ||

| Espagne | ||

| Russie | ||

| Reste de l'Europe | ||

| Asie-Pacifique | Chine | |

| Japon | ||

| Corée du Sud | ||

| Inde | ||

| Australie | ||

| Reste de l'Asie-Pacifique | ||

| Moyen-Orient et Afrique | Moyen-Orient | Arabie Saoudite |

| Émirats Arabes Unis | ||

| Reste du Moyen-Orient | ||

| Afrique | Afrique du Sud | |

| Égypte | ||

| Reste de l'Afrique | ||

| Par Type de Solution | Cadres d'Orchestration | ||

| Couches Mémoire / Bases de Données Vectorielles | |||

| Moteurs de Flux de Travail | |||

| SDK de Gestion de Contexte | |||

| Outils d'Observabilité et de Test | |||

| Par Mode de Déploiement | Cloud | ||

| Sur Site / Auto-Hébergé | |||

| Par Taille d'Organisation | Grandes Entreprises | ||

| Petites et Moyennes Entreprises (PME) | |||

| Par Secteur d'Utilisation Final | Informatique et Télécommunications | ||

| BFSI | |||

| Santé et Sciences de la Vie | |||

| Commerce de Détail et Commerce Électronique | |||

| Fabrication | |||

| Autres (Gouvernement, Éducation, etc.) | |||

| Par Géographie | Amérique du Nord | États-Unis | |

| Canada | |||

| Mexique | |||

| Amérique du Sud | Brésil | ||

| Argentine | |||

| Colombie | |||

| Reste de l'Amérique du Sud | |||

| Europe | Royaume-Uni | ||

| Allemagne | |||

| France | |||

| Italie | |||

| Espagne | |||

| Russie | |||

| Reste de l'Europe | |||

| Asie-Pacifique | Chine | ||

| Japon | |||

| Corée du Sud | |||

| Inde | |||

| Australie | |||

| Reste de l'Asie-Pacifique | |||

| Moyen-Orient et Afrique | Moyen-Orient | Arabie Saoudite | |

| Émirats Arabes Unis | |||

| Reste du Moyen-Orient | |||

| Afrique | Afrique du Sud | ||

| Égypte | |||

| Reste de l'Afrique | |||

Questions Clés Répondues dans le Rapport

Qu'est-ce qui stimule la croissance rapide du marché d'orchestration d'IA agentique ?

Les couches mémoire persistantes, le déploiement natif du cloud et les architectures de référence prêtes à l'emploi ont réduit le risque de mise en œuvre et débloqué une croissance CAGR de 35,32% jusqu'en 2030.

Quelle sera la taille du marché d'orchestration d'IA agentique d'ici 2030 ?

Les prévisions placent la taille du marché d'orchestration d'IA agentique à 28,45 milliards USD d'ici 2030, sur la base d'un élan soutenu de déploiement en entreprise.

Quel segment de solution se développe le plus rapidement ?

Les outils d'observabilité et de test progressent à un CAGR de 37,45% car les systèmes de production nécessitent une surveillance et un débogage approfondis.

Pourquoi les PME adoptent-elles l'IA agentique maintenant ?

Les modèles cloud et les studios à faible code ont réduit les coûts d'entrée à 20 000–60 000 USD, aidant les PME à surmonter les lacunes en compétences et à déployer des flux de travail multi-agents.

Quelle région contribuera le plus aux nouveaux revenus ?

L'Asie-Pacifique est en tête avec un CAGR de 37,89%, soutenu par le financement souverain de l'IA et les importantes initiatives d'automatisation de la fabrication.

Dernière mise à jour de la page le: