Tamaño y Participación del Mercado de Centros de Datos Optimizados con Inteligencia Artificial (IA) en Asia Pacífico

Análisis del Mercado de Centros de Datos Optimizados con Inteligencia Artificial (IA) en Asia Pacífico por Mordor Intelligence

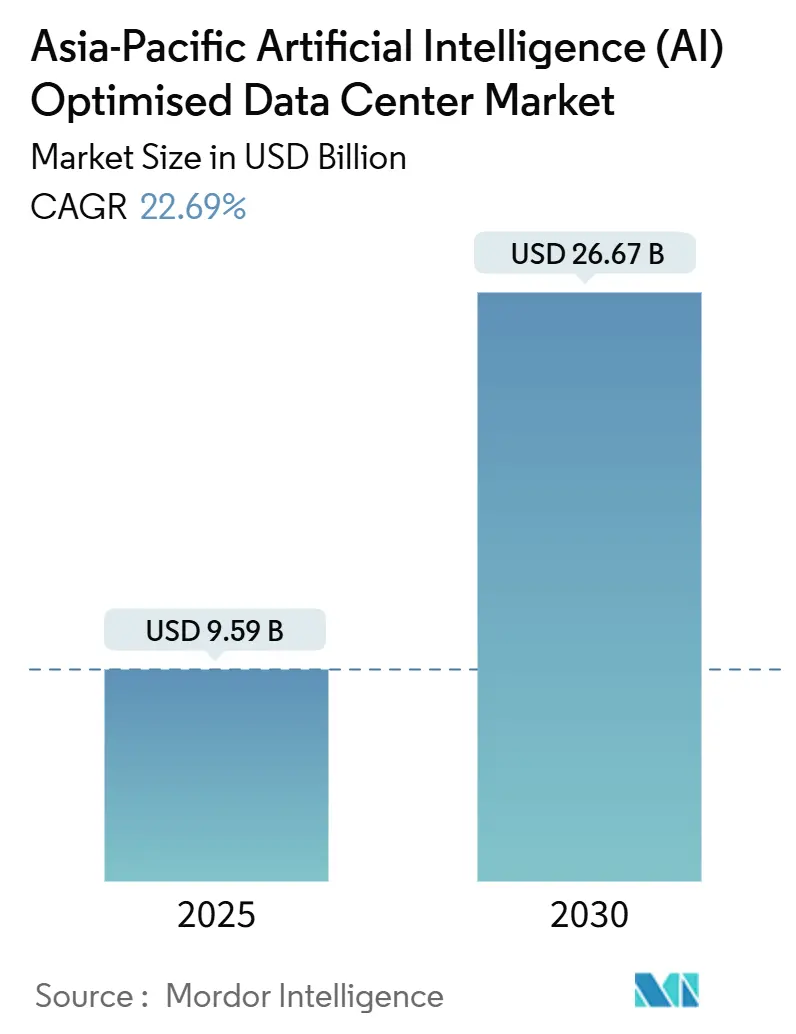

El mercado de centros de datos de inteligencia artificial de Asia Pacífico está valorado en USD 9.590 millones en 2025 y, con una CAGR del 22,69%, se prevé que alcance USD 26.670 millones en 2030, lo que subraya la expansión quinquenal más sólida registrada hasta la fecha en el gasto en infraestructura digital regional. Los operadores de nube a hiperescala siguen siendo el principal motor de la demanda, pero la legislación sobre IA soberana, la incertidumbre en torno a los controles de exportación y el salto en densidad térmica vinculado a las cargas de trabajo de IA generativa están redefiniendo la ubicación de los sitios, las opciones de refrigeración y las estrategias de adquisición de energía. En los próximos cinco años, se espera que las modernizaciones de refrigeración líquida superen en ritmo a las nuevas salas refrigeradas por aire, mientras que los plazos de prearrendamiento en los centros de colocación se alargan a medida que los bancos y los organismos del sector público se apresuran a asegurar capacidad de GPU doméstica. Los acuerdos de compra de energía regionales incorporan cada vez más garantías de energía renovable para cubrir la escasez de transformadores en las ciudades de segundo nivel de la India, y las primas de talento para ingenieros de infraestructura cualificados en IA siguen siendo entre un 35% y un 50% superiores a las de los roles heredados, consolidando la disponibilidad de mano de obra como un factor de riesgo a nivel directivo. Como resultado, los operadores capaces de combinar certificaciones de nube soberana con refrigeración avanzada y bloques de megavatios dedicados están en posición de capturar la mayor cuota de la próxima ola de crecimiento.

Conclusiones Clave del Informe

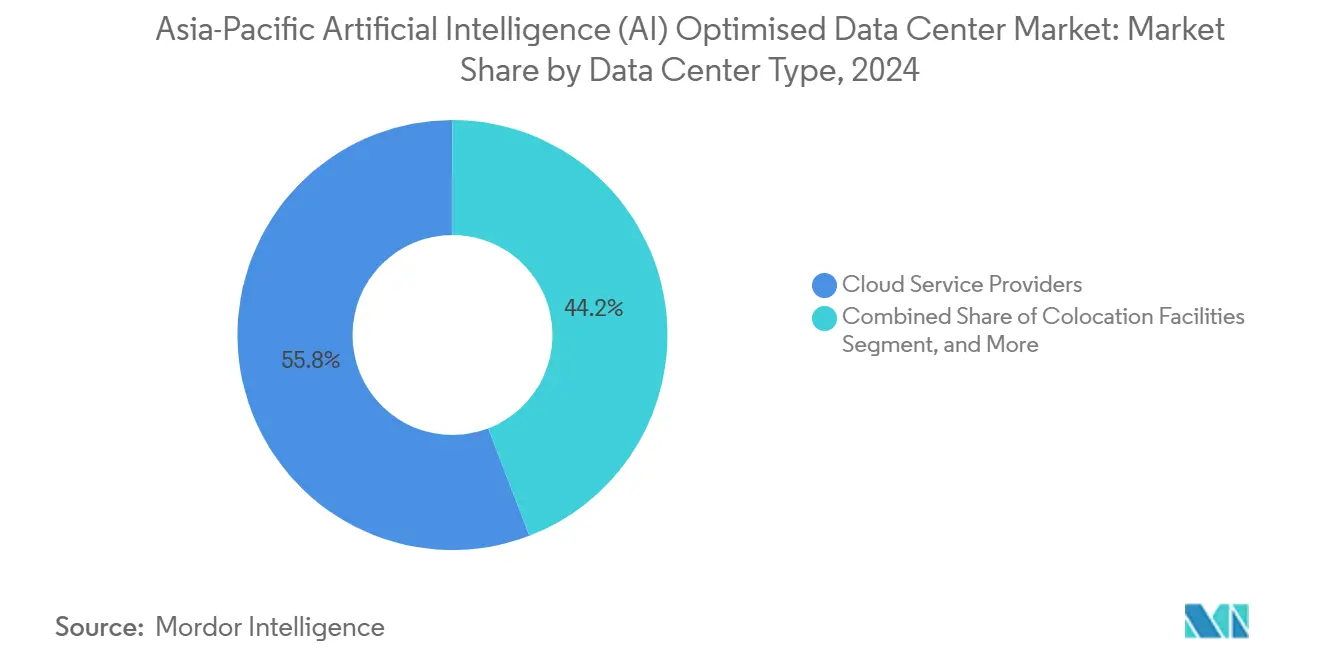

- Por tipo de centro de datos, los proveedores de nube a hiperescala lideraron con una participación del 55,82% en el mercado de centros de datos de inteligencia artificial de Asia Pacífico en 2024, mientras que las instalaciones de colocación están en camino de alcanzar una CAGR del 24,23% hasta 2030.

- Por componente, el software representó el 45,83% del tamaño del mercado de centros de datos de inteligencia artificial de Asia Pacífico en 2024, mientras que se proyecta que la infraestructura de hardware se expanda a una CAGR del 23,67% hasta 2030.

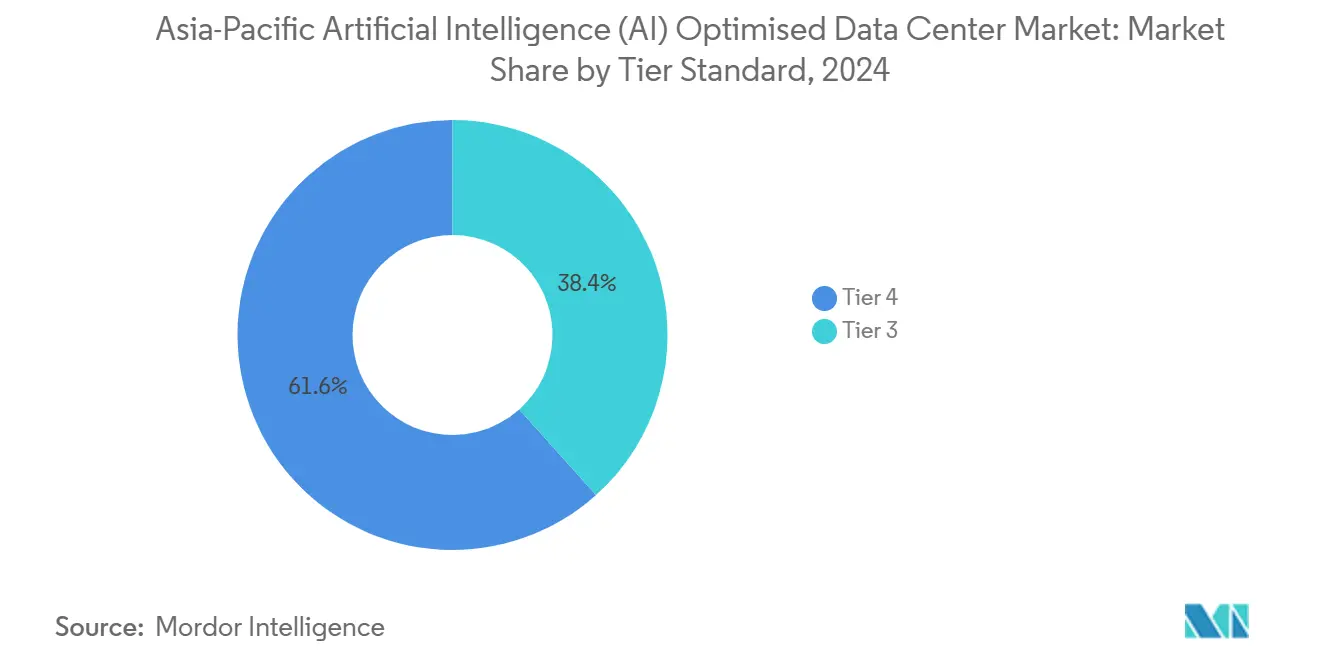

- Por estándar de nivel, las instalaciones de Nivel IV dominaron con una participación del 61,63% del tamaño del mercado de centros de datos de inteligencia artificial de Asia Pacífico en 2024; las instalaciones de Nivel III avanzan a una CAGR del 24,77%.

- Por industria del usuario final, TI y SETI representaron el 33,82% del tamaño del mercado de centros de datos de inteligencia artificial de Asia Pacífico en 2024, mientras que internet y medios digitales registran la CAGR más alta del 23,45% hasta 2030.

Tendencias e Información del Mercado de Centros de Datos Optimizados con Inteligencia Artificial (IA) en Asia Pacífico

Análisis del Impacto de los Impulsores

| Impulsor | (~) % de Impacto en el Pronóstico de CAGR | Relevancia Geográfica | Horizonte Temporal del Impacto |

|---|---|---|---|

| Expansiones de nube a hiperescala en el Sudeste Asiático | +4.2% | Núcleo del Sudeste Asiático, con efectos secundarios hacia la India | Mediano plazo (2-4 años) |

| Subsidios gubernamentales para cómputo de IA en China y Corea del Sur | +5.8% | China y Corea del Sur, contagio de políticas hacia la ASEAN | Corto plazo (≤ 2 años) |

| Modernización de instalaciones existentes con refrigeración líquida impulsada por IA | +3.1% | Global, concentrado en megasitios costeros | Mediano plazo (2-4 años) |

| Aumento del tráfico de inferencia de IA generativa en nodos de borde de telecomunicaciones | +2.9% | Núcleo de APAC, primeras ganancias en Japón y Singapur | Corto plazo (≤ 2 años) |

| Clústeres de GPU en instalaciones propias por parte de fabricantes keiretsu japoneses | +1.8% | Centrado en Japón, con efectos secundarios regionales limitados | Largo plazo (≥ 4 años) |

| Mandatos de IA soberana que aceleran el prearrendamiento de instalaciones de colocación en la ASEAN | +4.5% | Mercados de la ASEAN, con influencia regulatoria en expansión | Mediano plazo (2-4 años) |

| Fuente: Mordor Intelligence | |||

Los subsidios gubernamentales para cómputo de IA impulsan la aceleración de la infraestructura

El programa de USD 7.000 millones de Corea del Sur en IA, un 400% por encima de los presupuestos de infraestructura anteriores, destina el 60% de los fondos a adiciones de capacidad doméstica, comprimiendo los plazos de construcción a menos de 18 meses. El requisito de China de que el 80% de las cargas de trabajo de entrenamiento de IA permanezcan en territorio nacional para 2026 ha producido las tasas de prearrendamiento de colocación más altas de la región e impulsado la acumulación de inventario de GPU para mitigar el riesgo de controles de exportación. En toda la ASEAN, mandatos similares elevan las primas de nube soberana entre un 25% y un 30%, especialmente en Singapur, donde las instalaciones certificadas ya registran la menor tasa de vacancia en Asia.

Las expansiones de nube a hiperescala reconfiguran la infraestructura del Sudeste Asiático

El plan de USD 3.000 millones de Google para Tailandia y Malasia confirma la ventaja en red eléctrica que estos mercados tienen sobre los centros tradicionales, mientras que la región de nube soberana de Indonesia de Microsoft por USD 1.700 millones posiciona a la empresa por delante de la fecha límite de localización de datos de Yakarta en 2025. Cada proveedor de hiperescala requiere bloques de transformadores a nivel de parcela de 100 MW o más, lo que incentiva ubicaciones en parques industriales que pueden evitar las colas de la red eléctrica urbana.

Modernización de instalaciones existentes con refrigeración líquida impulsada por IA

Los racks de IA generativa generan entre 3 y 4 veces más calor que los servidores convencionales, lo que obliga a los operadores a adoptar refrigeración directa al chip para mantener el PUE por debajo de 1,3. NTT informa que el 40% de toda la nueva capacidad japonesa puesta en servicio en 2024 ya integra refrigeración líquida. La economía de la modernización favorece las salas existentes con carga de piso y capacidad de canalizaciones de bus suficientes, reduciendo el consumo de energía por rack entre un 15% y un 20% y duplicando la densidad sin los tiempos de espera de las nuevas construcciones.

Aumento del tráfico de inferencia de IA generativa en nodos de borde de telecomunicaciones

Los despliegues de cómputo en el borde de acceso múltiple 5G están acercando la inferencia de IA a los usuarios, reduciendo la latencia y descargando el ancho de banda de la red troncal. Japón y Singapur son los primeros en adoptar esta estrategia, instalando clústeres de GPU de pequeña escala dentro de hoteles de operadores para ofrecer servicios de traducción en tiempo real, comercio minorista inmersivo y navegación de realidad aumentada. La estrategia libera las regiones de hiperescala para tareas de entrenamiento, al tiempo que genera nuevas curvas de demanda de microcolocación.

Análisis del Impacto de las Restricciones

| Restricción | (~) % de Impacto en el Pronóstico de CAGR | Relevancia Geográfica | Horizonte Temporal del Impacto |

|---|---|---|---|

| Escasez aguda de energía de nivel de transformadores en ciudades de segundo nivel de la India | -2.1% | Ciudades de segundo nivel de la India, brechas en la infraestructura de red eléctrica | Corto plazo (≤ 2 años) |

| Controles de exportación de ASIC/GPU que afectan los plazos de suministro | -3.4% | China principalmente, con efectos secundarios en toda APAC | Mediano plazo (2-4 años) |

| Restricciones crecientes a la captación de agua marina en megasitios costeros | -1.6% | Instalaciones costeras en Singapur, Japón y Australia | Largo plazo (≥ 4 años) |

| Escasez de talento para ingenieros de software DC-IM optimizados para IA | -2.8% | Regional, aguda en Singapur, Seúl y Tokio | Mediano plazo (2-4 años) |

| Fuente: Mordor Intelligence | |||

Las carencias en infraestructura eléctrica restringen la expansión en ciudades de segundo nivel

En Pune, Hyderabad y Chennai, las asignaciones de red eléctrica están hasta un 40% por debajo de la demanda de los centros de datos, lo que prolonga los tiempos de conexión más allá de los 18 meses y obliga a los desarrolladores a recurrir a estructuras de Acuerdo de Compra de Energía renovable de mayor costo. Aunque la energía verde suaviza los perfiles de emisiones, el aumento del gasto de capital eleva los umbrales de tasa interna de retorno de los proyectos hasta en 300 puntos básicos.

Los controles de exportación de ASIC/GPU afectan los plazos de suministro

Las restricciones a los aceleradores avanzados amplían las ventanas de entrega a entre 6 y 12 meses, lo que lleva a las empresas chinas a incrementar los volúmenes de pedidos en instalaciones propias en un 180% interanual. Los compradores japoneses ahora diversifican hacia fabricantes de chips nacionales que ofrecen entre el 60% y el 70% del rendimiento de primer nivel a un costo un 40% menor, pero a expensas de la fragmentación de la pila de software y los retrasos en la validación.

Análisis de Segmentos

Por Tipo de Centro de Datos: El crecimiento de la colocación supera las normas históricas

Las instalaciones de colocación captaron el 28,35% del gasto y se expandirán a una CAGR del 24,23%, superando el crecimiento de la hiperescala a medida que las normas de IA soberana hacen obligatorio el control doméstico de racks para bancos, aseguradoras y ministerios gubernamentales. Los proveedores de hiperescala mantienen una ventaja del 55,82%, pero su participación en el mercado de centros de datos de inteligencia artificial de Asia Pacífico se ha estabilizado a medida que proliferan los nodos locales y de borde. Los operadores de colocación que aprovisionan previamente refrigeración líquida y bloques de transformadores de más de 20 MW obtienen prearrendamientos desproporcionados, especialmente en Singapur y Kuala Lumpur, donde los límites de suelo restringen la escala de nuevas construcciones. Las implementaciones empresariales y de borde, favorecidas por los keiretsu japoneses, absorben el riesgo de controles de exportación al mantener la custodia física de la GPU. El tamaño del mercado de centros de datos de inteligencia artificial de Asia Pacífico vinculado a los nodos empresariales en instalaciones propias superará los USD 3.000 millones para 2030, lo que refleja una diversificación sostenida respecto a la nube pública. A lo largo del horizonte de pronóstico, se espera que las expansiones de los proveedores de hiperescala se consoliden en torno a cinco corredores ricos en energía, afianzando su papel en las cargas de trabajo de entrenamiento mientras transfieren la inferencia crítica en cuanto a latencia a pods de colocación en el borde.

Entre 2025 y 2030, los compromisos de expansión de los proveedores de hiperescala -USD 2.900 millones de Microsoft en Japón y USD 3.000 millones de Google en el Sudeste Asiático continental- elevan la CAGR histórica del segmento del 18,4% al 21,8%. Los proveedores que integran derechos de aterrizaje de cables submarinos con capacidad de GPU directa crean un foso defensivo frente a los competidores domésticos. Mientras tanto, el mercado de centros de datos de inteligencia artificial de Asia Pacífico sigue recompensando a los grupos de colocación que obtienen sellos de gobernanza de IA y ofrecen estructuras de interconexión de baja latencia, lo que permite a los inquilinos conectar clústeres privados a las GPU de hiperescala cuando se relaxen los límites de exportación.

Nota: Las participaciones de cada segmento están disponibles con la compra del informe

Por Componente: El auge del hardware llega a medida que la IA pasa de la fase piloto a la producción

El software aún representa el 45,83% del gasto de 2024 porque los marcos de modelos, las capas de orquestación y las plataformas de observabilidad siguen siendo fundamentales para la construcción de IA. Sin embargo, el hardware -el segmento de más rápido crecimiento con una CAGR del 23,67%- se prevé que supere los USD 10.000 millones del tamaño del mercado de centros de datos de inteligencia artificial de Asia Pacífico para 2030, impulsado por el giro desde la experimentación basada en la nube hacia clústeres de inferencia a escala que ponen a prueba los umbrales de densidad de racks. Los operadores ahora reservan más de la mitad del gasto de capital de 2025 para circuitos de refrigeración, canalizaciones de bus y aparamenta de media tensión capaces de sostener temperaturas superiores a 40 kW por rack.

La energía y la refrigeración absorben el mayor desembolso en hardware; cada rack de GPU consume hasta 10 veces la corriente de un rack de CPU, lo que lleva a muchas salas a alimentaciones de red eléctrica de 30 MVA. Solo la adquisición de refrigeración líquida crece a un ritmo anual del 35% en Japón, lo que eleva la participación del país en el mercado de centros de datos de inteligencia artificial de Asia Pacífico dentro de la categoría de hardware. Los servicios, que representan el 31,52% del gasto, se están orientando hacia ofertas gestionadas a medida que los clientes externalizan el ajuste de réplicas, puntos de control de gradiente y programación consciente de la energía. El crecimiento de los servicios profesionales se rezaga a medida que los proveedores de hiperescala internalizan las competencias de diseño y los proveedores más pequeños se apoyan en arquitecturas de referencia de proveedores como Schneider Electric. En toda la región, las restricciones en la cadena de suministro de GPU y tejidos de red llevan a los operadores a mantener reservas de inventario de tres meses, inmovilizando capital de trabajo pero garantizando la continuidad del despliegue.

Por Estándar de Nivel: El impulso del Nivel III se afianza en el borde

Las salas de Nivel IV siguen dominando con una participación del 61,63% porque el tiempo de inactividad en el entrenamiento de IA puede eliminar semanas de trabajo de cómputo y afectar los presupuestos de reentrenamiento de modelos. Aun así, los recintos de Nivel III -con una CAGR prevista del 24,77%- captan nueva demanda para la inferencia, donde las breves interrupciones pueden absorberse mediante el enrutamiento del tráfico y la reprogramación de microlotes. El tamaño del mercado de centros de datos de inteligencia artificial de Asia Pacífico vinculado a las instalaciones de Nivel III superará los USD 6.000 millones para 2030, apoyado por implementaciones en el borde en intercambios de telecomunicaciones y refugios de fibra metropolitana.

Las cargas de trabajo de IA soberana de China continúan exigiendo redundancia de Nivel IV, pero el Sudeste Asiático flexibiliza hacia niveles de Nivel III que intercambian cinco nueves de disponibilidad por tiempos de construcción más rápidos y un gasto de capital entre un 18% y un 20% menor. Los reguladores japoneses ahora aceptan pods modulares de Nivel III dentro de fábricas para acortar los ciclos de diseño de semiconductores. Mientras tanto, el crecimiento del Nivel IV sube ligeramente a una CAGR del 22,1% a medida que los proveedores de hiperescala con abundante capital duplican los acuerdos de liquidez con los proveedores para asegurar aparamenta y enfriadores con 12 meses de antelación. La distribución de la participación en el mercado de centros de datos de inteligencia artificial de Asia Pacífico entre niveles se reducirá, aunque ambos siguen siendo indispensables: uno para el entrenamiento ininterrumpido y el otro para la inferencia sensible a la latencia en el borde de la red.

Por Industria del Usuario Final: Internet y Medios Digitales se disparan

TI y SETI representaron el 33,82% del gasto de 2024 gracias a la adopción temprana de canalizaciones de integración continua y marcos de pruebas automatizadas impulsados por modelos de lenguaje de gran escala. En contraste, Internet y Medios Digitales crece a una CAGR del 23,45%, impulsado por la generación de contenido en tiempo real, los motores de recomendación y las experiencias sociales inmersivas que requieren inferencia en el orden de los milisegundos. La industria de centros de datos de inteligencia artificial de Asia Pacífico está siendo testigo de cómo las empresas de telecomunicaciones asignan el 18,7% del gasto a nodos de borde de acceso múltiple para habilitar superposiciones de realidad aumentada con visión artificial para los suscriptores de 5G.[1]GSMA Future Networks Team, "Multi-access edge computing overview", GSMA, gsma.com

La participación del 15,2% del sector de Banca, Servicios Financieros y Seguros es estable porque los equipos de riesgo y cumplimiento normativo deben alojar los ciclos de ajuste fino dentro de las fronteras nacionales, lo que eleva las primas de nube soberana. Salud y Ciencias de la Vida añaden una CAGR del 22,8% al aprovechar la IA generativa en el descubrimiento de fármacos y el triaje radiológico, frecuentemente bajo normas de privacidad de nivel hospitalario.[2]Editores de Health-Tech, "AI accelerates drug discovery and imaging", Nature Medicine, nature.com Los casos de uso en manufactura se concentran en el mantenimiento predictivo y la detección de defectos en línea, lo que requiere integración de controladores en el borde que favorece los clústeres en instalaciones propias dentro de las fábricas. Gobierno y Defensa, aunque de menor tamaño, disfrutan de acceso prioritario a bloques de transformadores y derechos de agua, lo que garantiza que las instalaciones alcancen el estado de preparación antes que sus contrapartes civiles.

Análisis Geográfico

China domina el mercado de centros de datos de inteligencia artificial de Asia Pacífico con una participación del 42,74% en 2024, respaldada por directivas que exigen que el 80% de las cargas de trabajo de entrenamiento permanezcan en territorio nacional para 2026. El crecimiento anual se acelera al 22,3% a medida que los vientos en contra de los controles de exportación impulsan incrementos interanuales del 180% en los despliegues de GPU domésticas. Los mandatos de refrigeración líquida respaldados por Pekín para las salas con más de 10 MW desencadenan auges de modernización en los campus heredados, sosteniendo la tasa de ejecución de gasto de capital desproporcionada del país.

Japón, con una participación del 21,3%, aprovecha una inversión extranjera directa récord -USD 8.000 millones de Oracle y USD 2.900 millones de Microsoft- para consolidar su papel como el laboratorio de refrigeración más avanzado de la región. Las aprobaciones nacionales aceleradas para salas con PUE inferior a 1,3 permiten que los proyectos comiencen la construcción en un plazo de 90 días, y los accionistas keiretsu añaden USD 2.000 millones en clústeres de instalaciones propias para proteger la propiedad intelectual de diseño.

Corea del Sur registra la CAGR más rápida de la región, del 26,61%, respaldada por un estímulo de IA de USD 7.000 millones centrado en subsidios de capacidad doméstica y créditos fiscales. El mandato de cómputo en el borde del regulador de telecomunicaciones para 2025 inclina aún más el gasto hacia nodos 5G distribuidos, creando vías de demanda paralelas para los operadores de hiperescala y microcolocación.

La participación del 18,9% de la India sigue limitada por cuellos de botella en transformadores y colas de red eléctrica en las ciudades metropolitanas de segundo nivel, aunque los Acuerdos de Compra de Energía renovable y la adquisición de terrenos en corredores costeros mantienen intactas las perspectivas a largo plazo. Australia y Nueva Zelanda conjuntamente poseen una participación del 8,4%, atrayendo inversores con segmentaciones de nube soberana orientadas a agencias de defensa y salud.[3]Claire Jones, "Australia sovereign cloud AI infrastructure", Australian Financial Review, afr.com Singapur, aunque solo representa el 6,1% por ingresos, ejerce una influencia regulatoria desproporcionada; su marco de gobernanza de IA sirve ahora como plantilla de certificación en toda la ASEAN. Las naciones restantes del Sudeste Asiático aprovechan las grandes inversiones de los proveedores de hiperescala para superar la infraestructura heredada, posicionando el corredor como la adyacencia de mayor crecimiento en el mundo para las cargas de trabajo de IA.

Panorama Competitivo

La concentración del mercado de centros de datos de inteligencia artificial de Asia Pacífico es moderada, ya que los proveedores de hiperescala, las empresas de telecomunicaciones regionales y las empresas independientes de colocación persiguen estrategias superpuestas. Alibaba Cloud, Tencent Cloud, Amazon Web Services y Microsoft Azure continúan integrando servicios en la nube con bienes raíces propios, pero el aumento de las normas de residencia de datos permite a los campeones domésticos como NTT Global Data Centers y STT GDC defender su participación mediante certificaciones de cumplimiento normativo y circuitos de refrigeración líquida preinstalados.

Los movimientos estratégicos incluyen los acuerdos de nube soberana de Microsoft con ministerios tailandeses, el megaclúster Tokyo-Osaka de Oracle optimizado para racks de IA de 40 kW, y la adquisición de STT GDC por USD 800 millones de salas indias ya equipadas para densidades de GPU superiores a 30 kW. Las alianzas tecnológicas se profundizan: Schneider Electric y Vertiv proporcionan módulos de refrigeración de circuito cerrado, mientras que NVIDIA y Huawei compiten por diseños de aceleradores en medio de las restricciones de exportación. Los operadores con propiedad intelectual interna en refrigeración líquida capturan rentas premium y pueden diferir las amortizaciones de instalaciones existentes duplicando la densidad de racks sin ampliar la huella.

La escasez de talento define la lógica de las fusiones y adquisiciones; las empresas consideran la plantilla de ingeniería como un activo escaso y pagan primas de adquisición por equipos capaces de integrar refrigeración directa al chip, programadores de cargas de trabajo de IA y software de gestión de centros de datos adaptativo en cuanto a energía. La intensidad competitiva también aumenta en el borde, donde NTT y Singtel aprovechan los derechos de acceso de fibra óptica para desplegar pods de microcolocación que vinculan los sitios de red de acceso por radio 5G con aceleradores de GPU, reduciendo así la latencia de último kilómetro para las cargas de trabajo de realidad aumentada y videojuegos. En general, el mercado recompensa a los actores capaces de unir garantías de cumplimiento normativo, refrigeración de alta densidad y resiliencia energética dentro de una única oferta comercial.

Líderes de la Industria de Centros de Datos Optimizados con Inteligencia Artificial (IA) en Asia Pacífico

NVIDIA Corporation

Huawei Technologies Co., Ltd.

Sunbird Software, Inc.

Delta Electronics

Daikin Industries

- *Nota aclaratoria: los principales jugadores no se ordenaron de un modo en especial

Desarrollos Recientes de la Industria

- Marzo de 2025: Alibaba Cloud presentó su más reciente incorporación a la "serie Qwen" de modelos de inteligencia artificial. Este lanzamiento se produce en medio de una creciente competencia en el ámbito de los modelos de lenguaje de gran escala de China, especialmente tras el notable "momento DeepSeek". El modelo recién introducido,

Qwen2.5-Omni-7B,

cuenta con capacidades multimodales, lo que le permite manejar entradas diversas como texto, imágenes, audio y video. A cambio, genera salidas instantáneas de texto y voz natural. - Febrero de 2025: Daikin presentó su más reciente oferta, el Manejador de Aire para Sala de Cómputo Pro-C (CRAH, por sus siglas en inglés), reforzando su línea de productos para Centros de Datos. Diseñada para atender los diversos requisitos de refrigeración de los Centros de Datos, la unidad cuenta con un diseño mejorado y sofisticados mecanismos de control.

- Enero de 2025: Microsoft añadió USD 1.500 millones al desarrollo de IA en Tailandia, introduciendo zonas de nube soberana para clientes del sector financiero y del sector público.

- Diciembre de 2024: Oracle inauguró el primer tramo de USD 8.000 millones de salas de GPU en Japón en Tokio y Osaka con racks refrigerados por líquido de 40 kW.

Alcance del Informe del Mercado de Centros de Datos Optimizados con Inteligencia Artificial (IA) en Asia Pacífico

El término "Inteligencia Artificial (IA) en los centros de datos" profundiza en la integración de diversas tecnologías de IA, que abarcan el aprendizaje automático, el aprendizaje profundo, el procesamiento del lenguaje natural y la visión artificial en las operaciones de los centros de datos. Estas operaciones abarcan un espectro de componentes, desde la infraestructura y la gestión de la energía hasta el almacenamiento, las redes, la ciberseguridad y la automatización de instalaciones.

El Informe del Mercado de Centros de Datos de Inteligencia Artificial (IA) de Asia Pacífico está segmentado por Tipo de Centro de Datos (Centros de Datos de Proveedor de Servicios en la Nube, Centros de Datos de Colocación y Otros (Empresarial y en el Borde)), por Componente (Hardware (Energía, Refrigeración, Equipos de TI y Otros), Tecnología de Software (Aprendizaje Automático, Aprendizaje Profundo, Procesamiento del Lenguaje Natural y Visión Artificial)) y Servicios, y por País (China, India, Japón, Malasia, Australia, Singapur, Indonesia, Tailandia, Corea del Sur y el Resto de Asia Pacífico). Los Tamaños de Mercado y los Pronósticos se Proporcionan en Valores (USD) para todos los Segmentos Anteriores.

| Proveedores de Servicios en la Nube |

| Instalaciones de Colocación |

| Empresarial / En Instalaciones Propias / En el Borde |

| Hardware | Infraestructura de Energía |

| Infraestructura de Refrigeración | |

| Equipos de TI | |

| Racks y Otro Hardware | |

| Tecnología de Software | Aprendizaje Automático |

| Aprendizaje Profundo | |

| Procesamiento del Lenguaje Natural | |

| Visión Artificial | |

| Servicios | Servicios Gestionados |

| Servicios Profesionales |

| Nivel III |

| Nivel IV |

| TI y SETI |

| Internet y Medios Digitales |

| Operadores de Telecomunicaciones |

| Banca, Servicios Financieros y Seguros |

| Salud y Ciencias de la Vida |

| Manufactura e Internet Industrial de las Cosas |

| Gobierno y Defensa |

| China |

| Japón |

| India |

| Malasia |

| Corea del Sur |

| Singapur |

| Resto de Asia Pacífico |

| Por Tipo de Centro de Datos | Proveedores de Servicios en la Nube | |

| Instalaciones de Colocación | ||

| Empresarial / En Instalaciones Propias / En el Borde | ||

| Por Componente | Hardware | Infraestructura de Energía |

| Infraestructura de Refrigeración | ||

| Equipos de TI | ||

| Racks y Otro Hardware | ||

| Tecnología de Software | Aprendizaje Automático | |

| Aprendizaje Profundo | ||

| Procesamiento del Lenguaje Natural | ||

| Visión Artificial | ||

| Servicios | Servicios Gestionados | |

| Servicios Profesionales | ||

| Por Estándar de Nivel | Nivel III | |

| Nivel IV | ||

| Por Industria del Usuario Final | TI y SETI | |

| Internet y Medios Digitales | ||

| Operadores de Telecomunicaciones | ||

| Banca, Servicios Financieros y Seguros | ||

| Salud y Ciencias de la Vida | ||

| Manufactura e Internet Industrial de las Cosas | ||

| Gobierno y Defensa | ||

| Por País | China | |

| Japón | ||

| India | ||

| Malasia | ||

| Corea del Sur | ||

| Singapur | ||

| Resto de Asia Pacífico | ||

Preguntas Clave Respondidas en el Informe

¿Qué tasa de crecimiento se prevé para el mercado de centros de datos de inteligencia artificial de Asia Pacífico hasta 2030?

Se proyecta que el mercado se expanda a una CAGR del 22,69%, alcanzando USD 26.670 millones para 2030.

¿Qué segmento crece más rápido dentro de los centros de datos de IA de Asia Pacífico?

Las instalaciones de colocación lideran con una CAGR del 24,23% a medida que las normas de IA soberana impulsan la demanda doméstica de racks.

¿Por qué se están acelerando las modernizaciones de refrigeración líquida en las salas de GPU de Asia Pacífico?

Los racks de IA generativa generan entre 3 y 4 veces más calor que los servidores tradicionales, y la refrigeración líquida mantiene el PUE por debajo de 1,3 al tiempo que duplica la densidad de racks.

¿Qué país registra el ritmo de crecimiento más alto?

Corea del Sur registra la CAGR más sólida del 26,61%, respaldada por USD 7.000 millones en incentivos específicos para centros de datos de IA.

¿Cómo influyen los controles de exportación en las estrategias regionales de infraestructura de IA?

Las restricciones amplían los plazos de entrega de GPU a entre 6 y 12 meses, lo que lleva a las empresas chinas y japonesas a acumular aceleradores y favorecer los clústeres en instalaciones propias.

Última actualización de la página el: