Größe und Marktanteil des Marktes für Big-Data-Technologie

Analyse des Marktes für Big-Data-Technologie von Mordor Intelligence

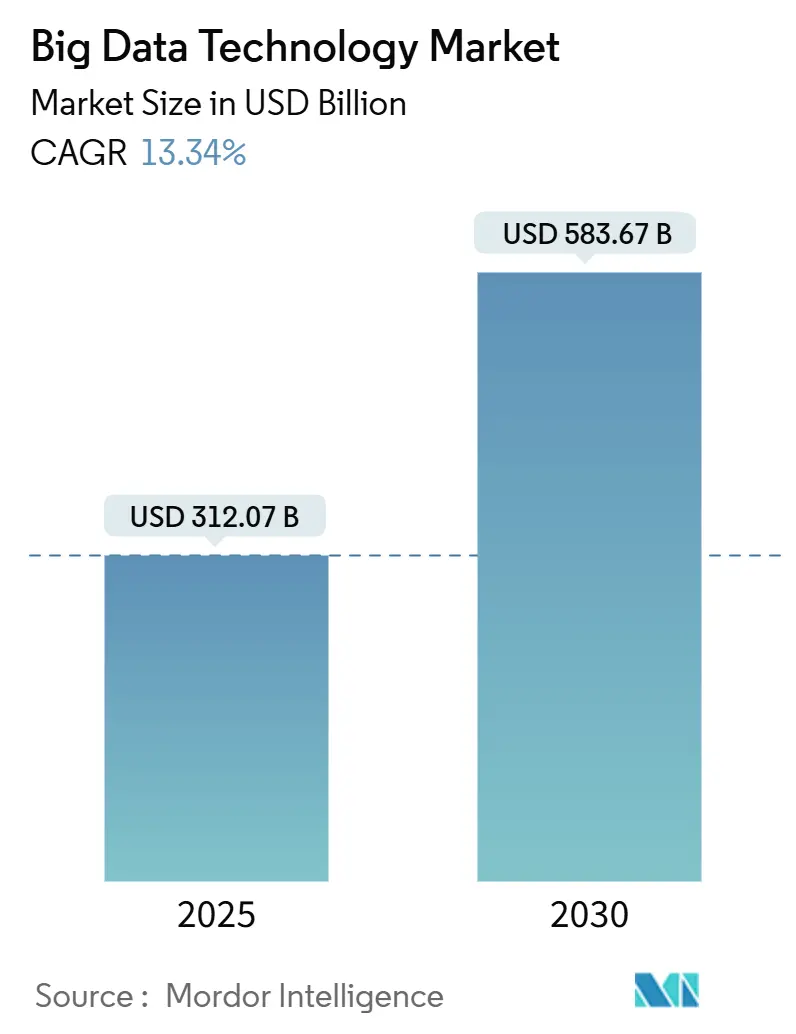

Die Marktgröße für Big-Data-Technologie wird voraussichtlich bis 2030 einen Wert von 583,67 Milliarden USD erreichen und dabei ausgehend von 312,07 Milliarden USD im Jahr 2025 eine CAGR von 13,34 % verzeichnen. Unternehmen vollziehen den Übergang von passiver Speicherung zu intelligenten Plattformen, die Echtzeit-Analysen, maschinelles Lernen und verteilte Verarbeitung in hybriden Umgebungen integrieren. Dienstleistungen beanspruchen derzeit den größten Umsatzanteil, während Software den größten inkrementellen Mehrwert schafft, da Unternehmen auf Cloud-agnostische Toolchains standardisieren. Die zunehmende Abhängigkeit von öffentlichen Cloud-Regionen in Verbindung mit Datensouveränitätsverpflichtungen fördert hybride Bereitstellungen, während verbrauchsbasierte Preisgestaltung kleine und mittlere Unternehmen in die erweiterte Analytik einbezieht. Die Branchennachfrage ist besonders stark im Banken- und Gesundheitswesen, wo Betrugsprävention mit geringer Latenz und Genomik-Workloads eine spezialisierte Infrastruktur erfordern. Die Wettbewerbsdynamik spiegelt eine moderate Konzentration wider, wobei die fünf führenden Anbieter rund 35 % des Software-Umsatzes 2024 auf sich vereinen und Raum für Spezialisten in den Bereichen Edge-Analytik und datenschutzerhaltende Berechnung lassen.

Wichtigste Erkenntnisse des Berichts

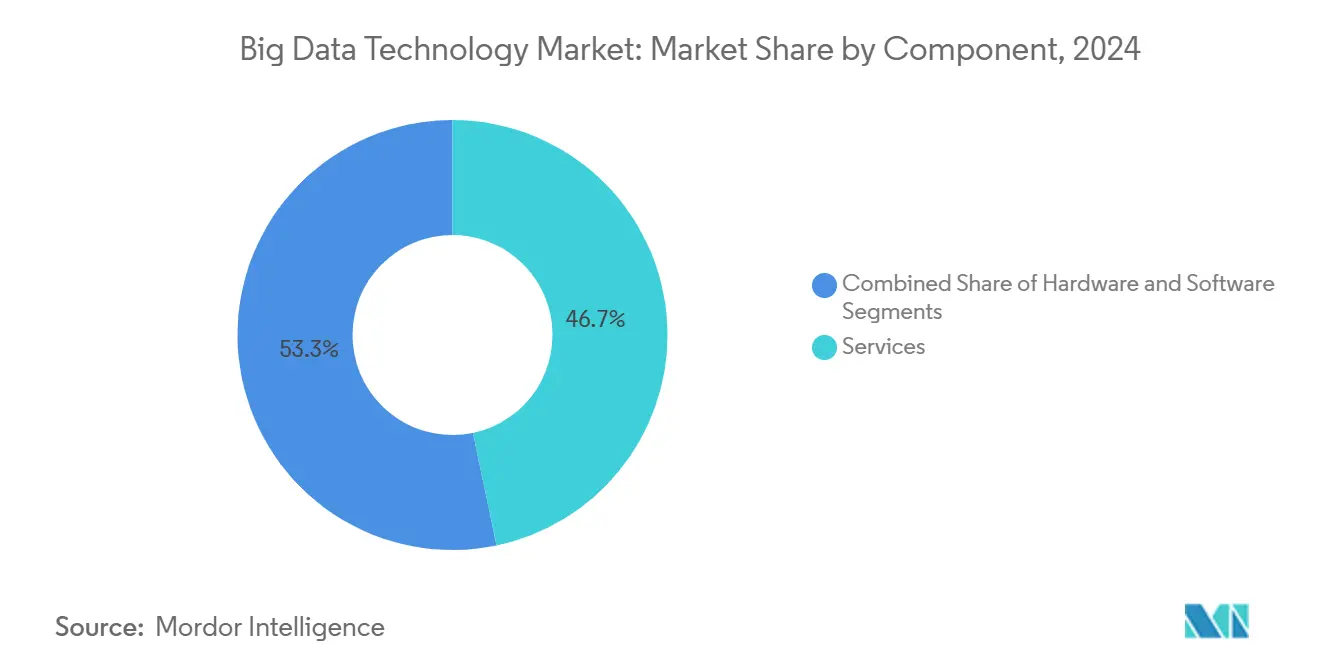

- Nach Komponente führten Dienstleistungen mit einem Anteil von 46,72 % am Markt für Big-Data-Technologie im Jahr 2024, während Software bis 2030 eine CAGR von 13,89 % verzeichnen soll.

- Nach Bereitstellungsmodell hielt die Cloud im Jahr 2024 einen Anteil von 61,22 % am Markt für Big-Data-Technologie; hybride Konfigurationen sollen bis 2030 mit einer CAGR von 13,94 % wachsen.

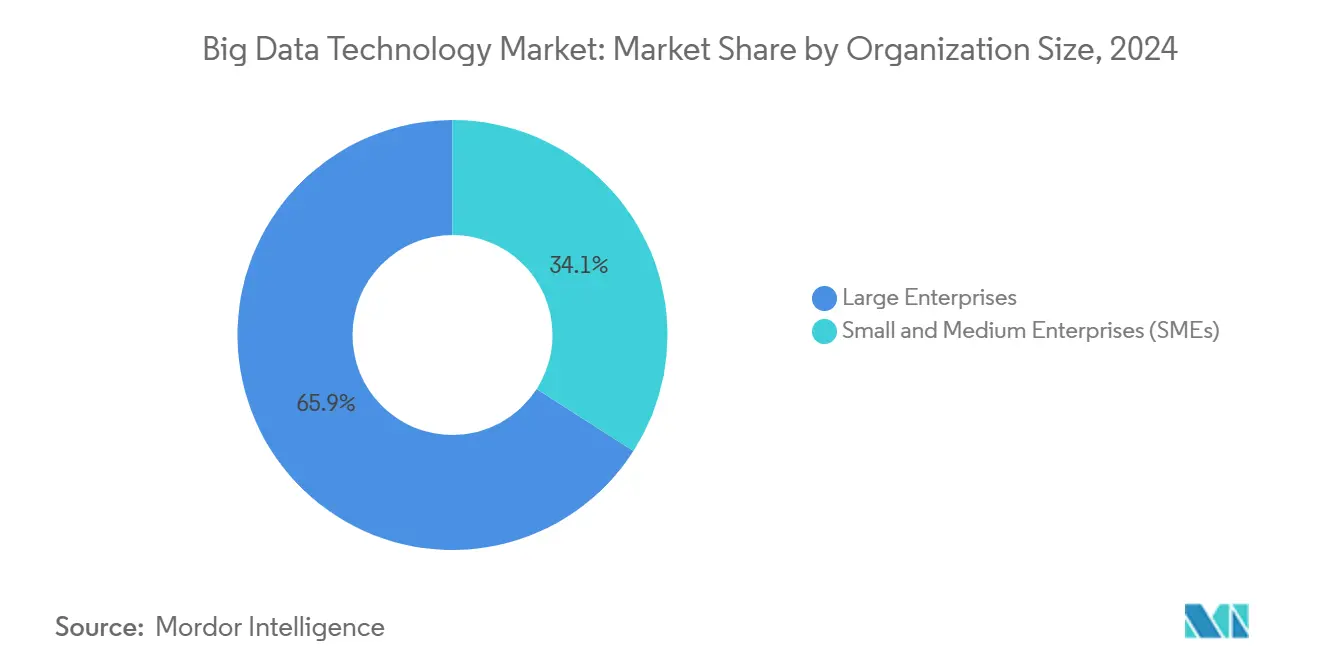

- Nach Unternehmensgröße entfielen auf Großunternehmen im Jahr 2024 65,93 % des Marktanteils für Big-Data-Technologie, während kleine und mittlere Unternehmen mit einer CAGR von 13,66 % am schnellsten wachsen.

- Nach Branchenvertikale werden Banken, Finanzdienstleistungen und Versicherungen voraussichtlich 25,67 % des Marktanteils für Big-Data-Technologie im Jahr 2024 ausmachen; Gesundheitswesen und Biowissenschaften sollen mit einer CAGR von 15,13 % wachsen.

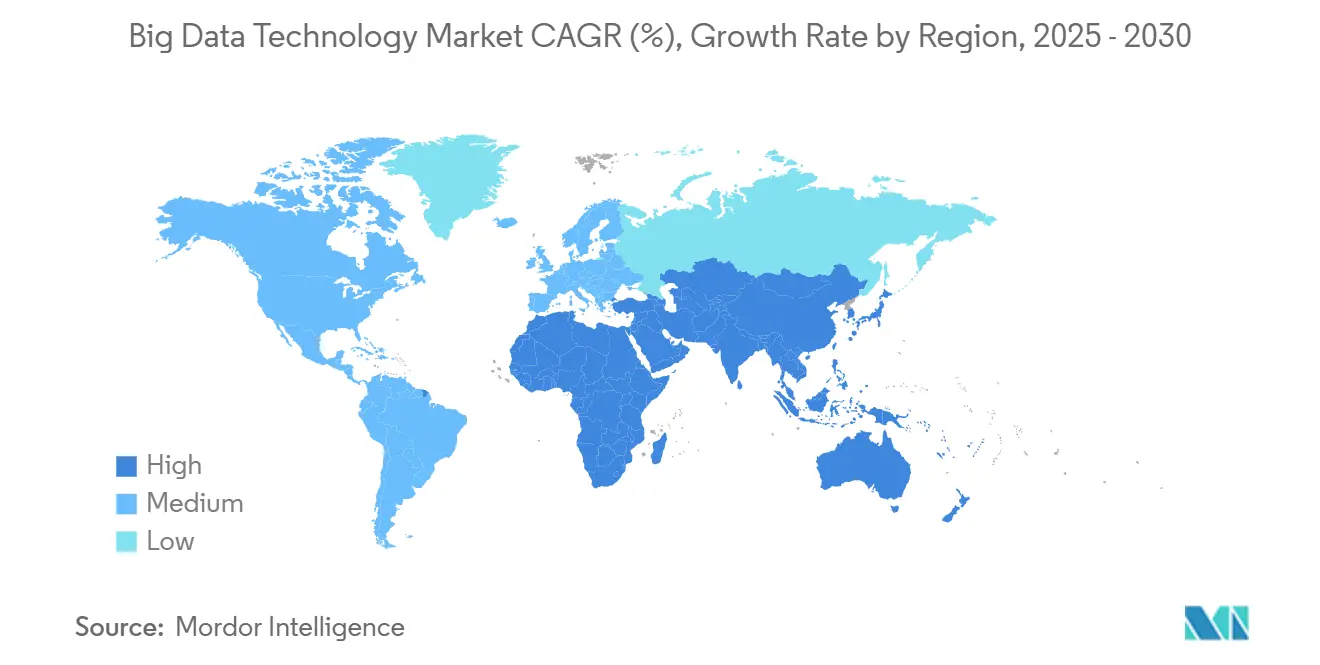

- Nach Geografie hielt Nordamerika im Jahr 2024 einen Anteil von 37,19 % am Markt für Big-Data-Technologie; die Region Asien-Pazifik ist jedoch auf dem Weg zu einer CAGR von 14,41 % bis 2030.

Globale Trends und Erkenntnisse zum Markt für Big-Data-Technologie

Analyse der Auswirkungen von Treibern

| Treiber | (~) % Auswirkung auf die CAGR-Prognose | Geografische Relevanz | Auswirkungszeitraum |

|---|---|---|---|

| Rasante Cloud-Akzeptanz | +3.2% | Global, am stärksten in Nordamerika und Westeuropa | Mittelfristig (2–4 Jahre) |

| Exponentielles Wachstum des Datenvolumens | +2.8% | Global, mit Schwerpunkt auf Asien-Pazifik | Langfristig (≥ 4 Jahre) |

| Fortschritte bei KI und maschinellem Lernen | +2.5% | Nordamerika und Asien-Pazifik | Mittelfristig (2–4 Jahre) |

| Steigende Nachfrage nach Echtzeit-Analysen | +2.1% | Global, frühe Akzeptanz in BFSI und Telekommunikation | Kurzfristig (≤ 2 Jahre) |

| Entstehung der Data-Fabric-Architektur | +1.6% | Nordamerika und Europa | Langfristig (≥ 4 Jahre) |

| Verbreitung von Datenaustauschplattformen und Datenmärkten | +1.1% | Nordamerika und Europa, andernorts noch in einem frühen Stadium | Langfristig (≥ 4 Jahre) |

| Quelle: Mordor Intelligence | |||

Rasante Cloud-Akzeptanz

Cloud-Dienste vereinnahmten 61,22 % des Umsatzes 2024, und die Kapitalausgaben der Hyperscaler überstiegen in jenem Jahr 200 Milliarden USD. Microsoft widmete rund 40 % seines Infrastrukturbudgets 2024 KI-optimierten Instanzen, die das Modelltraining um das Zehnfache beschleunigen.[1]Microsoft, „Azure-Kapitalausgaben 2024,” Microsoft.com Amazon plant bis 2025 zusätzliche Kapazitäten in Höhe von 75 Milliarden USD, um datennahe Workloads in Indien und Saudi-Arabien zu unterstützen. Diese Investitionen senken die Einstiegshürden für Analysen, verkürzen Hardware-Erneuerungszyklen und motivieren Unternehmen zur Plattformkonsolidierung, um Egress-Kosten zu begrenzen. Infolgedessen soll die Cloud-Akzeptanz die Gesamtnachfrage steigern und gleichzeitig Ausgaben von On-Premise-Hardware hin zu Abonnement-Software umlenken.

Exponentielles Wachstum des Datenvolumens

Die globale Datenerzeugung erreichte 2025 181 Zettabyte und ist auf dem Weg zu 1 Yottabyte bis 2030.[2]Ericsson, „Mobility Report 2025,” Ericsson.com Der mobile Datenverkehr steigt jährlich um 25 %, wobei Videos mit erweiterter Realität drei Viertel der Bandbreite beanspruchen. Huawei prognostiziert, dass bis 2028 40 % der Unternehmensdaten am Edge verarbeitet werden, was die Analytik über Geräte hinweg fragmentiert. Der Volumendruck erzwingt mehrstufige Speicherstrategien, die die Datenmigration von heißen zu kalten Ebenen automatisieren und die Kosten um bis zu 60 % senken. Anbieter, die das Lebenszyklusmanagement vereinfachen, verschaffen sich einen Vorteil, da Unternehmen Schwierigkeiten haben, Kosten, Compliance und Leistung in Einklang zu bringen.

Fortschritte bei der Integration von KI und maschinellem Lernen

Confluent stellte fest, dass 84 % der Datenverantwortlichen mindestens das Doppelte ihrer Investition aus Echtzeit-Streaming-Plattformen erzielten, die Modelle für maschinelles Lernen speisen.[3]Confluent, „Real-Time Data Streaming ROI Survey 2024,” Confluent.io Google Cloud berichtete, dass 79 % der Kunden KI-Workloads nun über verwaltete Dienste ausführen, wobei Aufgaben zur natürlichen Sprache und Bildverarbeitung um 45 % im Jahresvergleich gestiegen sind. Databricks fügte 2024 automatisiertes Lakehouse-Monitoring hinzu, um Modelle bei Datendrift neu zu trainieren. Zusammen verwischen diese Fortschritte die Grenzen zwischen Business Intelligence und Data Science, indem prädiktive Funktionen direkt in operative Anwendungen eingebettet und die Zeit bis zur Wertschöpfung beschleunigt wird.

Steigende Nachfrage nach Echtzeit-Analysen

Confluent stellte fest, dass 86 % der Unternehmen im Jahr 2024 Echtzeit-Stream-Verarbeitung priorisierten, insbesondere für Betrugserkennung und dynamische Preisgestaltung. Snowflakes dynamische Tabellen halten Dashboards durch inkrementelle Aktualisierung aktuell und senken den Rechenaufwand für hochfrequente Aggregate um 70 %. Telekommunikationsbetreiber passen Routing-Pfade nun in Millisekunden an und reduzieren Überlastungen um bis zu 30 %. Der Bedarf nach Unmittelbarkeit gestaltet Architekturen rund um Change-Data-Capture und Event-Streaming um und verdrängt batch-orientierte Warehouse-Modelle.

Analyse der Auswirkungen von Hemmnissen

| Hemmnis | (~) % Auswirkung auf die CAGR-Prognose | Geografische Relevanz | Auswirkungszeitraum |

|---|---|---|---|

| Hohe Infrastrukturkosten | -2.4% | Global, höchste Auswirkung in Schwellenmärkten | Mittelfristig (2–4 Jahre) |

| Mangel an qualifizierten Fachkräften für Big-Data-Technologie | -1.9% | Global, gravierend in Asien-Pazifik sowie Nahost und Afrika | Langfristig (≥ 4 Jahre) |

| Wachsende Datensouveränitätsvorschriften | -1.5% | Europäische Union, China, Indien | Mittelfristig (2–4 Jahre) |

| Bedenken hinsichtlich des Energieverbrauchs bei der Datenverarbeitung | -0.8% | Global, regulatorische Kontrolle in der Europäischen Union und Kalifornien | Langfristig (≥ 4 Jahre) |

| Quelle: Mordor Intelligence | |||

Hohe Infrastrukturkosten

Meta investierte 2024 38–40 Milliarden USD in die Sicherung fortschrittlicher Rechenzentren, darunter flüssigkeitsgekühlte Hardware mit einem Power Usage Effectiveness-Wert unter 1,1. Oracle gab im gleichen Zeitraum 6,9 Milliarden USD aus, um seinen globalen Cloud-Fußabdruck zu erweitern. Unternehmen ohne derartige Budgets finden On-Premise-Cluster kostspielig, wobei ein minimales Hadoop-Setup noch immer 500.000 USD vor Software und Personal erfordert. Obwohl Pay-as-you-go-Cloud-Dienste die Kapitalausgaben senken, kann intensiver Datentransfer die Gesamtbetriebskosten langfristig erhöhen. Kostenhürden verlangsamen daher die Akzeptanz bei mittelständischen Unternehmen und in Regionen, in denen Finanzierungsmöglichkeiten knapp sind.

Mangel an qualifizierten Fachkräften für Big-Data-Technologie

McKinsey schätzte, dass 2024 3,5 Millionen Datenstellen unbesetzt blieben, was die Gehälter für erfahrene Ingenieure in großen US-amerikanischen Ballungsräumen auf 120.000–150.000 USD trieb. PwC stellte fest, dass 60 % der Unternehmen Umschulungsprogramme starteten, doch die meisten Kurse dauern sechs Monate oder länger, bevor die Teilnehmer produktiv werden. Der Fachkräftemangel zwingt Unternehmen zur Nutzung verwalteter Dienste, die die Infrastrukturkomplexität verbergen, aber die Abhängigkeit von externen Anbietern erhöht das Lock-in-Risiko und kann langfristige Kosten in die Höhe treiben. Der Qualifikationsengpass ist besonders ausgeprägt in Asien-Pazifik sowie Nahost und Afrika, was die regionale Projektgeschwindigkeit trotz steigender Nachfrage begrenzt.

Segmentanalyse

Nach Komponente: Dienstleistungen sichern den Umsatz, während Software die Innovationsprämie vereinnahmt

Dienstleistungen trugen 46,72 % zum Umsatz 2024 bei, was die Abhängigkeit von Integratoren und verwalteten Anbietern beim Zusammenführen von Multi-Cloud-Analyse-Ökosystemen unterstreicht. Ein typisches Professional-Services-Engagement reicht von 500.000 bis 5 Millionen USD und umfasst Architekturdesign, Migration und Change-Management-Schulungen. Verwaltete Verträge liefern dann laufende Überwachung, Patches und Optimierung. Unterdessen soll Software mit einer CAGR von 13,89 % wachsen, da Anbieter verbrauchsbasierte Lizenzen anbieten und generative KI einbetten, die Eingaben in natürlicher Sprache in Code umwandelt.

Die Akzeptanz von Datenverwaltungssoftware beschleunigt sich als Reaktion auf den EU-Datenakt und den California Consumer Privacy Act, die eine dokumentierte Datenherkunft vorschreiben. Analyse-Pakete schichten Visualisierungs-, Modellierungs- und Kollaborationsfunktionen über verwaltete Datenspeicher, sodass Fachanwender Informationen ohne SQL-Kenntnisse erkunden können. Die Hardware-Nachfrage hinkt hinterher, da Cloud-Infrastruktur das Rechenwachstum absorbiert. Dennoch behalten spezialisierte Appliances mit GPUs oder Tensor-Beschleunigern eine Nische für latenzempfindliche Aufgaben wie Betrugsbewertung.

Notiz: Segmentanteile aller einzelnen Segmente sind nach dem Kauf des Berichts verfügbar

Nach Bereitstellungsmodell: Hybride Konfigurationen balancieren Souveränität und Elastizität

Cloud-Angebote machten 61,22 % des Umsatzes 2024 aus, was die Attraktivität elastischer Kapazitäten widerspiegelt, doch Datensouveränitätsregeln zwingen Unternehmen dazu, bestimmte Workloads On-Premise zu halten. Hybride Konfigurationen sollen bis 2030 jährlich um 13,94 % wachsen und lokale Datenhaltung mit Remote-Analysediensten verbinden. Finanzinstitute verarbeiten Kartentransaktionen aus Compliance-Gründen in inländischen Rechenzentren, während sie anonymisierte Risikomodelle in der Cloud trainieren. Gesundheitsdienstleister halten elektronische Patientenakten gemäß HIPAA ebenfalls vor Ort und exportieren Genomik-Workloads in speicherintensive Cloud-Knoten.

Hybride Frameworks erhöhen die Governance-Komplexität und erfordern einheitliche Identitäts- und Sicherheitsrichtlinien über Umgebungen hinweg. Kubernetes-Orchestrierung, Container-Images und Infrastructure-as-Code helfen dabei, Bereitstellungs-Pipelines zu standardisieren, sodass Teams Jobs zwischen Clustern verschieben können, wenn sich Preise oder Kapazitäten ändern. On-Premise-Installationen bleiben für ultralatenzarme Steuerungssysteme unverzichtbar, doch ihr Anteil an den Gesamtausgaben sinkt weiter.

Nach Unternehmensgröße: KMU nutzen Cloud-Wirtschaftlichkeit, um Fähigkeitslücken zu schließen

Großunternehmen absorbierten 65,93 % der Ausgaben 2024, angetrieben durch Datensätze im Petabyte-Maßstab und strenge Latenzanforderungen. Kleine und mittlere Unternehmen sollen jedoch mit einer CAGR von 13,66 % wachsen, da verbrauchsbasierte Cloud-Dienste die Einstiegshürden senken. Rund 60 % der KMU nutzen mittlerweile SaaS-Analysen, gegenüber 45 % vor zwei Jahren. Anbieter umwerben diese Gruppe mit kostenlosen Kontingenten, wie BigQuerys monatlichem 1-Terabyte-Kontingent und Vorlagen-Dashboards für Kundenabwanderung, Marketing-Attribution und Bestandsoptimierung.

Größere Unternehmen hingegen erkunden föderierte Architekturen, die Abfragerechte dezentralisieren und gleichzeitig die Governance zentralisieren. Diese Struktur stärkt Geschäftsbereiche und wahrt gleichzeitig unternehmensweite Standards. Mit zunehmender Reife übernehmen viele KMU ähnliche föderierte Muster, um Datensilos zu vermeiden, was eine Konvergenz in der architektonischen Best Practice über Unternehmensgrößen hinweg unterstreicht.

Nach Branchenvertikale: BFSI führt bei den Ausgaben, während das Gesundheitswesen am schnellsten wächst

Der BFSI-Sektor lieferte 25,67 % der Nachfrage 2024, verankert durch Echtzeit-Zahlungsabwicklung und regulatorisches Berichtswesen. JPMorgan Chase allein investierte in jenem Jahr 17 Milliarden USD in Technologie und widmete davon rund 30 % Upgrades der Dateninfrastruktur. Banken weltweit setzen KI-Betrugsmodelle ein, die Falsch-Positiv-Raten im Vergleich zu regelbasierten Systemen um bis zu 60 % reduzieren. Gesundheitswesen und Biowissenschaften, die mit einer CAGR von 15,13 % wachsen, nutzen Genomik-Analysen und kontinuierliche Patientenüberwachung zur Individualisierung von Interventionen. Die Präzisionsmedizin-Pipelines der Mayo Clinic verarbeiten Petabytes an Sequenzdaten und demonstrieren die Tiefe des Datenwachstums in dieser Vertikale.

Einzelhandel, Fertigung, Telekommunikation und Energie intensivieren ebenfalls die Analyse-Akzeptanz, jedoch in moderaterem Tempo. Amazon führt rund 35 % seines Umsatzes auf Empfehlungsmaschinen zurück, die durch Big-Data-Technologie optimiert werden, während Siemens Software für vorausschauende Wartung einsetzt, die ungeplante Ausfallzeiten um bis zu 50 % reduziert. Diese branchenübergreifende Zugkraft unterstreicht die breite Relevanz des Marktes für Big-Data-Technologie.

Geografische Analyse

Nordamerika entfiel 2024 auf 37,19 % des Umsatzes und profitierte von anhaltenden Kapitalausgaben der Hyperscaler sowie einer US-amerikanischen Bundesrichtlinie zur bevorzugten Cloud-Nutzung, die maschinenlesbare öffentliche Datensätze vorschreibt. Der Anreizpool des CHIPS and Science Act in Höhe von 52 Milliarden USD soll die inländische Chip-Versorgung stärken und Risiken bei der Server-Beschaffung mindern. Kanadas Digital Charter Implementation Act betont Datenportabilität und algorithmische Transparenz und stimuliert die Nachfrage nach Herkunfts- und Governance-Tools. Mexiko entwickelt sich zu einem Nearshore-Rechenzentrum-Hub für kontinentale Unternehmen, die eine geringere Latenz für lateinamerikanische Nutzer anstreben.

Asien-Pazifik soll mit einer CAGR von 14,41 % bis 2030 das schnellste regionale Wachstum verzeichnen. Chinas 14. Fünfjahresplan klassifiziert Big-Data-Infrastruktur als strategische Priorität, und Indiens Unified Payments Interface verarbeitet nun über 13 Milliarden monatliche Transaktionen, die Betrugsanalysen in unter einer Sekunde erfordern. Japans Society-5.0-Initiative bettet Sensoren in Fertigungslinien ein, um KI-Qualitätskontrolle zu speisen, während Südkoreas K-Digital-Plattform 5G und Edge-Computing ausbaut, um autonome Mobilität zu unterstützen. Australien schreibt inländische Datenhaltung für Betreiber kritischer Infrastrukturen vor und stärkt hybride Bereitstellungen, die sensible Datensätze lokal halten.

Europa verzeichnet eine langsamere Expansion, da der Datenakt parallele Verarbeitungsumgebungen für grenzüberschreitende Datenflüsse erzwingt und Kosten ohne entsprechende Umsatzgewinne verursacht. DSGVO-Bußgelder belaufen sich bisher auf insgesamt 4,5 Milliarden EUR und halten die Nachfrage nach Compliance-Lösungen aufrecht. Souveräne Cloud-Projekte wie Gaia-X streben Unabhängigkeit von US-amerikanischen Anbietern an, erreichen jedoch noch keine Parität bei Preis und Funktionstiefe. Im Nahen Osten weist Saudi-Arabiens Vision 2030 mehr als 500 Milliarden USD für digitale Infrastruktur zu, während die Vereinigten Arabischen Emirate bis 2031 10 % des BIP aus künstlicher Intelligenz anstreben. Südamerika zeigt stetige, aber verhaltene Fortschritte, da Brasilien die LGPD-Compliance inmitten makroökonomischer Belastungen durchsetzt.

Wettbewerbslandschaft

Der Markt für Big-Data-Technologie weist ein moderat konzentriertes Anbieterfeld auf. Cloud-Hyperscaler integrieren Analysefunktionen vertikal und drücken damit die Margen reiner Software-Anbieter. Databricks und Snowflake konkurrieren auf Basis der Lakehouse-Architektur: Databricks betont die Apache-Spark-Herkunft, während Snowflake Zero-Copy-Datenaustausch in den Vordergrund stellt. MongoDB und Couchbase kämpfen um den Anteil an operativen Datenbanken, wobei MongoDB Vektorsuche für generative KI-Workloads hinzufügt. Confluent kommerzialisiert Apache Kafka für Echtzeit-Streaming, und Elastic konzentriert sich auf Log-Analysen und Observability.

Strategische Schritte konzentrieren sich auf branchenspezifische Lösungen, geografische Reichweite und Ökosystem-Allianzen. Palantir sichert Verteidigungsverträge, die hohe Wechselkosten erzeugen. Teradata migriert Legacy-Kunden durch gemeinsame Angebote mit Microsoft und Google zu Cloud-Abonnements. Start-ups wie Starburst und Dremio nutzen die Nachfrage nach Data-Mesh-Architekturen, indem sie Abfragen ohne zentralisierten Speicher ermöglichen, während Anbieter in den Bereichen Daten-Observability und datenschutzverbessernde Technologien Qualitäts- und Compliance-Lücken schließen. Compliance-Rahmenwerke wie ISO 27001, SOC 2 und HIPAA bleiben eine Grundvoraussetzung, die Beschaffungsentscheidungen prägt.

Marktführer in der Branche für Big-Data-Technologie

Cloudera Inc.

Snowflake Inc.

Databricks Inc.

MongoDB Inc.

Splunk Inc.

- *Haftungsausschluss: Hauptakteure in keiner bestimmten Reihenfolge sortiert

Jüngste Branchenentwicklungen

- September 2025: Confluent veröffentlichte einen verwalteten Apache-Pulsar-Dienst mit Stream-übergreifender Replikation und positioniert das Unternehmen damit als Komplettanbieter für Event-Streaming neben seinen bestehenden Kafka-Angeboten, was Multi-Cloud-Architekturen für Daten in Bewegung vereinfacht.

- Juni 2025: Google Cloud führte BigQuery Omni Edge ein und erweiterte damit föderierte SQL-Abfragen auf On-Premise-Kubernetes-Cluster und konkurrierende Clouds, wodurch Daten-Egress-Kosten gesenkt werden, indem Transformationen dort ausgeführt werden, wo die Daten liegen.

- April 2025: Snowflake startete eine native Vektordatenbank-Engine innerhalb von Snowpark, die Einbettungen im Milliardenmaßstab und Retrieval-Augmented Generation ohne externe Dienste ermöglicht, und kündigte die sofortige allgemeine Verfügbarkeit in allen kommerziellen Regionen an.

- Februar 2025: Databricks übernahm StreamForge, einen Spezialisten für Echtzeit-Apache-Flink, für 1,2 Milliarden USD, um die Niedriglatenz-Verarbeitung innerhalb seiner Lakehouse-Plattform zu vertiefen und ereignisgesteuerte KI-Funktionen zu beschleunigen.

Umfang des globalen Berichts über den Markt für Big-Data-Technologie

Der Bericht über den Markt für Big-Data-Technologie ist segmentiert nach Komponente (Software, Hardware, Dienstleistungen), Bereitstellungsmodell (On-Premise, Cloud, Hybrid), Unternehmensgröße (Großunternehmen sowie kleine und mittlere Unternehmen), Branchenvertikale (Banken, Finanzdienstleistungen und Versicherungen (BFSI), Gesundheitswesen und Biowissenschaften, Einzel- und Konsumgüter, Fertigung, Regierung und öffentlicher Sektor, Telekommunikation und IT, Medien und Unterhaltung, Energie und Versorgungsunternehmen, sonstige Branchenvertikale) sowie Geografie (Nordamerika, Europa, Asien-Pazifik, Nahost und Afrika, Südamerika). Marktprognosen werden in Wertangaben (USD) bereitgestellt.

| Software | Datenverwaltungssoftware |

| Analysesoftware | |

| Hardware | Server |

| Speicher | |

| Dienstleistungen | Professional Services |

| Verwaltete Dienste |

| On-Premise |

| Cloud |

| Hybrid |

| Großunternehmen |

| Kleine und mittlere Unternehmen (KMU) |

| Banken, Finanzdienstleistungen und Versicherungen (BFSI) |

| Gesundheitswesen und Biowissenschaften |

| Einzel- und Konsumgüter |

| Fertigung |

| Regierung und öffentlicher Sektor |

| Telekommunikation und IT |

| Medien und Unterhaltung |

| Energie und Versorgungsunternehmen |

| Sonstige Branchenvertikale |

| Nordamerika | Vereinigte Staaten | |

| Kanada | ||

| Mexiko | ||

| Europa | Deutschland | |

| Vereinigtes Königreich | ||

| Frankreich | ||

| Russland | ||

| Übriges Europa | ||

| Asien-Pazifik | China | |

| Japan | ||

| Indien | ||

| Südkorea | ||

| Australien | ||

| Übriger Asien-Pazifik-Raum | ||

| Nahost und Afrika | Naher Osten | Saudi-Arabien |

| Vereinigte Arabische Emirate | ||

| Übriger Naher Osten | ||

| Afrika | Südafrika | |

| Ägypten | ||

| Übriges Afrika | ||

| Südamerika | Brasilien | |

| Argentinien | ||

| Übriges Südamerika | ||

| Nach Komponente | Software | Datenverwaltungssoftware | |

| Analysesoftware | |||

| Hardware | Server | ||

| Speicher | |||

| Dienstleistungen | Professional Services | ||

| Verwaltete Dienste | |||

| Nach Bereitstellungsmodell | On-Premise | ||

| Cloud | |||

| Hybrid | |||

| Nach Unternehmensgröße | Großunternehmen | ||

| Kleine und mittlere Unternehmen (KMU) | |||

| Nach Branchenvertikale | Banken, Finanzdienstleistungen und Versicherungen (BFSI) | ||

| Gesundheitswesen und Biowissenschaften | |||

| Einzel- und Konsumgüter | |||

| Fertigung | |||

| Regierung und öffentlicher Sektor | |||

| Telekommunikation und IT | |||

| Medien und Unterhaltung | |||

| Energie und Versorgungsunternehmen | |||

| Sonstige Branchenvertikale | |||

| Nach Geografie | Nordamerika | Vereinigte Staaten | |

| Kanada | |||

| Mexiko | |||

| Europa | Deutschland | ||

| Vereinigtes Königreich | |||

| Frankreich | |||

| Russland | |||

| Übriges Europa | |||

| Asien-Pazifik | China | ||

| Japan | |||

| Indien | |||

| Südkorea | |||

| Australien | |||

| Übriger Asien-Pazifik-Raum | |||

| Nahost und Afrika | Naher Osten | Saudi-Arabien | |

| Vereinigte Arabische Emirate | |||

| Übriger Naher Osten | |||

| Afrika | Südafrika | ||

| Ägypten | |||

| Übriges Afrika | |||

| Südamerika | Brasilien | ||

| Argentinien | |||

| Übriges Südamerika | |||

Im Bericht beantwortete Schlüsselfragen

Wie groß ist der Markt für Big-Data-Technologie im Jahr 2025?

Die Marktgröße für Big-Data-Technologie beträgt im Jahr 2025 312,07 Milliarden USD.

Wie hoch ist die erwartete Wachstumsrate bis 2030?

Der Markt soll zwischen 2025 und 2030 eine CAGR von 13,34 % verzeichnen.

Welches Komponentensegment wächst am schnellsten?

Software soll mit einer CAGR von 13,89 % wachsen, da Unternehmen plattformunabhängige Analyse-Tools bevorzugen.

Warum gewinnen hybride Bereitstellungen an Bedeutung?

Hybride Architekturen ermöglichen es Unternehmen, Datensouveränitätsvorschriften einzuhalten und gleichzeitig auf elastische Cloud-Dienste zuzugreifen, was eine CAGR von 13,94 % antreibt.

Welche Region wird am schnellsten wachsen?

Asien-Pazifik soll bis 2030 mit einer CAGR von 14,41 % wachsen, angeführt von China, Indien und Japan.

Wie hoch ist das Marktkonzentrationsniveau?

Die fünf führenden Anbieter halten rund 35 % des Software-Umsatzes, was auf eine moderate Konzentration hinweist.

Seite zuletzt aktualisiert am: