Marktgröße und Marktanteil für Agentische KI-Orchestrierung und Speichersysteme

Marktanalyse für Agentische KI-Orchestrierung und Speichersysteme von Mordor Intelligence

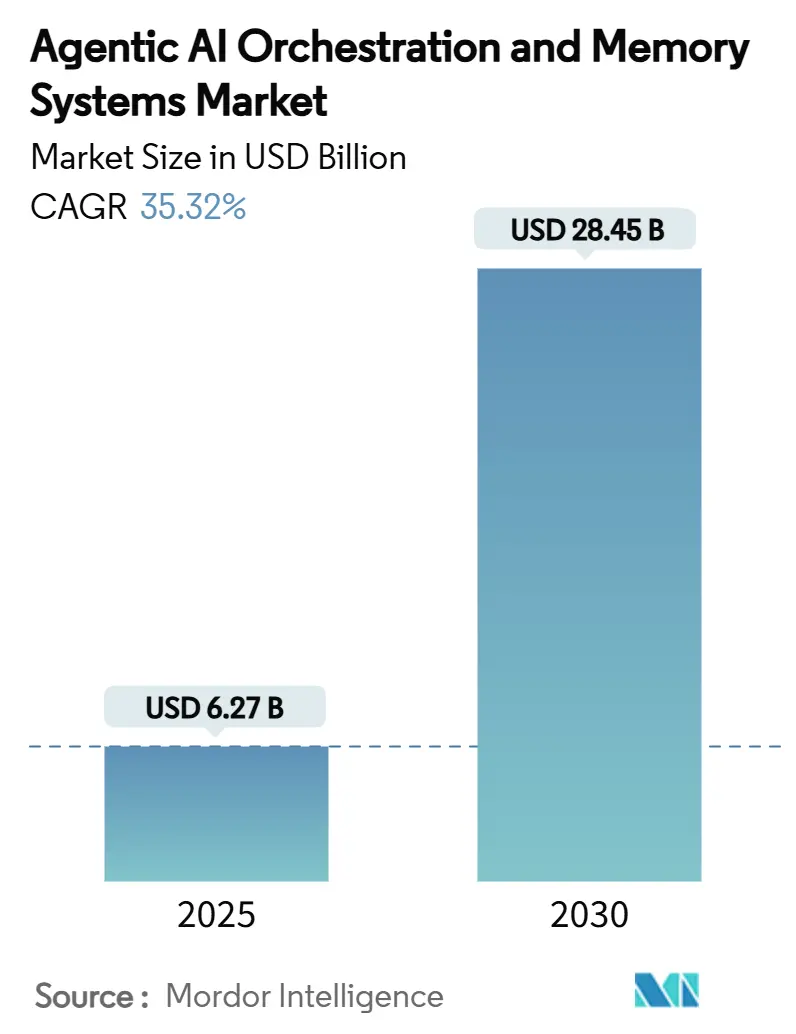

Die Marktgröße für Agentische KI-Orchestrierung und Speichersysteme wird im Jahr 2025 auf 6,27 Milliarden USD geschätzt und soll bis 2030 einen Wert von 28,45 Milliarden USD erreichen, bei einer CAGR von 35,32 % während des Prognosezeitraums (2025–2030). Der zweistellige Anstieg ist darauf zurückzuführen, dass Unternehmen über Pilotprojekte hinaus zu produktionsreifen, autonomen Multi-Agenten-Workflows übergehen, die manuelle Berührungspunkte in Kernoperationen reduzieren. Der Geschäftswert dreht sich nun um Orchestrierungsschichten, die Schlussfolgerung und Handlung koordinieren, während schlüsselfertige Speichersysteme den langfristigen Kontext für jeden Agenten verfügbar halten. In Orchestrierungs-APIs integrierte Vektor-Datenbanken liefern diesen persistenten Speicher, und Cloud-Plattformen betten die Funktionalität als verwalteten Dienst ein, was den Aufbau- und Betriebsaufwand reduziert. Die Wettbewerbsintensität steigt, da große Technologieunternehmen Referenzarchitekturen bündeln, die architektonische Unsicherheit beseitigen, während spezialisierte Start-ups ihren Marktanteil durch tiefere Vektorsuche, engere Beobachtbarkeit und domänenspezifische Workflow-Logik verteidigen. Der Markt für Agentische KI-Orchestrierung profitiert auch von Compliance-Anforderungen, die vollständige Prüfpfade für Aktivitäten großer Sprachmodelle (LLM) erfordern, was die Kontexterhaltung zu einer Priorität auf Vorstandsebene macht[1]Microsoft Corporation, "Azure AI Agent Service," MICROSOFT.COM.

Wichtigste Erkenntnisse des Berichts

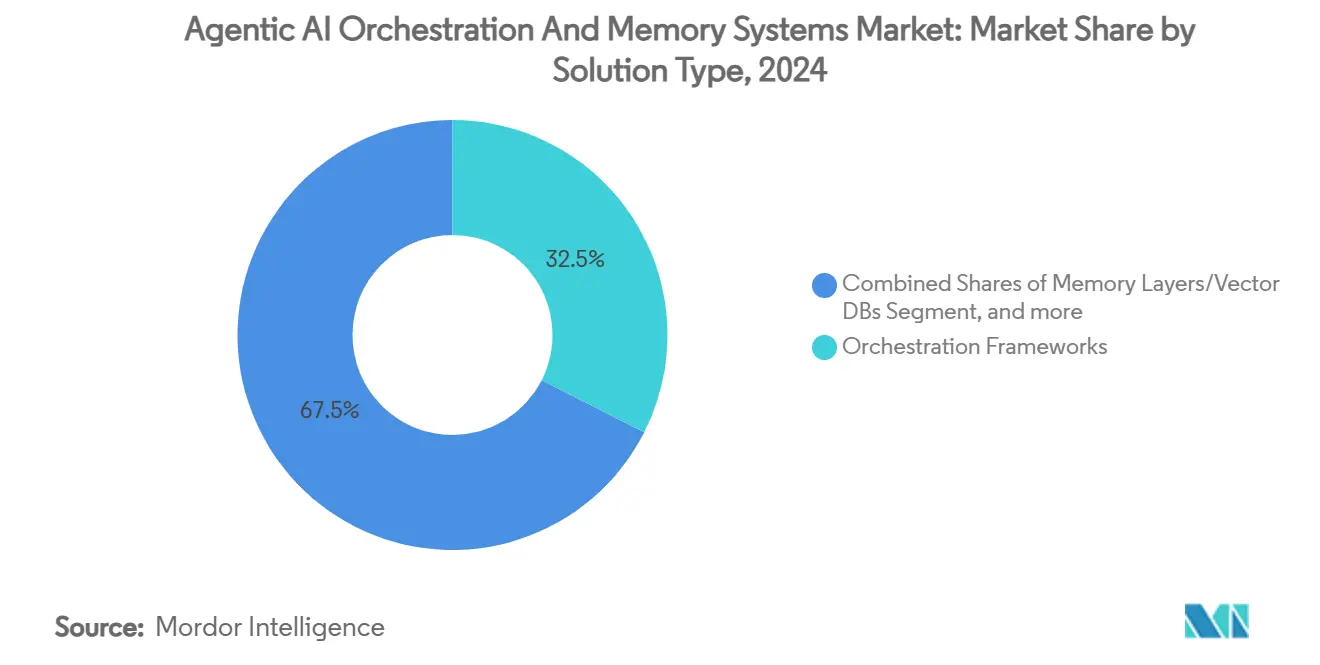

- Nach Lösungstyp hielten Orchestrierungs-Frameworks im Jahr 2024 einen Marktanteil von 32,45 % am Markt für Agentische KI-Orchestrierung, während Beobachtbarkeits- und Testwerkzeuge bis 2030 mit einer CAGR von 37,45 % beschleunigen.

- Nach Bereitstellungsmodus beherrschten Cloud-Plattformen im Jahr 2024 einen Anteil von 67,84 % an der Marktgröße für Agentische KI-Orchestrierung und entwickeln sich bis 2030 mit einer CAGR von 36,50 % weiter.

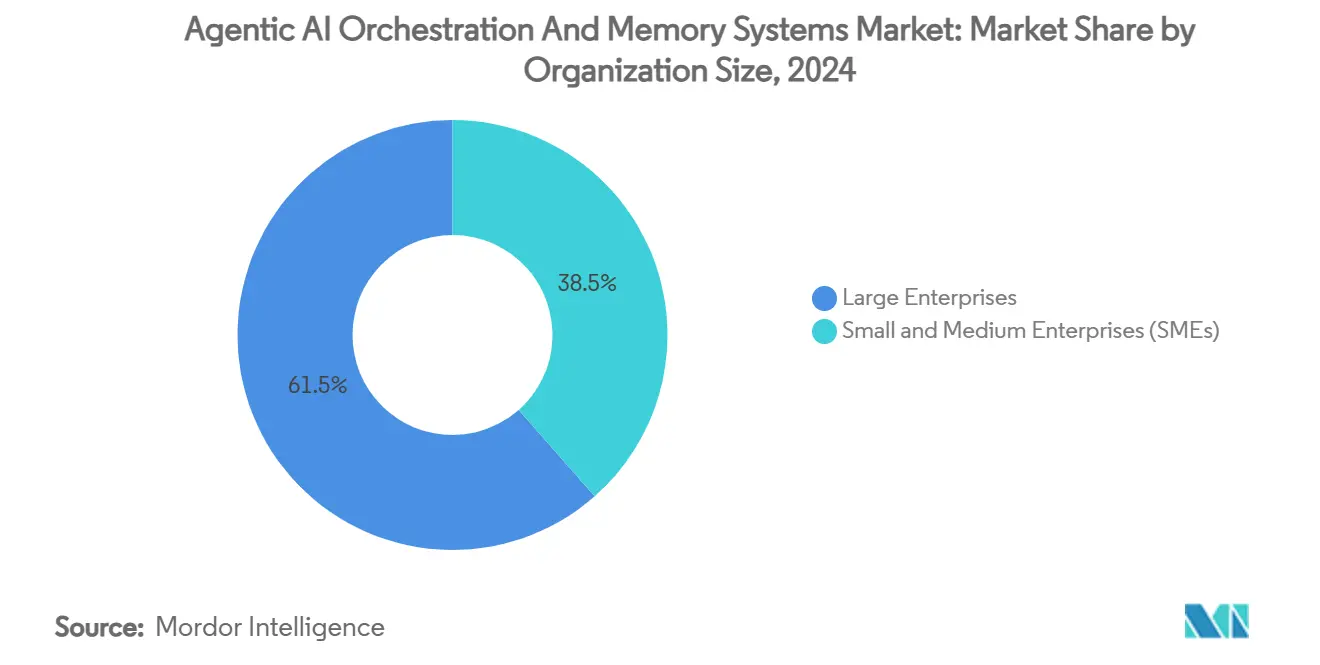

- Nach Unternehmensgröße führten Großunternehmen im Jahr 2024 mit einem Umsatzanteil von 61,47 %; kleine und mittlere Unternehmen expandieren bis 2030 mit einer CAGR von 38,10 %.

- Nach Endnutzerbranche erfasste IT und Telekommunikation im Jahr 2024 einen Anteil von 23,40 % am Markt für Agentische KI-Orchestrierung, während Einzel- und E-Commerce bis 2030 voraussichtlich mit einer CAGR von 37,19 % wachsen wird.

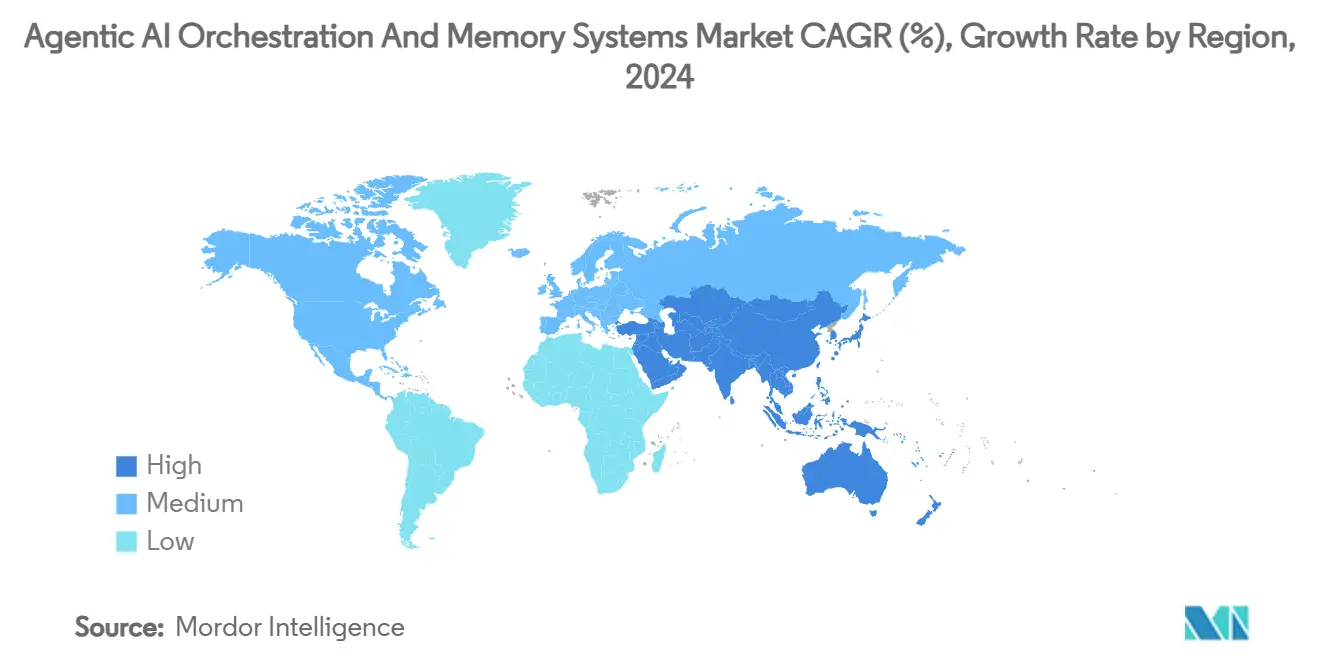

- Nach Geografie entfiel auf Nordamerika im Jahr 2024 ein Umsatzanteil von 40,40 %; der asiatisch-pazifische Raum verzeichnet die schnellste CAGR von 37,89 % bis 2030.

Globale Trends und Erkenntnisse im Markt für Agentische KI-Orchestrierung und Speichersysteme

Analyse der Treiberwirkung

| Treiber | (~) % Auswirkung auf die CAGR-Prognose | Geografische Relevanz | Zeithorizont der Auswirkung |

|---|---|---|---|

| Cloud-native Agent-Ops-Stacks gewinnen an Bedeutung bei CIOs | +8.20% | Global, mit frühen Gewinnen in Nordamerika und der EU | Mittelfristig (2–4 Jahre) |

| Konvergenz von Vektor-Datenbanken und Orchestrierungs-APIs zu schlüsselfertigen Speicherschichten | +7.80% | Global | Kurzfristig (≤ 2 Jahre) |

| Unternehmens-Multi-Agenten-Pilotprojekte wechseln 2025 von Machbarkeitsstudien zur Produktion | +6.50% | Nordamerika und EU als Kern, Ausweitung auf den asiatisch-pazifischen Raum | Kurzfristig (≤ 2 Jahre) |

| Referenzarchitekturen großer Technologieanbieter senken das Einführungsrisiko | +5.90% | Global | Mittelfristig (2–4 Jahre) |

| Steigende Compliance-Anforderungen für LLM-Prüfpfade treiben persistenten Speicher voran | +4.70% | Nordamerika und EU, Ausweitung auf den asiatisch-pazifischen Raum | Langfristig (≥ 4 Jahre) |

| Entstehung offener Protokolle (A2A, MCP), die Plug-and-Play-Agenten-Netze ermöglichen | +3.10% | Global | Langfristig (≥ 4 Jahre) |

| Quelle: Mordor Intelligence | |||

Cloud-Native Agent-Ops-Stacks gewinnen an Bedeutung bei CIOs

Chief Information Officers klassifizieren Orchestrierungs- und Speichersysteme als strategische Infrastruktur und ersetzen die Wahrnehmung von Agentischer KI als experimentellen Zusatz. Die Ausgaben verlagern sich auf Cloud-native Agent-Ops-Plattformen, da diese mit bestehenden DevOps-Pipelines und Sicherheitswerkzeugen harmonieren. Microsofts Azure AI Agent Service bettet die Orchestrierung direkt in virtuelle Netzwerkgrenzen ein, sodass Unternehmen Multi-Agenten-Flows ohne zusätzlichen Integrationsaufwand starten können. Frühe Anwender berichten von Einsparungen bei den Betriebskosten von 30–40 %, sobald Reasoning-Agenten repetitive menschliche Aufgaben ersetzen[2] Boston Consulting Group, "How AI Agents Are Opening the Golden Era of Customer Experience," BCG.COM . Die integrierten Governance-Module erfüllen regulatorische Anforderungen an die Erklärbarkeit und positionieren Cloud-native Architekturen als Standard für neue Bereitstellungen bis 2030. Da groß angelegte Projekte Skalierung erreichen, bewerten CIOs Anbieter-Roadmaps anhand von drei Kennzahlen – Latenz unter gleichzeitiger Last, automatisierte Rollout-Sicherheit und vollständige Herkunftsprotokollierung – und wandeln diese Kriterien in mehrjährige Plattformverträge um.

Konvergenz von Vektor-Datenbanken und Orchestrierungs-APIs zu schlüsselfertigen Speicherschichten

Die Einschränkungen zustandsloser Agenten schwinden, da Vektor-Speicher-Indizierung und Orchestrierungslogik nun in einer einzigen verwalteten Schicht ineinandergreifen. Mem0 AI kombiniert semantische Suche mit hoher Trefferquote mit Workflow-Auslösern, sodass jeder Agenten-Aufruf den Kontext in derselben atomaren Transaktion abruft, aktualisiert und speichert[3] Mem0 AI, "Memory Layer Platform," MEM0.AI . Unternehmen, die diese schlüsselfertigen Speicherschichten installieren, verzeichnen eine um 40–60 % höhere Aufgabenerledigungsgenauigkeit im Vergleich zu zustandslosen Ausgangswerten. Der technologische Sprung resultiert aus der späten Bindung von Einbettungen: Speicherschreibvorgänge erfolgen nur, wenn Relevanzbewertungen Richtlinienschwellenwerte überschreiten, was die Ausbreitung von Vektor-Speichern kontrolliert. Mit gelöster Persistenz überarbeiten Architekten durchgängige Geschäftsprozesse – beispielsweise erstrecken sich Order-to-Cash-Flows nun über mehrere Geschäftszyklen ohne Kontextverlust, und Agenten referenzieren monatelange Lieferantenverhandlungen bei Echtzeit-Preisentscheidungen. Diese strukturelle Fähigkeit setzt die Erwartungen neu, was autonome Systeme innerhalb von Unternehmens-Workflows abdecken können.

Unternehmens-Multi-Agenten-Pilotprojekte wechseln 2025 von Machbarkeitsstudien zur Produktion

Die Machbarkeitsstudienphase entfällt für viele Fortune-1000-Unternehmen im Jahr 2025. Wells Fargo hat ein Kundenservice-Agenten-Netz über Sprach-, Chat- und E-Mail-Kanäle live geschaltet und messbare Reduzierungen der durchschnittlichen Bearbeitungszeit sowie eine Steigerung der Kundenzufriedenheitswerte veröffentlicht. Die Produktionsreife beschleunigte sich, da Beobachtbarkeits-Stacks nun jeden Agenten-Entscheidungsbaum erfassen und Compliance-Beauftragten ermöglichen, Interaktionen auf Abruf wiederzugeben. Databricks-Umfragedaten zeigen, dass 60 % der Unternehmen im Jahr 2025 mindestens einen Piloten in die Produktion überführen werden, ein dreifacher Anstieg gegenüber 2024. Diese Pipeline von Inbetriebnahmen zwingt Anbieter, eine Vier-Neunen-Verfügbarkeit für Orchestrierungs-Engines zu garantieren und Rollback-Strategien anzubieten, wenn emergentes Agentenverhalten von der Richtlinie abweicht. Mit wachsenden Produktionsbeständen gewichten Käufer zunehmend die Support-SLAs und Incident-Response-Frameworks der Anbieter ebenso stark wie deren reine Modellqualitäts-Benchmarks.

Referenzarchitekturen großer Technologieanbieter senken das Einführungsrisiko

Microsoft, Google und AWS nutzen ihre Cloud-Präsenz, indem sie Full-Stack-Referenzdesigns liefern. Googles Vertex AI Memory Bank verknüpft persistenten Vektor-Speicher mit bestehenden Identitäts- und Zugriffsmanagement-Richtlinien und beschleunigt Sicherheitsüberprüfungen. AWS Bedrock Agents bündeln Token-Level-Schutzmaßnahmen vorab, sodass Finanzinstitute Compliance-Hürden in Wochen statt Quartalen überwinden können. Unternehmen, die diese Vorlagen übernehmen, berichten von einer Verkürzung der Bereitstellungszyklen um 50–70 %, was zu Genehmigungen auf Vorstandsebene für umfangreichere Rollouts führt. Referenzarchitekturen kodifizieren bewährte Verfahren, sodass selbst Unternehmen mit kleinen KI-Teams Multi-Agenten-Anwendungen aufbauen können, die interne Architekturprüfungsausschüsse bestehen. Diese Blaupausen verankern große Technologieanbieter im Orchestrierungskern, erweitern aber auch das gesamte adressierbare Ausgabenvolumen, indem sie risikoaverse Sektoren wie das Gesundheitswesen und die öffentliche Verwaltung überzeugen.

Analyse der Hemmnisse

| Hemmnis | (~) % Auswirkung auf die CAGR-Prognose | Geografische Relevanz | Zeithorizont der Auswirkung |

|---|---|---|---|

| Unreife Beobachtbarkeits- und Debugging-Toolchain für Multi-Agenten-Workflows | -4.20% | Global | Kurzfristig (≤ 2 Jahre) |

| Hohe Vektor-Speicher-Inferenzkosten bei Skalierung für langfristigen Kontext | -3.80% | Global | Mittelfristig (2–4 Jahre) |

| Fragmentierte Standards erzeugen Interoperabilitätsaufwand | -2.90% | Global | Langfristig (≥ 4 Jahre) |

| Datensouveränitätsbedenken begrenzen grenzüberschreitende Speicherreplikation | -2.10% | EU und asiatisch-pazifischer Raum als Kern, regulatorische Ausweitung global | Langfristig (≥ 4 Jahre) |

| Quelle: Mordor Intelligence | |||

Unreife Beobachtbarkeits- und Debugging-Toolchain für Multi-Agenten-Workflows

Unternehmen stehen vor Überwachungslücken, da herkömmliche Dashboards für das Anwendungsleistungsmanagement keine Agenten-Gedankenspuren oder emergente Kollaborationsmuster analysieren. Deepchecks listet nur eine Handvoll zweckgebundener LLM-Beobachtbarkeitsprodukte auf, und die Funktionsparität mit ausgereiften Anwendungsleistungsmanagement-Suiten fehlt noch[4] Deepchecks, "Top 5 LLM Observability Tools," DEEPCHECKS.COM . Ohne vollständige Introspektion haben Teams Schwierigkeiten, Belohnungsfunktionen zu verfeinern oder Race Conditions zu isolieren, wenn Agenten über Mikrodienste hinweg koordinieren. XenonStack stellt fest, dass 40–50 % der ins Stocken geratenen Produktions-Rollouts fehlende Debugging-Telemetrie als Hauptursache nennen. Diese Barriere verlangsamt regulierte Branchen überproportional, die jeden algorithmischen Schritt nachweisen müssen. Anbieter beeilen sich, Trace-Visualisierer und Anomalieerkenner zu liefern, die auf Agenten-Graphen zugeschnitten sind, doch bis die Abdeckung die DevSecOps-Erwartungen erreicht, dämpft das Bereitstellungsrisiko das kurzfristige Wachstum weiterhin.

Hohe Vektor-Speicher-Inferenzkosten bei Skalierung für langfristigen Kontext

Die Pflege von Speicherfenstern mit Millionen von Dokumenten in Vektor-Datenbanken ist rechenintensiv, insbesondere wenn Einbettungen nach dem Feinabstimmen neu berechnet werden. AI Multiple berechnet, dass der Vektorabruf in datenintensiven Branchen 30–40 % der Betriebskosten lebender Agenten ausmachen kann[5] AI Multiple, "AI Agent Performance: Success Rates & ROI in 2025," AIMULTIPLE.COM . Rapid Innovation berichtet von ähnlichen Kostenverhältnissen bei Lieferkettenimplementierungen, bei denen Agenten jahrelange Versandhistorien abrufen. Die Preiskurve steigt nichtlinear, da Ähnlichkeitssuchen große Indexpartitionen berühren, wenn der Kontext zunimmt. Kleinere Unternehmen begrenzen daher die Vektortiefe, was die Reasoning-Qualität der Agenten beeinträchtigt. Anbieter experimentieren mit hybridem Speicher, der kalte Vektoren in Objektspeicher auslagert und sie bei Bedarf reaktiviert, aber kommerzielle Nachweise bleiben begrenzt. Bis sich die Kostenkurven abflachen, werden einige CFOs den Projektumfang begrenzen und damit die ansonsten steile Einführungstrajektorie beschneiden.

Segmentanalyse

Nach Lösungstyp: Beobachtbarkeitswerkzeuge stärken das Unternehmensvertrauen

Beobachtbarkeits- und Testplattformen verzeichneten bis 2030 die schnellste CAGR von 37,45 %, da Unternehmen erkannten, dass zuverlässige Produktionsagenten eine tiefe Instrumentierung erfordern. Das Segment gewann an Dynamik, sobald Agenten-Traces, Token-Level-Attribution und Richtlinienverletzungswarnungen zu Prüfanforderungen auf Vorstandsebene wurden. Im Jahr 2024 besaßen Orchestrierungs-Frameworks noch den größten Anteil von 32,45 % an der Marktgröße für Agentische KI-Orchestrierung, doch das Wachstum verlangsamte sich, da Frameworks reiften und neue Käufer Überwachungs-Add-ons priorisierten. AgentOps und ähnliche Anbieter monetarisierten diese Lücke mit Dashboards, die jeden Reasoning-Schritt wiedergeben und Ursachendiagnosen aufzeigen[6] AgentOps, "AgentOps Platform," AGENTOPS.AI . Die hohe Akzeptanz in den Bereichen Finanzdienstleistungen und Gesundheitswesen signalisiert, dass Beobachtbarkeit nicht mehr optional ist.

Ausgefeilte Speicherschichten, die Vektorsuche mit rollenbasierter Zugriffskontrolle verbinden, bildeten den zweitgrößten Umsatzanteil. Workflow-Engines generieren weiterhin stetige Abonnementverlängerungen, da sie das Rückgrat für die Aufgabensequenzierung über Agenten hinweg bleiben. Kontextmanagement-SDKs sprechen Entwickler-Tooling-Teams an, die Abstraktionen für die Agentenzustandsverwaltung und Prompt-Versionierung benötigen. Die Vielfalt der Toolsets unterstreicht, dass Multi-Agenten-Orchestrierung ein Ökosystem und keine einzelne Produktkategorie ist, und Käufer bündeln häufig mehrere Komponenten verschiedener Anbieter, um vollständige Lebenszyklusanforderungen zu erfüllen.

Notiz: Segmentanteile aller einzelnen Segmente sind nach dem Berichtskauf verfügbar

Nach Bereitstellungsmodus: Cloud-Dominanz beschleunigt sich

Die Cloud-Bereitstellung erfasste im Jahr 2024 einen Anteil von 67,84 % am Markt für Agentische KI-Orchestrierung und soll mit einer CAGR von 36,50 % wachsen, was On-Premises-Installationen weit übertrifft. Öffentliche Cloud-Anbieter abstrahieren die operative Komplexität der Sharding-Vektor-Speicher, automatischen Skalierung von Kontextfenstern und Aktualisierung von Orchestrierungs-Laufzeiten. Unternehmen tendieren zu verwalteten Endpunkten, die rollenbasierte Governance bieten und gleichzeitig horizontal auf Abruf skalieren. Hybride Muster treten weiterhin auf, wenn als streng vertraulich eingestufte Daten in privaten Clustern verbleiben, während Orchestrierungs- und Inferenzverkehr in Cloud-VPCs verbleibt. Nexos.ais Gateway-Schicht, die Anfragen über 200 LLM-Endpunkte weiterleitet, veranschaulicht, warum Unternehmen als-Dienst-Gateways gegenüber selbstverwalteten Clustern bevorzugen[7] Nexos.ai, "AI Gateway: Next-Level LLM Management for Enterprises," NEXOS.AI .

On-Premises-Aufbauten bestehen weiterhin im Verteidigungsbereich und in bestimmten EU-Behördenkontexten, wo Datensouveränitätsregeln eine externe Speicherung ausschließen. Selbst dort liefern Anbieter schlüsselfertige Appliances, die Cloud-Orchestrierungs-Stacks hinter Unternehmens-Firewalls nachahmen. Die kontinuierliche Härtung souveräner Cloud-Zonen in Japan und Indien verringert die Zurückhaltung regulierter Branchen, was darauf hindeutet, dass der Cloud-Anteil selbst in historisch On-Premises-dominierten Bereichen wachsen wird. Angesichts dieser Trends erwarten Investoren, dass die Bruttomargenpools der Cloud-Plattformen zunehmen, da margenstarke Orchestrierungsdienste natürlich in bestehende Rechen- und Speicherausgaben upsellen.

Nach Unternehmensgröße: KMU treiben die Demokratisierung voran

Kleine und mittlere Unternehmen wuchsen bis 2030 mit einer bemerkenswerten CAGR von 38,10 %, doch Großunternehmen behalten die Umsatzdominanz aufgrund von Auftragsgrößen, die Hunderte von Agenten-Lizenzen und Vektor-Speicher im Terabyte-Maßstab bündeln. Der Demokratisierungsbogen basiert auf Kosteneffizienz: KMU können nun Einstiegs-Orchestrierungsprojekte für 20.000 bis 60.000 USD starten, eine Schwelle, die aus Betriebsbudgets statt aus mehrjährigen Investitionsausgaben erreichbar ist. Fertige Vorlagen für Marketingautomatisierung oder Helpdesk-Triage ermöglichen es kleineren Unternehmen, auf Data-Science-Einstellungen zu verzichten, die sie sich nicht leisten können. OECD-Analysen zeigen, dass Qualifikationslücken das größte Einführungshindernis bleiben, weshalb Anbieter Low-Code-Orchestrierungsstudios und integrierte Prompt-Bibliotheken einbetten, um Lernkurven zu glätten.

Großunternehmen behalten die Führung, da sie Agenten über ERP-, CRM- und Lieferkettennetzwerke integrieren und hochwertige Serviceaufträge für Systemintegratoren schaffen. Sie verhandeln auch Mengenrabatte auf Vektor-Speicher und Prioritätssupport. Doch mit zunehmender Verbreitung von Vorlagenbibliotheken werden KMU-Wachstumszahlen die Volumenmetriken aufrechterhalten, die Cloud-Anbieter nutzen, um fortlaufende F&E-Investitionen in Orchestrierungsfunktionen zu rechtfertigen.

Nach Endnutzerbranche: Einzelhandelstransformation führt das Wachstum an

IT und Telekommunikation erfassten im Jahr 2024 23,40 % des Umsatzes, da Telekommunikationsunternehmen autonome Netzwerküberwachungsagenten benötigten und IT-Outsourcer die Orchestrierung in verwaltete Dienste bündelten. Einzel- und E-Commerce werden jedoch die höchste CAGR von 37,19 % erzielen, da konversationelle Einkaufs- und dynamische Preisagenten unmittelbare Umsatzsteigerungen zeigen. Fast Company dokumentiert zweistellige Konversionssteigerungen für Marken, die KI-Einkaufsassistenten einsetzen, die frühere Browsing-Aktivitäten erinnern, Rabatte aushandeln und Checkout-Flows automatisch ausfüllen. Die Akzeptanz im Bereich Banken, Finanzdienstleistungen und Versicherungen folgt eng mit Betrugserkennnungsagenten, die kontextuelle Muster mit Millisekunden-Latenz querverweisen. Das Gesundheitswesen setzt Orchestrierung trotz regulatorischem Aufwand für die Verwaltung von Arzneimittelstudien-Daten ein, während die Fertigung autonome Planung für vorausschauende Wartung anwendet.

Die Marktgröße für Agentische KI-Orchestrierung für Einzelhandels-Personalisierungsagenten soll bis 2030 4 Milliarden USD übersteigen, was widerspiegelt, wie Umsatzgewinne an der Kundenfront die Systemeinführungskosten rechtfertigen. Die industrielle Akzeptanz wächst stetig, da Fabriken Robotik instrumentieren, doch der Gesamtanteil hinkt Dienstleistungsbranchen hinterher, in denen digitale Interaktionen dominieren.

Geografische Analyse

Nordamerika hielt im Jahr 2024 einen Umsatzanteil von 40,40 % aufgrund von First-Mover-Unternehmenspiloten und einem regulatorischen Flickenteppich, der überprüfbare Prüfpfade erfordert und Käufer zu ausgereiften US-amerikanischen Orchestrierungs-Stacks drängt. Der asiatisch-pazifische Raum verzeichnet nun die steilste CAGR von 37,89 % bis 2030, da souveräne KI-Budgets in China, Japan und Indien heimische Orchestratoren subventionieren, die für lokale Compliance-Regeln optimiert sind. Nationale Subventionen senken Beschaffungshürden, und Fertigungsschwergewichte rüsten Agenten-Netze in Lieferketten-Kontrolltürme nach. Europas Wachstum ist stetig, aber vergleichsweise langsamer, da die DSGVO und der bevorstehende EU-KI-Act die Sorgfaltspflichtzyklen der Anbieter verlängern. Dennoch gewinnen europäische Plattformen, die Privacy-by-Design einbauen, Akzeptanz in datensensiblen Branchen.

Südamerika verzeichnet frühe Akzeptanz, die sich auf Brasiliens digitales Bankwesen konzentriert. Der Nahe Osten und Afrika verfolgen Digitalisierungsagenden in der Öl- und Gasindustrie sowie im öffentlichen Sektor, obwohl Qualifikationsmangel die Geschwindigkeit dämpft. Insgesamt verändert die APAC-Expansion die Anbieter-Roadmaps: Sprachunterstützung, regionale Compliance-Adapter und inländische Rechenzentrumskapazitäten werden zu Mindestanforderungen für globale Anbieter.

Wettbewerbslandschaft

Das Wettbewerbsfeld zeigt eine moderate Fragmentierung. Microsoft, Google und AWS bündeln Orchestrierung in Cloud-Konten und nutzen bestehende Ausgabenanker, um fortgeschrittene Agentendienste zu upsellen. Azure definiert ein Modell der geteilten Verantwortung, das die Datenherkunft dem Kunden zuweist, während Microsoft die Orchestrierungs-Laufzeit verwaltet, was Risikoteams gefällt, die Klarheit über die Haftung bei Datenschutzverletzungen wünschen. Google und AWS verfolgen parallele Strategien mit verwalteten Speicherbänken und Schutzrichtlinien. Ihre Skalierung ermöglicht bevorzugte GPU-Preisgestaltung und Genehmigungen für die nationale Sicherheit, was ihnen hilft, stark regulierte Konten zu gewinnen.

Spezialisten kontern durch Vertiefung vertikaler Fähigkeiten. Pinecone konzentriert sich auf ultraschnelle Vektorsuche mit unternehmensweiten Zugriffskontrollen. LangChain bietet ein Open-Source-Framework, das das Onboarding von Entwicklern durch zusammensetzbare Prompt-Ketten beschleunigt und Self-Hosting für Unternehmen unterstützt, die Cloud-Abhängigkeit scheuen. Mem0 AI erfasst Datensätze, bei denen die Kontexterhaltung Jahre umfasst, wie z. B. Kundendaten im Vermögensverwaltungsbereich. Start-ups wie CrewAI Labs differenzieren sich durch iterative Planungsalgorithmen, die die Multi-Agenten-Zusammenarbeit in komplexen Workflows optimieren.

NVIDIAs Übernahme von Run:ai für 700 Millionen USD unterstreicht, dass Orchestrierung nicht mehr eine Feature-Schicht, sondern ein strategischer Kontrollpunkt für KI-Infrastruktur ist[8] TechCrunch, "Nvidia Acquires AI Workload Management Startup Run:ai for USD 700 Million," TECHCRUNCH.COM . Ebenso drängen offene Protokollinitiativen (A2A, MCP) Anbieter zur Interoperabilität, da Unternehmensarchitekten gegen geschlossene Ökosysteme rebellieren. Die langfristige Wettbewerbsgrenze hängt daher von zwei Fragen ab: Wer garantiert die niedrigste Gesamtlatenz vom Prompt zur Aktion, und wer bietet die portabelste Agentendefinitionssprache, die Anbieterwechsel ohne Neugestaltung übersteht.

Branchenführer im Markt für Agentische KI-Orchestrierung und Speichersysteme

-

Pinecone Inc.

-

LangChain Technologies Ltd.

-

OpenAI LLC

-

UiPath Inc.

-

ServiceNow Inc.

- *Haftungsausschluss: Hauptakteure in keiner bestimmten Reihenfolge sortiert

Jüngste Branchenentwicklungen

- Januar 2025: Nexos.ai sammelte 8 Millionen USD ein, um ein Gateway zu starten, das den Datenverkehr über 200 kommerzielle LLMs weiterleitet und einheitliche Sicherheitsrichtlinien durchsetzt. Die Finanzierung unterstreicht die Überzeugung von Risikokapitalgebern, dass Multi-Modell-Orchestrierung die Anbieterabhängigkeit reduziert und die Kosten pro Token optimiert. Die Strategie zielt darauf ab, Nexos.ai als neutrale Broker-Schicht zu positionieren, die Unternehmen über proprietären Endpunkten einsetzen.

- Dezember 2024: NVIDIA schloss den Kauf von Run:ai für 700 Millionen USD ab, um GPU-Scheduling und KI-Workload-Management direkt in Orchestrierungs-Pipelines einzubetten. Der Schritt stärkt NVIDIAs Griff auf den Inferenz-Stack und bietet Kunden eine Ein-Klick-Bereitstellung vom GPU-Slice bis zur Multi-Agenten-Bereitstellung, was den Marktanteil von reinen Software-Orchestratoren ohne Hardware-Optimierung verschieben könnte.

- November 2024: Microsofts allgemeine Verfügbarkeit des Azure AI Agent Service lieferte unternehmensgerechte Orchestrierung sowie Vorlagenbibliotheken für Finanzen, Gesundheitswesen und Einzelhandel. Der Rollout zielt darauf ab, Machbarkeitsstudienzeiträume zu verkürzen und Azure als Standard-Startplattform für Produktionsagenten-Bestände zu festigen, die Compliance-Schutzmaßnahmen erfordern.

- Oktober 2024: Google führte Vertex AI Memory Bank mit regionsübergreifender Replikation und Datenschutzkontrollen ein. Die Markteinführung adressiert den Schmerzpunkt des persistenten Kontexts und richtet sich an EU-Kunden, die Datenspeicherungsgarantien benötigen. Googles Wette ist, dass integrierte Datenschutzzertifizierungen regulierte Branchen erschließen werden, die bisher zögerten, Einbettungen offshore zu speichern.

- September 2024: LangChain Technologies sicherte sich eine Series-A-Finanzierung von 25 Millionen USD unter der Führung von Sequoia Capital, um sein Open-Source-Framework für Unternehmens-Workloads zu stärken. Das Kapital finanziert Roadmap-Elemente wie natives RBAC, Prompt-Versions-Herkunft und Premium-Support-Stufen, die Community-Zugkraft in monetarisierbare Dienste umwandeln und dabei die Offenheit bewahren.

Berichtsumfang des globalen Marktes für Agentische KI-Orchestrierung und Speichersysteme

| Orchestrierungs-Frameworks |

| Speicherschichten / Vektor-Datenbanken |

| Workflow-Engines |

| Kontextmanagement-SDKs |

| Beobachtbarkeits- und Testwerkzeuge |

| Cloud |

| On-Premises / Selbst-gehostet |

| Großunternehmen |

| Kleine und mittlere Unternehmen (KMU) |

| IT und Telekommunikation |

| Banken, Finanzdienstleistungen und Versicherungen |

| Gesundheitswesen und Biowissenschaften |

| Einzel- und E-Commerce |

| Fertigung |

| Sonstige (öffentliche Verwaltung, Bildung usw.) |

| Nordamerika | Vereinigte Staaten | |

| Kanada | ||

| Mexiko | ||

| Südamerika | Brasilien | |

| Argentinien | ||

| Kolumbien | ||

| Übriges Südamerika | ||

| Europa | Vereinigtes Königreich | |

| Deutschland | ||

| Frankreich | ||

| Italien | ||

| Spanien | ||

| Russland | ||

| Übriges Europa | ||

| Asiatisch-Pazifischer Raum | China | |

| Japan | ||

| Südkorea | ||

| Indien | ||

| Australien | ||

| Übriger asiatisch-pazifischer Raum | ||

| Naher Osten und Afrika | Naher Osten | Saudi-Arabien |

| Vereinigte Arabische Emirate | ||

| Übriger Naher Osten | ||

| Afrika | Südafrika | |

| Ägypten | ||

| Übriges Afrika | ||

| Nach Lösungstyp | Orchestrierungs-Frameworks | ||

| Speicherschichten / Vektor-Datenbanken | |||

| Workflow-Engines | |||

| Kontextmanagement-SDKs | |||

| Beobachtbarkeits- und Testwerkzeuge | |||

| Nach Bereitstellungsmodus | Cloud | ||

| On-Premises / Selbst-gehostet | |||

| Nach Unternehmensgröße | Großunternehmen | ||

| Kleine und mittlere Unternehmen (KMU) | |||

| Nach Endnutzerbranche | IT und Telekommunikation | ||

| Banken, Finanzdienstleistungen und Versicherungen | |||

| Gesundheitswesen und Biowissenschaften | |||

| Einzel- und E-Commerce | |||

| Fertigung | |||

| Sonstige (öffentliche Verwaltung, Bildung usw.) | |||

| Nach Geografie | Nordamerika | Vereinigte Staaten | |

| Kanada | |||

| Mexiko | |||

| Südamerika | Brasilien | ||

| Argentinien | |||

| Kolumbien | |||

| Übriges Südamerika | |||

| Europa | Vereinigtes Königreich | ||

| Deutschland | |||

| Frankreich | |||

| Italien | |||

| Spanien | |||

| Russland | |||

| Übriges Europa | |||

| Asiatisch-Pazifischer Raum | China | ||

| Japan | |||

| Südkorea | |||

| Indien | |||

| Australien | |||

| Übriger asiatisch-pazifischer Raum | |||

| Naher Osten und Afrika | Naher Osten | Saudi-Arabien | |

| Vereinigte Arabische Emirate | |||

| Übriger Naher Osten | |||

| Afrika | Südafrika | ||

| Ägypten | |||

| Übriges Afrika | |||

Im Bericht beantwortete Schlüsselfragen

Was treibt das schnelle Wachstum des Marktes für Agentische KI-Orchestrierung an?

Persistente Speicherschichten, Cloud-native Bereitstellung und fertige Referenzarchitekturen haben das Implementierungsrisiko gesenkt und ein CAGR-Wachstum von 35,32 % bis 2030 freigesetzt.

Wie groß wird der Markt für Agentische KI-Orchestrierung bis 2030 sein?

Prognosen setzen die Marktgröße für Agentische KI-Orchestrierung bis 2030 auf 28,45 Milliarden USD auf der Grundlage eines anhaltenden Unternehmens-Rollout-Schwungs.

Welches Lösungssegment expandiert am schnellsten?

Beobachtbarkeits- und Testwerkzeuge skalieren mit einer CAGR von 37,45 %, da Produktionssysteme eine tiefe Überwachung und Fehlersuche benötigen.

Warum setzen KMU jetzt auf Agentische KI?

Cloud-Vorlagen und Low-Code-Studios haben die Einstiegskosten auf 20.000–60.000 USD gesenkt und helfen KMU, Qualifikationslücken zu überwinden und Multi-Agenten-Workflows einzusetzen.

Welche Region wird den größten neuen Umsatz beitragen?

Der asiatisch-pazifische Raum führt mit einer CAGR von 37,89 %, unterstützt durch souveräne KI-Finanzierung und umfangreiche Fertigungsautomatisierungsinitiativen.

Seite zuletzt aktualisiert am: